Um problema silencioso com os sistemas de IA modernos não é que eles careçam de conhecimento. É que às vezes falam com certeza sobre coisas que são apenas parcialmente verdadeiras.

Um modelo pode escrever uma explicação detalhada, citar fontes e estruturar sua resposta de forma organizada. No entanto, uma pequena afirmação dentro da resposta pode estar errada. E a menos que alguém verifique cuidadosamente, o erro simplesmente viaja junto com o resto do texto.

Essa fraqueza se torna mais visível à medida que ferramentas de IA entram em pesquisa, codificação e suporte à decisão.

Então a pergunta naturalmente aparece: quem verifica as respostas?

A maioria dos sistemas hoje depende de soluções centralizadas. Uma única organização constrói o modelo, controla as atualizações e decide como os erros são tratados. Mesmo quando existe revisão externa, a camada de verificação ainda está dentro de uma instituição.

Essa estrutura funciona até certo ponto. Mas também concentra a confiança.

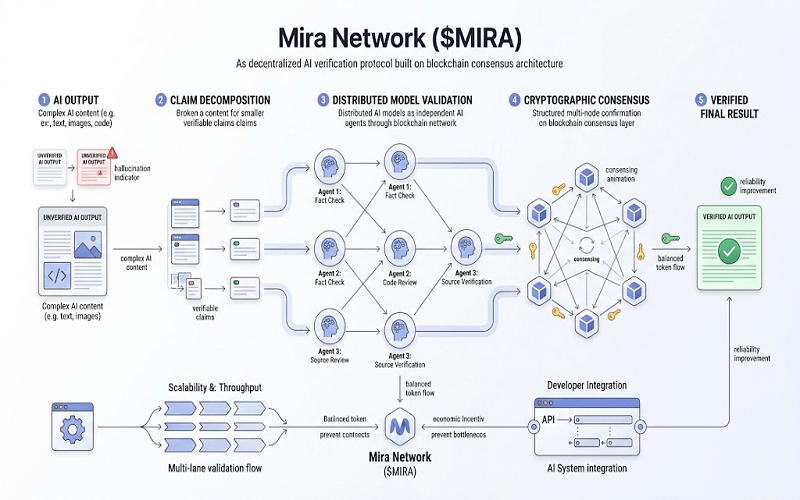

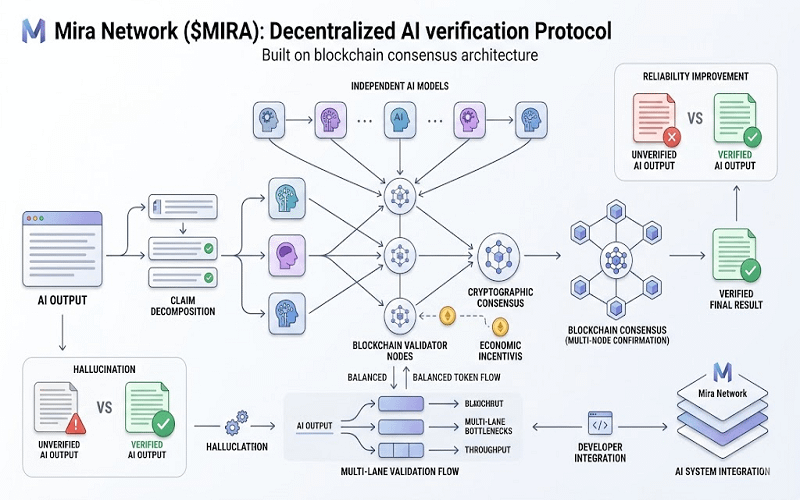

Enquanto lia sobre @Mira - Trust Layer of AI , achei sua abordagem interessante porque parte de uma suposição diferente. Em vez de pedir que uma IA verifique a si mesma, o protocolo trata a verificação como um processo de rede.

A ideia é bastante simples.

Uma resposta de IA pode ser dividida em declarações menores. Cada declaração é basicamente uma reivindicação. Algo como uma data, uma estatística ou uma explicação causal.

Essas reivindicações podem então ser avaliadas separadamente.

Diferentes modelos de IA independentes examinam as partes e submetem seus julgamentos. Alguns confirmam a reivindicação. Outros podem sinalizar incerteza ou discordância. Com o tempo, essas respostas formam um padrão.

É aqui que a camada de blockchain entra.

Em vez de manter o processo de validação dentro dos servidores de uma única empresa, os resultados são registrados por meio de consenso descentralizado. A verificação criptográfica ajuda a garantir que as verificações foram realizadas e registradas de forma transparente.

Em termos práticos, o sistema começa a se assemelhar a uma camada de verificação de fatos distribuída para saídas de IA.

Não há um único árbitro.

Mais como um painel de revisores que não pertencem à mesma instituição.

O token $MIRA desempenha um papel na coordenação desse processo. Participantes que executam modelos de verificação podem ser recompensados por contribuir com verificações precisas. O design econômico tenta incentivar a validação honesta em vez da participação passiva.

É uma tentativa interessante de alinhar incentivos em torno da precisão em vez da velocidade.

Claro, a ideia levanta questões práticas.

Executar múltiplos modelos para verificar cada afirmação pode se tornar computacionalmente caro. Coordenar validadores independentes não é trivial também. E o espaço de infraestrutura de IA descentralizada está se tornando lotado, com vários projetos explorando ideias semelhantes sobre confiança e verificação.

Há também o simples fato de que o ecossistema ainda é jovem.

Protocolos como #Mira e #MiraNetwork são experimentos tanto quanto são infraestrutura. O verdadeiro teste será se esses sistemas podem operar eficientemente quando os pedidos de verificação crescerem.

Ainda assim, o conceito em si parece valer a pena explorar.

À medida que os sistemas de IA produzem mais das informações que as pessoas leem e confiam, a confiabilidade dessas saídas se torna uma preocupação compartilhada. Uma rede projetada para verificar reivindicações coletivamente é uma possível maneira de abordar esse problema.

E às vezes a parte mais interessante não é a tecnologia em si, mas a mudança silenciosa no pensamento por trás dela.