Apresentando Mira: Um Sistema Baseado em Consenso para Verificar a Saída da IA

A IA moderna parece mágica. Fazemos uma consulta e recebemos uma resposta em poucos segundos. Atribuímos um trabalho e ele é concluído imediatamente. Mas há algo perigoso nessa mágica. A melhor IA pode fornecer respostas incorretas ou tendenciosas com certeza. Um exemplo foi a situação em que um chatbot de companhia aérea criou uma política falsa de reembolso, e o cliente realmente perdeu dinheiro, e a companhia aérea deveria pagar a conta. Tais alegações fabricadas são chamadas de alucinações e são bastante prevalentes. Em um estudo de chatbot médico, os pesquisadores estabeleceram que 50-80 por cento das vezes a IA mentiu em vez de afirmar a verdade. De forma concisa, a IA atual é inteligente e fraca.

A inteligência artificial hoje parece quase mágica. Você digita uma pergunta e em segundos uma resposta detalhada aparece. Você atribui uma tarefa e ela é concluída instantaneamente. A velocidade é impressionante, a linguagem é confiante e os resultados muitas vezes parecem inteligentes. Mas por trás dessa experiência suave está um risco silencioso. Os sistemas de IA na verdade não entendem a verdade da maneira que os humanos entendem. Eles preveem padrões com base em probabilidades. Quando essas previsões dão errado, o sistema pode produzir informações que parecem perfeitamente precisas, mas são completamente falsas. Esses erros confiantes, muitas vezes chamados de alucinações, são uma das fraquezas mais sérias na IA moderna.

A questão se torna ainda mais preocupante em áreas como medicina, direito, finanças ou informação pública, onde uma única declaração imprecisa pode ter consequências reais. Modelos de IA são treinados em grandes conjuntos de dados que refletem tanto conhecimento quanto preconceito humano. Como resultado, eles podem, sem querer, repetir preconceitos ocultos ou apresentar perspectivas incompletas. Tornar os modelos maiores e mais avançados não elimina automaticamente esses problemas. Na verdade, muitas vezes há uma troca entre criatividade, precisão e justiça. Nenhum modelo único pode garantir confiabilidade impecável.

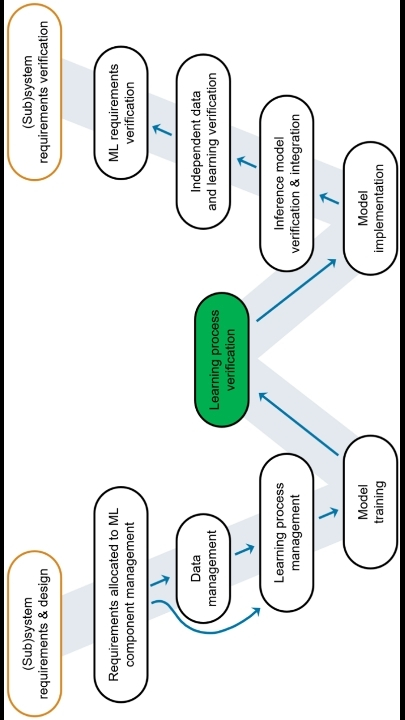

Esta é a lacuna que a Mira Network foi projetada para abordar. Em vez de pedir aos usuários para confiar em um sistema de IA poderoso, a Mira introduz uma camada adicional de verificação baseada no consenso. A ideia é simples, mas poderosa: não confie em uma única voz quando muitas vozes independentes podem avaliar a mesma reivindicação. Inspirada pela lógica dos sistemas de blockchain, onde nós distribuídos concordam sobre transações em vez de confiar em uma autoridade, a Mira aplica um princípio semelhante à saída da IA.

Quando uma IA gera uma resposta, a Mira não a aceita como um único bloco de informação. Ela quebra o conteúdo em reivindicações menores e testáveis. Cada reivindicação é então enviada através de uma rede de modelos verificadores independentes. Esses modelos avaliam a declaração e votam sobre sua precisão. Se uma forte maioria concorda, a reivindicação é verificada. Se o consenso é fraco, o sistema a sinaliza como incerta. O resultado final é registrado de maneira transparente e resistente a adulterações, criando um registro auditável de verificação em vez de aceitação cega.

A descentralização desempenha um papel central neste design. A maioria dos sistemas de IA avançados hoje é desenvolvida e controlada por um pequeno número de grandes organizações. Essa concentração cria potenciais pontos cegos e pontos únicos de falha. A Mira distribui o processo de verificação entre modelos e participantes diversos. Diferentes sistemas treinados em diferentes dados trazem perspectivas variadas, o que aumenta a probabilidade de que erros ou preconceitos sejam detectados. Opiniões divergentes são naturalmente filtradas por meio do acordo da maioria.

Para incentivar a participação honesta, a rede utiliza um mecanismo de staking ligado ao seu token nativo, $MIRA. Participantes que verificam reivindicações devem bloquear tokens como colateral. Quando seus votos estão alinhados com o consenso, eles ganham recompensas. Comportamento desonesto ou descuidado repetido pode resultar em penalidades. Esta estrutura econômica é projetada para tornar a verificação verdadeira mais lucrativa do que a manipulação. À medida que mais participantes entram e bloqueiam tokens, a rede se torna mais forte e mais resistente a ataques.

A privacidade também é cuidadosamente considerada. Como as saídas da IA podem incluir informações sensíveis, o sistema distribui reivindicações fragmentadas entre os nós para que nenhum participante único veja o contexto completo. Certificados de verificação confirmam se as reivindicações passaram pelo consenso sem expor os dados originais. Com o tempo, métodos criptográficos adicionais devem fortalecer ainda mais essa camada de privacidade.

A visão mais ampla vai além da simples verificação de fatos. A Mira visa apoiar indústrias críticas onde a confiabilidade é essencial, desde diagnósticos de saúde até análise legal e avaliação de risco financeiro. Ao combinar múltiplos modelos em um processo de consenso estruturado, algumas implementações supostamente alcançaram níveis de precisão significativamente mais altos do que sistemas de modelo único sozinhos. A ambição de longo prazo é ainda mais ambiciosa: um ecossistema onde os sistemas de IA geram e verificam informações simultaneamente, reduzindo a dependência de supervisão humana cara, mantendo a segurança.

Existem desafios, claro. A verificação exige trabalho computacional adicional e pode introduzir atrasos em comparação com respostas de modelo único. Conteúdo criativo ou altamente subjetivo é mais difícil de reduzir a simples afirmações verdadeiras ou falsas. Construir uma rede verdadeiramente descentralizada também leva tempo e uma forte governança inicial. No entanto, apesar desses obstáculos, a ideia fundamental aborda uma questão estrutural profunda na inteligência artificial.

À medida que a IA se torna cada vez mais incorporada na vida cotidiana e na tomada de decisões de alto risco, a confiança não pode ser baseada apenas na velocidade ou na confiança. Ela deve ser construída sobre a verificação. A Mira Network representa uma tentativa de mover da autoridade centralizada para o acordo distribuído, de confiar em um sistema poderoso para validar informações através da inteligência coletiva. Se este modelo se mostrar eficaz, o futuro da IA pode não ser definido apenas por quão inteligente ela se torna, mas por quão confiavelmente pode provar sua própria verdade.

A IA não vai desaparecer. Ela está se tornando mais poderosa a cada ano.

A questão não é se a IA moldará o futuro.

A questão é se conseguiremos construir barreiras fortes o suficiente para confiar nisso.

A Mira Network representa uma das tentativas mais ousadas de resolver a fraqueza oculta da IA, alucinação e preconceito, não tornando um modelo perfeito, mas tornando muitos modelos responsáveis uns pelos outros.

Se tiver sucesso, o futuro da IA não será apenas rápido e inteligente.

Será verificado.