Salah satu masalah sepi dengan sistem AI modern bukanlah bahwa mereka kekurangan pengetahuan. Melainkan bahwa mereka terkadang berbicara dengan kepastian tentang hal-hal yang hanya sebagian benar.

Sebuah model dapat menulis penjelasan yang detail, mengutip sumber, dan menyusun jawabannya dengan rapi. Namun, satu klaim kecil di dalam respons mungkin salah. Dan kecuali seseorang memeriksa dengan cermat, kesalahan itu hanya akan ikut menyebar bersama dengan sisa teks.

Kelemahan itu menjadi lebih terlihat saat alat AI masuk ke dalam penelitian, pengkodean, dan dukungan keputusan.

Jadi pertanyaan itu muncul secara alami: siapa yang memverifikasi jawaban?

Sebagian besar sistem saat ini bergantung pada solusi terpusat. Sebuah organisasi tunggal membangun model, mengontrol pembaruan, dan memutuskan bagaimana kesalahan ditangani. Bahkan ketika ulasan eksternal ada, lapisan verifikasi masih berada di dalam satu institusi.

Struktur itu berfungsi sampai batas tertentu. Tetapi itu juga mengonsentrasikan kepercayaan.

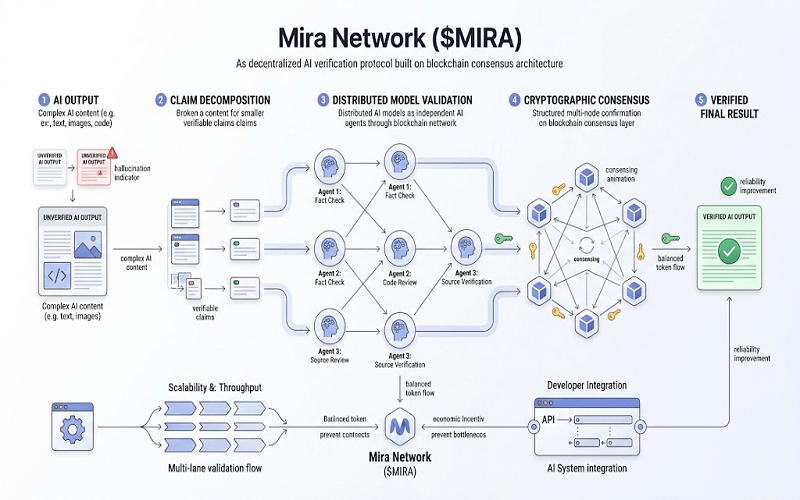

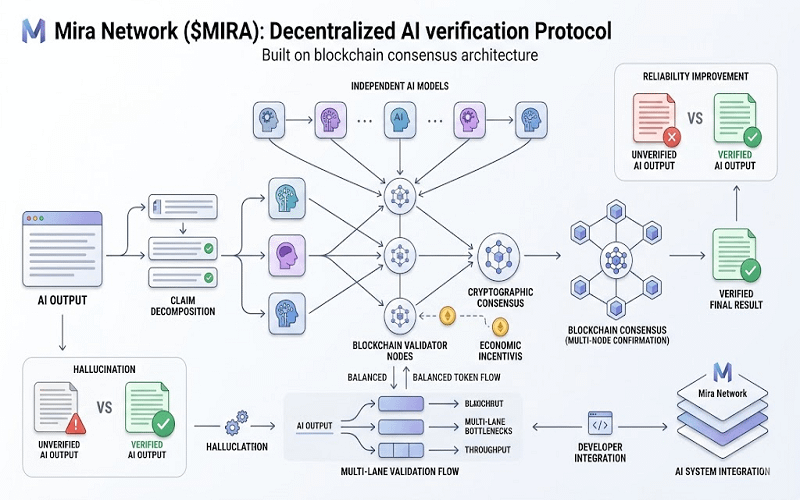

Saat membaca tentang @Mira - Trust Layer of AI , saya menemukan pendekatan mereka menarik karena dimulai dari asumsi yang berbeda. Alih-alih meminta satu AI untuk memeriksa dirinya sendiri, protokol ini memperlakukan verifikasi sebagai proses jaringan.

Idenya cukup sederhana.

Sebuah respons AI dapat dipecah menjadi pernyataan-pernyataan yang lebih kecil. Setiap pernyataan pada dasarnya adalah sebuah klaim. Sesuatu seperti tanggal, statistik, atau penjelasan kausal.

Klaim-klaim tersebut kemudian dapat dievaluasi secara terpisah.

Model AI independen yang berbeda memeriksa bagian-bagian dan mengirimkan penilaian mereka. Beberapa mengonfirmasi klaim tersebut. Lainnya mungkin menandai ketidakpastian atau ketidaksetujuan. Seiring waktu, respons ini membentuk pola.

Inilah saatnya lapisan blockchain masuk.

Alih-alih menjaga proses validasi di dalam server satu perusahaan, hasilnya dicatat melalui konsensus terdesentralisasi. Verifikasi kriptografis membantu memastikan bahwa pemeriksaan dilakukan dan dicatat secara transparan.

Dalam istilah praktis, sistem ini mulai menyerupai lapisan pemeriksaan fakta terdistribusi untuk keluaran AI.

Tidak ada satu pun wasit.

Lebih seperti panel pengulas yang tidak berasal dari institusi yang sama.

Token $MIRA memainkan peran dalam mengoordinasikan proses ini. Peserta yang menjalankan model verifikasi dapat diberi imbalan karena berkontribusi pada pemeriksaan yang akurat. Desain ekonomi berusaha mendorong validasi yang jujur daripada partisipasi pasif.

Ini adalah upaya yang menarik untuk menyelaraskan insentif seputar akurasi daripada kecepatan.

Tentu saja, ide tersebut mengangkat pertanyaan praktis.

Menjalankan beberapa model untuk memverifikasi setiap klaim bisa menjadi mahal secara komputasi. Mengkoordinasikan validator independen juga tidaklah sepele. Dan ruang infrastruktur AI terdesentralisasi semakin ramai, dengan beberapa proyek yang mengeksplorasi ide-ide serupa tentang kepercayaan dan verifikasi.

Ada juga fakta sederhana bahwa ekosistem ini masih muda.

Protokol seperti #Mira dan #MiraNetwork adalah eksperimen sebanyak mereka adalah infrastruktur. Uji sebenarnya adalah apakah sistem ini dapat beroperasi secara efisien ketika permintaan verifikasi meningkat.

Namun, konsep itu sendiri terasa layak untuk dieksplorasi.

Ketika sistem AI menghasilkan lebih banyak informasi yang dibaca dan diandalkan orang, keandalan keluaran tersebut menjadi masalah bersama. Jaringan yang dirancang untuk memeriksa klaim secara kolektif adalah salah satu cara yang mungkin untuk mendekati masalah itu.

Dan terkadang bagian yang paling menarik bukanlah teknologi itu sendiri, tetapi pergeseran pemikiran yang tenang di baliknya.