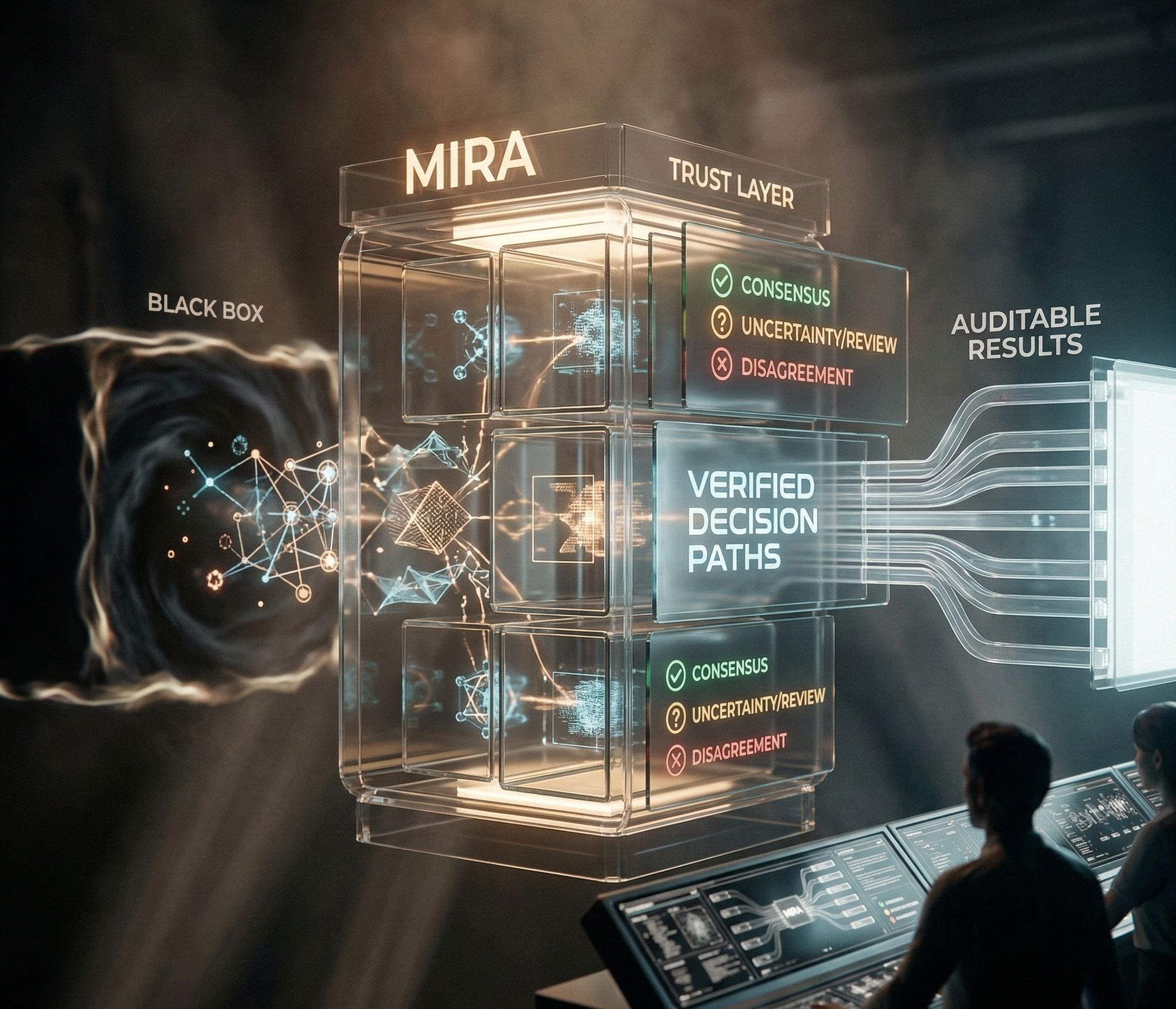

IA kini ada di mana-mana: otomatisasi, analisis data, bantuan dalam pengambilan keputusan. Namun, satu masalah besar tetap ada bagi perusahaan dan pengguna: kotak hitam. Bagaimana bisa mempercayai sebuah hasil jika kita tidak dapat memverifikasi bagaimana hasil itu dihasilkan?

Kinerja tidak lagi cukup. Untuk melangkah ke tahap berikutnya, IA memerlukan transparansi dan auditabilitas. Di sinilah @Mira - Trust Layer of AI berperan, lapisan kepercayaan yang akhirnya membawa verifikasi yang diperlukan untuk sistem IA.

🔍 Tantangan: Mengapa transparansi itu penting?

Model AI saat ini kuat tetapi tidak transparan. Ketika AI memberikan jawaban, alur logika sering kali tetap tidak terlihat. Dalam lingkungan profesional atau yang diatur, ini adalah risiko. Organisasi perlu tahu:

Mengapa kesimpulan spesifik ini?

Apakah sumber yang digunakan dapat diandalkan?

Apa tingkat kepastian sistem ini?

Apakah hasilnya dapat diverifikasi secara independen?

Tanpa visibilitas, tidak mungkin membangun kepercayaan yang berkelanjutan dalam otomatisasi.

✅ Auditabilitas: Melacak yang tidak terlihat

Tidak seperti perangkat lunak tradisional yang berbasis pada aturan tetap (jika A, maka B), AI bergantung pada probabilitas statistik. Ini membuat pelacakan kesalahan sangat kompleks.

Seiring AI terintegrasi ke dalam industri kritis, auditabilitas menjadi suatu keharusan. Mira memenuhi kebutuhan ini dengan mengubah alur kerja AI agar dapat diperiksa, divalidasi, dan direvisi.

⚙️ Bagaimana Mira Network mengubah permainan

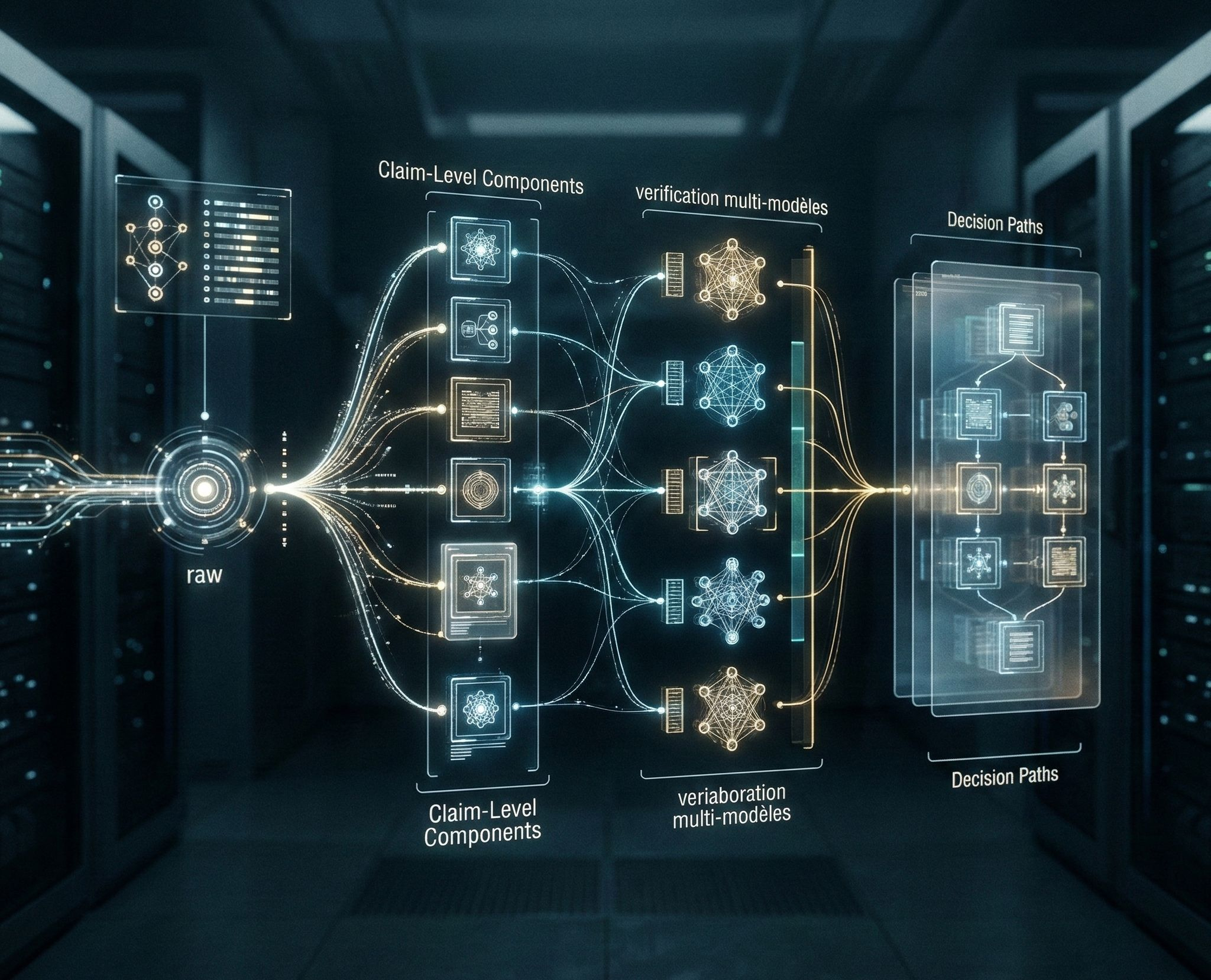

Mira tidak memperlakukan jawaban dari AI sebagai blok teks monolitik. Jaringan ini memecah setiap keluaran menjadi "Komponen Tingkat Klaim" (klaim individu).

Atomisasi: Jawaban dipisahkan menjadi beberapa pernyataan spesifik.

Evaluasi terpisah: Setiap mikro-pernyataan dianalisis secara independen untuk memverifikasi konsistensinya dengan data yang tersedia.

Verifikasi Multi-Model: Alih-alih percaya pada satu model begitu saja, Mira menggunakan validasi silang. Beberapa model menganalisis klaim yang sama:

Konsensus: Tingkat kepercayaan tinggi.

Ketidaksepakatan: Peringatan tentang ketidakpastian atau kebutuhan untuk pemeriksaan manusia.

📊 Pelacakan lengkap (Jalan Keputusan)

Berkat struktur ini, Mira menciptakan sejarah keputusan yang jelas:

Pernyataan apa yang telah diambil?

Bagaimana mereka dievaluasi?

Skor kepercayaan keseluruhan berapa yang telah diberikan?

Ini memungkinkan pengembang untuk membangun aplikasi "cerdas": sistem dapat secara otomatis memvalidasi keluaran dengan kepercayaan tinggi dan mengisolasi hasil yang meragukan untuk pemeriksaan manual.

🚀 Menuju ekosistem IA yang Tanpa Kepercayaan

Masa depan AI tidak lagi hanya bergantung pada kekuatan komputasi, tetapi juga pada keandalan infrastruktur. Mira Network membangun fondasi ekosistem di mana AI tidak lagi menjadi kotak hitam, tetapi alat yang bertanggung jawab, dapat dilacak, dan dapat diaudit.

Dengan membawa lapisan verifikasi ini, Mira memungkinkan AI untuk beralih dari sekadar alat menjadi infrastruktur kritis yang dapat dipercaya.

$MIRA #Mira #Aİ #Web3 #Transparency