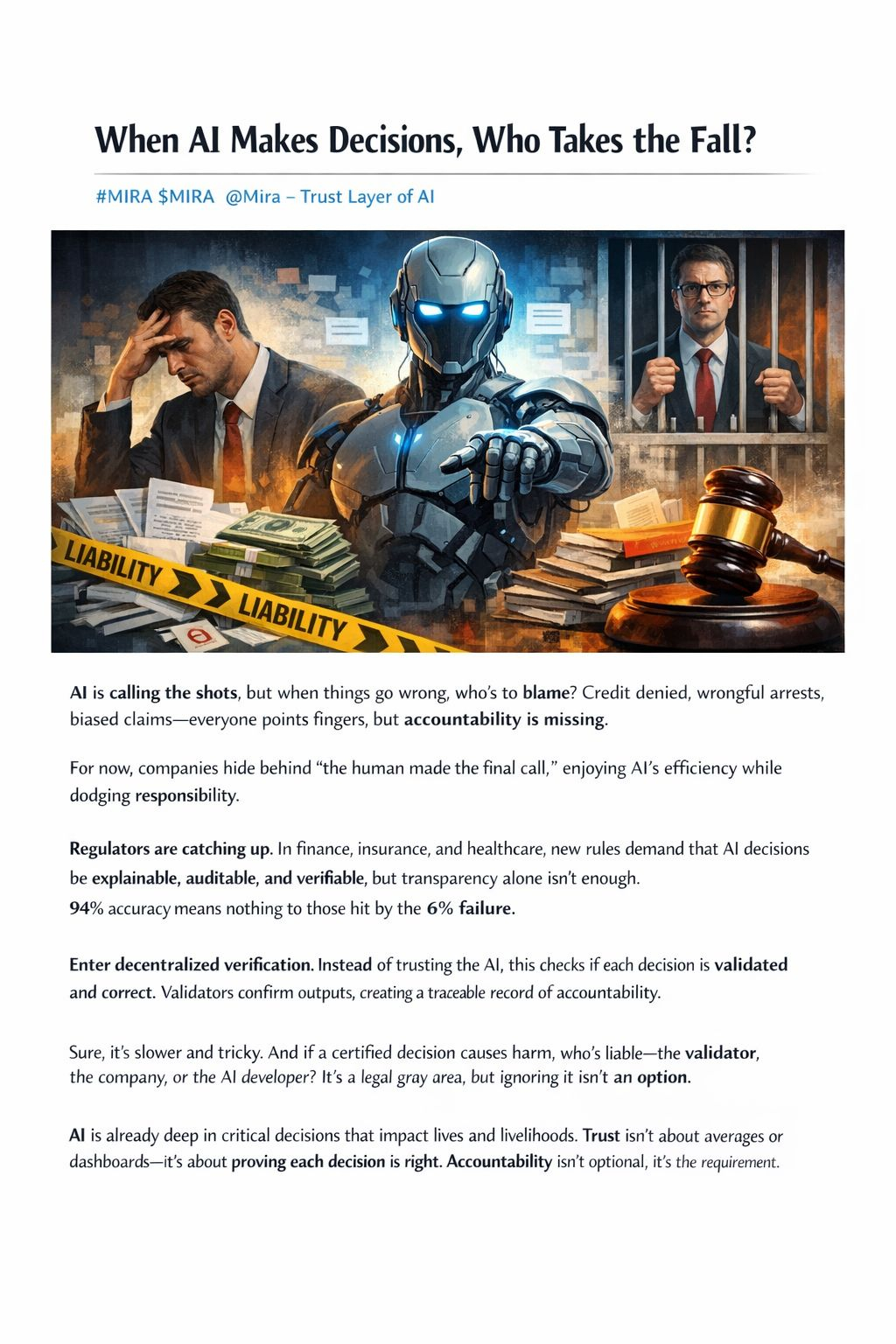

Industri AI telah lama menghindari pertanyaan krusial: ketika sistem AI menyebabkan kerugian di dunia nyata, siapa yang sebenarnya bertanggung jawab? Ini bukan teoritis—ini tentang karier yang diakhiri, penyelidikan yang diluncurkan, atau penyelesaian senilai jutaan dolar. Saat ini, tidak ada jawaban yang jelas, dan ketidakpastian itu adalah hambatan terbesar bagi adopsi AI secara penuh di institusi. Masalahnya bukan biaya, kualitas model, atau kompleksitas integrasi—ini adalah kurangnya akuntabilitas.

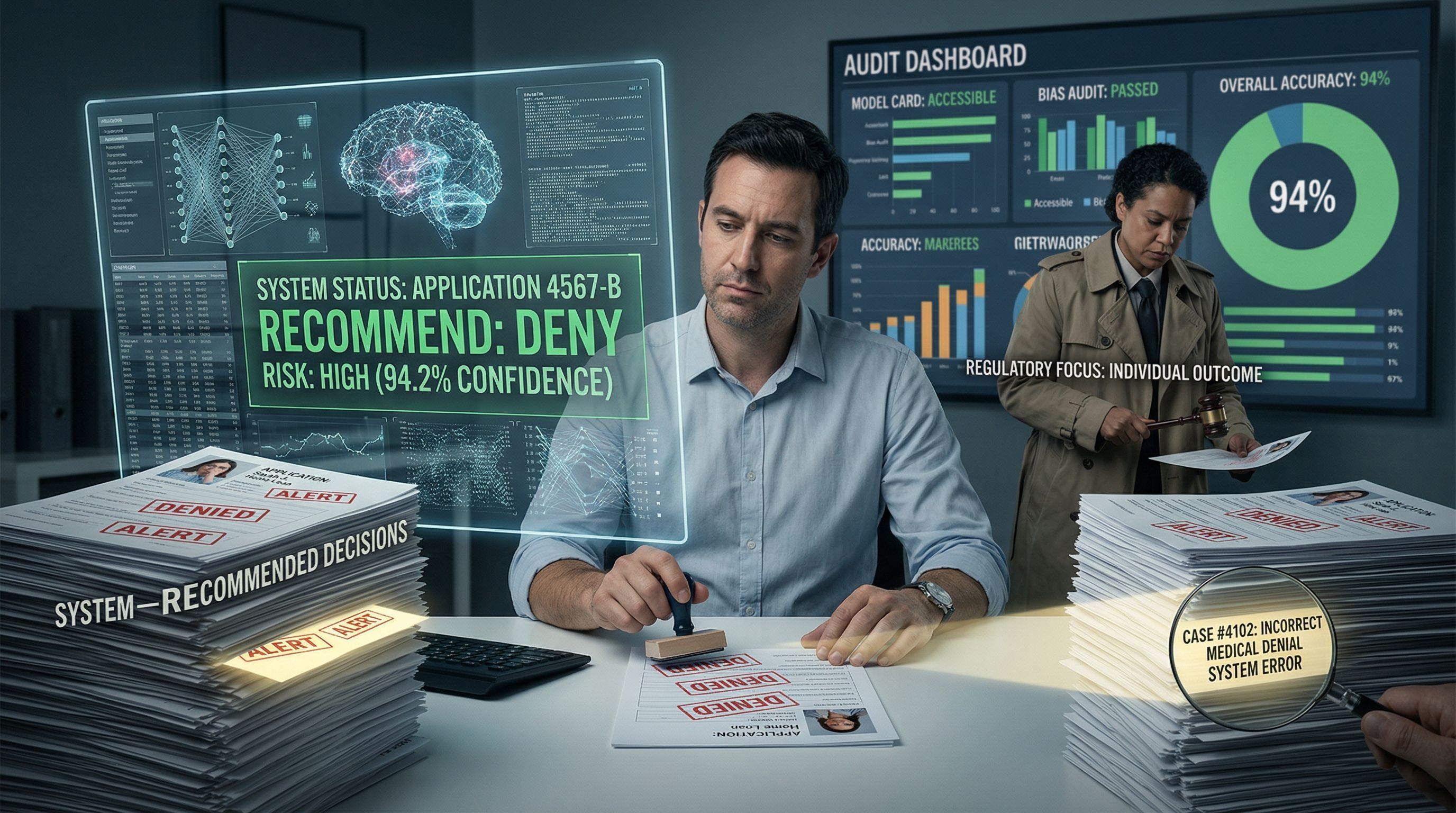

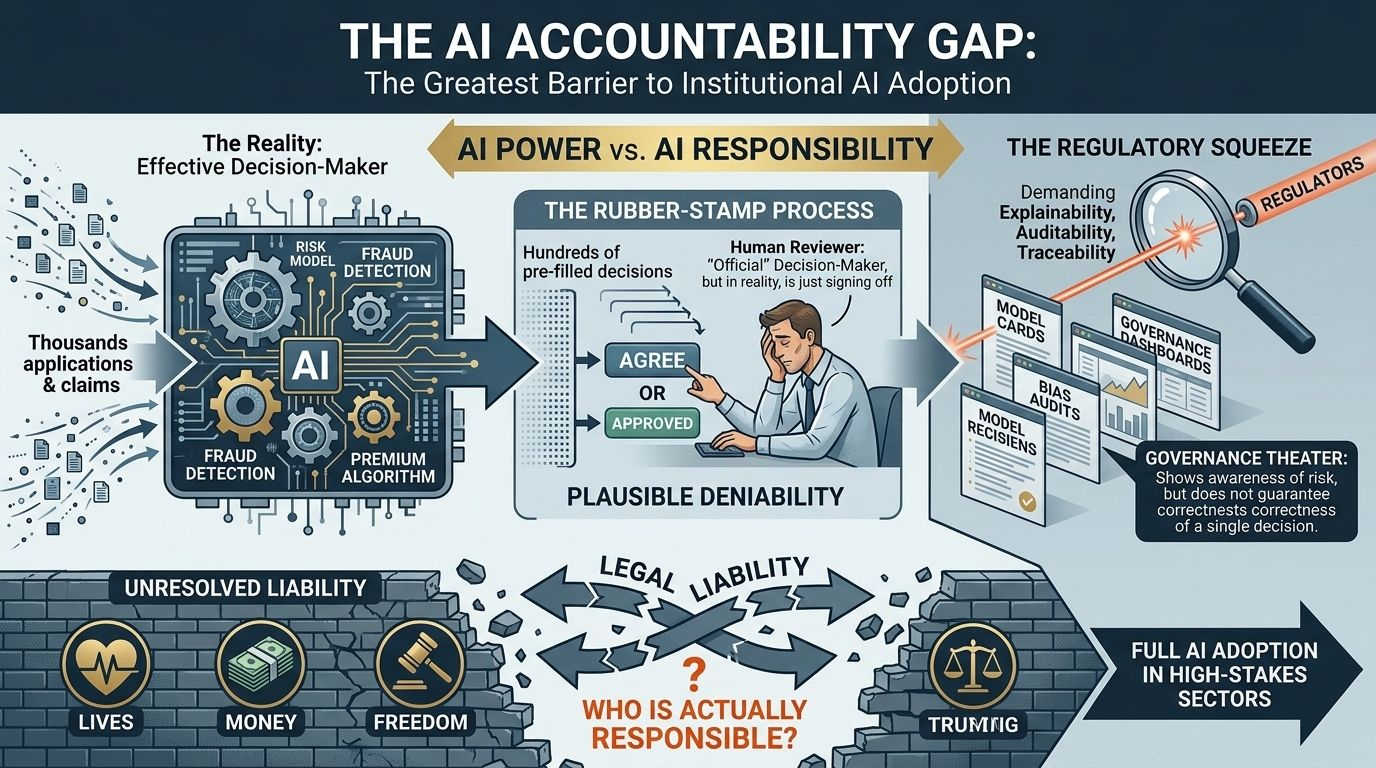

Sebagian besar sistem AI dipresentasikan sebagai penasihat, bukan pembuat keputusan. Model kredit mungkin menandai seseorang sebagai berisiko, algoritma asuransi mungkin menyarankan premi, dan sistem deteksi penipuan mungkin mengeluarkan peringatan. Secara resmi, seorang manusia yang menyetujui, jadi model ini "tidak membuat keputusan." Namun dalam kenyataannya, setelah memproses ribuan aplikasi atau klaim, manusia sering kali hanya menyetujui apa yang telah dipilih oleh AI. AI tidak lagi menyarankan—ia secara efektif memutuskan. Organisasi mendapatkan manfaat efisiensi sambil mempertahankan penyangkalan yang dapat dipercaya ketika terjadi kesalahan.

Regulator mulai mengejar ketertinggalan. Di seluruh sektor keuangan, asuransi, dan sektor berisiko tinggi lainnya, aturan baru mengharuskan sistem AI untuk dapat dijelaskan, diaudit, dan dapat ditelusuri. Industri merespons dengan kartu model, audit bias, dan dasbor yang menunjukkan perilaku AI. Namun, langkah-langkah ini tidak menyelesaikan masalah inti. Mereka menunjukkan kesadaran akan risiko tetapi tidak menjamin bahwa keputusan tertentu benar. Di bidang di mana kehidupan, uang, atau kebebasan dipertaruhkan, kinerja model secara umum tidak berarti.

Akurasi sering kali terlalu ditekankan. Sebuah model mungkin 94% benar rata-rata, tetapi 6% yang tersisa dapat merusak aplikasi hipotek, salah mengklasifikasikan klaim asuransi, atau menolak prosedur medis. Auditor tidak melihat rata-rata; regulator tidak memeriksa kinerja agregat. Pengadilan fokus pada output spesifik yang menyebabkan kerugian. Akuntabilitas dalam AI adalah tentang keputusan individu, bukan tren statistik.

Inilah di mana verifikasi terdesentralisasi mengubah permainan. Alih-alih bertanya apakah model umumnya dapat diandalkan, ia bertanya apakah output tertentu telah diverifikasi. Ini bukan tentang mempercayai AI dalam teori—ini tentang mengonfirmasi bahwa keputusan tepat ini dapat dipertanggungjawabkan. Sama seperti produsen menghasilkan catatan inspeksi untuk setiap produk, keputusan AI dapat memiliki catatan yang dapat diverifikasi.

Sistem seperti ini juga mengubah insentif. Validator yang mengonfirmasi output dihargai atas akurasi dan dihukum atas kelalaian. Setiap keputusan menjadi dapat diaudit dan akuntabel. Institusi dapat menunjukkan bahwa output individu telah diverifikasi—bukan hanya bahwa AI biasanya berfungsi dengan baik. Catatan itu bisa menjadi perbedaan antara kepatuhan dan pelanggaran, kepercayaan dan tanggung jawab.

Verifikasi memiliki biaya. Ini dapat memperlambat proses, menambah kompleksitas, dan meningkatkan tantangan operasional. Di lingkungan yang cepat, bahkan penundaan kecil mungkin tidak dapat diterima. Pertanyaan hukum tetap ada: jika keputusan yang diverifikasi kemudian menyebabkan kerugian, siapa yang bertanggung jawab—validator, organisasi, atau pengembang AI? Sampai aturan formal ada untuk verifikasi AI terdistribusi, institusi akan tetap berhati-hati.

Realitasnya jelas: AI sudah membuat keputusan yang mempengaruhi uang, peluang, dan kebebasan orang. Domain-domain ini beroperasi di bawah kerangka akuntabilitas yang ketat. Jika AI adalah bagian dari mereka, ia tidak dapat melarikan diri dari standar yang sama. Kepercayaan dibangun satu keputusan pada satu waktu, melalui proses yang jelas yang menetapkan tanggung jawab ketika terjadi kesalahan. Akuntabilitas bukanlah opsional—itu penting.

Jika Anda mau, saya juga dapat membuat versi pendek yang ramah media sosial dari artikel ini untuk platform seperti Twitter atau LinkedIn yang menyoroti poin-poin utama dan menyertakan ajakan untuk bertindak untuk $MIRA

$MIRA

$MIRA