Kecerdasan buatan tidak lagi menjadi konsep futuristik, itu adalah bagian dari realitas sehari-hari kita. Ia menulis laporan, menganalisis pasar, membantu dokter, mendukung peneliti, dan bahkan membantu pemerintah menginterpretasikan data. Kecepatannya mengesankan. Skala yang tidak tertandingi. Namun di balik semua kemampuan itu terdapat satu pertanyaan sederhana yang masih belum memiliki jawaban universal: Bisakah kita sepenuhnya mempercayainya?

Sistem AI dirancang untuk memprediksi pola dan menghasilkan respons berdasarkan probabilitas. Mereka sangat pandai terdengar percaya diri. Tantangannya adalah bahwa kepercayaan diri tidak selalu sama dengan kebenaran. Sebuah respons bisa terlihat halus dan meyakinkan sambil diam-diam membawa kesalahan fakta yang halus, cacat penalaran, atau kesalahpahaman kontekstual. Dalam lingkungan risiko rendah, itu mungkin dapat dikelola. Di sektor-sektor berisiko tinggi seperti keuangan, perawatan kesehatan, atau infrastruktur, bahkan kesalahan kecil dapat memicu konsekuensi yang signifikan.

Kesenjangan Tersembunyi dalam Desain AI Modern

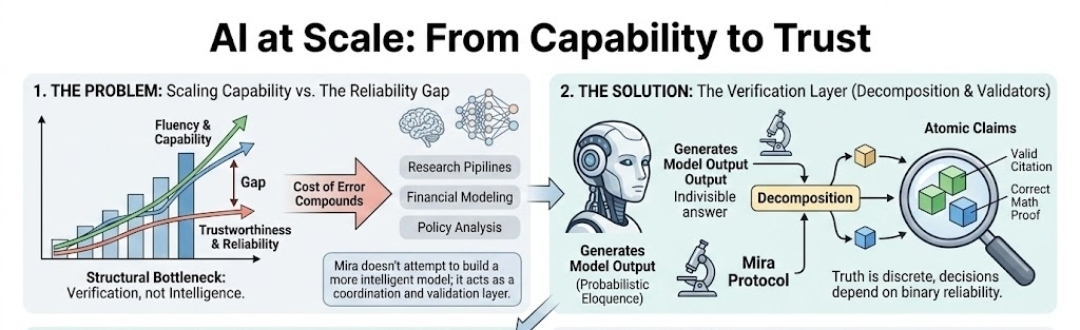

Sebagian besar model AI yang paling canggih dioptimalkan untuk efisiensi: output yang lebih cepat, set data yang lebih besar, pengenalan pola yang lebih baik. Tujuan-tujuan ini masuk akal dari sudut pandang kinerja. Namun, arsitektur seringkali memprioritaskan penciptaan daripada verifikasi. Setelah output dihasilkan, biasanya diterima begitu saja kecuali ditinjau secara manual.

Jarak antara menghasilkan kecerdasan dan memvalidasinya adalah tempat ketidakpastian hidup.

Saat organisasi mengintegrasikan AI lebih dalam ke dalam jalur pengambilan keputusan, pembatasan struktural ini menjadi semakin sulit untuk diabaikan. Automasi meningkatkan produktivitas, tetapi tanpa mekanisme untuk mengkonfirmasi akurasi secara independen, itu juga meningkatkan paparan risiko.

Sebuah Filosofi Berbeda: Verifikasi Sebelum Kepercayaan

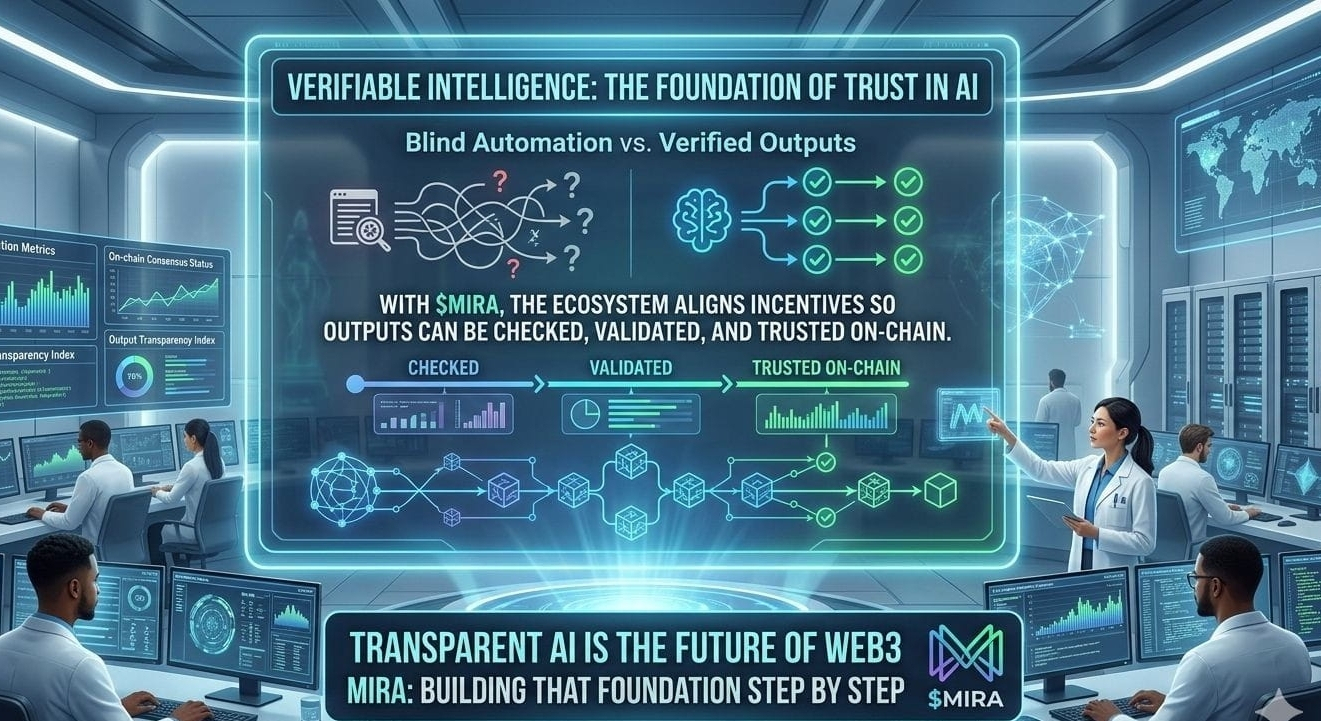

Inilah di mana $MIRA Jaringan memperkenalkan perubahan perspektif.

Alih-alih bersaing untuk membangun model terbesar atau tercepat, Mira fokus pada sesuatu yang sama pentingnya: memvalidasi apa yang dihasilkan sistem AI. Ide ini sederhana namun kuat: memisahkan penciptaan dari konfirmasi.

Dalam arsitektur ini, AI dapat menghasilkan wawasan, tetapi wawasan tersebut tidak segera dianggap sebagai kebenaran final. Mereka melewati lapisan verifikasi terdesentralisasi yang mengevaluasi klaim sebelum mereka diandalkan atau dilaksanakan. Pemisahan ini menciptakan batas yang jelas antara output dan persetujuan.

Mengubah Jawaban Kompleks Menjadi Klaim yang Dapat Diperiksa

Salah satu aspek paling inovatif dari sistem ini adalah bagaimana ia menangani respons AI. Alih-alih meninjau blok besar konten yang dihasilkan sebagai keseluruhan, ia memecah output menjadi pernyataan terstruktur yang dapat diuji.

Setiap pernyataan menjadi klaim yang dapat diperiksa secara individu.

Metode granular ini mengurangi risiko ketidakakuratan yang tersembunyi lolos. Jika satu bagian dari respons cacat, itu tidak membatalkan atau mencemari semuanya. Presisi meningkat karena verifikasi terjadi pada unit informasi terkecil yang bermakna.

Tinjauan Terdesentralisasi, Bukan Otoritas Titik Tunggal

Sistem validasi tradisional sering kali bergantung pada otoritas pusat. Meskipun efisien, sentralisasi dapat memperkenalkan bias, titik buta yang dibagikan, atau titik kegagalan tunggal.

Mira Network mendistribusikan proses verifikasi di antara peserta independen. Validator menilai klaim secara terpisah, menerapkan berbagai alasan dan perspektif. Kesimpulan diterima hanya ketika konsensus tercapai.

Model terdistribusi ini meningkatkan ketahanan. Ini mengurangi ketergantungan pada peninjau tunggal dan meminimalkan titik buta sistemik yang mungkin muncul dalam satu kerangka analitis.

Transparansi Melalui Catatan Tak Terubah

Kepercayaan diperkuat ketika prosesnya transparan. Untuk mencapai ini, hasil verifikasi dicatat di infrastruktur blockchain. Setelah didokumentasikan, hasil tidak dapat diubah secara retroaktif.

Ini menciptakan jejak audit permanen, fitur penting untuk perusahaan yang beroperasi di industri yang diatur. Apakah untuk kepatuhan, akuntabilitas internal, atau tinjauan eksternal, organisasi dapat menunjukkan bahwa kesimpulan yang didorong oleh AI telah divalidasi secara independen sebelum diterapkan.

Insentif yang Menghadiahi Akurasi

Sebuah sistem hanya sekuat insentif yang mendasarinya.

Mira mengintegrasikan mekanisme ekonomi yang memberi imbalan kepada validator untuk penilaian yang tepat dan bertanggung jawab. Peserta yang secara konsisten memberikan evaluasi akurat membangun reputasi dan mendapatkan imbalan, menyelaraskan motivasi finansial dengan integritas sistem.

Alih-alih menganggap akurasi sebagai default, jaringan membuatnya terukur dan terinsentif.

Mempersiapkan Sistem AI Otonom

Kecerdasan buatan secara bertahap bergerak menuju otonomi yang lebih besar. Dari perdagangan algoritmik dan logistik otomatis hingga dukungan keputusan klinis dan penemuan ilmiah, sistem AI mulai bertindak dengan intervensi manusia minimal.

Seiring dengan meningkatnya otonomi, margin untuk kesalahan yang tidak terdeteksi menyusut.

Verifikasi tidak lagi bisa bersifat opsional; itu harus menjadi infrastruktur dasar. Mira memposisikan dirinya sebagai jembatan keandalan antara mesin AI yang kuat dan akuntabilitas dunia nyata. Ini memastikan bahwa saat mesin menjadi lebih mampu, output mereka tetap terikat pada kebenaran yang dapat diverifikasi.

Dari Kemungkinan ke Bukti

Masa depan AI tidak akan ditentukan hanya oleh seberapa cerdas sistemnya. Itu akan ditentukan oleh seberapa dapat dipercaya mereka.

Dengan memperkenalkan validasi terdesentralisasi, proses tinjauan terstruktur, dan mekanisme konsensus yang transparan, $MIRA Jaringan bertujuan untuk membawa kecerdasan buatan melampaui respons yang didorong oleh probabilitas menuju sesuatu yang lebih kuat: kepastian digital yang terverifikasi.

Dalam era di mana data mendorong keputusan dan algoritma mempengaruhi hasil, kepercayaan bukanlah sebuah kemewahan. Itu adalah infrastruktur.