Viết bởi Nhóm Khoa học Qubic

Một bình luận về bài báo mới nhất của Nick Bostrom bởi Nhóm Khoa học Qubic

Tái định hình Cuộc tranh luận về Siêu trí tuệ: Phẫu thuật, không phải Xọc ngẫu nhiên

Ông vừa công bố một bài báo làm việc mới, Thời điểm Tối ưu cho Siêu trí tuệ: Những xem xét thường nhật cho những người hiện có (2026), trong đó ông chuyển đổi câu hỏi trung tâm. Thay vì hỏi liệu chúng ta có nên phát triển siêu trí tuệ hay không, Bostrom tập trung vào thời điểm nào là tối ưu để làm như vậy. Đối với bất kỳ ai theo dõi sự giao thoa đang phát triển nhanh chóng của AI và blockchain, khung của ông mang lại những hệ quả sâu sắc cho cách chúng ta thiết kế cơ sở hạ tầng sẽ hỗ trợ trí tuệ nhân tạo tổng quát (AGI).

Tái định hình cuộc tranh luận về siêu trí tuệ: Phẫu thuật, không phải Roulette

Điểm khởi đầu của bài báo của Bostrom vừa thanh lịch vừa phá cách. Ông tái định hình cuộc tranh luận phân cực "AI có vs. AI không" hoàn toàn. Phát triển siêu trí tuệ, ông lập luận, không giống như chơi roulette Nga. Nó giống như trải qua một ca phẫu thuật rủi ro cho một tình trạng đã chết.

Điều kiện đó là gì? Tình trạng hiện tại của nhân loại. Xem xét cơ sở: khoảng 170.000 cái chết xảy ra mỗi ngày do lão hóa, bệnh tật và sự thất bại hệ thống. Một dân số toàn cầu già hóa phải đối mặt với sự suy thoái sinh học không thể đảo ngược. Các bệnh không thể chữa khỏi, bao gồm ung thư, thoái hóa thần kinh và các bệnh tim mạch, tiếp tục làm gánh nặng cho hàng triệu người. Chúng ta đối mặt với các rủi ro toàn cầu không được giảm thiểu, từ sự bất ổn khí hậu, đến tham nhũng thể chế hệ thống, đến sự suy giảm chất lượng dân chủ. Đại dịch, chiến tranh và sự sụp đổ của toàn bộ hệ thống vẫn là những mối đe dọa luôn hiện hữu.

Dựa trên những thực tế này, Bostrom lập luận rằng việc định khung lựa chọn là "không có rủi ro mà không có AI" so với "rủi ro cực kỳ với một siêu trí tuệ" là đơn giản hóa. Câu hỏi nghiêm túc hơn là: Đường đi nào tạo ra tuổi thọ dự kiến lớn hơn và chất lượng cuộc sống lớn hơn cho những người đã tồn tại?

Bằng cách neo phân tích của mình vào những điều kiện thực tế, hiện tại của cuộc sống con người, Bostrom tránh được các trừu tượng triết học và suy đoán thần học. Ông đang nói về bạn, gia đình bạn và những người sống ngay bây giờ.

Tuổi thọ, rủi ro tử vong, và lý do cho trí tuệ nhân tạo tổng quát

Khi chúng ta còn trẻ, rủi ro hàng năm của việc chết là cực kỳ thấp. Về mặt sinh học, chúng ta vẫn còn xa cái chết trong hầu hết các trường hợp. Nhưng khi chúng ta già đi, xác suất tử vong tăng liên tục do sự suy thoái sinh học.

Nếu siêu trí tuệ có thể giảm thiểu hoặc thậm chí loại bỏ lão hóa, như Bostrom đề xuất, thì rủi ro tử vong hàng năm của bạn sẽ giữ ở mức của một người trẻ khỏe mạnh. Tỷ lệ tử vong của bạn sẽ không tăng theo thời gian. Trong kịch bản đó, tuổi thọ trở nên cực kỳ dài.

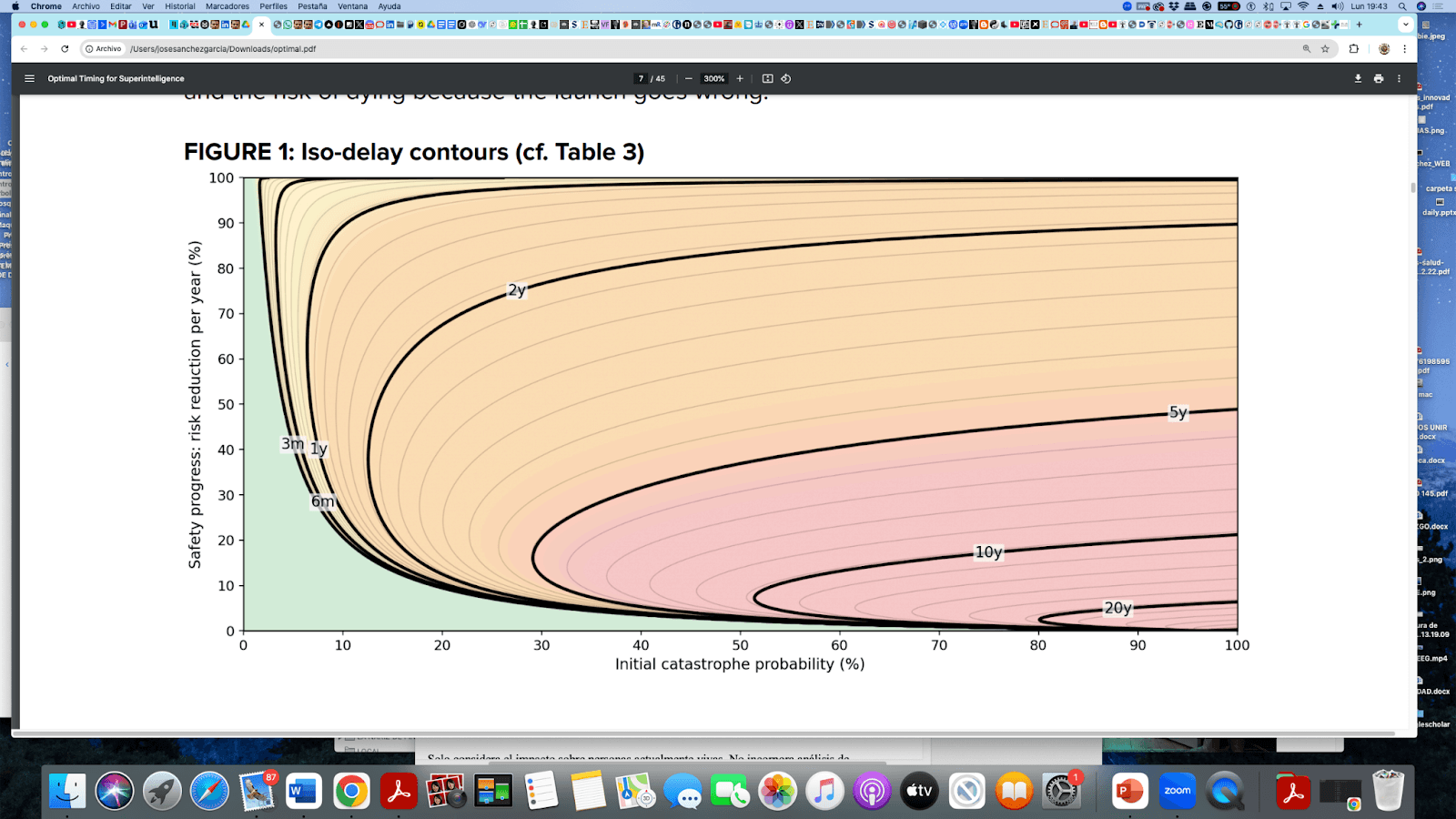

Từ góc nhìn này, giá trị kỳ vọng của siêu trí tuệ bù đắp cho các rủi ro cao của nó. Nhưng điều gì sẽ xảy ra nếu chúng ta trì hoãn cho đến khi công nghệ trở nên hoàn toàn "an toàn"? Điều gì sẽ xảy ra nếu chúng ta tích lũy xác suất tử vong với mỗi năm trôi qua? Câu hỏi trở thành: có hợp lý hơn không khi chấp nhận xác suất thảm họa từ việc triển khai sớm, với điều kiện rằng tiến bộ an toàn AI là hàm mũ, hay là chấp nhận sự chắc chắn về cái chết tích lũy từ việc trì hoãn?

Chiết khấu tạm thời và chi phí của việc chờ đợi

Bostrom giới thiệu khái niệm chiết khấu tạm thời (ρ), một nguyên tắc đã được nghiên cứu nhiều trong lý thuyết quyết định. Con người có xu hướng đánh giá các kết quả hiện tại cao hơn so với các kết quả tương lai. Đó là lý do tại sao chúng ta vẫn ở trong những công việc, mối quan hệ và mô hình không hài lòng: nỗ lực thay đổi cảm thấy lớn, và phần thưởng cảm thấy xa vời.

Nhưng ở đây một sự đảo ngược thú vị xảy ra. Nếu cuộc sống sau AGI không chỉ dài hơn mà còn tốt hơn một cách đáng kể, với những cải tiến triệt để về sức khỏe, khả năng nhận thức và chất lượng cuộc sống, thì việc chiết khấu tạm thời thực sự trừng phạt việc chờ đợi. Mỗi năm trì hoãn là một năm sống trong tình trạng chất lượng tồi tệ hơn khi một trạng thái vượt trội hơn có thể tiếp cận.

Chất lượng cuộc sống và sự tránh né rủi ro trong triển khai AGI

Mô hình của Bostrom không chỉ giả định sự lâu dài. Nó bao gồm các cải tiến đáng kể trong phúc lợi. Nếu chất lượng cuộc sống gấp đôi sau khi chuyển đổi sang siêu trí tuệ, thì sự cân bằng chuyển đổi quyết định sang việc triển khai sớm hơn. Ông sau đó bổ sung thêm các chỉ số tránh né rủi ro (CRRA và CARA), thừa nhận rằng nếu chúng ta nhạy cảm hơn với các mất mát cực đoan, thì khoảng thời gian mà "khởi động ngay" vẫn là lời khuyên sẽ hẹp lại và thời gian trì hoãn tối ưu sẽ kéo dài.

Đây không phải là chủ nghĩa tăng tốc liều lĩnh. Đây là quyết định có điều chỉnh dưới sự không chắc chắn, loại phân tích nên thông báo cách chúng ta quản lý con đường đến trí tuệ nhân tạo tổng quát.

Triển khai Hai Giai đoạn: Nhanh đến Cảng, Chậm đến Bến

Một trong những đóng góp mạnh mẽ nhất của bài báo là sự phân chia quá trình chuyển đổi AGI thành hai giai đoạn khác nhau:

Giai đoạn 1: Đạt được khả năng AGI. Di chuyển nhanh nhất có thể một cách có trách nhiệm hướng tới việc xây dựng một hệ thống thể hiện trí thông minh tổng quát.

Giai đoạn 2: Một sự tạm dừng chiến lược trước khi triển khai toàn bộ. Khi hệ thống tồn tại, giới thiệu một sự trì hoãn có kiểm soát để nghiên cứu nó, thử nghiệm nó trong các điều kiện thực tế, và giải quyết các vấn đề an toàn kỹ thuật mà trước đây chỉ là lý thuyết.

Giả thuyết của Bostrom là một khi một hệ thống AGI thực sự tồn tại, một "cơn gió an toàn" xảy ra. Các nhà nghiên cứu có thể quan sát hành vi thực tế thay vì suy đoán về nó. Tiến bộ an toàn gia tăng đáng kể vì các vấn đề trở nên kinh nghiệm thay vì trừu tượng. Khẩu hiệu mà ông đặt ra: nhanh đến cảng, chậm đến bến.

Ai là người hưởng lợi nhiều nhất từ việc chuyển đổi sớm sang siêu trí tuệ?

Bostrom không coi thời điểm tối ưu là phổ quát. Những người lớn tuổi, những người bệnh nặng và những người sống trong điều kiện precarius có ít năm mong đợi còn lại hơn. Đối với họ, lợi ích tiềm năng của việc chuyển đổi nhanh chóng sang siêu trí tuệ là lớn hơn rất nhiều. Những người trẻ tuổi với nhiều thập kỷ phía trước có thể chịu đựng việc chờ đợi lâu hơn.

Nếu bạn áp dụng một logic ưu tiên, ưu tiên trọng số lớn hơn cho những người kém hơn, thì thời gian tối ưu sẽ tiến lên phía trước. Bostrom cũng rõ ràng từ chối giả định phổ biến rằng ngoài một độ tuổi nhất định, cuộc sống bổ sung không mang lại giá trị. Đánh giá đó, ông lập luận, có nguồn gốc từ trải nghiệm của chúng ta về lão hóa và suy thoái hiện tại. Nó không tính đến một kịch bản phục hồi thực sự, một trong những lời hứa trung tâm của một tương lai siêu trí tuệ.

Rủi ro thể chế: Tại sao cơ sở hạ tầng quản trị AI quan trọng

Trong các phần cuối của bài báo của mình, Bostrom giới thiệu các cảnh báo thể chế quan trọng. Kịch bản hợp lý nhất, ông gợi ý, là một kịch bản trong đó nhà lãnh đạo công nghệ sử dụng lợi thế của mình vì sự an toàn. Nhưng ông cũng chỉ ra những nguy hiểm của các lệnh cấm quốc gia, các cấm vận quốc tế, và các động lực cạnh tranh phát sinh khi nhiều tác nhân đua nhau tiến tới AGI dưới áp lực địa chính trị.

Phân tích của ông ngầm giả định một hệ sinh thái nơi sức mạnh tính toán có xu hướng tập trung. Trong một môi trường như vậy, các rủi ro tăng lên: quân sự hóa tài nguyên tính toán, tính toán dư thừa (dự trữ khổng lồ sẵn sàng được kích hoạt dưới áp lực cạnh tranh), và các động lực lệch lạc của sự tập trung cực đoan. Đây không phải là những mối quan tâm trừu tượng. Đường đi hiện tại của phát triển AI, được thống trị bởi một vài nhà cung cấp đám mây quy mô lớn và các phòng thí nghiệm doanh nghiệp, tạo ra chính sự tập trung này.

Những tác động đối với Qubic: Tại sao cơ sở hạ tầng AI phi tập trung giảm thiểu rủi ro tồn tại

Nếu chúng ta xem xét khung làm việc của Bostrom một cách nghiêm túc, câu hỏi cơ bản chuyển từ "khi nào khởi động AGI" sang loại cơ sở hạ tầng nào giảm thiểu các rủi ro liên quan đến việc khởi động đó. Đây là nơi kiến trúc của Qubic trở nên có liên quan trực tiếp đến cuộc trò chuyện toàn cầu về an toàn siêu trí tuệ.

Vấn đề tập trung trong phát triển AI hiện tại

Nếu siêu trí tuệ được xây dựng trên cơ sở hạ tầng tập trung, phụ thuộc vào các trung tâm dữ liệu khổng lồ, các quy trình đào tạo không minh bạch, và sự kiểm soát của doanh nghiệp, thì hồ sơ rủi ro mở rộng ra ngoài khía cạnh kỹ thuật đơn thuần. Nó trở thành địa chính trị. Sự tập trung của tính toán làm cho loại quản trị thích ứng mà Bostrom coi là thiết yếu trong giai đoạn trước triển khai trở nên khó khăn hơn rất nhiều. Nó cũng tạo ra đúng loại tính toán dư thừa mà ông cảnh báo: dự trữ tính toán khổng lồ sẵn sàng được kích hoạt ngay lập tức dưới áp lực cạnh tranh.

Cách mà kiến trúc tính toán phân tán của Qubic giải quyết những rủi ro này

Qubic làm giảm nút thắt cấu trúc đó. Kiến trúc của nó phân phối sức mạnh tính toán trên một mạng lưới toàn cầu thay vì tập trung nó trong một nút duy nhất. Qubic không phụ thuộc vào kiến trúc loại LLM được đào tạo không minh bạch trong các trung tâm dữ liệu khổng lồ. Thay vào đó, nó tận dụng Chứng minh công việc hữu ích (uPoW), nơi các thợ đào đóng góp tính toán thực cho việc đào tạo lõi AI của nó, Aigarth, thay vì giải các câu đố băm tùy ý.

Lựa chọn thiết kế này có những tác động trực tiếp đến phân tích của Bostrom. Một cơ sở hạ tầng ít tập trung hơn làm giảm xác suất của các kịch bản triển khai đột ngột, cạnh tranh mà ông cảnh báo. Tính toán phân tán có nghĩa là sức mạnh không nằm ở một cơ sở duy nhất có thể bị chiếm đóng quân sự, cũng không ở một phòng thí nghiệm doanh nghiệp dưới sự kiểm soát đơn phương. Đó là sức bền cấu trúc mở rộng không gian cho Giai đoạn 2 của Bostrom: sự tạm dừng chiến lược nơi thử nghiệm thực tế, cải tiến từng bước và quản trị thích ứng có thể xảy ra trước khi triển khai toàn bộ.

Để hiểu sâu hơn về cách tiếp cận của Qubic với AI khác với các mô hình chính thống, hãy khám phá Neuraxon: Bước nhảy vọt lớn của Qubic hướng tới AI sống và học tập, và phân tích gần đây rằng AI tĩnh là một ngõ cụt. Google xác nhận.. Những bài viết này minh họa cách Qubic xây dựng trí tuệ thông qua một mô hình hoàn toàn khác: một mô hình được thiết kế cho việc học liên tục, khả năng phục hồi phân tán, và sự thích ứng với thế giới thực trên một mạng lưới phi tập trung.

AI phi tập trung và Blockchain: Sự phù hợp cấu trúc với an toàn AGI

Từ góc nhìn của Bostrom, tiềm năng của Qubic không chỉ nằm ở việc "phi tập trung" như một hoạt động thương hiệu. Nó nằm ở việc sửa đổi các biến cấu trúc quyết định thời điểm tối ưu cho việc triển khai siêu trí tuệ. Bằng cách phân phối tính toán, xây dựng các giao thức đồng thuận khớp các động lực của thợ đào với việc đào tạo AI thực sự, và làm cho toàn bộ quá trình trở thành mã nguồn mở và có thể kiểm tra, Qubic tạo ra loại cơ sở hạ tầng mà làm cho việc chuyển đổi sang AGI an toàn hơn về cấu trúc.

Nếu bạn quan tâm đến cách mô hình khai thác CPU của Qubic và mạng tính toán phân tán đang phát triển, bài sâu về Khai thác Dogecoin trên Qubic giải thích sự mở rộng mới nhất của Chứng minh công việc hữu ích, và Tầm nhìn 2026 của Qubic chi tiết lộ lộ trình cơ sở hạ tầng rộng lớn hơn hiện đang được thực hiện.

Vấn đề khó khăn nhất: Xây dựng AGI có khả năng học hỏi từ thế giới

Tưởng tượng ra các kịch bản utopian và dystopian là giá trị. Thực tế, đó là con đường tốt nhất để tạo ra các tương lai phù hợp với nhu cầu và giá trị của con người. Nhưng nhìn đi chỗ khác, chờ đợi một cách vô nghĩa, hoặc tăng tốc mà không có sự kiểm soát đều không cung cấp những suy ngẫm cần thiết.

Có lẽ thách thức khó khăn nhất ngay bây giờ không phải là cân nhắc rủi ro của việc tăng tốc chuyển đổi và mô hình hóa nó. Hiện tại, nhiệm vụ khó khăn nhất là xây dựng một trí tuệ nhân tạo tổng quát có khả năng tự học từ các môi trường động khác nhau, tạo ra các đại diện của thế giới và hành động trong đó. Đó chính xác là thách thức mà khung Neuraxon của Qubic được thiết kế để giải quyết, không phải bằng cách đào tạo trên các tập dữ liệu tĩnh phía sau cánh cửa đóng kín, mà bằng cách tiến hóa trong công khai, học hỏi từ sự phức tạp của thế giới thực trên một mạng lưới phi tập trung mà bất cứ ai cũng có thể tham gia.

Tài liệu tham khảo và nguồn gốc

1. Bostrom, N. (2026). Thời điểm tối ưu cho siêu trí tuệ: Các cân nhắc thông thường cho những người đang sống. Bài báo làm việc, v1.0.

https://nickbostrom.com/optimal.pdf

2. Bostrom, N. (2014). Siêu trí tuệ: Các con đường, mối nguy, chiến lược. Nhà xuất bản Đại học Oxford.

3. Bostrom, N. (2003). Lãng phí thiên văn: Chi phí cơ hội của sự phát triển công nghệ bị trì hoãn. Utilitas, 15(3), 308–314.

4. Yudkowsky, E. & Soares, N. (2025). Nếu ai đó xây dựng nó, mọi người đều chết.

5. Hall, R. E. & Jones, C. I. (2007). Giá trị của cuộc sống và sự gia tăng chi tiêu cho sức khỏe. Tạp chí Kinh tế Hàng quý, 122(1), 39–72.

6. Nhóm Khoa học Qubic. Neuraxon: Bước nhảy vọt lớn của Qubic hướng tới AI sống và học tập.

https://qubic.org/blog-detail/neuraxon-qubic-s-big-leap-toward-living-learning-ai

7. Thảo luận cộng đồng LessWrong: Thời điểm tối ưu cho siêu trí tuệ

https://www.lesswrong.com/posts/2trvf5byng7caPsyx/optimal-timing-for-superintelligence-mundane-considerations