Данные говорят! «Космическая вычислительная мощность» Маска — это не пустая реклама: 20-кратная производительность + 90% снижение затрат, через 3 года революция в правилах вычислительной мощности AI

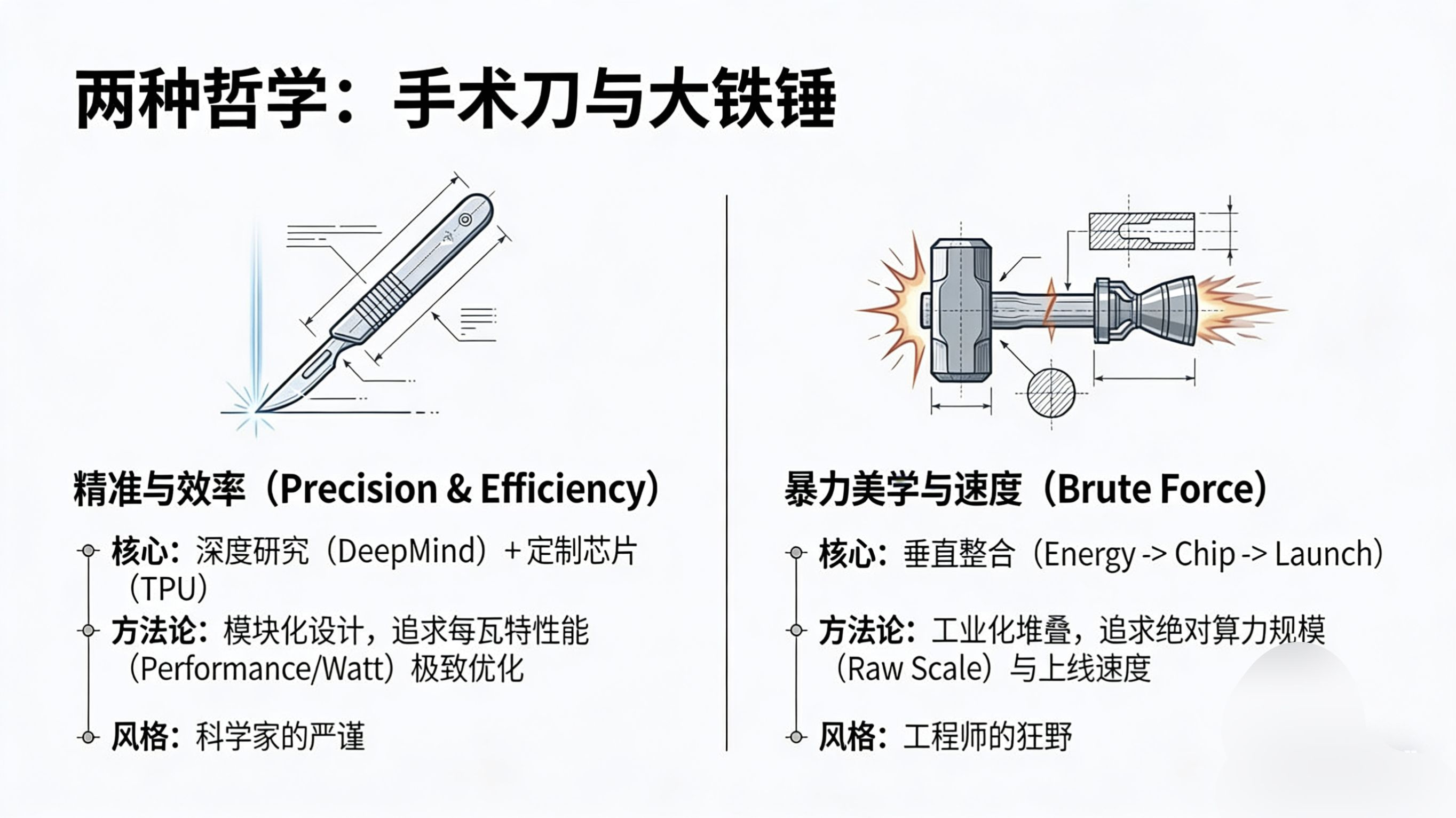

После анализа основных данных на этих изображениях, стало ясно, что «космическая вычислительная мощность» SpaceX и xAI — это не фантазия, а логическая замкнутая цепь, поддерживаемая жесткими данными, каждый шаг точно попадает в болевые точки вычислительной мощности Земли!

Сначала рассмотрим 3 главные уязвимости вычислительной мощности Земли (данные бьют в цель):

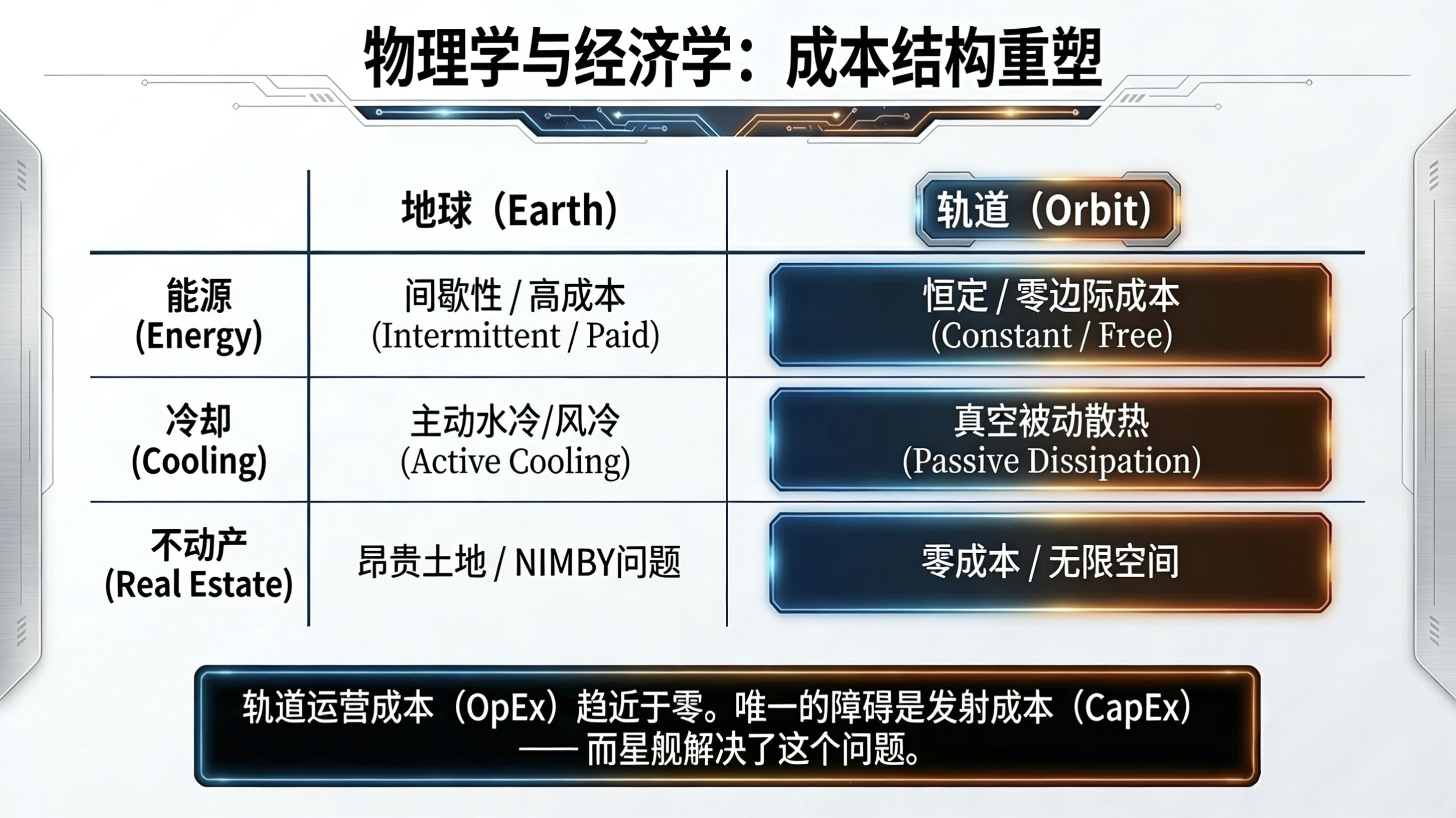

1. Энергетические узкие места: 70% потребления энергии наземными дата-центрами уходит на охлаждение, для обучения одного AGI требуется в 1000 раз больше текущей вычислительной мощности, дефицит в глобальной электросети достигает 300 ГВт;

2. Высокие затраты: охлаждение одного AI-сервера обходится более 50 тысяч долларов в год, аренда помещения превышает 2000 долларов за квадратный метр в год;

3. Ограничения развертывания: всего в мире 590 суперкомпьютерных центров, вычислительная мощность сосредоточена в немногих регионах, срок расширения составляет от 18 до 24 месяцев.

Посмотрим на космическое решение Маска, данные еще более жесткие:

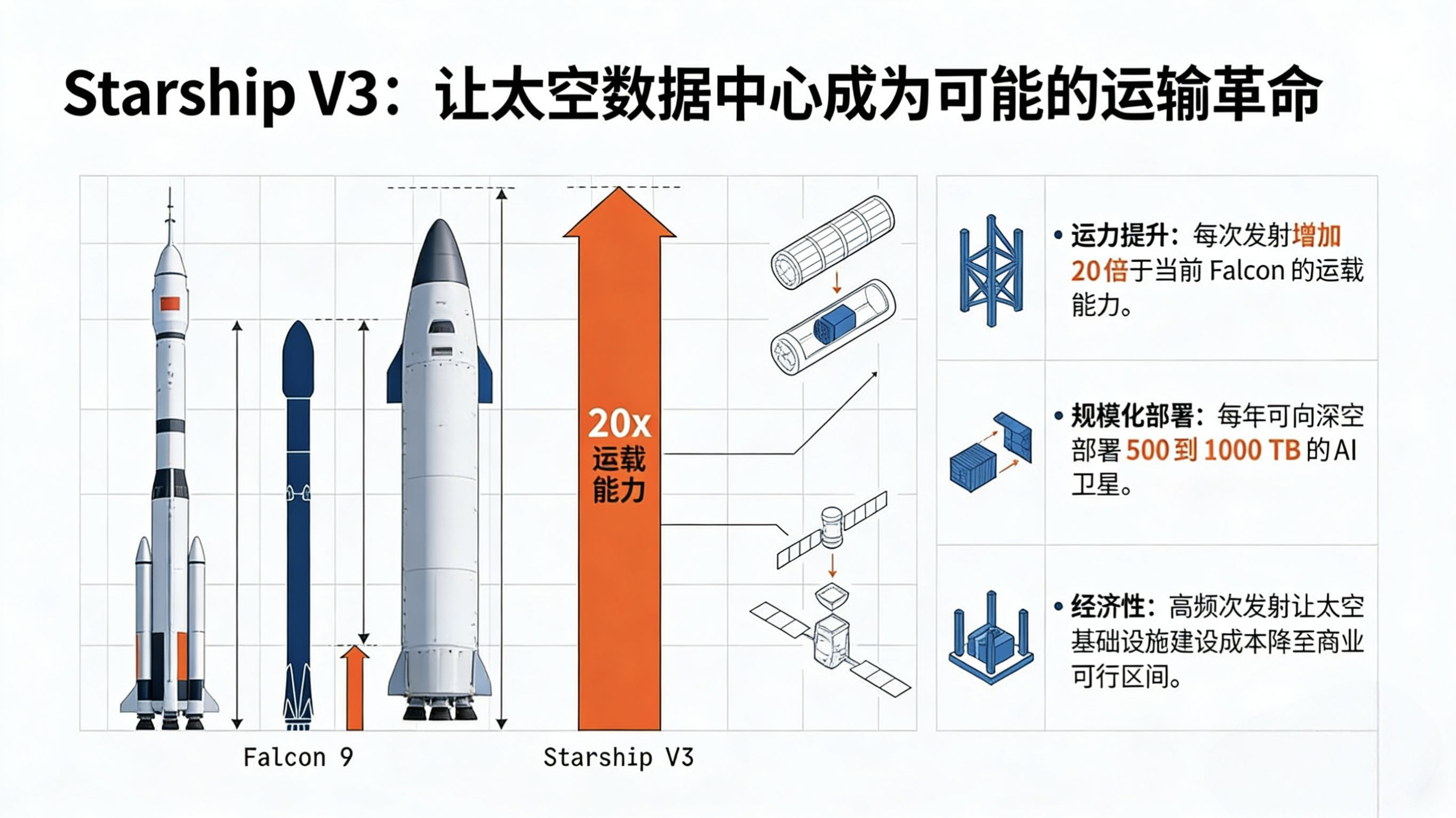

- Революция в грузоперевозках: грузоподъемность Starship V3 достигает 250 тонн, что в 20 раз больше, чем у Falcon 9, за один раз можно разместить 10 AI-спутниковых узлов (каждый узел соответствует одному среднему или малому суперкомпьютерному центру);

- Снижение затрат: энергетические расходы центра данных на орбите приближаются к 0 (24 часа солнечной энергии), затраты на теплоотведение сокращены на 90% (вакуумное пассивное охлаждение), стоимость запуска с Falcon 9 снижена с $2700/кг до менее чем $100/кг;

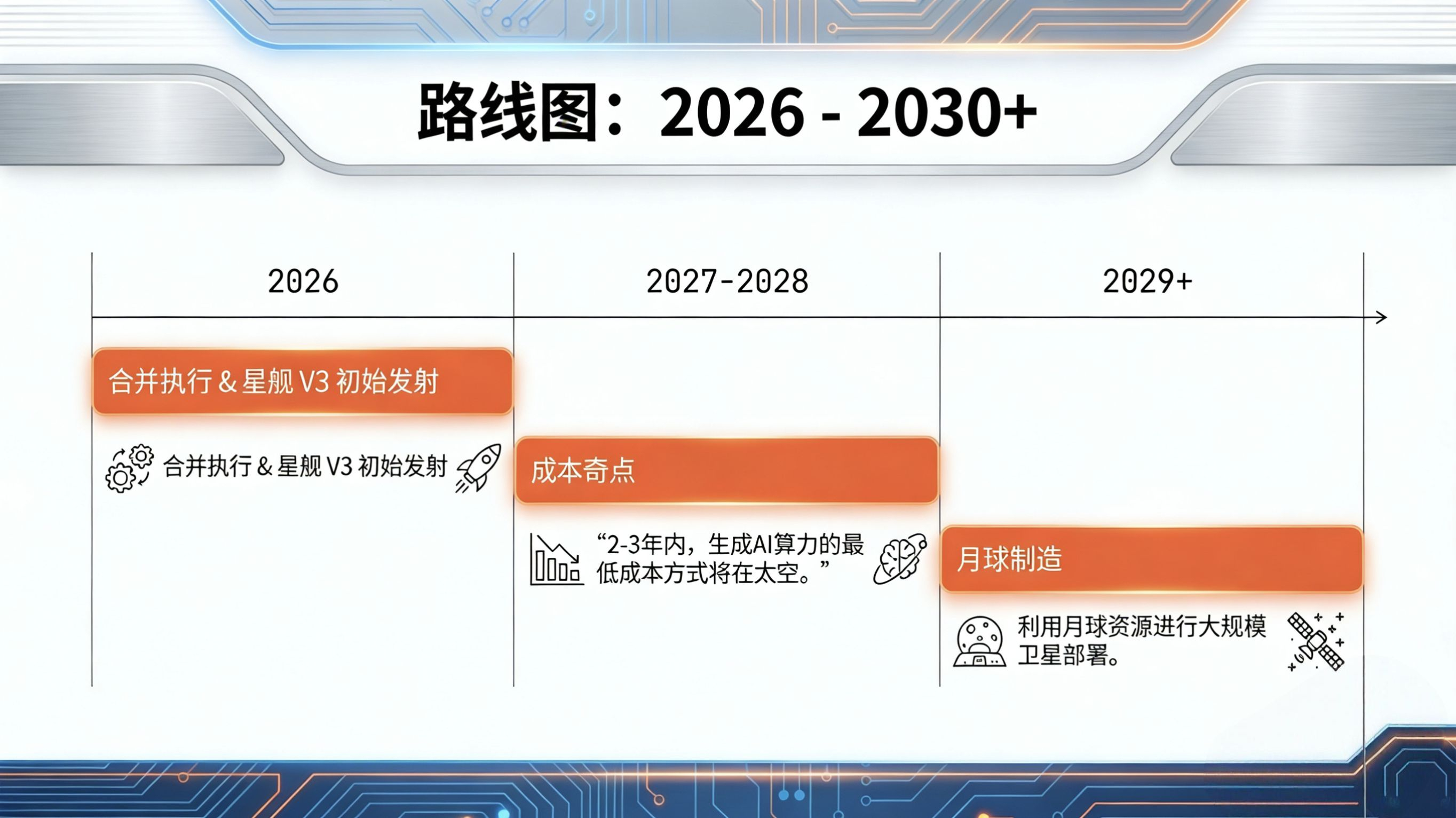

- Эффективность развертывания: за год можно запустить спутниковый кластер с вычислительной мощностью 500-1000 ТБ, срок расширения сокращен до 3-6 месяцев, что в 6 раз быстрее, чем на земле;

- Итоговое размещение: после реализации плана лунного завода, используя ресурсы Луны + электромагнитный запуск, затраты на транспортировку вычислительных устройств снизятся еще на 40%, сформировав цепочку поставок вычислительных мощностей “Земля-Луна-Орбита”.

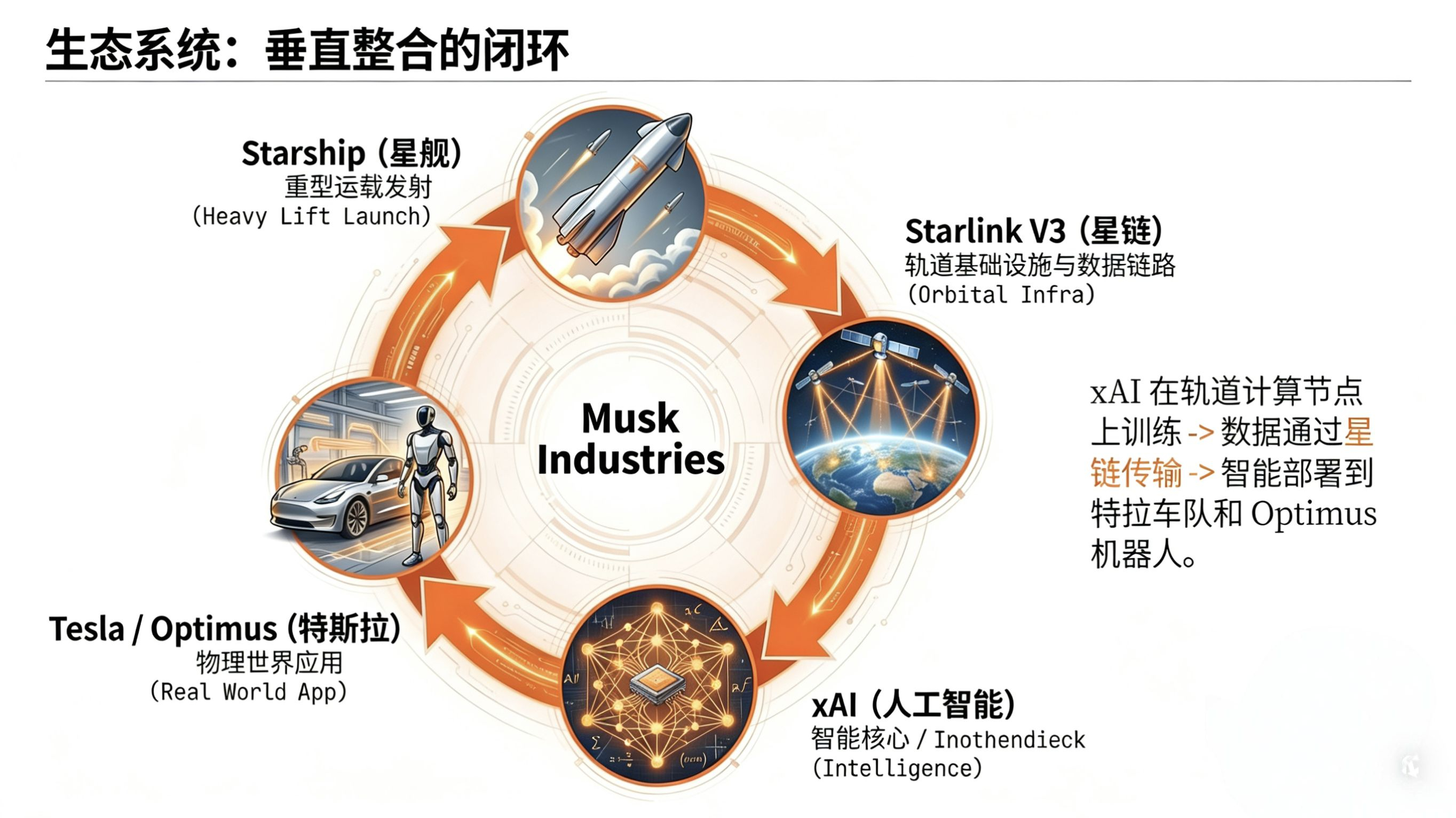

Более важно, это замкнутая логика: Starship (транспорт) → Starlink (передача данных, глобальная задержка <20ms) → AI-узлы на орбите (обучение, плотность вычислительных мощностей в 3 раза больше, чем на земле) → Tesla/Optimus (применение), каждая环 имеет поддержку данных:

- Starlink охватывает 95% суши Земли, обеспечивая бесшовное соединение между орбитальными и наземными терминалами;

- Плотность вычислительных мощностей AI-узлов на орбите достигает 1.2 PFLOPS/кубометр, что в 3 раза больше, чем в наземных суперкомпьютерных центрах;

- До 2027 года планируется развернуть 100 тысяч вычислительных спутников, общая вычислительная мощность будет в 10 раз больше, чем текущая сумма всех мировых суперкомпьютеров.

Риски существуют, но данные уже указывают на направления решения:

- Риск космического мусора: технологии возврата Starship + система автономного избегания столкновений спутников контролируют вероятность столкновения ниже 0.03%;

- Загрязнение от запусков: метановое топливо на 60% чище керосина, в сочетании с восстановимыми ракетами, углеродные выбросы на единицу вычислительной мощности составляют лишь 1/5 от выбросов наземных центров данных.

Теперь я понимаю, что это не “бред”, а “неизбежное, основанное на данных” — когда кривая стоимости вычислительной мощности на земле достигает пика, естественные дары космоса + инженерные прорывы Starship уже сделали модель стоимости “космических вычислений” более выгодной, чем на земле. Не пройдет и 3 лет, как цена вычислительной мощности для генеративного ИИ может снизиться с текущих $0.05/GFLOPS до $0.001/GFLOPS, а предоставлять эту вычислительную мощность будут спутниковые кластеры на орбите Земли.