Искусственный интеллект быстро становится основой цифрового принятия решений. Но на блокчейне настоящая проблема не в том, чтобы создать более умные модели, а в том, чтобы доказать, что они надежны. Каждый раз, когда вывод ИИ инициирует финансовое действие, формирует голосование по управлению или запускает смарт-контракт, системе нужен способ показать, что результат является подлинным и может быть воспроизведен. Вот в чем проблема, которую Mira решила с помощью своего API.

Большинство ИИ моделей сегодня являются черными ящиками. Вы отправляете им данные, получаете результат и подключаете это к своему приложению. Это работает хорошо, если вы строите на централизованной платформе, но на блокчейне дела становятся запутанными. Блокчейны требуют прозрачности, предсказуемости и возможности проверить каждый шаг. Если вы не можете независимо проверить, что сделал ИИ, вы вынуждены доверять тому, кто управляет моделью. Внезапно у вас появляется центральная точка отказа, скрывающаяся внутри якобы децентрализованной системы.

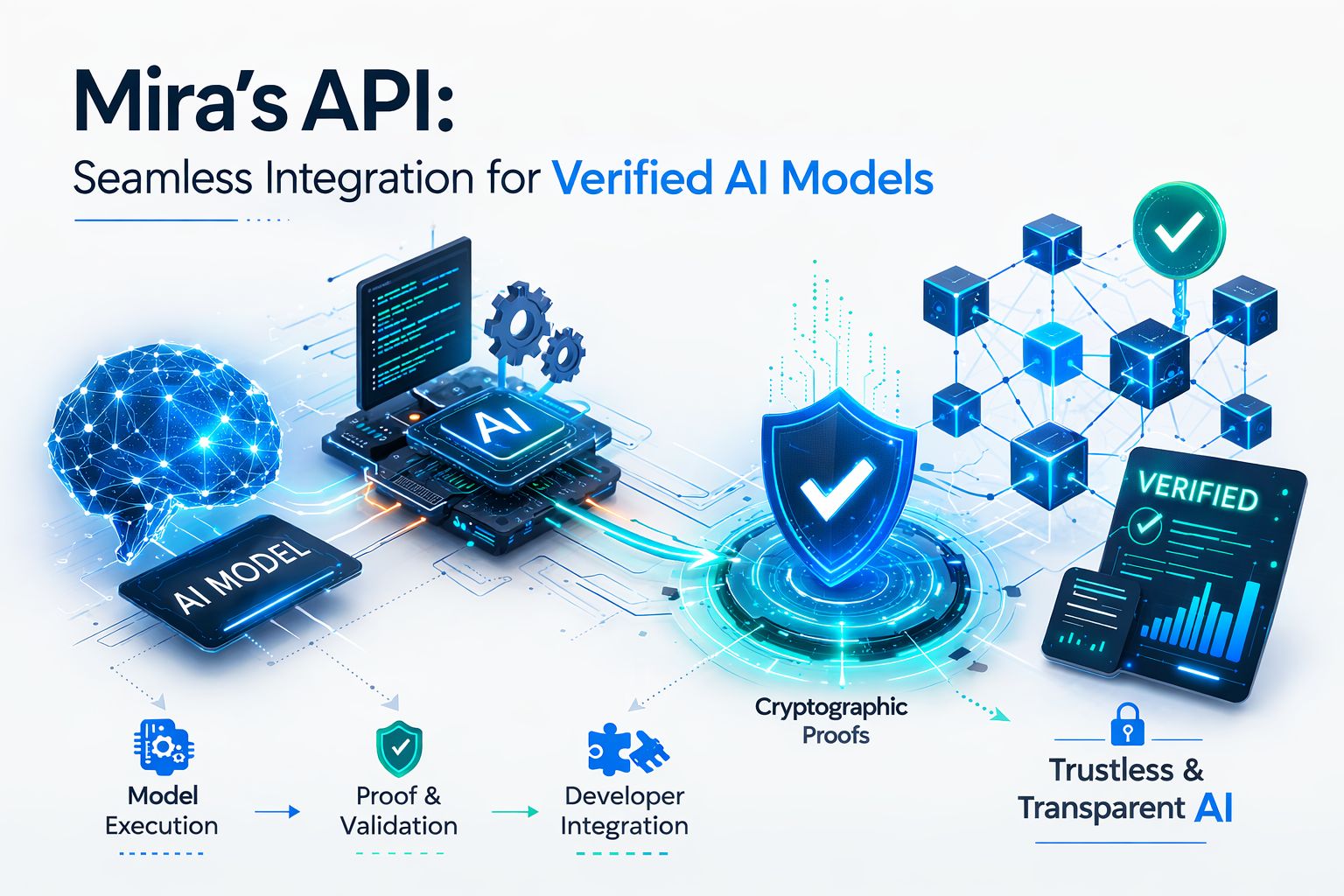

API Mira решает эту проблему напрямую. Она не просто выдает ответы, вместо этого она прикрепляет криптографические доказательства к каждому выводу. Эти доказательства показывают, как именно модель пришла к своему ответу. Другими словами, Mira превращает ИИ из черного ящика в прозрачную, проверяемую часть системы, которая идеально вписывается в среду с минимальными доверительными рисками.

Архитектура состоит из трех уровней. Во-первых, существует уровень выполнения модели. Здесь ИИ-модели делают свое дело: обрабатывают входные данные, делают предсказания. Mira наблюдает за всем, фиксируя, какая версия модели работала, какие параметры она использовала и какие шаги следовала. Это сырые данные для проверки.

Следующий шаг — это уровень доказательства и валидации. Здесь система берет все эти детали выполнения и превращает их в криптографические доказательства. Каждый может проверить эти доказательства, чтобы подтвердить, что конкретная модель, работающая при определенных условиях, выдала результат. Это мост между вероятностным миром ИИ и детерминированным миром блокчейнов.

Наконец, существует уровень интеграции для разработчиков. Здесь API Mira передает инструменты проверки разработчикам. Вы можете подключить API к своему децентрализованному приложению, агенту ИИ или инструменту автоматизации. Каждый раз, когда ИИ выдает решение, возможно, это оценка рисков или проверка контента, вы получаете данные о доказательствах сразу же вместе с выводом.

Это имеет значение, особенно в областях, где решения ИИ перемещают деньги или формируют экономические результаты. В децентрализованных финансах, например, ИИ используется для всего — от анализа рынка до выявления мошенничества. Если вы не можете проверить процесс ИИ, вы снова попадаете в ситуацию, когда нужно доверять поставщику. Mira меняет это. Теперь системы могут доказать, что их выводы, основанные на ИИ, являются последовательными, проверяемыми и честными.

Конечно, этот подход не бесплатен. Генерация этих криптографических доказательств добавляет дополнительные вычисления и может замедлить процессы, особенно с комплексными моделями. Также возникает вопрос о том, сколько деталей поставщики ИИ готовы раскрыть, в конце концов, их модели являются ценным интеллектуальным имуществом. Найти баланс между открытостью и защитой собственных разработок будет определять, насколько широко такая инфраструктура будет принята.

В более широком смысле, такие инструменты, как API Mira, создают новое пространство в криптомире. Оракулы решили проблему предоставления надежных внешних данных для смарт-контрактов. Теперь уровни проверки могут стать столь же важными для соединения ИИ с децентрализованными системами.

Итог: интеграция ИИ в блокчейн — это не просто вопрос ускорения или умности моделей. Доверие должно быть заложено с самого начала. API Mira указывает на более крупный тренд, отходящий от "ИИ как услуги" и движущийся к "ИИ как проверяемому компоненту". Умения уже недостаточно. Это должно быть также доказуемо.

@Mira - Trust Layer of AI $MIRA #Mira