Искусственный интеллект стремительно переходит от инструмента к автономному действующему лицу.

Системы ИИ уже пишут код, выполняют сделки, анализируют рынки и принимают сложные решения быстрее, чем это может сделать любой человек. Но по мере того, как эти системы приобретают автономию, возникает критический

вопрос:

вопрос:

Кто проверяет интеллект?

Сегодня большинство ИИ работает как черный ящик.

Результаты выглядят авторитетными, но логика, стоящая за ними, часто остается непрозрачной. Это становится опасным, когда ИИ начинает взаимодействовать с высоко рискованными средами, такими как финансы, управление или децентрализованная инфраструктура.

Неподтвержденная информация может быстро стать системным риском.

Это проблема, которую $MIRA стремится решить.

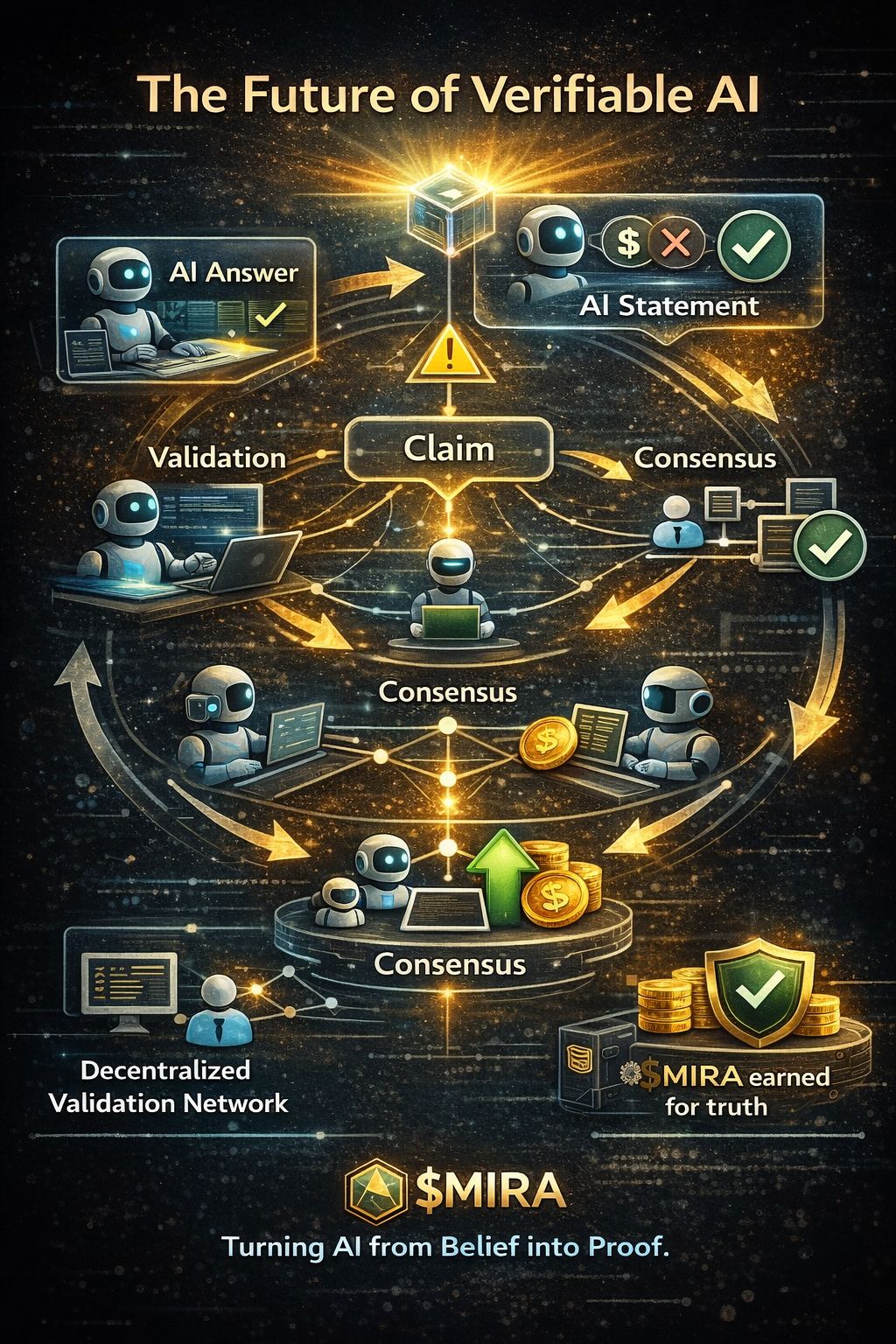

$MIRA вводит архитектуру с приоритетом проверки, где результаты ИИ никогда не принимаются как окончательные. Вместо этого они разбиваются на атомарные требования, которые можно проверять индивидуально.

Каждое требование проходит через процесс децентрализованной валидации, поддерживаемый распределенными участниками.

Протокол работает через несколько основных механизмов:

Декомпозиция требований

Результаты ИИ разделяются на более мелкие фактические утверждения, которые могут быть независимо проверены.

Распределенная валидация

Несколько валидаторов проверяют каждое требование, используя независимое мышление и внешние источники данных.

Порог консенсуса

Требования принимаются только тогда, когда достигнут заранее установленный уровень согласия валидаторов.

Экономические стимулы

Валидаторы ставят капитал и зарабатывают вознаграждения $MIRA, когда они правильно валидируют.

Механизмы оштрафования

Некорректная или небрежная валидация приводит к экономическим штрафам.

Неизменяемые аудиторские следы

Все результаты проверки навсегда фиксируются, обеспечивая полную прозрачность и прослеживаемость.

Эта архитектура преобразует проверку из пассивного процесса обзора в сеть правды, движимую стимулом.

Вместо того чтобы доверять одной модели ИИ, система полагается на коллективную валидацию, поддерживаемую экономической ответственностью.

Поскольку агенты ИИ начинают взаимодействовать с децентрализованными финансами, DAO, предсказательными рынками и автоматизированными системами, необходимость в проверяемом интеллекте становится фундаментальной.

$MIRA эффективно вводит уровень доверия для ИИ-систем, обеспечивая возможность оспаривания, проверки и доказательства интеллекта.

Потому что будущее ИИ касается не только генерации ответов.

Речь идет о доказательстве их.

ИИ без проверки — это скорость без тормозов.

$MIRA строит тормозную систему для автономного интеллекта.