في كل مرة يتقدم فيها الذكاء الاصطناعي خطوة إلى الأمام، يزداد إعجابنا بقدراته… لكنه في الوقت نفسه يطرح سؤالًا أكثر عمقًا:

هل يمكننا الوثوق دائمًا بما يقوله؟

الواقع أن النماذج الحديثة رغم قوتها قد تقع في أخطاء مثل الهلوسة أو التحيّز، وهو ما يجعل الاعتماد عليها في بعض المجالات الحساسة أمرًا يحتاج إلى طبقة إضافية من التحقق والثقة.

وهنا تحديدًا تظهر فكرة مشروع Mira.

فكرة المشروع

بدل أن يحاول Mira بناء نموذج ذكاء اصطناعي جديد، يركز على شيء أكثر أهمية:

التحقق من مخرجات الذكاء الاصطناعي نفسها.

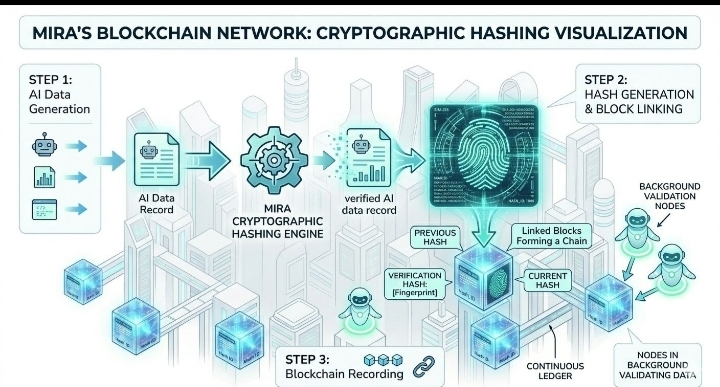

يعتمد البروتوكول على نظام لامركزي يقوم بتقسيم المهام أو الإجابات المعقدة إلى أجزاء صغيرة يمكن التحقق منها، ثم يتم توزيع هذه الأجزاء على شبكة من نماذج الذكاء الاصطناعي المستقلة.

بعد ذلك تتم مقارنة النتائج واعتماد الأكثر دقة عبر آلية إجماع لامركزية، مع توثيق النتيجة بطريقة شفافة.

بهذا الشكل تتحول الإجابات من مجرد معلومات عادية إلى نتائج موثقة يمكن الوثوق بها.

لماذا يبدو المشروع مهمًا؟

تكمن قوة Mira في أنه يعالج واحدة من أكبر مشاكل الذكاء الاصطناعي اليوم: الثقة.

فمع توسع استخدام الذكاء الاصطناعي في مجالات مثل:

التحليل المالي

الأنظمة القانونية

التشخيص الطبي

الأمن السيبراني

تصبح دقة المعلومات أمرًا حاسمًا، وليس مجرد ميزة إضافية.

وهنا يقدم Mira نموذجًا مختلفًا، حيث لا تعتمد الإجابة على نموذج واحد فقط، بل على تحقق جماعي قائم على الحوافز الاقتصادية والشفافية.

الميزات الأساسية

ما يجعل Mira مشروعًا لافتًا للنظر هو مجموعة من الخصائص المهمة، مثل:

التحقق اللامركزي

شبكة من نماذج الذكاء الاصطناعي تعمل معًا للتحقق من النتائج بدل الاعتماد على مصدر واحد.

توثيق النتائج

تحويل المخرجات إلى معلومات يمكن التحقق منها تشفيريًا.

حوافز اقتصادية

مكافآت للمشاركين الذين يقدمون عمليات تحقق دقيقة.

شفافية عالية

إمكانية تتبع عمليات التحقق ومراجعتها.

رؤية للمستقبل

إذا كان العقد الماضي قد ركز على تطوير نماذج ذكاء اصطناعي أكثر قوة، فقد يركز العقد القادم على شيء مختلف:

بناء أنظمة ذكاء اصطناعي يمكن الوثوق بها.

وفي هذا السياق، تبدو فكرة Mira كخطوة نحو بناء طبقة ثقة عالمية تعمل خلف الكواليس، تتحقق من المعرفة قبل أن تتحول إلى قرارات يعتمد عليها الناس.

الخلاصة

مشروع Mira لا يحاول فقط تحسين الذكاء الاصطناعي، بل يحاول معالجة السؤال الذي سيحدد مستقبل هذه التقنية:

كيف يمكننا الوثوق بما تقوله الآلات؟

وربما تكون الإجابة في بناء نظام يجعل الذكاء الاصطناعي نفسه

قابلًا للتحقق، شفافًا، وخاضعًا للإجماع. 🚀

@Mira - Trust Layer of AI #Mira $MIRA