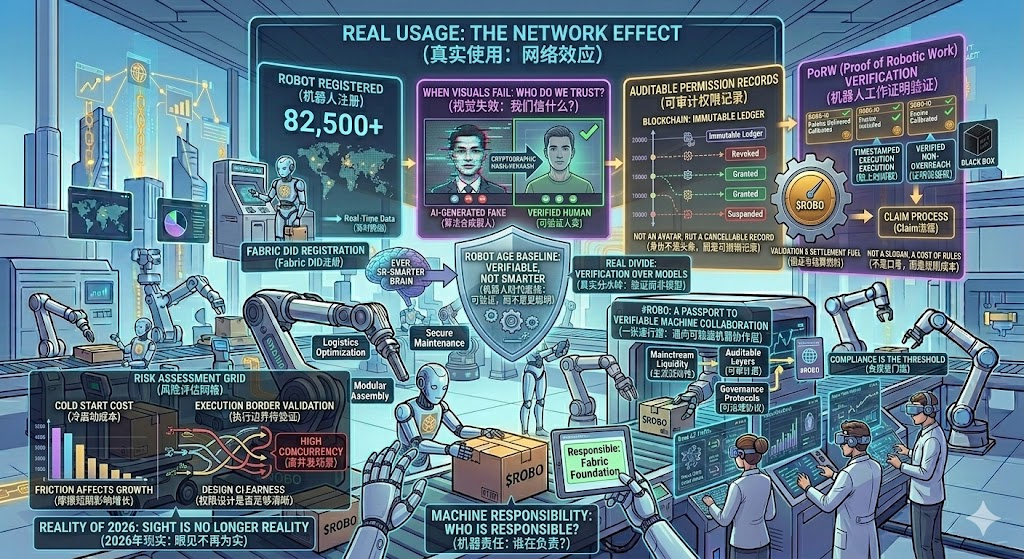

Recent, am auzit despre o fraudă cu schimbarea feței folosind AI: un director financiar al unei companii multinaționale a fost inducât să transfere o sumă uriașă într-o „reuniune video cu toți directorii”, iar abia după aceea a descoperit că, cu excepția sa, toți „colegii” din ecran erau creați de algoritmi. După ce am citit povestea, m-am simțit doar înghețat. Realitatea din 2026 este că ceea ce vedem nu mai este neapărat real, iar vocea noastră nu mai este o dovadă sigură. Ne aflăm într-un mediu în care este greu să distingem omul de mașină, iar fiecare interacțiune ar putea să fie o eroare de atribuire a drepturilor. Astfel, problema devine extrem de acută: când agenții inteligenți încep să participe la activități economice, cine va dovedi cine sunt ei, ce puteri dețin și ce au făcut?

Contraintuitiv, adevărata linie de demarcație nu este un model mai puternic, ci o validare mai strictă.

Primul pas este să descompunem cele trei puncte cheie. În primul rând, identitatea nu este un avatar, ci un registru de permisiuni care poate fi revocat și auditat. Procesul de revendicare, cu semnăturile, confirmările și termenii săi, poate părea complicat la prima vedere, dar esența sa este ca și cum am trimite „certificatul de bună purtare” viitoarelor mașini - nu pentru a împărți bani, ci pentru a lăsa o urmă de comportament care poate fi urmărit. @Fabric Foundation Tratați acest proces ca pe un experiment de comportament pe lanț: cine este dispus să susțină regulile, acela va intra în rețea.

În al doilea rând, validarea nu este „demonstrarea că ești foarte inteligent”, ci „demonstrarea că nu ai depășit limitele”. Așa-numitul Verified Work este mai degrabă un mod de a atașa un timestamp și o lanț de responsabilitate fiecărei execuții. Poate fi înțeles ca un „cutie neagră” în registrul public: poate fi reîntors în caz de probleme, poate fi urmărit în caz de dispute. $ROBO Rolul său este de a alimenta validarea și decontarea - nu este doar un slogan, ci un consumabil care face ca regulile să funcționeze cu adevărat.

În al treilea rând, conformitatea nu este o decorare, ci un prag de intrare în lichiditatea de masă. Acțiunea din 27 februarie a făcut ca exteriorul să conștientizeze că acest drum nu este doar un joc de auto-satisfacție. În loc să o vedem ca pe un token, mai bine o vedem ca pe #ROBO un permis de trecere: drumul către un nivel de colaborare al mașinilor care poate fi verificat, guvernat și auditat.

Riscurile trebuie, de asemenea, clarificate. În primul rând, costul de pornire este semnificativ. Procesele complicate pot elimina speculatorii, dar pot bloca și o parte din utilizatorii reali; frecarea generată de validare va afecta, pe termen scurt, viteza de creștere. În al doilea rând, limitele de execuție rămân de verificat. Este designul identității, permisiunilor și condițiilor de încetare suficient de clar pentru a menține eficiența în scenarii cu concurență ridicată? Este nevoie de timp pentru a verifica acest lucru.

Dacă mecanismul de validare poate fi adoptat cu adevărat de către partea de scenariu, costurile de validare vor scădea odată cu creșterea, iar rețeaua de colaborare va fi mai probabil să se extindă; pe de altă parte, dacă frecarea depășește pe termen lung beneficiile, rețeaua poate rămâne blocată în faza de pornire rece, iar structura de încredere va fi greu de format. Mașinile vor deveni din ce în ce mai inteligente, dar dacă nu există reguli care să le susțină, inteligența va amplifica doar riscurile. Întrebarea nu mai este „cât de puternic este AI-ul”, ci „cine este responsabil pentru el.”