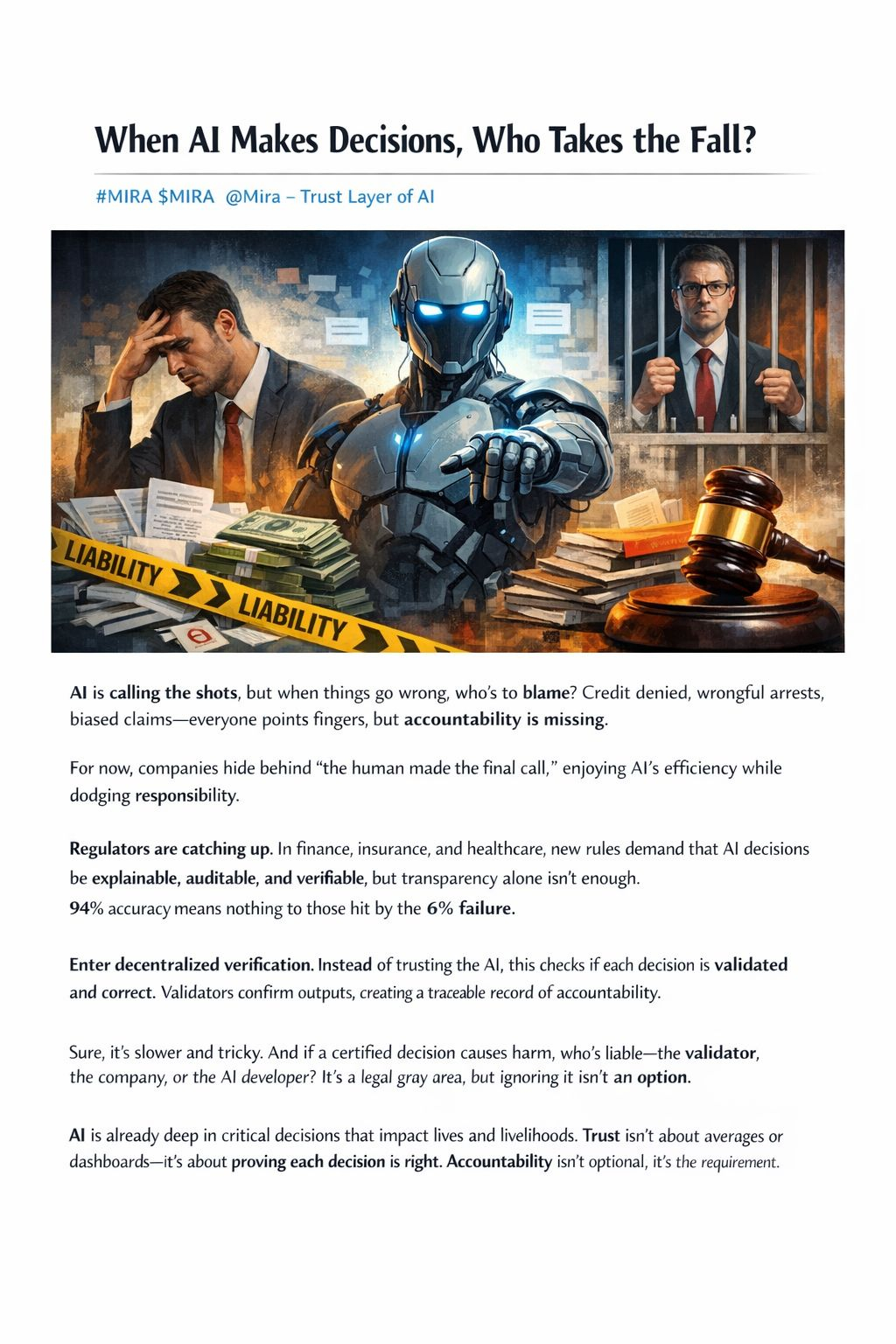

Industria AI a evitat mult timp o întrebare critică: când un sistem AI cauzează daune în lumea reală, cine este de fapt responsabil? Aceasta nu este teoretică—este vorba despre cariere care sunt încheiate, investigații lansate sau soluții de milioane de dolari. Chiar acum, nu există un răspuns clar, iar această incertitudine este cel mai mare obstacol pentru adoptarea completă a AI-ului în instituții. Problema nu este costul, calitatea modelului sau complexitatea integrării—ci lipsa de responsabilitate.

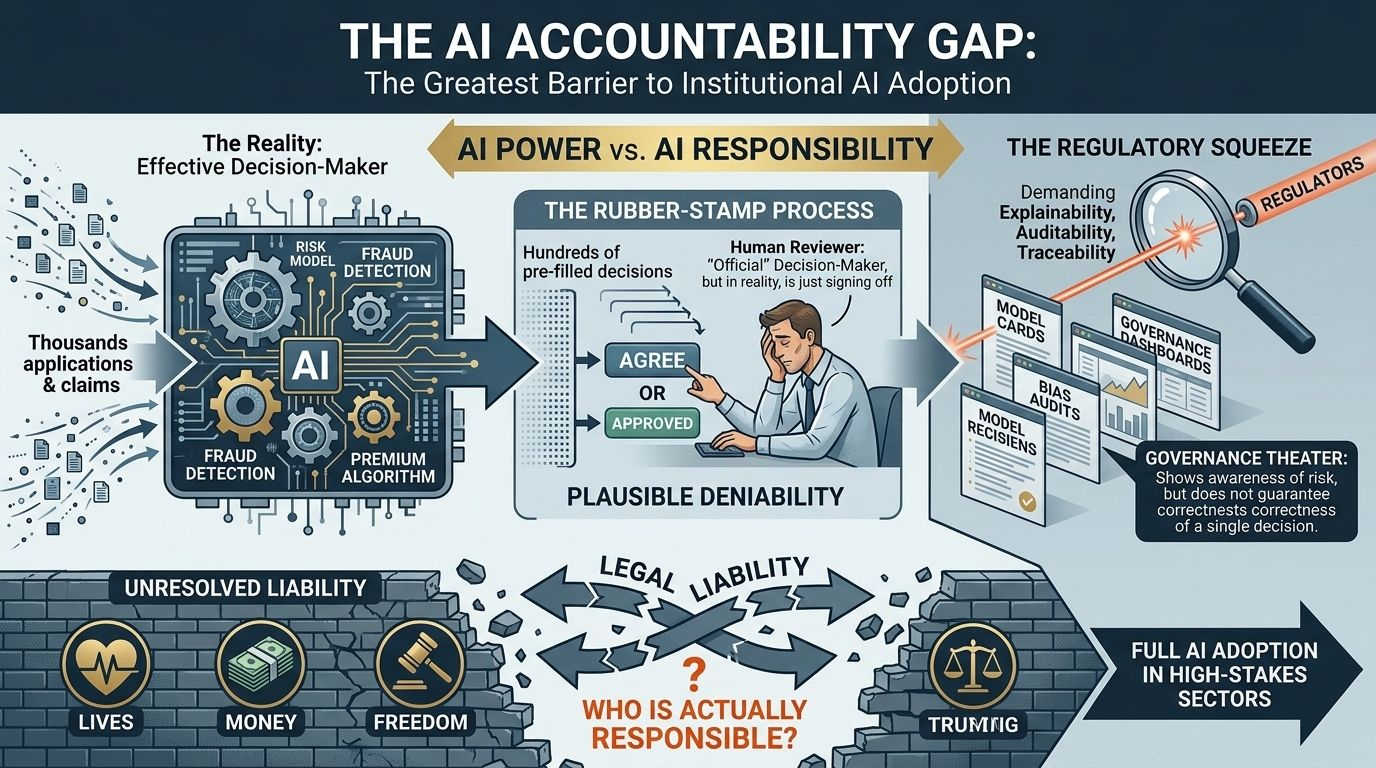

Cele mai multe sisteme de inteligență artificială sunt prezentate ca fiind consilieri, nu luători de decizii. Un model de credit poate semnala pe cineva ca fiind riscant, un algoritm de asigurare poate sugera o primă, iar un sistem de detectare a fraudelor poate ridica o alertă. Oficial, un om semnează, așa că modelul „nu ia decizia”. Dar, în realitate, după procesarea a mii de aplicații sau cereri, oamenii adesea aprobă ceea ce AI-ul a ales deja. AI-ul nu mai sugerează—practic decide. Organizațiile câștigă beneficiile eficienței, păstrând în același timp o negare plauzibilă atunci când lucrurile merg prost.

Regulatorii încep să se pună la curent. În domeniul financiar, al asigurărilor și în alte sectoare cu riscuri mari, noi reguli cer ca sistemele AI să fie explicabile, auditabile și trasabile. Industria răspunde cu carduri de model, audituri de bias și tablouri de bord care arată comportamentul AI. Dar aceste măsuri nu rezolvă problema de bază. Ele arată conștientizarea riscurilor, dar nu garantează că vreo decizie particulară este corectă. În domeniile în care vieți, bani sau libertate sunt în joc, performanța generală a modelului este lipsită de semnificație.

Precizia este adesea supraevaluată. Un model ar putea fi corect în medie în proporție de 94%, dar cele 6% rămase pot distruge o aplicație de ipotecă, pot clasifica greșit o cerere de asigurare sau pot refuza o procedură medicală. Auditorii nu se uită la medii; regulatorii nu examinează performanța agregată. Instanțele se concentrează pe rezultatele specifice care au cauzat daune. Responsabilitatea în AI se referă la decizia individuală, nu la tendințele statistice.

Aici este locul unde verificarea descentralizată schimbă regulile jocului. În loc să întrebe dacă un model este în general fiabil, întreabă dacă un anumit rezultat a fost verificat. Nu este vorba despre a avea încredere în AI în teorie—este vorba despre a confirma că această decizie exactă poate fi susținută. La fel cum un producător produce înregistrări de inspecție pentru fiecare produs, deciziile AI pot avea înregistrări verificabile.

Un astfel de sistem schimbă, de asemenea, stimulentele. Validatorii care confirmă rezultatele sunt recompensați pentru precizie și penalizați pentru neglijență. Fiecare decizie devine auditabilă și responsabilizată. Instituțiile pot demonstra că rezultatele individuale au fost verificate—nu doar că AI-ul funcționează bine în general. Acea înregistrare poate face diferența între conformitate și încălcare, încredere și răspundere.

Verificarea are costuri. Poate încetini procesele, adăuga complexitate și ridica provocări operaționale. În medii cu viteză mare, chiar și întârzieri minime pot fi inacceptabile. Întrebările legale rămân: dacă o decizie verificată cauzează ulterior daune, cine este răspunzător—validatorul, organizația sau dezvoltatorul AI? Până când nu există reguli formale pentru verificarea AI distribuit, instituțiile vor rămâne prudente.

Realitatea este clară: AI-ul ia deja decizii care afectează banii, oportunitățile și libertățile oamenilor. Aceste domenii funcționează sub cadre stricte de responsabilitate. Dacă AI-ul face parte din ele, nu poate scăpa de aceleași standarde. Încrederea se construiește o decizie la un moment dat, prin procese clare care stabilesc responsabilitatea atunci când lucrurile merg prost. Responsabilitatea nu este opțională—este esențială.

Dacă dorești, pot crea și o versiune scurtă, prietenoasă cu rețelele sociale, a acestui articol pentru platforme precum Twitter sau LinkedIn care să evidențieze punctele principale și să includă un apel la acțiune pentru $MIRA

$MIRA

$MIRA