1. Problema: De ce AI are nevoie de un strat de încredere

Rețeaua Mira încearcă să construiască un strat de încredere pentru AI. Așadar, de ce AI trebuie să fie de încredere? Cum rezolvă Mira această problemă?

Când oamenii discută despre AI, se concentrează mai mult pe aspectele puternice ale AI. Cu toate acestea, este interesant că AI are "iluzorii" sau prejudecăți. Oamenii nu acordă prea multă atenție acestui lucru. Care este "iluzia" AI? Pe scurt, AI uneori "inventează" și vorbește prostii într-un mod serios. De exemplu, dacă întrebi AI de ce luna este roz, s-ar putea să-ți ofere multe explicații aparent rezonabile într-un mod serios.

2. Originea tehnică a halucinațiilor AI

„Iluziile” sau părtinirile AI sunt legate de unele căi actuale ale tehnologiei AI. De exemplu, AI generativ produce conținut prezicând „cel mai probabil” pentru a obține coerență și raționalitate, dar uneori este imposibil să se verifice autenticitatea. În plus, datele de antrenament în sine conțin erori, părtiniri și chiar conținut fictiv, care vor afecta, de asemenea, ieșirea AI. Cu alte cuvinte, AI învață modele de limbaj uman, mai degrabă decât faptele în sine.

Pe scurt, mecanismul actual de generare a probabilităților + modelul bazat pe date aduce aproape inevitabil posibilitatea halucinației AI.

3. Consecințe de mare risc în domenii riguroase

Dacă acest tip de ieșire părtinitoare sau halucinată este doar conținut obișnuit de cunoștințe sau divertisment, nu vor exista consecințe directe pentru moment. Cu toate acestea, dacă apare în domenii foarte riguroase, cum ar fi medicina, dreptul, aviația și finanțele, va avea consecințe majore. Prin urmare, cum să rezolvăm halucinațiile și părtinirile AI este una dintre problemele esențiale în evoluția AI. Unii folosesc tehnologia de generare îmbunătățită prin recuperare (combinată cu baze de date în timp real pentru a prioritiza ieșirea faptelor verificate), iar alții introduc feedback uman pentru a corecta erorile modelului prin etichetare manuală și supraveghere umană.

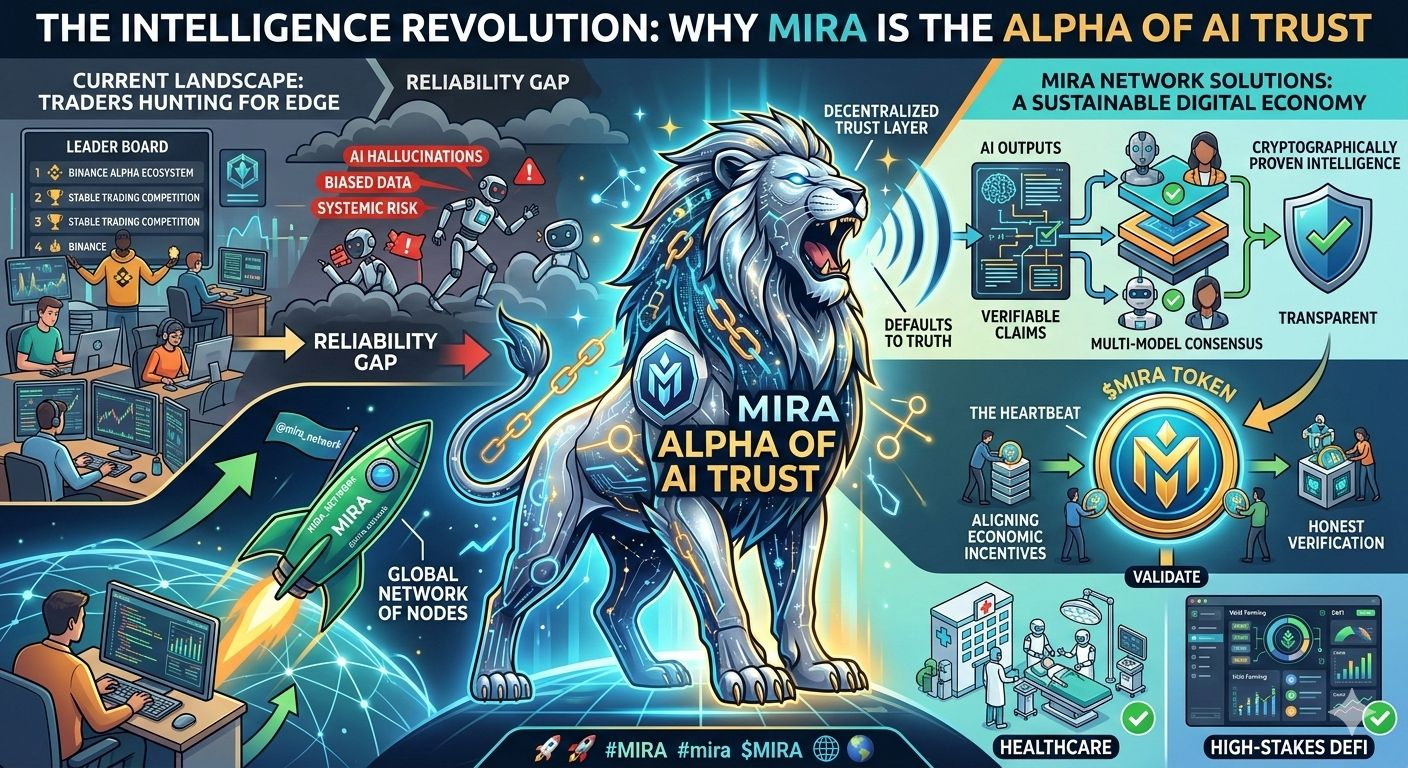

4. Soluția Mira: Consensul Multi-Model

Proiectul Mira încearcă, de asemenea, să rezolve problema părtinirii și iluziilor AI. Cu alte cuvinte, Mira încearcă să construiască un strat de încredere pentru AI, să reducă părtinirea și iluziile AI și să îmbunătățească fiabilitatea AI. Așadar, din cadrul general, cum reduce Mira părtinirea și iluziile AI și, în cele din urmă, atinge un AI de încredere?

Nucleul realizării Mira este de a verifica ieșirea AI prin consensul mai multor modele AI. Cu alte cuvinte, Mira însăși este o rețea de verificare care verifică fiabilitatea ieșirii AI și profită de consensul mai multor modele AI. În plus, un alt punct important este verificarea prin consens descentralizat.

Prin urmare, cheia rețelei Mira este verificarea consensului descentralizat. Verificarea consensului descentralizat este ceea ce domeniul criptografic se descurcă bine. În același timp, profită și de sinergia mai multor modele pentru a reduce părtinirile și iluziile prin modul de verificare colectiv.

În ceea ce privește arhitectura de verificare, aceasta necesită o declarație verificabilă independent. Protocolul Mira susține conversia conținutului complex în declarații verificate independent. Aceste declarații necesită ca operatorii de noduri să participe la verificare. Pentru a asigura onestitatea operatorilor de noduri, aici vor fi folosite stimulente/pedepse criptoeconomice pentru a atinge diferite modele AI + operatori de noduri descentralizați pentru a asigura fiabilitatea rezultatelor verificării.

5. Conversia conținutului și protecția intimității

Arhitectura rețelei Mira include conversia conținutului, verificarea distribuită și mecanismele de consens pentru a obține fiabilitatea verificării. În această arhitectură, conversia conținutului este o parte importantă. Rețeaua Mira va descompune mai întâi conținutul candidat (de obicei, trimis de client) în diferite declarații verificabile (pentru a asigura că modelul poate fi înțeles în același context). Aceste declarații sunt distribuite nodurilor de către sistem pentru verificare pentru a determina validitatea declarației și a rezuma rezultatele pentru a ajunge la un consens. Aceste rezultate și consensul vor fi returnate clientului. În plus, pentru a proteja intimitatea clientului, conversia conținutului candidat este descompusă în perechi de declarații, care vor fi date diferitelor noduri într-o manieră aleatorie pentru a preveni scurgerea informațiilor în timpul procesului de verificare.

În general, Mira oferă o nouă soluție pentru a obține fiabilitatea AI, care este să construiască o rețea de verificare a consensului descentralizat bazată pe mai multe modele AI, aducând o fiabilitate mai mare serviciilor AI ale clienților, reducând părtinirea și iluziile AI și îndeplinind nevoile clienților pentru o mai mare acuratețe și precizie. Pe scurt, Mira încearcă să construiască un strat de încredere pentru AI. Aceasta va promova aplicația aprofundată a AI.

6. Ecosistemul actual și participarea la testnet

În prezent, cadrele agentului AI al Mira includ ai16z, ARC etc. Rețeaua publică de testare Mira a fost lansată ieri. Utilizatorii pot participa la rețeaua publică de testare Mira folosind Klok, care este o aplicație de chat LLM bazată pe Mira. Folosind aplicația Klok, puteți experimenta ieșirea AI verificată (puteți să o comparați cu ieșirea AI neverifyată) și să câștigați puncte Mira. În ceea ce privește utilizarea viitoare a punctelor, aceasta nu a fost încă dezvăluită.