Przemysł AI od dawna unikał kluczowego pytania: gdy system AI powoduje realne szkody, kto tak naprawdę ponosi odpowiedzialność? To nie jest teoretyczne - chodzi o zakończenie karier, rozpoczęcie dochodzeń lub ugody na wiele milionów dolarów. W tej chwili nie ma jasnej odpowiedzi, a ta niepewność jest największą barierą dla pełnej adopcji AI w instytucjach. Problemem nie są koszty, jakość modelu ani złożoność integracji - to brak odpowiedzialności.

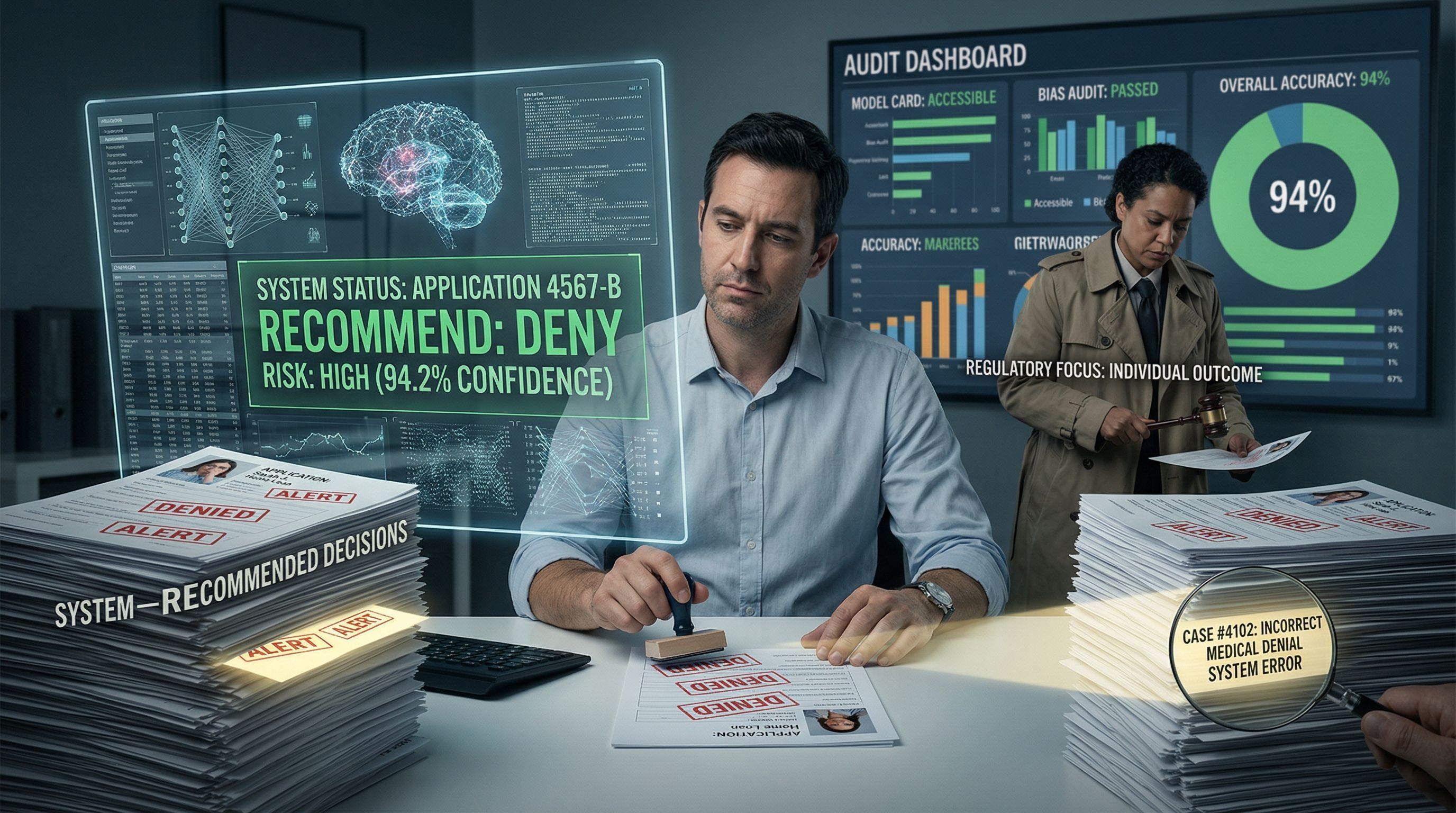

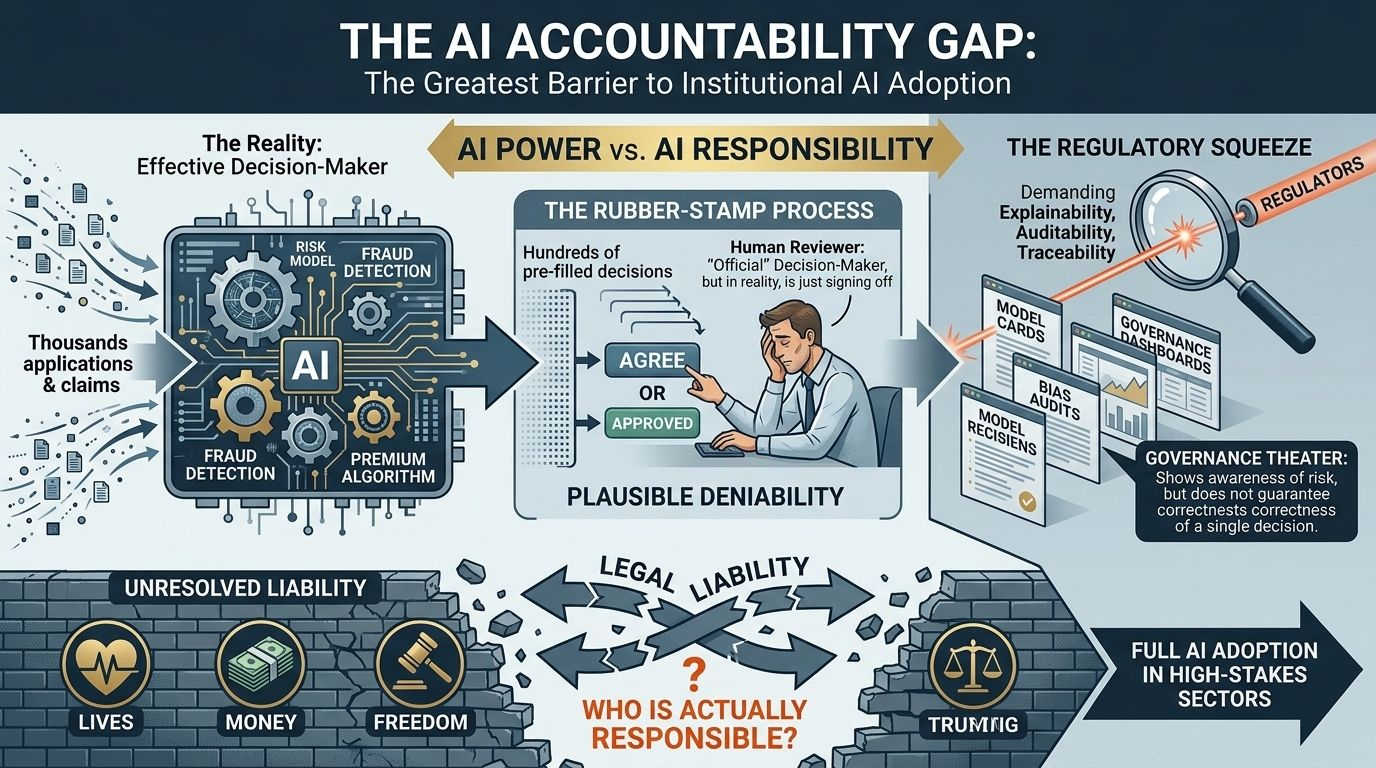

Większość systemów AI jest przedstawiana jako doradcy, a nie podejmujący decyzje. Model kredytowy może oznaczyć kogoś jako ryzykownego, algorytm ubezpieczeniowy może zasugerować składkę, a system wykrywania oszustw może wzbudzić alert. Oficjalnie, człowiek zatwierdza, więc model „nie podejmuje decyzji”. Ale w rzeczywistości, po przetworzeniu tysięcy wniosków lub roszczeń, ludzie często po prostu zatwierdzają to, co AI już wybrało. AI nie sugeruje już - de facto podejmuje decyzje. Organizacje zyskują korzyści z efektywności, jednocześnie zachowując wiarygodne zaprzeczenie, gdy coś idzie nie tak.

Regulatorzy zaczynają doganiać. W finansach, ubezpieczeniach i innych sektorach o wysokich stawkach nowe przepisy wymagają, aby systemy AI były zrozumiałe, audytowalne i śledzone. Branża odpowiada kartami modeli, audytami uprzedzeń i pulpitami pokazującymi zachowanie AI. Ale te środki nie rozwiązują podstawowego problemu. Pokazują świadomość ryzyka, ale nie gwarantują, że jakakolwiek konkretna decyzja jest poprawna. W obszarach, gdzie stawką są życie, pieniądze lub wolność, ogólna wydajność modelu jest bez znaczenia.

Dokładność jest często nadmiernie podkreślana. Model może być średnio poprawny w 94%, ale pozostałe 6% może zrujnować wniosek o kredyt hipoteczny, błędnie zakwalifikować roszczenie ubezpieczeniowe lub odmówić procedury medycznej. Audytorzy nie patrzą na średnie; regulatorzy nie badają ogólnej wydajności. Sądy koncentrują się na konkretnych wynikach, które spowodowały szkody. Odpowiedzialność w AI dotyczy indywidualnej decyzji, a nie trendów statystycznych.

To tutaj zdecentralizowana weryfikacja zmienia zasady gry. Zamiast pytać, czy model jest ogólnie wiarygodny, pyta, czy konkretna decyzja została zweryfikowana. Nie chodzi o zaufanie do AI w teorii - chodzi o potwierdzenie, że ta konkretna decyzja może być poparta. Tak jak producent wytwarza dokumentację inspekcji dla każdego produktu, decyzje AI mogą mieć weryfikowalne zapisy.

Taki system również zmienia zachęty. Walidatorzy potwierdzający wyniki są nagradzani za dokładność i karani za zaniedbanie. Każda decyzja staje się audytowalna i odpowiedzialna. Instytucje mogą wykazać, że poszczególne wyniki zostały zweryfikowane - nie tylko to, że AI zazwyczaj działa dobrze. Ta dokumentacja może być różnicą między zgodnością a naruszeniem, zaufaniem a odpowiedzialnością.

Weryfikacja ma swoje koszty. Może spowolnić procesy, dodać złożoności i zwiększyć wyzwania operacyjne. W środowiskach o wysokiej prędkości nawet małe opóźnienia mogą być nieakceptowalne. Pozostają pytania prawne: jeśli zweryfikowana decyzja później spowoduje szkodę, kto ponosi odpowiedzialność - walidator, organizacja, czy deweloper AI? Dopóki nie istnieją formalne zasady dla rozproszonej weryfikacji AI, instytucje będą ostrożne.

Rzeczywistość jest jasna: AI już podejmuje decyzje, które wpływają na pieniądze, możliwości i wolności ludzi. Te obszary działają w ramach ścisłej odpowiedzialności. Jeśli AI jest częścią tych obszarów, nie może uciec od tych samych standardów. Zaufanie buduje się z każdą decyzją, poprzez jasne procesy, które przypisują odpowiedzialność, gdy coś się nie uda. Odpowiedzialność nie jest opcjonalna - jest niezbędna.

Jeśli chcesz, mogę również stworzyć krótką, przyjazną dla mediów społecznościowych wersję tego artykułu na platformy takie jak Twitter czy LinkedIn, która podkreśli główne punkty i zawrze wezwanie do działania dla $MIRA

$MIRA

$MIRA