Sto aspettando e osservando i strati più tranquilli del mondo dell'IA dove i veri problemi si rivelano lentamente. Sto guardando oltre l'eccitazione intorno a modelli potenti e dimostrazioni impressionanti e concentrandomi su qualcosa che sembra molto più fragile sotto tutto questo. Ho notato quanto facilmente le persone si fidano delle risposte che suonano intelligenti. Mi concentro sulla strana tensione tra quanto sicura suona l'intelligenza artificiale e quanto incerta possa essere la sua conoscenza.

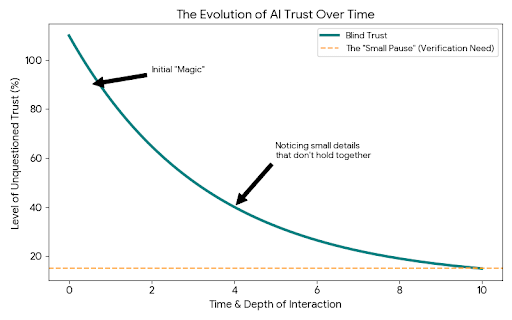

La prima volta che trascorri del tempo reale con strumenti di intelligenza artificiale moderni, sembra quasi magico. Digiti una domanda e pochi secondi dopo appare una spiegazione completa. Può analizzare argomenti complessi, scrivere lunghi paragrafi, riassumere ricerche, persino imitare un ragionamento che sembra riflessivo e strutturato.

All'inizio sembra che il futuro sia arrivato silenziosamente.

Ma più a lungo ci siedi, più iniziano a comparire dubbi sottili.

Inizi a notare piccoli dettagli che non si incastrano del tutto. Un riferimento che non può essere trovato. Una statistica che sembra credibile ma si rivela leggermente errata. Una spiegazione sicura costruita su un'assunzione debole.

Ciò che rende questi momenti inquietanti non è l'errore stesso. Gli esseri umani commettono errori costantemente. Ciò che lo rende scomodo è la certezza nel tono. La risposta arriva senza esitazione. Nessun dubbio visibile. Sembra finita anche quando qualcosa all'interno è silenziosamente rotto.

E questo crea una strana reazione emotiva più a lungo usi questi sistemi.

Vuoi fidarti di loro. Vuoi credere che l'intelligenza con cui stai interagendo capisca ciò che sta dicendo. Ma una parte di te inizia a esitare prima di accettare qualsiasi cosa troppo rapidamente.

Quella piccola pausa è diventata più comune per me man mano che guardo l'evoluzione dell'intelligenza artificiale.

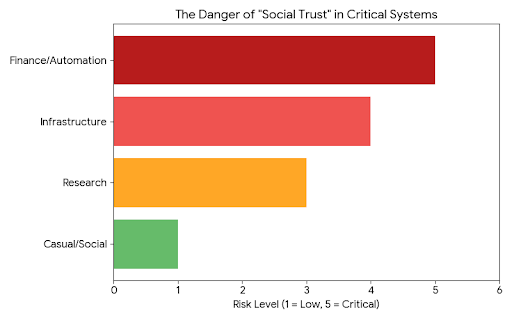

In questo momento la maggior parte dei sistemi di IA opera su una sorta di fiducia sociale. Il modello produce una risposta e l'utente decide se sembra corretta. A volte le persone ricontrollano. A volte no. Quando l'argomento è informale, il rischio è basso.

Ma nel momento in cui l'IA inizia a toccare decisioni finanziarie, ricerca, automazione o infrastruttura, quella fiducia casuale inizia a sembrare pericolosa.

La cosa strana è che l'intera industria sembra concentrata nel rendere l'IA più potente, mentre la questione dell'affidabilità sembra ancora incompleta.

Modelli più grandi appaiono. Modelli più veloci appaiono. Tecniche di ragionamento più intelligenti appaiono. Ma la dinamica di base rimane la stessa. Un singolo sistema produce una risposta e tutti gli altri sperano che la risposta sia giusta.

Più osservo questo modello, più sembra che stiamo risolvendo il problema sbagliato per primo.

Forse l'intelligenza da sola non è sufficiente.

Forse il livello mancante è la verifica.

Quell'idea ha iniziato a persistere nella mia mente quando ho iniziato a studiare silenziosamente cosa sta cercando di costruire Mira Network. A prima vista sembra un altro progetto seduto da qualche parte tra intelligenza artificiale e tecnologia blockchain. Quella combinazione è apparsa molte volte prima e spesso sembra forzata.

Ma più a lungo sono rimasto con il concetto, più ha iniziato a sembrare che stesse affrontando qualcosa di più profondo.

Invece di assumere che le uscite dell'IA debbano essere fidate, Mira le tratta come qualcosa che deve essere messo in discussione.

Quel cambiamento potrebbe sembrare piccolo, ma cambia l'intera relazione tra umani e macchine.

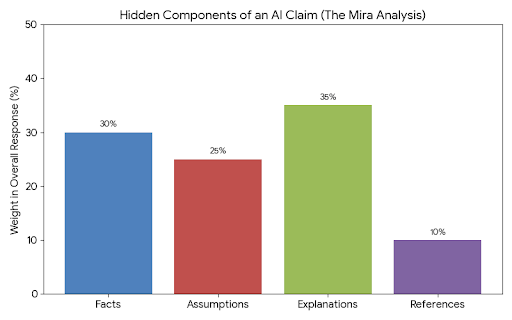

Quando un'IA genera una lunga risposta, non sta semplicemente producendo una singola affermazione. Nascosti all'interno di quella risposta ci sono molte affermazioni separate. Fatti, assunzioni, spiegazioni, riferimenti. Gli esseri umani spesso leggono il paragrafo come un blocco unico di informazioni e lo accettano se il tono complessivo sembra convincente.

Mira lo affronta in modo diverso.

Il sistema spezza il contenuto in affermazioni individuali che possono essere esaminate una per una.

Improvvisamente la risposta non è più una verità finita. Diventa qualcosa di più vicino a un insieme di idee in attesa di essere testate.

Diversi modelli di IA nella rete partecipano all'esame di quelle affermazioni. Invece di una voce che dichiara la risposta, più voci valutano se ciascun pezzo di informazione regge effettivamente.

Guardare questa struttura svilupparsi sembra stranamente familiare.

Inizia a somigliare al modo in cui gli esseri umani cercano la verità.

Nella scienza, una scoperta non è accettata immediatamente. Altri ricercatori la testano. La mettono in discussione. La sfidano. A volte la confermano. A volte dimostrano che alcune parti sono sbagliate. Nel tempo emerge un quadro più chiaro.

Quel processo esiste perché la conoscenza diventa più forte quando resiste all'esame.

L'intelligenza artificiale ha operato principalmente senza quel livello.

In questo momento un modello produce informazioni e la responsabilità di metterle in discussione ricade interamente sulla persona che le legge. Funziona quando l'IA sta solo aiutando a scrivere email o riassumere documenti. Ma non appena le macchine iniziano a interagire con altre macchine, il sistema diventa fragile.

Un'informazione difettosa può viaggiare rapidamente attraverso sistemi automatizzati. Vengono prese decisioni. I processi avanzano. E l'errore originale si moltiplica silenziosamente.

Quella possibilità crea una tensione silenziosa sotto tutto l'entusiasmo intorno all'IA.

Stiamo costruendo macchine che possono generare conoscenza più velocemente di quanto gli esseri umani abbiano mai potuto. Ma non abbiamo ancora costruito un sistema condiviso per verificare quella conoscenza alla stessa velocità.

Quella è la parte di Mira che continua a richiamare la mia attenzione.

Invece di inseguire il sogno di un modello perfetto, il progetto assume che l'imperfezione esisterà sempre. Gli errori si verificheranno. Le allucinazioni si verificheranno. I pregiudizi appariranno.

Quindi la vera domanda diventa qualcosa di più semplice.

Come fai a catturare l'errore prima che si diffonda?

La risposta che Mira esplora è sorprendentemente radicata. Trasforma la verifica in un processo di rete. Lascia che partecipanti indipendenti valutino le affermazioni. Usa incentivi per incoraggiare una validazione onesta. Consenti al consenso di formarsi attorno a ciò che l'informazione sopravvive all'esame.

La blockchain inizia a avere senso all'interno di quella struttura.

Per anni le blockchain sono state utilizzate per aiutare gli estranei a concordare su registri finanziari senza fidarsi di un'autorità centrale. Mira sembra stia sperimentando l'idea che la stessa logica potrebbe applicarsi all'informazione stessa.

Invece di fidarsi di un singolo modello di IA, la fiducia emerge dall'interazione tra molti valutatori.

Ciò che mi affascina di questa direzione è quanto sia calma rispetto al solito rumore nel mondo delle criptovalute.

La maggior parte dei progetti parla di velocità, scala o interruzione. La conversazione spesso ruota attorno a quanto velocemente qualcosa può crescere o quanto grande potrebbe diventare la rete.

Mira sembra più silenziosa.

Sembra che qualcuno abbia notato una debolezza che tutti gli altri stavano evitando e abbia deciso di affrontarla direttamente.

L'affidabilità della conoscenza generata dalle macchine.

E più guardo l'evoluzione dell'intelligenza artificiale, più quel problema sembra impossibile da ignorare. Perché il futuro che molte persone immaginano coinvolge sistemi autonomi che prendono decisioni, negoziano transazioni, gestiscono infrastrutture e interagiscono tra loro costantemente.

Se quei sistemi sono costruiti su informazioni che non sono mai state verificate correttamente, l'intera struttura poggia su un terreno instabile.

Più osservo questo spazio, più un pensiero diventa chiaro.

La vera svolta nell'intelligenza artificiale potrebbe non venire dalla macchina che produce il maggior numero di risposte, ma dal sistema che finalmente impara come metterle in discussione.