Sto aspettando e osservando i lati più tranquilli del mondo dell'IA e delle criptovalute, dove i sistemi reali di solito iniziano a formarsi molto prima che qualcuno li consideri importanti. Sto guardando oltre l'eccitazione, oltre gli annunci dei token e le previsioni sui robot che prendono il controllo delle industrie. Ho notato qualcosa di diverso quando rallento e presterò attenzione a come si sta evolvendo l'infrastruttura più profonda. Mi concentro sui pezzi che la maggior parte delle persone ignora all'inizio, i livelli sotto la tecnologia dove fiducia, coordinazione e responsabilità iniziano silenziosamente a prendere forma.

Più tempo trascorro osservando questo spazio, più un pensiero scomodo continua a tornare da me.

Le macchine stanno diventando più intelligenti ogni anno. Ma i sistemi che dovrebbero gestirle sembrano ancora impreparati.

I robot possono già muovere pacchi nei magazzini, scansionare colture nei campi, ispezionare edifici e navigare per le strade della città. Gli agenti AI possono analizzare i dati, coordinare la logistica e prendere decisioni più velocemente della maggior parte dei team umani.

Eppure qualcosa sulla struttura attorno a queste macchine continua a sembrare incompleta.

Non tecnicamente incompleto.

Strutturalmente incompleto.

Perché una volta che le macchine iniziano a partecipare all'attività economica reale, la domanda più importante non è più cosa possono fare.

La domanda diventa qualcosa di molto più umano.

Possiamo fidarci di ciò che hanno fatto?

Quella domanda porta più peso di quanto la maggior parte delle persone realizzi.

Immagina un robot che ispeziona attrezzature critiche all'interno di una fabbrica. Se riporta che tutto sembra sicuro e in seguito qualcosa fallisce, le persone non chiederanno quanto fosse avanzato il robot. Faranno una domanda molto più semplice.

Cosa è realmente successo?

Chi ha verificato il risultato?

Dove sono le prove?

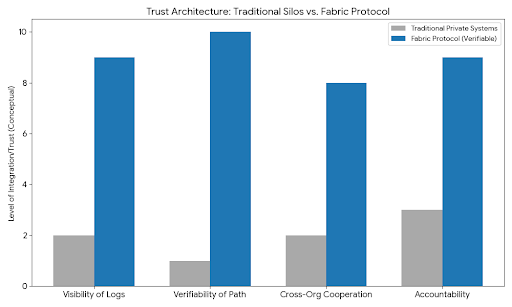

In questo momento, quelle risposte spesso vivono all'interno di sistemi privati di proprietà dell'azienda che ha costruito la macchina. I log sono conservati su server interni. I dati sono archiviati dietro infrastrutture aziendali. Se qualcosa va storto, gli esterni devono fidarsi di qualsiasi spiegazione venga fornita.

Quel modello funziona mentre le macchine rimangono strumenti isolati.

Ma nel momento in cui le macchine iniziano a interagire con diverse aziende, ambienti pubblici e infrastrutture condivise, quell'assunzione silenziosa inizia a sembrare fragile.

Questo è il punto in cui ho iniziato a prestare attenzione al Fabric Protocol.

Non perché promettesse qualcosa di più forte o futuristico rispetto ad altri progetti.

In realtà l'opposto.

Sembrava che qualcuno stesse lavorando silenziosamente su un problema che la maggior parte delle persone non aveva ancora pienamente riconosciuto.

Il livello di coordinamento per le macchine.

Più lo guardavo, più sembrava meno una piattaforma robotica e più un sistema progettato per aiutare il mondo a capire cosa stanno realmente facendo le macchine.

Quella differenza potrebbe sembrare piccola, ma emotivamente cambia tutto.

Perché la fiducia nelle macchine non derivarà dal credere che siano intelligenti.

La fiducia deriva dalla conoscenza che le loro azioni possono essere verificate.

Fabric affronta questa idea attraverso qualcosa chiamato calcolo verificabile. Invece di semplicemente produrre risultati, le macchine che operano all'interno del sistema possono generare prove su come quei risultati sono stati creati.

Non solo la risposta finale.

Il percorso che ha portato a questo.

Quella prova può essere ancorata a un registro pubblico dove diventa parte di una registrazione condivisa invece di un log privato.

Il momento in cui realmente ti fermi a riflettere su quell'idea, inizia a sembrare potente in un modo silenzioso.

Significa che quando un robot svolge un compito, la prova di quel compito non scompare all'interno di una singola organizzazione. Diventa qualcosa che altri partecipanti possono osservare e verificare.

Questo conta più di quanto la gente pensi.

Perché il mondo verso cui ci stiamo muovendo non sarà pieno di robot che lavorano da soli all'interno di spazi controllati.

Le macchine interagiranno con catene di approvvigionamento, sistemi di trasporto, edifici, infrastrutture finanziarie e altre macchine costruite da organizzazioni completamente diverse.

Ogni interazione crea un momento in cui la fiducia deve esistere tra parti che potrebbero non conoscersi.

Senza verifica condivisa, ognuna di quelle interazioni porta incertezza.

Con la verifica, l'interazione diventa qualcosa di più vicino alla cooperazione.

Un'altra cosa che ho notato mentre osservavo l'evoluzione del Fabric è il modo in cui tratta gli agenti autonomi.

La maggior parte dei sistemi digitali è stata progettata per gli esseri umani. I conti appartengono alle persone. Le interfacce sono costruite per l'attenzione umana. I permessi sono concessi attraverso l'identità umana.

Ma i robot e gli agenti AI non si comportano come gli esseri umani.

Non si collegano occasionalmente e svolgono un compito.

Operano costantemente.

Generano flussi di decisioni e dati ogni secondo.

Cercare di adattare quel comportamento in sistemi tradizionali spesso sembra scomodo. È come forzare un nuovo tipo di vita in un ambiente che non è mai stato progettato per esso.

Fabric sembra riconoscere quel cambiamento.

Invece di trattare le macchine come strumenti secondari, la rete consente loro di agire come partecipanti.

Gli agenti possono coordinare compiti. Possono verificare risultati. Possono interagire con altri agenti all'interno di una struttura in cui le regole esistono oltre qualsiasi singola azienda.

Quando penso all'economia robotica futura di cui si parla, questo dettaglio inizia a sembrare estremamente importante.

La vera trasformazione non deriverà da robot individuali che diventano brillanti.

Deriverà da reti di macchine che cooperano tra loro mentre gli esseri umani sovrintendono il sistema più ampio.

Quella cooperazione richiede qualcosa di più profondo dell'intelligenza.

Richiede infrastruttura condivisa.

Un altro dettaglio silenzioso che è rimasto con me è la struttura di governance dietro il protocollo. È supportata da una fondazione piuttosto che controllata da una singola corporazione.

Quella scelta cambia il tono emotivo del sistema.

Quando l'infrastruttura appartiene interamente a una compagnia, ogni partecipante si chiede inevitabilmente se le regole cambieranno per avvantaggiare quella compagnia.

Ma quando un sistema è costruito come una rete pubblica, gli incentivi sembrano diversi.

Le regole evolvono lentamente. A volte frustrantemente lentamente.

Ma evolvono attraverso la partecipazione piuttosto che la proprietà.

Per qualcosa di così sensibile come le macchine che operano attraverso industrie e ambienti pubblici, quella neutralità potrebbe contare più di quanto la gente realizzi in questo momento.

La parte strana di tutto ciò è quanto questi problemi siano ancora invisibili.

La maggior parte delle conversazioni attorno all'AI si concentra sulla capacità. La gente parla di modelli più intelligenti, robotica più veloce e automazione che sostituisce i lavori.

Quelle discussioni catturano l'attenzione perché sembrano drammatiche.

Ma la vera sfida vive silenziosamente da qualche parte più in profondità.

Come creiamo sistemi in cui le macchine possono agire nel mondo reale mentre gli esseri umani comprendono e si fidano ancora delle conseguenze di quelle azioni?

Più osservo come AI, robotica e infrastruttura decentralizzata stanno evolvendo insieme, più sento un cambiamento strano che sta avvenendo.

All'inizio il futuro sembrava essere definito da macchine intelligenti.

Ora sembra che potrebbe essere definito dalle reti che rendono quelle macchine responsabili nei confronti del mondo che le circonda.

E più mi siedo con quel pensiero, più realizzo che la tecnologia più importante dell'era dei robot potrebbe non essere le macchine stesse, ma i sistemi silenziosi che permettono a tutti gli altri di fidarsi di ciò che quelle macchine hanno realmente fatto.

\u003cm-63/\u003e \u003cc-65/\u003e \u003ct-67/\u003e