Sto aspettando e osservando le parti più tranquille del mondo delle criptovalute e dell'IA dove le vere idee di solito crescono prima che chiunque le noti. Sto guardando oltre l'eccitazione e gli annunci, cercando di capire quali problemi le persone stanno realmente cercando di risolvere. Nel tempo, ho notato qualcosa di strano. Più il settore diventa rumoroso, meno le persone sembrano parlare delle fondamenta su cui tutto dipende. Mi concentro sui momenti in cui un progetto sembra meno rumore e più come qualcuno che cerca silenziosamente di riparare qualcosa che è stato rotto per molto tempo.

La maggior parte delle conversazioni sull'intelligenza artificiale e sulla robotica ruotano attorno al progresso. Sistemi più veloci, modelli più intelligenti, macchine che possono vedere, sentire e comprendere il mondo meglio di quanto potessero ieri. E onestamente, alcuni di quegli avanzamenti sono incredibili. Guardare le macchine imparare a navigare negli spazi o comprendere il linguaggio porta ancora un senso di meraviglia.

Ma più a lungo osservo questo spazio, più sento una piccola tensione sotto tutto quel progresso.

Le macchine stanno migliorando, eppure i sistemi attorno a loro sembrano ancora fragili.

Un robot che si muove all'interno di un laboratorio o di un magazzino è una cosa. Opera all'interno di un ambiente controllato dove ogni variabile è conosciuta. Le persone che lo hanno costruito controllano anche i dati, le regole e la rete in cui vive. Quando qualcosa va storto, la stessa organizzazione possiede la spiegazione.

Ma il mondo reale non funziona in questo modo.

Le macchine stanno lentamente uscendo da quegli ambienti controllati. Robot di consegna che attraversano le strade. Sistemi automatizzati che lavorano attraverso le catene di approvvigionamento. Agenti AI che prendono decisioni che influenzano le imprese, i clienti e talvolta intere comunità.

Quando ciò accade, una domanda più profonda appare silenziosamente sullo sfondo.

Come possiamo fidarci di ciò che questi sistemi stanno facendo?

Non fiducia in senso emotivo, ma in senso pratico. Quando una macchina prende una decisione, chi può effettivamente verificare come è avvenuta quella decisione. Quando i dati si spostano tra i sistemi, chi può confermare che non siano stati alterati. Quando qualcosa va storto, chi può tracciare la catena di eventi abbastanza chiaramente da comprendere la verità.

Questo è dove ho iniziato a prestare attenzione al Fabric Protocol.

All'inizio l'ho affrontato con la stessa cautela che di solito sento quando sento parlare di nuove infrastrutture crypto. Lo spazio ha prodotto abbastanza promesse da rendere chiunque scettico. Grandi visioni sono facili da scrivere. Costruire qualcosa che risolve silenziosamente un problema difficile è molto più difficile.

Ma l'idea dietro Fabric continuava a richiamare la mia attenzione.

L'attenzione non è su rendere i robot più intelligenti. Si tratta di creare un ambiente in cui le macchine possano operare in un modo che le persone possono verificare e comprendere.

Quella differenza sembra sottile, ma porta un peso emotivo se ci pensi abbastanza a lungo.

Perché l'intelligenza senza responsabilità crea disagio. Le persone potrebbero ammirare ciò che le macchine possono fare, ma esitano quando quelle macchine iniziano a prendere decisioni che non possono essere spiegate.

Fabric affronta questo problema da una direzione diversa concentrandosi sul calcolo verificabile. Invece di chiedere alle persone di fidarsi semplicemente che un sistema si comporti correttamente, il sistema produce prove che possono essere controllate.

Immagina un robot che svolge un compito. Invece che quell'azione scompaia in un database privato da qualche parte, il calcolo e i dati che circondano quella decisione lasciano una traccia che può essere verificata in seguito. Il record diventa parte di un'infrastruttura condivisa dove i diversi partecipanti possono confermare cosa sia realmente accaduto.

C'è qualcosa di tranquillamente rassicurante in quell'idea.

Non perché prometta perfezione, ma perché rispetta il fatto che errori e disaccordi avverranno. La verifica offre alle persone un modo per risolvere quei momenti con prove anziché supposizioni.

L'uso di un registro pubblico in questo contesto sembra meno uno strumento finanziario e più una memoria condivisa. Un luogo dove azioni, dati e calcoli possono essere registrati in una forma che non appartiene a nessun singolo partecipante.

Una volta che quel livello esiste, le macchine iniziano a sembrare meno strumenti isolati e più partecipanti in un sistema che le persone possono osservare.

Quella svolta potrebbe sembrare tecnica, ma emotivamente cambia il rapporto tra umani e macchine.

In questo momento molti sistemi AI operano come scatole nere. Producono risposte, decisioni o azioni, ma il percorso che porta a quegli esiti spesso sembra nascosto. Quando i risultati sono corretti, le persone celebrano l'intelligenza. Quando i risultati sono sbagliati, appare confusione.

Fabric sembra esplorare un mondo in cui quei percorsi sono abbastanza visibili da verificare.

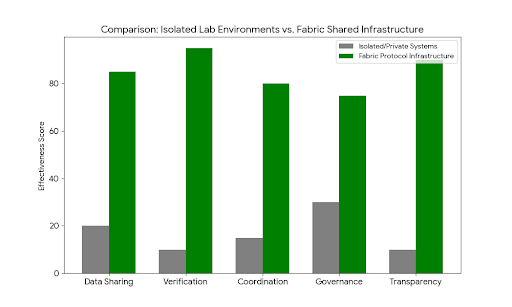

Un'altra cosa che continua a tornare nella mia mente è quanto sia stata frammentata lo sviluppo della robotica per anni. Diverse aziende costruiscono macchine che raramente comunicano tra loro. I dati rimangono all'interno di sistemi isolati. Ogni nuovo progetto inizia quasi da zero perché la conoscenza non può facilmente viaggiare tra gli ambienti.

Sembra inefficiente, quasi solitario in un senso tecnologico.

L'idea di un'infrastruttura condivisa in cui macchine, dati e calcoli possono coordinarsi inizia a attenuare quella frammentazione. Invece di isole isolate di innovazione, i sistemi potrebbero lentamente diventare pezzi connessi di una rete più ampia.

Quella possibilità porta un tranquillo senso di sollievo quando penso al futuro dell'automazione.

Perché il mondo in cui operano le macchine è già complesso. Città, reti logistiche, ospedali e fabbriche sono pieni di situazioni imprevedibili. Se ogni sistema robotico rimane isolato, l'attrito tra di loro crescerà solo.

Un'infrastruttura che consente la collaborazione potrebbe ridurre quell'attrito in modi che le persone potrebbero non notare immediatamente.

Fabric sembra anche affrontare la governance come parte del sistema piuttosto che qualcosa aggiunto in seguito. Quel dettaglio potrebbe sembrare tecnico, ma emotivamente affronta una delle paure più profonde che le persone hanno riguardo alla tecnologia autonoma.

La paura che le macchine operino senza regole chiare.

Se i meccanismi di governance esistono all'interno dell'infrastruttura stessa, le regole possono evolversi man mano che la tecnologia cambia. Comunità e partecipanti possono adattare il comportamento dei sistemi senza distruggere tutto e ricominciare da capo.

Crea la sensazione che il sistema sia vivo abbastanza da adattarsi.

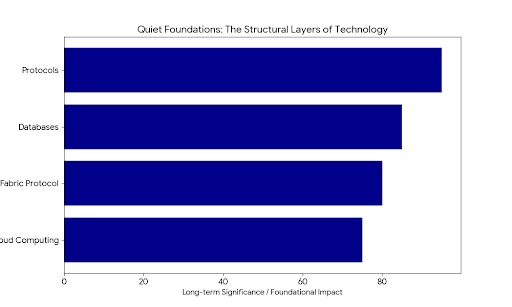

Più a lungo osservo gli sviluppi nell'IA e nella robotica, più mi rendo conto di qualcosa di importante. Le scoperte più significative raramente appaiono sotto i riflettori. Emergi silenziosamente negli strati di cui le persone parlano raramente.

I protocolli di comunicazione hanno costruito internet molto prima che esistessero i social media. I sistemi di database hanno plasmato il software moderno molto prima che le persone iniziassero a parlare di piattaforme cloud.

Il tessuto sembra appartenere a quella categoria più silenziosa.

Si tratta meno di creare dimostrazioni impressionanti e più di costruire le strutture invisibili di cui le future macchine potrebbero dipendere. Il tipo di infrastruttura che le persone riconoscono solo anni dopo quando si rendono conto che tutto ha iniziato a costruirsi sopra di essa.

E forse è per questo che continua a rimanere nella parte posteriore della mia mente.

Perché quando le macchine iniziano a condividere i nostri ambienti, a prendere decisioni e a coordinare compiti tra settori e città, l'intelligenza da sola non sarà sufficiente.

Ciò che le persone cercheranno davvero è la tranquilla fiducia che i sistemi che guidano quelle macchine possano effettivamente essere fidati.