@Mira - Trust Layer of AI #Mira $MIRA

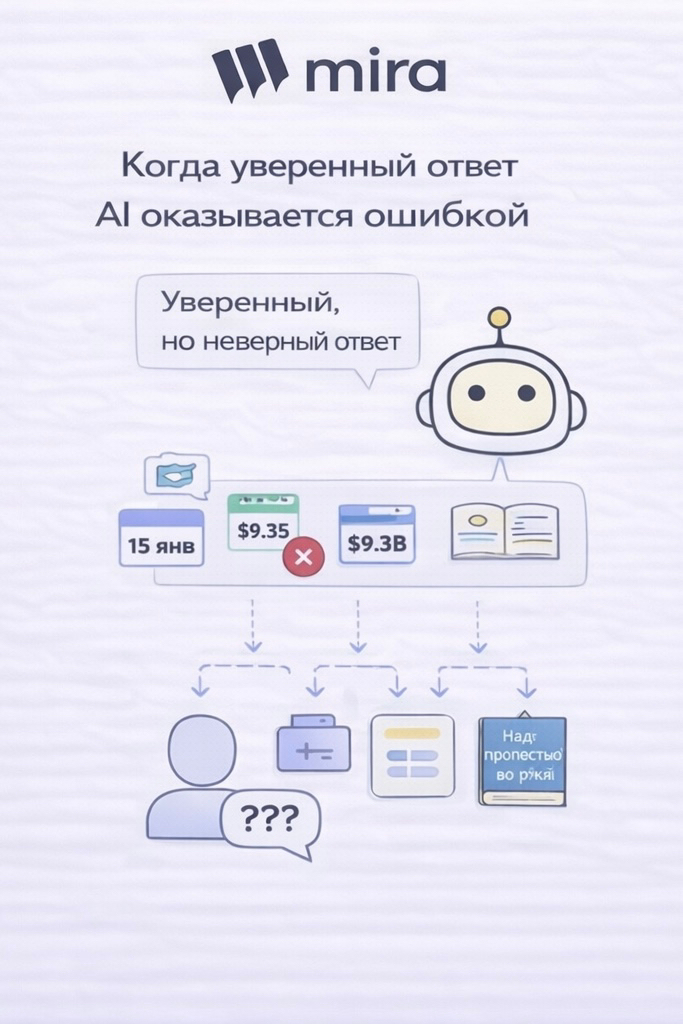

Я раньше доверяла уверенности AI. Если модель звучала убедительно и текст выглядел логично, казалось, что ответ можно принимать почти как факт.

Но однажды я поймала модель на ошибке. Это была не мелкая неточность, а конкретный факт, который звучал уверенно, но оказался выдуманным. В тот момент стало очевидно: когда AI отвечает, у пользователя почти нет способа понять, откуда именно появился этот вывод и что из него действительно проверено. Именно этот момент я снова вспомнила, когда начала разбираться в архитектуре @Mira - Trust Layer of AI .

Большинство AI-моделей генерируют ответ как единый поток текста. Он может выглядеть логично и убедительно, но внутри него часто скрываются десятки отдельных утверждений: даты, события, цифры, выводы. Если хотя бы одно из них неверно, весь ответ начинает терять надёжность.

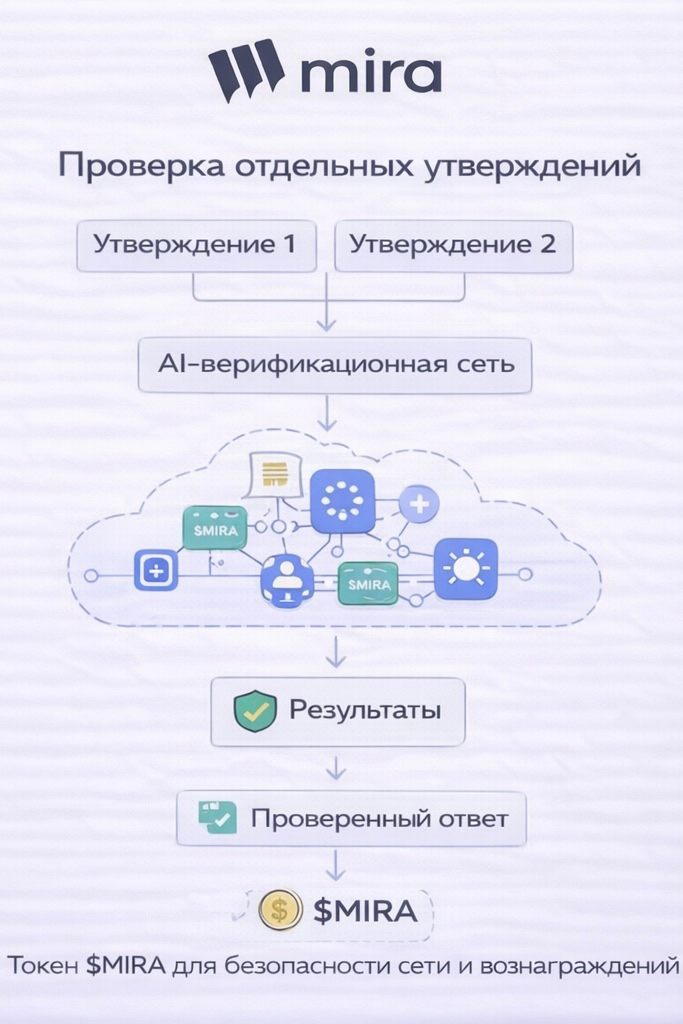

В архитектуре Mira такой текст сначала разбивается на отдельные claims, самостоятельные утверждения, которые можно проверять независимо друг от друга. После этого они отправляются на проверку в сеть. Несколько независимых моделей и участников оценивают их и формируют общий результат проверки. Этот механизм напоминает кворум. Итог зависит не от одной модели, а от согласия нескольких участников сети. Именно здесь появляется роль $MIRA. Участники, которые участвуют в проверке утверждений, используют токен для участия в сети и получают вознаграждения за точную валидацию. Экономическая модель сети напрямую связана с процессом проверки информации.

Когда смотришь на эту архитектуру, становится заметно, что Mira пытается изменить сам момент появления доверия к AI. Ответ модели перестаёт быть просто текстом и превращается в набор утверждений, которые проходят проверку через сеть.

И тогда возникает простой вопрос: если AI всё чаще участвует в реальных решениях, будет ли достаточно просто уверенного ответа, или будущим стандартом станет проверенный результат?