Il crescente problema di affidabilità nell'intelligenza artificiale

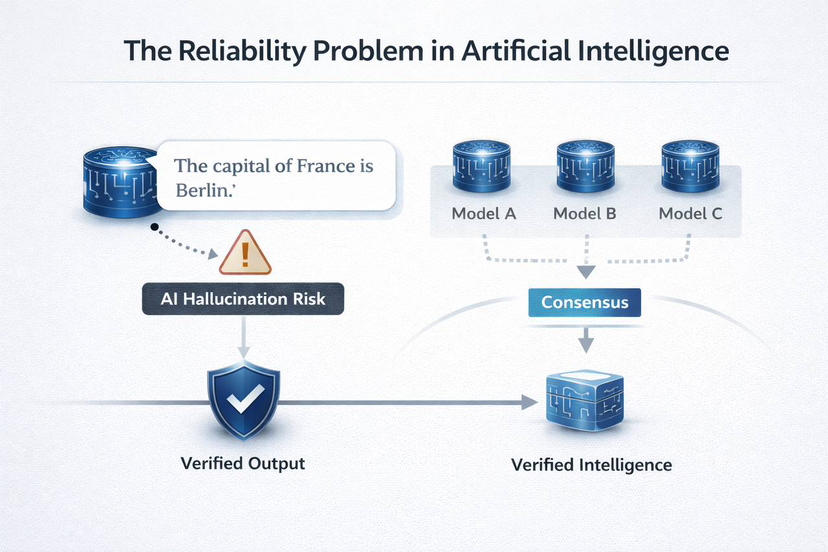

Negli ultimi anni ho notato qualcosa di interessante riguardo all'intelligenza artificiale. La tecnologia sta diventando incredibilmente potente, ma allo stesso tempo c'è un problema silenzioso di cui la maggior parte delle persone non parla abbastanza. L'IA può sembrare molto sicura anche quando ha torto. Chiunque abbia utilizzato strumenti di IA moderni ha probabilmente vissuto questa esperienza. Fai una domanda e il sistema fornisce una risposta chiara, a volte anche con spiegazioni e riferimenti. Ma poi ti rendi conto che una parte della risposta era errata.

Questo accade perché la maggior parte dei sistemi AI funziona prevedendo la parola successiva più probabile piuttosto che dimostrando fatti. Sono estremamente bravi a produrre un linguaggio che sembra corretto, ma ciò non significa che le informazioni siano sempre accurate. Questo problema è spesso chiamato “allucinazione AI.” Anche i modelli avanzati a volte producono informazioni sbagliate o di parte, il che li rende difficili da fidare in aree importanti come finanza, istruzione, sanità o legge.

Perché la verifica potrebbe contare più dell'intelligenza

Il concetto di Mira diventa più comprensibile una volta che consideri il modo in cui gli esseri umani confermano le informazioni. Nella scienza, è difficile credere a un'affermazione fatta da un individuo. L'affermazione viene messa alla prova da altri ricercatori, ricreando l'esperimento e verificando le prove. Non è fino a quando questa affermazione non viene dimostrata più e più volte che si trasforma in conoscenza accettata.

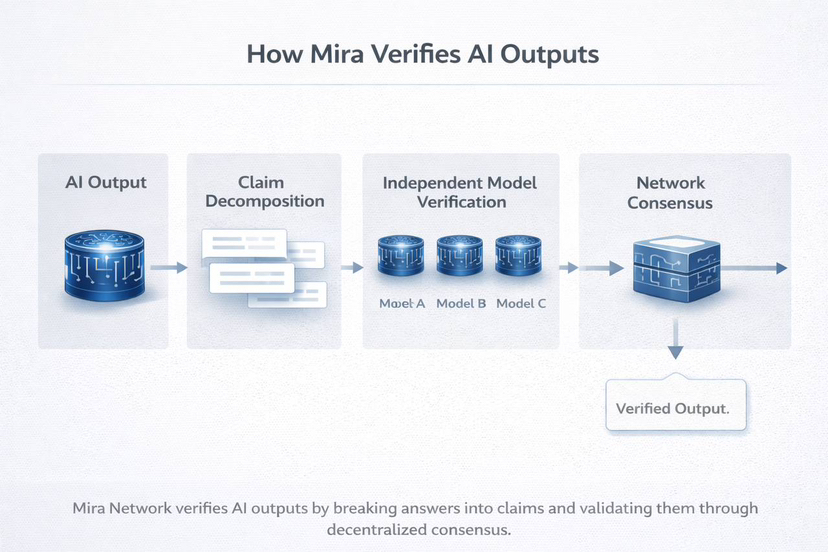

Mira cerca di trasferire un valore comparabile all'intelligenza artificiale. L'output di un singolo modello non è automaticamente fidato nella rete. Invece, scompone una risposta AI in affermazioni più piccole che possono essere verificate. Queste affermazioni vengono poi presentate a un numero di modelli indipendenti o nodi di verifica che le esaminano singolarmente.

Ciò che è interessante in questo design è che considera la verità come qualcosa che emerge dal consenso tra vari atteggiamenti, piuttosto che essere qualcosa di interpretato centralmente.

Lo scopo della decentralizzazione del sistema.

L'altro aspetto che rende Mira unica, secondo me, è il modo in cui è organizzata la sua verifica. La rete non si basa su un'unica azienda o server centralizzato per eseguire la verifica, ma piuttosto su un vasto numero di partecipanti indipendenti. Questi partecipanti eseguono vari modelli AI e reclami presentati alla rete.

Questa organizzazione decentralizzata è importante in quanto elimina le possibilità di favoritismi o manipolazione. Quando la verifica è effettuata da un'unica organizzazione, c'è la possibilità che possa essere di parte riguardo a quali risposte dovrebbero essere considerate accettabili. Tuttavia, una volta che il numero di validatori indipendenti è elevato, il risultato sarà più equilibrato.

In parole semplici, Mira sta cercando di stabilire un livello di fiducia con l'intelligenza artificiale.

Motivi che rendono il sistema onesto.

Gli incentivi sono una delle cose che non trascuro mai quando studio progetti crypto. La tecnologia è raramente sufficiente. Questi sistemi tendono a funzionare, poiché le persone sono punite se non agiscono in modo corretto.

Mira propone un sistema di incentivi token che motiva i validatori a presentare la verifica corretta. I portatori di interesse possono scommettere per unirsi alla rete e ricevere una ricompensa quando eseguono correttamente la verifica. Nel caso offrano una verifica negligente o falsa, parte del loro stake può essere persa.

Un altro approccio al pensiero dell'infrastruttura AI.

Meno considero Mira, più sembra essere un progetto infrastrutturale e non un altro token crypto. Non mira a creare un chatbot migliore o un modello più intelligente. Piuttosto, si preoccupa di qualcosa di più profondo: garantire che i risultati AI siano credibili.

Mira sta cercando il concetto che non è solo l'intelligenza a essere sufficiente. Ciò di cui abbiamo bisogno è l'intelligenza su cui possiamo fare affidamento.