C'è qualcosa di affascinante nel modo in cui l'intelligenza artificiale è entrata nelle nostre vite. Non è arrivata come un evento drammatico unico. È entrata nelle routine quotidiane silenziosamente e poi all'improvviso sembrava essere ovunque contemporaneamente. La usiamo per scrivere, cercare, riassumere, raccomandare, prevedere, tradurre, organizzare e sempre di più per guidare decisioni che un tempo richiedevano un giudizio umano diretto. La velocità è impressionante. La comodità è avvincente. I risultati spesso sembrano abbastanza rifiniti da far credere alle persone che la tecnologia sia già più affidabile di quanto non sia in realtà. È lì che inizia la conversazione più profonda.

La vera sfida con l'IA non è solo l'intelligenza. È la fiducia.

Un modello può produrre una risposta in secondi, e quella risposta può sembrare calma, fluida e convincente. Ma lo stile non è prova. La fiducia non è evidenza. La fluency non è verità. Questo è il divario che molte persone stanno solo ora iniziando a comprendere. L'intelligenza artificiale può essere utile e ancora sbagliata. Può essere efficiente e ancora inaffidabile. Può sembrare che sappia esattamente di cosa sta parlando mentre genera silenziosamente errori, distorsioni, mezze verità o uscite parziali. In situazioni informali questo può essere solo scomodo. In situazioni serie diventa pericoloso.

Immagina un futuro in cui l'IA è profondamente coinvolta nei sistemi finanziari, nei flussi di lavoro di ricerca, nelle revisioni legali, nella logistica, nelle macchine autonome, nel supporto sanitario, nell'istruzione, nell'intelligenza aziendale e nella governance digitale. In quel mondo la domanda non è più se l'IA sia potente. La vera domanda diventa se le sue uscite possano essere fidate abbastanza per agire. Questo è lo spazio esatto in cui @mira_network diventa interessante, perché non è costruito attorno alla semplice eccitazione di ciò che l'IA può produrre. È costruito attorno alla questione più difficile e importante di come le uscite dell'IA possano essere verificate.

Questo spostamento di focus è molto importante. La maggior parte delle conversazioni attorno all'IA ruotano ancora attorno a velocità, capacità, creatività, scala o prestazioni. Il modello comune è celebrare ciò che un modello può fare. Mira spinge la conversazione in un'altra direzione. Chiede cosa succede dopo che una risposta è generata. Tratta l'uscita non come una verità finale, ma come una rivendicazione. E una volta che qualcosa è trattato come una rivendicazione, il passo naturale successivo è la verifica.

Quell'idea sembra semplice, ma ha conseguenze importanti. Una rivendicazione può essere verificata. Una rivendicazione può essere contestata. Una rivendicazione può essere confrontata con altre valutazioni. Una rivendicazione può essere testata da più sistemi indipendenti invece di essere accettata semplicemente perché un modello l'ha prodotta con fiducia. In questo senso, Mira sta cercando di aggiungere uno strato di fiducia all'intelligenza artificiale. Sta cercando di creare una struttura in cui le uscite dell'IA non siano solo create, ma anche esaminate prima di essere utilizzate.

Questo è importante perché una delle maggiori debolezze nei sistemi IA attuali è che non distinguono naturalmente tra sembrare giusto ed essere giusto. Un errore lucidato è pur sempre un errore. Un'allucinazione sicura è comunque informazione falsa. Un errore formulato in modo bello può comunque fuorviare un utente, un'azienda, un decisore o un sistema automatizzato. Se il mondo continua a costruire sopra l'IA senza risolvere questo problema, allora la prossima fase di innovazione potrebbe essere costruita su terreni instabili.

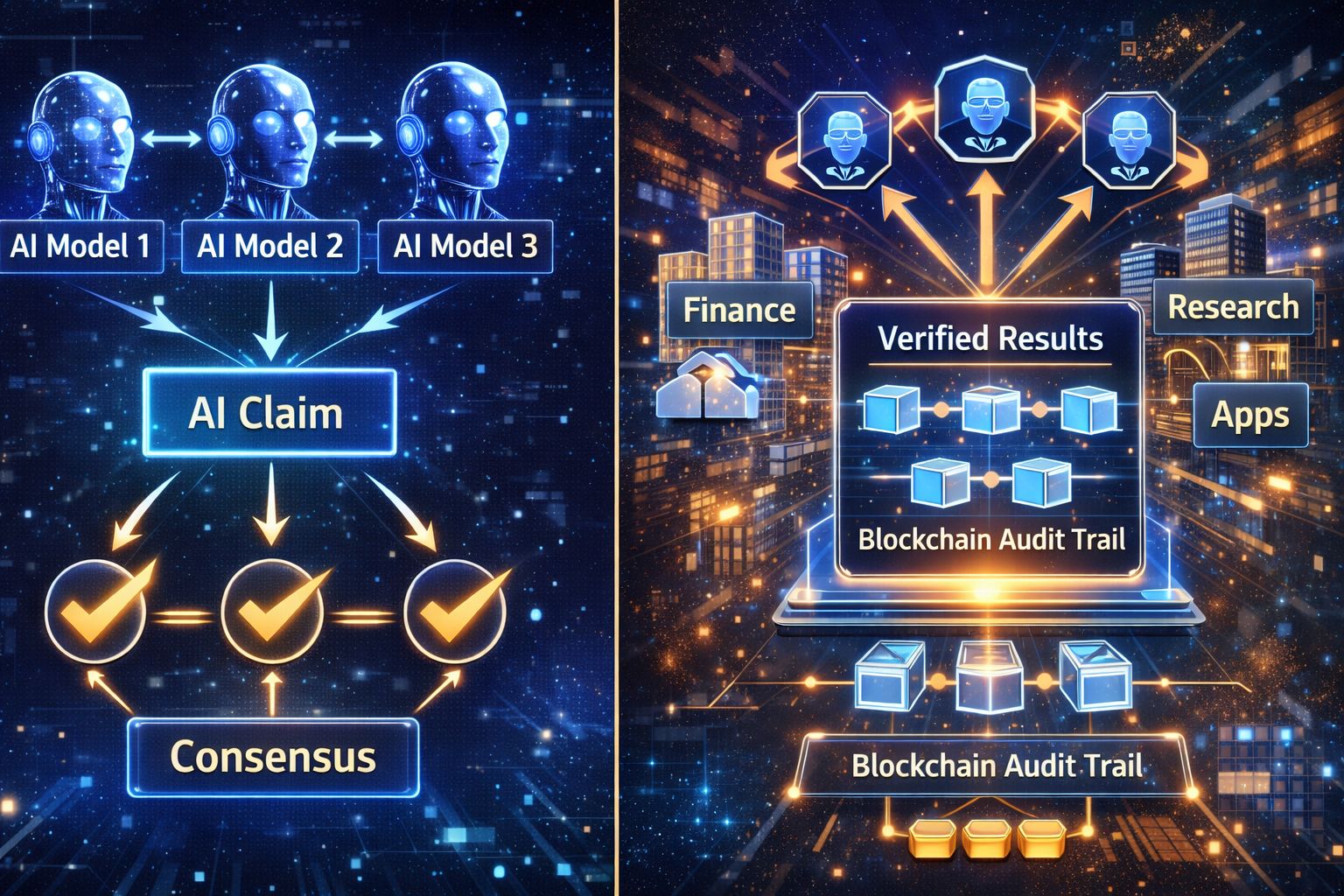

Mira Network offre una visione diversa. Invece di riporre cieca fiducia in un modello, utilizza più modelli IA indipendenti per esaminare la stessa rivendicazione. L'obiettivo non è dipendere da una singola fonte di giudizio della macchina. L'obiettivo è creare una maggiore affidabilità attraverso il confronto, la revisione e il consenso. Quando diversi modelli valutano la stessa uscita da angolazioni diverse, il risultato può diventare più affidabile di qualsiasi modello che lavori da solo. Questo crea qualcosa che sembra più vicino alla verifica che alla mera generazione.

Questa è una distinzione potente. La generazione crea contenuti. La verifica crea fiducia.

Quando le persone pensano alla fiducia, spesso la immaginano come un'emozione umana soft. Ma nei sistemi digitali, la fiducia può anche essere infrastruttura. Può essere regole, registri, incentivi, processi di validazione e registri trasparenti. Ecco perché la blockchain è importante nel design di Mira. Se i risultati della verifica sono registrati in modo trasparente, allora il processo diventa più verificabile. C'è una traccia visibile che mostra come il risultato è stato valutato, quale consenso è emerso e come la rete ha raggiunto la sua conclusione. Questo è molto diverso da un sistema chiuso a scatola nera dove gli utenti sono semplicemente invitati a credere a qualunque cosa esca.

La trasparenza è una delle parti più forti di questo concetto. In molti sistemi IA oggi, gli utenti ricevono una risposta con poca visibilità su quanto sia davvero affidabile. Possono vedere l'uscita finale, ma non il processo dietro l'uscita. La struttura di Mira punta verso un mondo in cui quel processo stesso diventa prezioso. La verifica non è più un lavoro di sfondo invisibile. Diventa parte del prodotto. Diventa qualcosa che le persone possono ispezionare, costruire e fidarsi più a fondo perché lascia un record.

Questo apre anche la porta alla responsabilità. Quando un sistema include verificatori, incentivi e risultati registrati, diventa più facile separare la validazione superficiale dalla partecipazione onesta. Quel livello di incentivo è importante perché i sistemi digitali non rimangono forti solo perché le persone sperano che lo siano. Rimangono forti quando il sistema premia l'accuratezza e scoraggia la disonestà. Attaccando valore alla corretta validazione, Mira non sta solo chiedendo alle macchine di cooperare. Sta chiedendo ai partecipanti dell'ecosistema di prendersi cura della correttezza.

Quest'idea potrebbe diventare più importante nel tempo di quanto la maggior parte delle persone realizzi oggi. La prossima fase dell'IA non riguarderà solo modelli più intelligenti. Riguarderà anche il coordinamento affidabile macchina-a-macchina, uscite fidate e sistemi che possono operare con meno supervisione umana diretta. Man mano che l'IA si espande in ambienti in cui le azioni hanno conseguenze, la verifica smette di essere un lusso. Inizia a sembrare una necessità.

Questo è uno dei motivi per cui $MIRA feels like more than a token attached to a narrative. Al suo meglio, rappresenta esposizione a una tesi più ampia. Quella tesi è che l'affidabilità diventerà uno degli strati più preziosi nell'economia dell'IA. Per anni le persone hanno gareggiato per costruire modelli più grandi, veloci e capaci. Ma la capacità senza fiducia ha dei limiti. Un modello può essere brillante, ma se nessuno può fare affidamento sulle sue uscite in situazioni importanti, allora la sua utilità rimane ristretta. La fiducia è ciò che consente all'intelligenza di passare da dimostrazioni interessanti a sistemi reali seri.

La bellezza di questa tesi è che è facile da capire una volta che si fa un passo indietro. Le istituzioni umane già funzionano in questo modo. La società non funziona solo su rivendicazioni grezze. Ci affidiamo a ricevute, audit, testimoni, sistemi di conformità, approvazioni, documentazione, controlli incrociati e standard. Non perché gli esseri umani siano incapaci di agire, ma perché la fiducia diventa più importante quando le scommesse aumentano. In molti modi, Mira sta cercando di costruire l'equivalente digitale di quella logica per l'intelligenza artificiale. Sta chiedendo perché dovremmo permettere all'IA di influenzare risultati importanti senza costruire un sistema serio per controllare se le sue rivendicazioni sono valide.

Un altro motivo per cui l'idea sembra forte è che supporta l'interoperabilità. L'intelligenza verificata non deve rimanere intrappolata in una piattaforma chiusa. Se una rete può produrre risultati di verifica fidati, allora quei risultati possono potenzialmente essere utilizzati in molti prodotti e servizi diversi. Gli sviluppatori potrebbero costruire applicazioni su uno strato di fiducia invece di dover creare la propria logica di verifica da zero ogni volta. Questo potrebbe essere utile nella ricerca, nella finanza, nell'automazione aziendale, nell'analisi, nei sistemi agenti, e in qualsiasi ambiente in cui l'affidabilità conta tanto quanto la velocità.

Questo crea un quadro più ampio attorno a Mira Network. Non si tratta solo di migliorare le risposte di un modello. Si tratta di aiutare a creare un'infrastruttura per un ecosistema IA più ampio in cui le uscite possono essere verificate, fidate e riutilizzate con maggiore fiducia. Questo sposta il progetto da essere solo un'altra narrazione dell'IA a qualcosa di più vicino a un middleware fondamentale per un'intelligenza affidabile.

Naturalmente, nessuna persona seria dovrebbe pretendere che la verifica risolva ogni sfida nell'IA da un giorno all'altro. Il futuro conterrà comunque dispute, incertezze, casi limite, comportamenti avversari e complessità tecnica. Ma questo non indebolisce l'idea centrale. Anzi, la rafforza. Più l'IA diventa difficile da governare, più i framework di verifica diventano preziosi. I sistemi progettati per la fiducia di solito contano di più quando l'ambiente diventa complesso, ad alta velocità e difficile da monitorare manualmente.

Questo è dove molte persone potrebbero sottovalutare il significato a lungo termine di progetti come @mira_network. I mercati spesso premiano prima i prodotti visibili e poi l'infrastruttura invisibile. Ma la storia mostra che gli strati di infrastruttura possono diventare estremamente preziosi una volta che l'ecosistema matura attorno a loro. Tutti si entusiasmano inizialmente per l'esperienza superficiale. Poi si rendono conto che i sistemi silenziosi sottostanti sono ciò che rende possibile la scala. Nel caso dell'IA, l'infrastruttura di fiducia potrebbe essere uno di quei sistemi silenziosi.

C'è anche qualcosa di psicologicamente potente in questa direzione. Le persone sono sempre più impressionate dall'IA, ma sono anche sempre più caute. Molti utenti hanno già avuto l'esperienza di vedere una risposta dell'IA che sembrava perfetta e si è rivelata errata. Quest'esperienza lascia un segno. Crea scetticismo. E lo scetticismo non è una debolezza in questo caso. È una risposta razionale a una tecnologia che continua a fare errori lucidi. I progetti che ottengono fiducia a lungo termine potrebbero non essere quelli che promettono le uscite più magiche. Potrebbero essere quelli che riconoscono il problema onestamente e costruiscono sistemi per ridurlo.

Ecco perché il messaggio più ampio di Mira sembra tempestivo. Non sta chiedendo al mondo di smettere di usare l'IA. Sta chiedendo al mondo di usare l'IA in modo più responsabile. Non sta attaccando la capacità. Sta cercando di proteggere la capacità dal diventare inaffidabile su larga scala. Questa è una differenza importante. La verifica non è contro l'innovazione. La verifica è ciò che rende l'innovazione più profonda più sicura da implementare.

Da una prospettiva ecosistemica, questo rende @mira_network degno di attenzione. Il progetto parla di un bisogno strutturale piuttosto che di una tendenza passeggera. Le narrazioni dell'IA vanno e vengono molto rapidamente, ma il problema dell'affidabilità è improbabile che scompaia. Se mai, diventerà più urgente man mano che i sistemi autonomi, gli agenti IA, i flussi di lavoro aziendali e le decisioni guidate dalle macchine diventano più comuni. Più influenza ha l'IA, maggiore sarà la pressione per dimostrare che le uscite sono affidabili. Quella pressione potrebbe creare una reale domanda per sistemi progettati attorno alla validazione e al consenso.

Visto attraverso questa lente, $MIRA becomes parte di un'idea più ampia riguardo alla prossima fase dell'infrastruttura IA. Il mercato ha già dimostrato di valutare il calcolo, i dati e le prestazioni dei modelli. Il prossimo strato che potrebbe iniziare a valutare più profondamente è la fiducia. Non fiducia come branding. Non fiducia come linguaggio di marketing. Fiducia come sistema tecnico ed economico. Fiducia come architettura. Fiducia come qualcosa di misurabile, verificabile e utile in tutte le applicazioni.

Alla fine, il motivo principale per cui quest'idea si distingue è che sembra realistica. L'intelligenza artificiale non ha bisogno di ulteriore hype quanto ha bisogno di fondamenta più solide. Il mondo sa già che l'IA può generare. Ciò di cui il mondo ha ancora bisogno è una risposta migliore alla domanda su quando quelle generazioni meritano fiducia. Mira Network sta cercando di costruire verso quella risposta.

E potrebbe essere per questo che la sua visione conta.

Il futuro dell'IA non sarà deciso solo da quale modello può parlare più velocemente o generare la risposta più lunga. Sarà anche plasmato da quali sistemi possono creare fiducia attorno alla veridicità di quelle risposte. Man mano che l'IA diventa più integrata nelle decisioni reali, l'affidabilità potrebbe diventare più preziosa della mera novità. In quel futuro, la verifica non è una funzione secondaria. È una delle fondamenta.

Questa è la promessa più profonda dietro @mira_network. Se l'intelligenza è il motore, la fiducia potrebbe essere lo strato che rende l'intera macchina utilizzabile su larga scala.

#Mira $MIRA @Mira - Trust Layer of AI