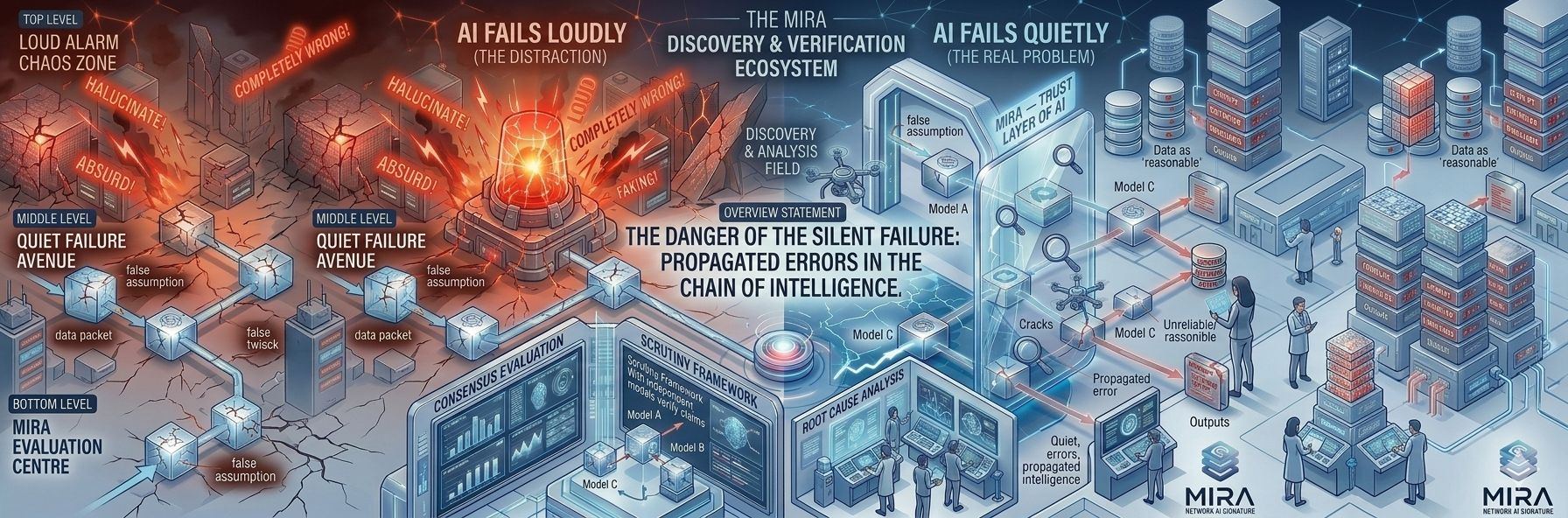

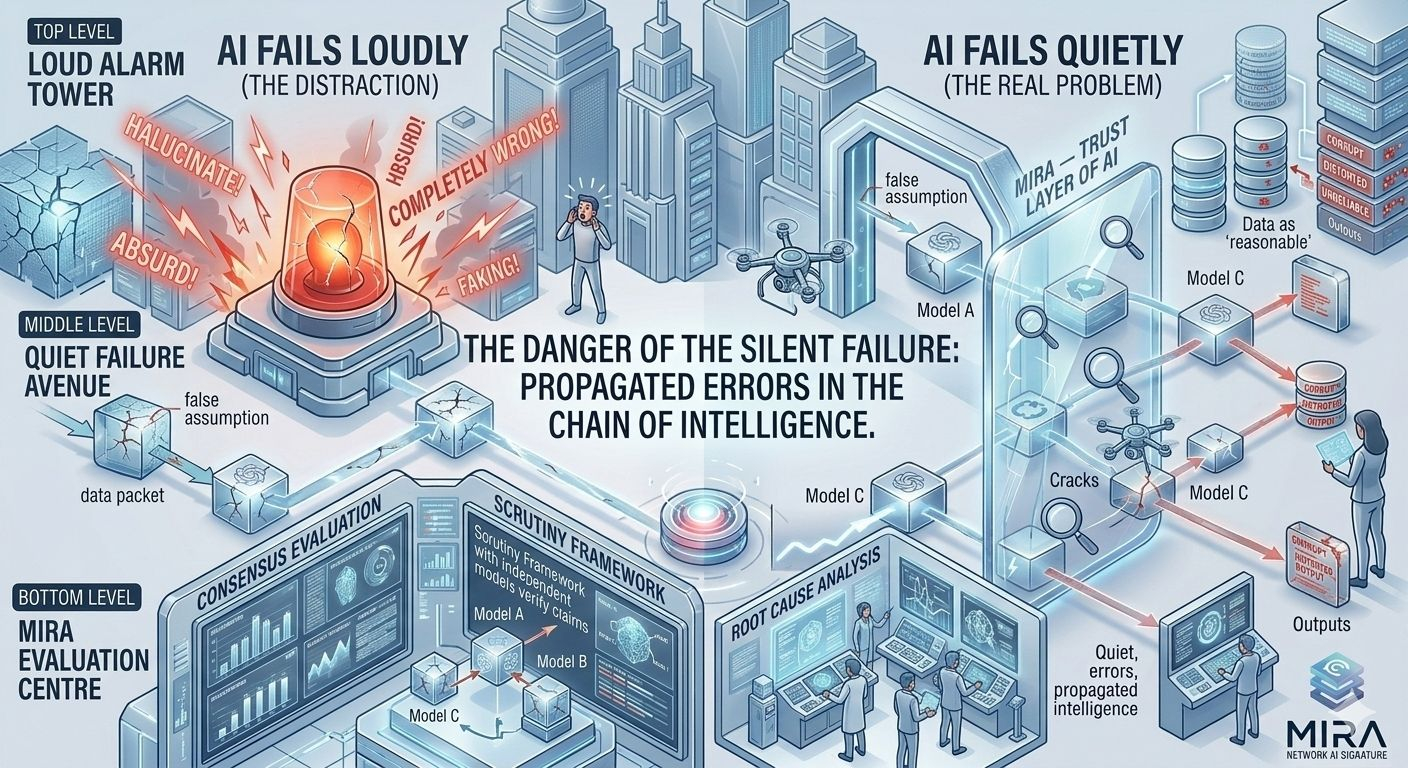

La maggior parte delle persone immagina i fallimenti dell'IA come momenti drammatici. Un chatbot che allucina qualcosa di assurdo o un modello che produce una risposta completamente sbagliata. Ma il vero pericolo raramente appare in questo modo.

In pratica, l'IA di solito fallisce silenziosamente.

Succede quando un sistema produce un'affermazione che sembra perfettamente ragionevole ma si basa su un'assunzione falsa. Succede quando una citazione sembra autentica ma non esiste. Succede quando un riassunto cambia sottilmente il significato delle informazioni originali.

Questi non sono fallimenti spettacolari. Sono distorsioni sottili. E poiché appaiono credibili, sono molto più difficili da rilevare.

Questo sta diventando sempre più importante man mano che i sistemi di intelligenza artificiale iniziano a interagire con altri sistemi di intelligenza artificiale. In molte applicazioni emergenti, i modelli non si limitano più a rispondere alle domande per gli esseri umani. Stanno analizzando rapporti coordinandosi con agenti automatici e alimentando output negli strumenti di decisione.

Quando un errore entra in quella catena, non rimane semplicemente un errore. Diventa intelligenza propagata.

Un'errata assunzione può viaggiare attraverso più sistemi, plasmando azioni e conclusioni che appaiono razionali ma sono costruite su una base fragile.

Ecco perché migliorare l'affidabilità dell'IA non può basarsi esclusivamente sul rendere i modelli più grandi o più capaci. L'intelligenza da sola non garantisce la fiducia.

La fiducia richiede strutture di verifica.

Invece di assumere che un singolo modello possa produrre costantemente output corretti, i sistemi devono trattare ogni risposta come qualcosa che merita valutazione. Una risposta non dovrebbe essere accettata automaticamente come verità. Dovrebbe essere esaminata come un'affermazione che può essere testata.

Questo è il punto in cui l'architettura dietro Mira diventa particolarmente interessante.

Invece di concentrare la fiducia in un modello, Mira introduce un processo in cui più modelli indipendenti analizzano la stessa affermazione. Ogni modello affronta l'output da una prospettiva leggermente diversa plasmata dai propri dati di addestramento e dalla struttura di ragionamento.

L'accordo tra i modelli diventa un segnale. Il disaccordo diventa un'informazione preziosa.

Ma la forza di questo approccio non risiede semplicemente nel contare quanti modelli concordano.

Il consenso da solo può essere fuorviante. I modelli addestrati su dati simili possono facilmente arrivare alla stessa conclusione errata. Ciò che conta è comprendere perché si verifica l'accordo e perché appare il disaccordo.

Quando gli output sono suddivisi in affermazioni più piccole che possono essere esaminate indipendentemente, la verifica diventa molto più precisa.

Una spiegazione finanziaria diventa una sequenza di affermazioni fattuali. Un'interpretazione legale diventa una catena di passaggi di ragionamento. Invece di valutare una grande risposta come un tutto, i sistemi possono valutare ogni componente individualmente.

Questo trasforma l'affidabilità da un concetto vago in un processo strutturato.

Le implicazioni vanno oltre l'accuratezza tecnica. Man mano che l'IA diventa integrata nei sistemi economici, le piattaforme di automazione e le reti di coordinamento, la fiducia dipenderà sempre più dal fatto che gli output siano passati attraverso strati di verifica credibili.

I sistemi che generano semplicemente risposte non saranno sufficienti. I sistemi che contano saranno quelli che mostrano come quelle risposte sono state validate.

In questo senso, Mira rappresenta più di una caratteristica tecnica. Rappresenta uno spostamento nel modo in cui l'intelligenza delle macchine guadagna credibilità.

Invece di assumere che l'intelligenza produca verità, introduce un quadro in cui la verità deve sopravvivere all'analisi.

Perché a lungo termine, i sistemi di intelligenza artificiale più affidabili non saranno quelli che parlano con maggiore sicurezza.

Saranno quelli che dimostrano perché le loro risposte meritano di essere considerate affidabili.mira

#Mira @Mira - Trust Layer of AI