$MIRA L'inconfort de l'intelligence artificielle

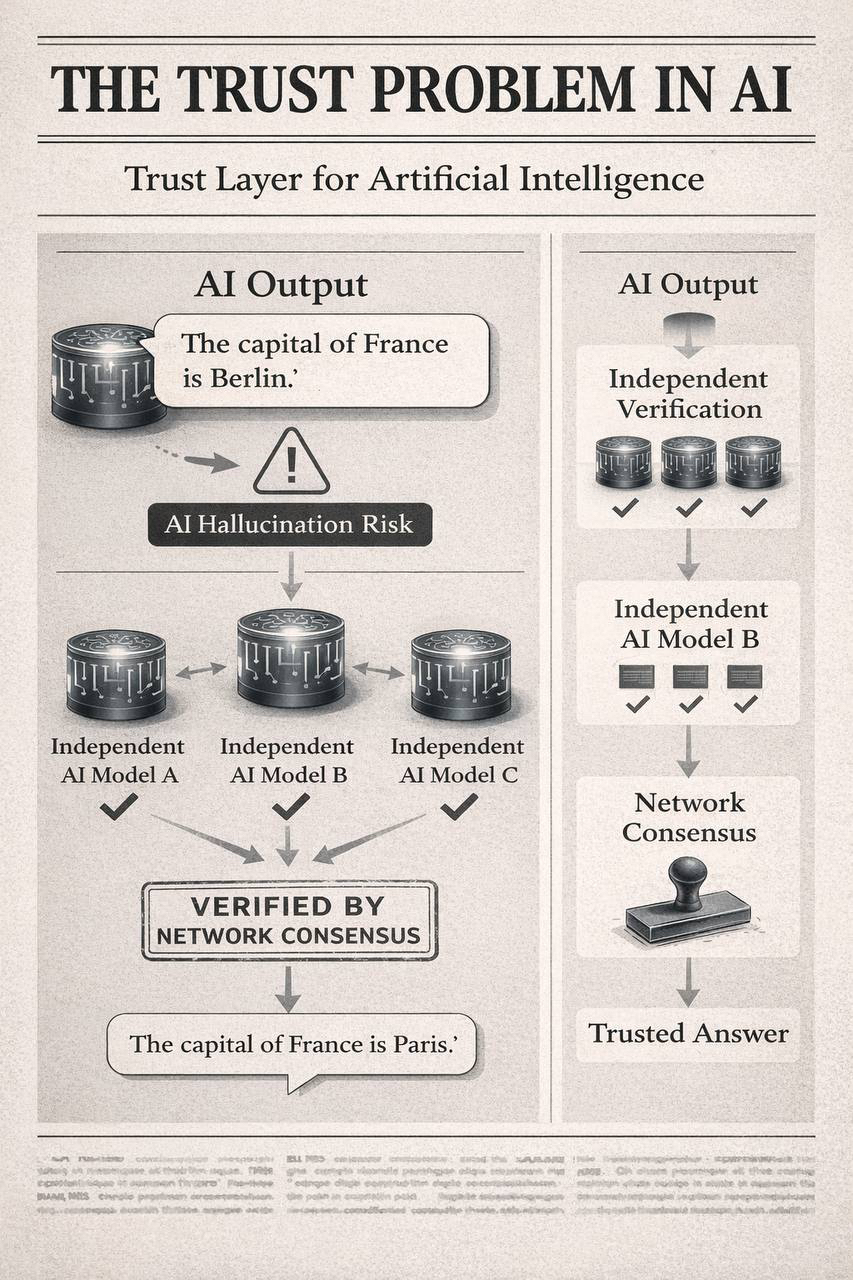

L'un des faits difficiles m'a fait regarder l'intelligence artificielle de plus près lorsque j'ai commencé à le faire. Les systèmes d'IA sont si sûrs mais pas nécessairement précis. Le modèle linguistique est capable de fournir une explication claire et de nommer des sources et d'organiser les arguments, cependant, il peut toujours se tromper en termes de faits simples. Ce problème est désigné sous le nom d'hallucination de l'IA et c'est l'une des raisons principales pour lesquelles l'IA n'est pas un outil de confiance dans d'autres cercles sérieux. Les systèmes ne sont pas applicables aux hôpitaux, aux tribunaux, aux marchés financiers et aux écoles qui composent parfois des informations. La technologie peut s'avérer puissante, cependant, lorsqu'elle n'est pas fiable, elle peut devenir risquée. Plus je lisais cela, plus je comprenais qu'il ne s'agit pas simplement de créer de meilleurs modèles. En effet, même les modèles les plus parfaits sont faillibles car ils sont probabilistes par nature. Au lieu de prouver, ils font des suppositions sur ce qu'ils pensent être éventuellement vrai. Donc, bien que le taux d'erreur puisse diminuer, il ne disparaît jamais. Et avec un milliard d'interactions d'IA chaque jour, vous pouvez déjà avoir un gros problème même avec un faible taux d'erreur.

C'est le point principal du concept de Mira.

Transformer les réponses de l'IA en une forme vérifiable.

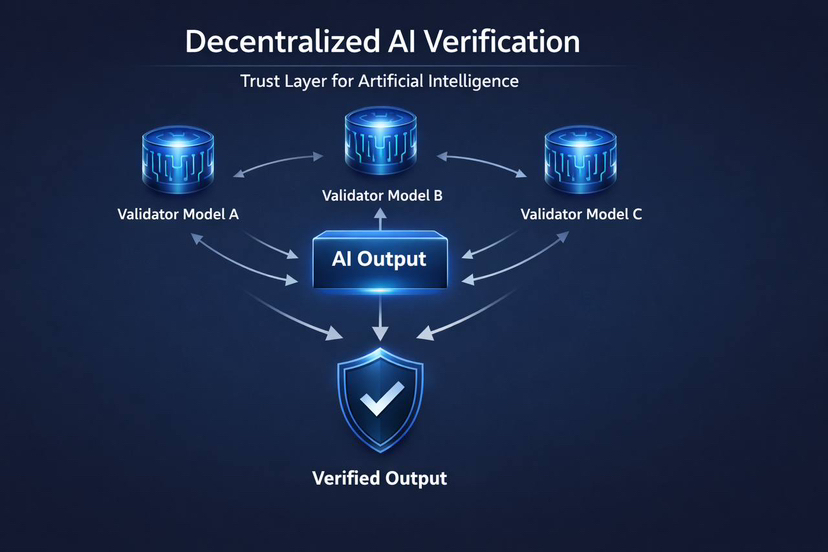

La chose la plus intéressante à propos de Mira, que j'ai remarquée, est qu'elle n'essaie pas de perfectionner un seul modèle d'IA. Au contraire, elle pose une autre question. Serait-il possible d'authentifier les résultats de l'IA comme les blockchains authentifient les transactions ? Mira considère toute sortie d'IA comme une déclaration qui ne doit pas être crue sans vérification. Plutôt que d'avoir un seul modèle, le système décompose une réponse en faits plus petits et présente les faits à un grand nombre de modèles ou de validateurs différents qui sont ensuite vérifiés indépendamment. Si un nombre suffisant de vérificateurs indépendants confirment que l'affirmation est correcte, le système l'accepte. En cas de désaccord, la réponse est rejetée ou recréée. Ce concept est comparable au fonctionnement de la science. La science n'accepte pas l'affirmation faite par un individu. Elle est crue car d'autres personnes la mettent à l'épreuve et vérifient les résultats. Mira tente d'appliquer le même principe aux sorties d'IA. L'aspect intrigant est que cette vérification est effectuée dans un réseau décentralisé plutôt que par une entreprise centrale.

L'importance de la décentralisation dans la vérification de l'IA.

Lorsque la majorité de la population mentionne le mot blockchain, elle imagine de l'argent. Cependant, il s'agit de quelque chose de plus profond avec les blockchains : l'accord distribué. Ils ne doivent pas compter sur une seule autorité pour décider de ce qui est vrai en permettant à de nombreux participants indépendants. Mira utilise ce concept sur l'intelligence artificielle. Le réseau décentralise la vérification, au lieu de s'appuyer sur un seul modèle d'IA, ou sur l'évaluation d'une seule entreprise, le réseau est disséminé parmi de nombreux participants et modèles. Tous les validateurs vérifient qu'une affirmation est correcte et un consensus est atteint dans le réseau. Ce que je trouve intéressant dans ce design, c'est qu'il altère la position de l'IA en tant que telle. Dans les modèles conventionnels, l'IA propose des réponses et les utilisateurs doivent choisir de les croire. Dans l'approche de Mira, l'IA est aussi le créateur et l'auditeur. Le travail de divers modèles est vérifié.

La couche d'économie en l'absence de vérification.

Naturellement, la vérification ne se fait pas gratuitement. Mira propose un schéma d'incitation basé sur des jetons pour permettre aux parties prenantes du réseau de déposer des jetons et d'être récompensées si elles vérifient les sorties de l'IA de manière honnête. Les validateurs peuvent, d'une part, perdre une partie de leur mise s'ils fournissent une vérification incorrecte ou se comportent de manière malveillante. Ce système économique est significatif car il coordonne les incitations. Les validateurs ne sont pas récompensés pour la rapidité et le coût de production des réponses. Idéalement, cela crée un marché dans lequel la fiabilité est appréciable.

La chose qui me semble spécifique à cela est que ce qui est fait sur le réseau a un but. Divers systèmes de preuve de travail tels que le minage de blockchain précoce ont des ordinateurs calculant des énigmes qui ne sont jamais utiles. Dans l'exemple de Mira, les informations générées par les systèmes d'IA sont vérifiées par le travail computationnel. C'est-à-dire que l'efficacité de la connaissance numérique est directement améliorée par le travail du réseau.

Une autre base possible de l'IA autonome.

J'ai commencé à avoir une vision plus large de cela. Dans le cas où les résultats de l'IA sont fiables, les systèmes d'IA peuvent commencer à fonctionner de manière plus indépendante. Pour le moment, la plupart des flux de travail d'IA sont surveillés par des personnes. Des individus vérifient les résultats, apportent des corrections et vérifient les sorties. Cependant, si la présence d'une couche de vérification décentralisée est capable de fournir une assurance crédible concernant le raisonnement de l'IA, une réduction de la nécessité d'avoir une supervision humaine à tout moment pourrait se produire. Cela pourrait permettre à l'IA d'être utilisée dans des zones où elle doit être fiable. Les sorties vérifiées seraient utiles dans l'analyse financière, la recherche juridique, la rédaction académique et les outils de soutien médical.

Cela ne veut pas dire que Mira résout le problème de fiabilité de l'IA. Même dans les systèmes de vérification, il peut y avoir des défauts. Ils dépendent de la qualité des validateurs, des incitations économiques et de la conception du système. Cependant, le concept d'avoir une couche de confiance au-dessus de l'IA est une idée puissante. La partie la plus intrigante que j'ai finalement apprise sur Mira est qu'elle ne considère pas la fiabilité de l'IA comme un problème technique mais comme un problème de coordination. Plutôt que d'essayer de développer un modèle idéalisé, elle développe un système dans lequel un grand nombre de modèles défectueux peuvent se vérifier mutuellement leurs résultats. Le système présuppose la survenue d'erreurs, cependant, il tente de créer un système dans lequel les erreurs peuvent être traquées avant qu'elles ne contaminent. Le succès ou l'échec du réseau mis à part, le concept qui le sous-tend pose une question significative. Les systèmes d'IA qui produisent des réponses ne seront peut-être pas les plus importants à l'avenir. Ils pourraient être les systèmes qui les authentifient.

#Mira @Mira - Trust Layer of AI #MİRA