$ROBO #ROBO @Fabric Foundation

Quando le persone parlano di robotica, la conversazione si concentra quasi sempre sulle capacità. Macchine più veloci, sensori più intelligenti, modelli di IA migliori. Ma ultimamente ho pensato a una domanda diversa che non viene discussa abbastanza.

Cosa succede quando un robot commette un errore?

Sembra semplice, ma una volta che i robot iniziano a svolgere compiti economici reali, quella domanda diventa sorprendentemente complicata.

Immagina un robot di consegna che fa cadere attrezzature costose. O un robot di magazzino che danneggia l'inventario. O una macchina industriale che interpreta male un comando e interrompe una linea di produzione.

Qualcuno deve assumersi la responsabilità di quel risultato.

In questo momento, la risposta di solito si riduce a un mix di operatori, produttori e sviluppatori di software. Ma man mano che i robot diventano più autonomi, tale responsabilità diventa più difficile da tracciare. La macchina può aver agito sulla base di molteplici input, decisioni automatizzate e fonti di dati esterne.

È lì che ho iniziato a vedere l'importanza di ciò che m-71 sta cercando di costruire.

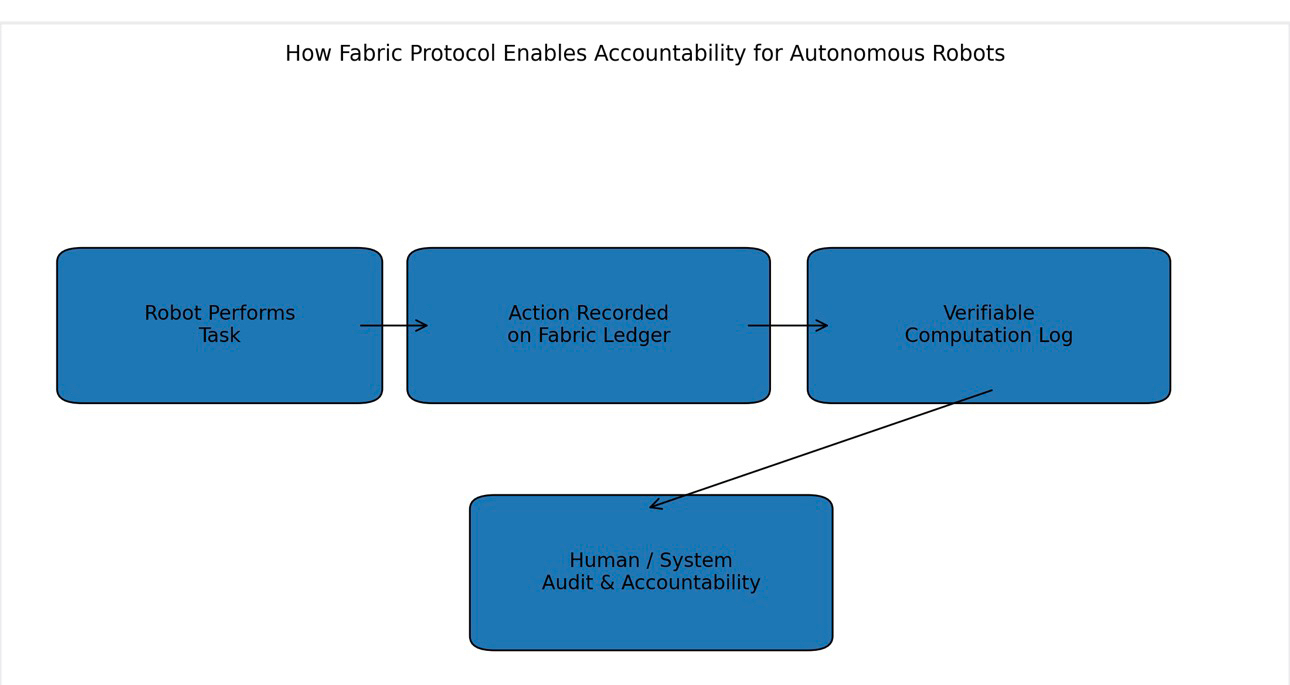

Fabric è progettato come una rete aperta in cui i robot possono operare attraverso computazione verificabile e infrastruttura coordinata. A prima vista sembra un sistema per connettere le macchine e permettere loro di collaborare. Ma più ci penso, più vedo un altro strato sottostante.

Responsabilità.

Se un robot esegue un lavoro su una rete pubblica, le sue azioni non dovrebbero scomparire in una scatola nera. Deve esserci un registro di ciò che è successo, come è successo e quale sistema lo ha autorizzato.

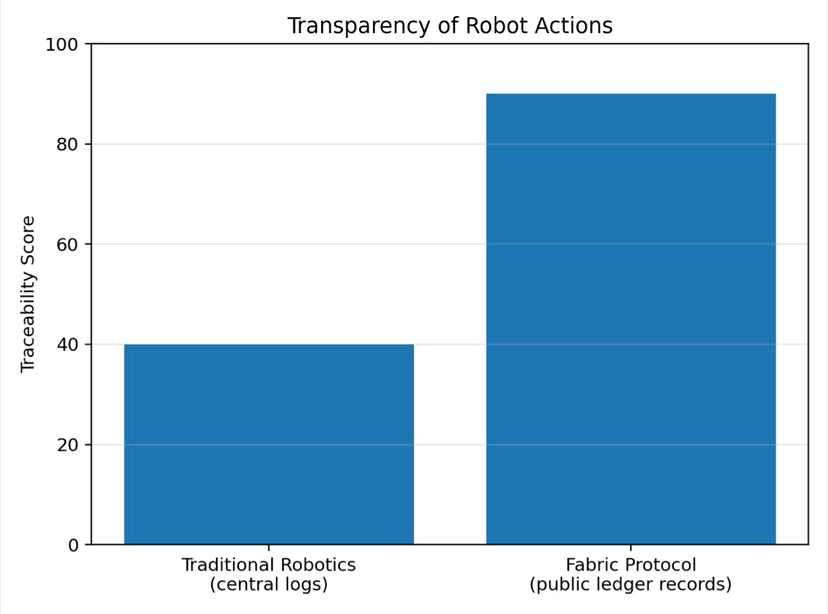

Fabric affronta questo problema coordinando l'attività dei robot attraverso un libro mastro pubblico. Ogni interazione, computazione o evento di coordinamento può essere registrato e verificato. Ciò significa che le azioni non sono solo eseguite; sono tracciabili.

E la tracciabilità cambia tutto.

Invece di discutere su cosa potrebbe essere successo all'interno del sistema decisionale di un robot, la rete stessa diventa una fonte di verità. Esiste un registro che mostra quali istruzioni sono state emesse, quali dati sono stati utilizzati e come la macchina ha risposto.

In altre parole, il sistema passa dalla fiducia alla verifica.

Quando penso a questa idea in termini pratici, sembra un pezzo mancante nella conversazione sull'automazione. Trascorriamo così tanto tempo a celebrare ciò che i robot possono fare che dimentichiamo di chiedere come quelle azioni saranno governate una volta che diventeranno parte dell'attività economica quotidiana.

Perché una volta che le macchine iniziano a svolgere compiti nei mercati, le poste aumentano. I robot possono gestire logistica, manutenzione, produzione e persino ruoli di supporto decisionale. A quel punto, l'affidabilità da sola non è sufficiente. Deve esserci un meccanismo che consenta a esseri umani e istituzioni di comprendere cosa è successo quando qualcosa va storto.

L'infrastruttura di Fabric è interessante proprio perché affronta direttamente questa questione.

Combinando la computazione verificabile con un libro mastro condiviso, il protocollo crea un quadro in cui le azioni robotiche possono essere auditate. Questo non impedisce alle macchine di fare errori, ma assicura che quegli errori siano visibili e spiegabili.

E la visibilità è importante.

Pensa a come si sono evoluti i sistemi finanziari. La banca moderna funziona non solo perché avvengono transazioni, ma perché le transazioni sono registrate, auditate e regolate. Lo stesso principio potrebbe alla fine applicarsi alle macchine autonome.

I robot che svolgono lavoro economico avranno bisogno di registri trasparenti di attività.

Senza quella trasparenza, la fiducia diventa fragile.

Con esso, la collaborazione diventa possibile.

Questo è il motivo per cui il concetto dietro il Fabric Protocol continua a tornare a un'idea centrale: il coordinamento tra umani e macchine ha bisogno di struttura. Non è sufficiente che i robot siano intelligenti o efficienti. Devono anche operare all'interno di sistemi in cui il loro comportamento possa essere verificato.

Dal mio punto di vista, è quello che rende la questione della responsabilità così importante.

La vera sfida nella robotica potrebbe non essere costruire macchine più intelligenti. Potrebbe essere costruire reti in cui quelle macchine possano agire in modo responsabile all'interno di un ambiente economico aperto.

E se l'economia robotica diventa mai reale, i sistemi che risolvono il problema della responsabilità probabilmente saranno più importanti di qualsiasi design di robot singolo.