Ieri stavo testando di nuovo alcuni prompt dell'IA mentre lavoravo su alcune ricerche e una risposta sembrava perfetta all'inizio. Spiegazione chiara, tono sicuro, anche un riferimento alla fine.

Poi ho provato ad aprire la fonte.

La citazione non esisteva.

Non ovviamente falso… solo leggermente sbagliato. E questa è la parte che mi disturba dell'IA in questo momento. È incredibilmente brava a sembrare corretta anche quando l'informazione è un po' imprecisa.

Questo è fondamentalmente il problema attorno al quale è costruito “Mira Network”.

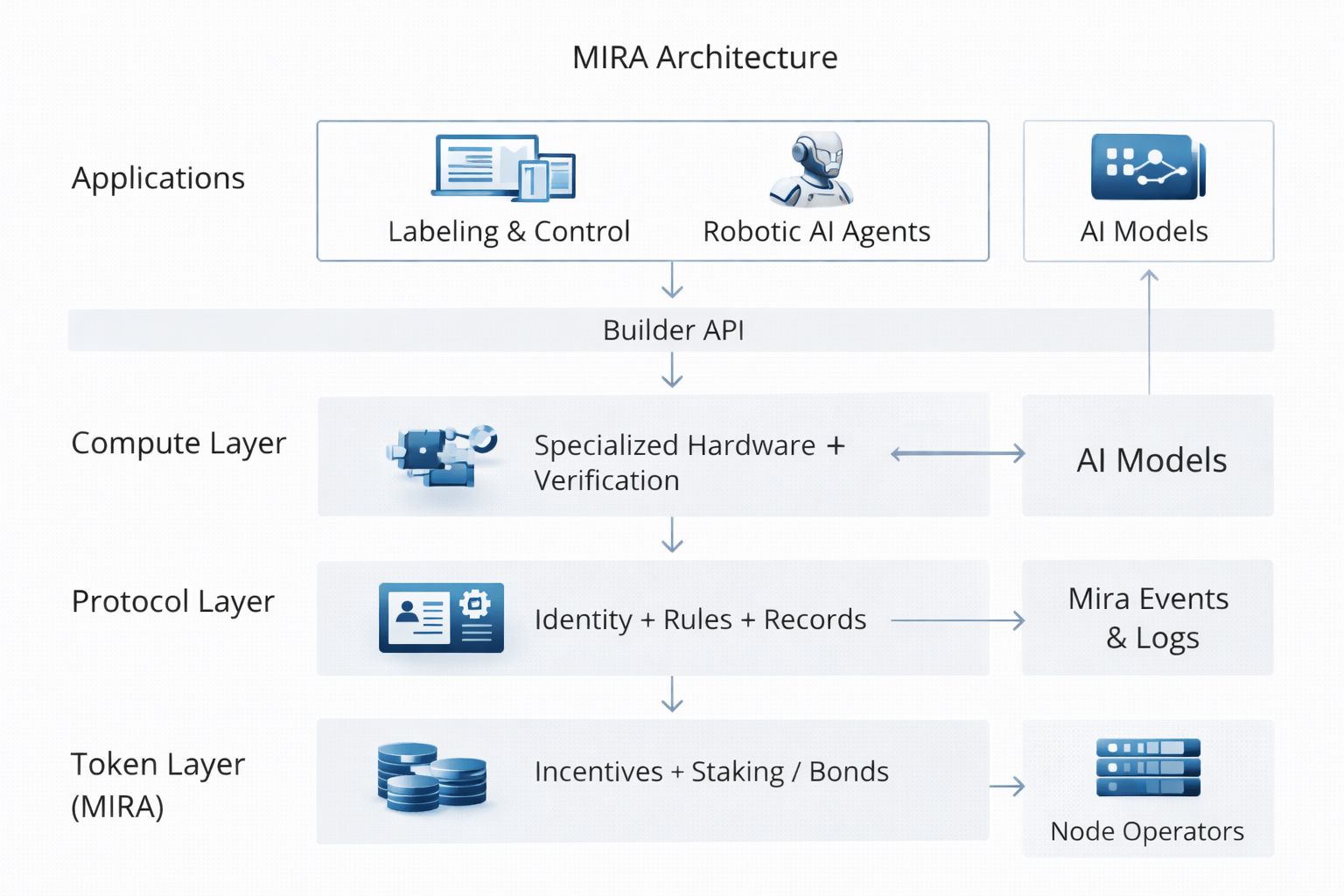

La maggior parte dei progetti di IA si concentra sul rendere i modelli più intelligenti. Modelli più grandi, più parametri, migliori set di dati per l'addestramento. Ma Mira adotta un angolo diverso. Invece di assumere che i modelli diventeranno eventualmente perfetti, si concentra su “verificare i risultati prodotti da quei modelli”.

E onestamente… quell'approccio sembra più realistico.

Il modo in cui Mira funziona è in realtà piuttosto interessante. Quando un'IA genera una risposta, il protocollo non tratta la risposta come un blocco unico di informazioni. Invece, scompone l'output in “affermazioni individuali”.

Una statistica.

Una dichiarazione.

Un riferimento.

Ogni affermazione può essere quindi controllata separatamente.

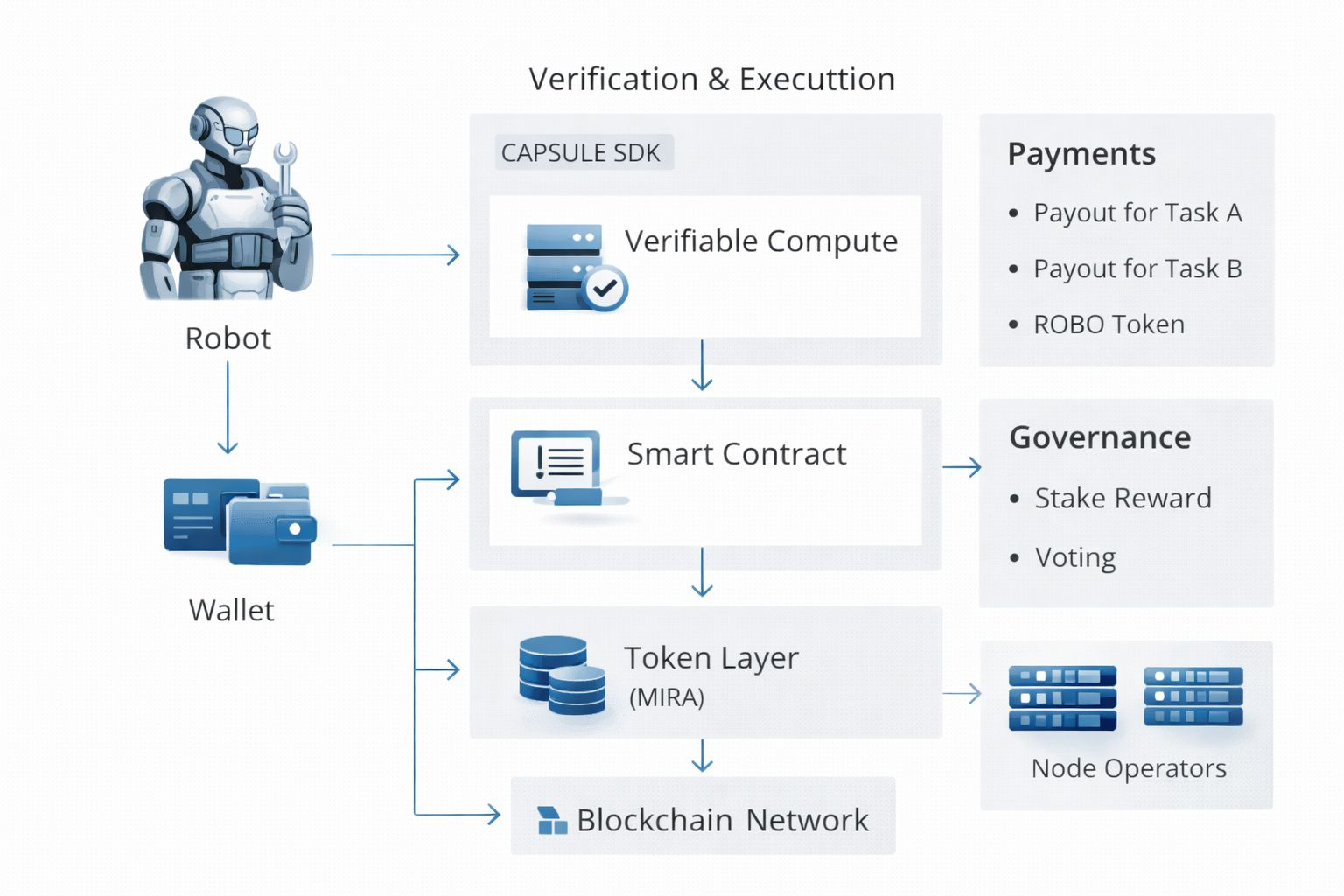

Quelle affermazioni sono distribuite attraverso una rete di validatori. Alcuni validatori potrebbero essere altri modelli di IA. Altri possono essere sistemi progettati specificamente per valutare determinati tipi di informazioni.

Invece di fidarsi di un modello, la rete cerca “accordo tra più validatori”.

Se abbastanza sistemi indipendenti confermano lo stesso risultato, quella affermazione diventa verificata e registrata attraverso il consenso della blockchain.

Quella piccola modifica sposta completamente il modello di fiducia attorno all'IA.

In questo momento, quando leggiamo una risposta dell'IA, stiamo sostanzialmente agendo come il livello di verifica noi stessi. Apriamo schede extra, confrontiamo risposte, ricontrolliamo numeri.

Mira sposta quel processo “nel protocollo”.

I validatori sono incentivati a verificare le affermazioni con attenzione. Una corretta validazione può guadagnare ricompense. Una validazione errata può portare a penalità.

Quindi, nel tempo, il sistema trasforma gli output dell'IA in qualcosa di più vicino a “informazioni verificabili invece di congetture sicure”.

Ciò che rende questa idea interessante per me è dove sembra andare l'IA successivamente.

Oggi l'IA agisce principalmente come un assistente. Leggi la risposta e decidi cosa fare. Ma nuovi agenti IA stanno già iniziando ad automatizzare compiti in finanza, analisi dei dati e infrastruttura digitale.

Se quei sistemi iniziano a prendere decisioni automaticamente, anche piccoli errori possono contare molto di più.

Ecco perché la verifica potrebbe finire per essere altrettanto importante quanto l'intelligenza.

La tesi di Mira è fondamentalmente questa: l'IA continuerà a generare informazioni, ma una rete decentralizzata dovrebbe decidere se quelle informazioni possono effettivamente essere fidate.

E onestamente, dopo aver visto un'altra falsa citazione ieri… quell'idea sembra improvvisamente molto più necessaria.