Ho notato qualcosa dopo aver lavorato con i sistemi di intelligenza artificiale per un po'. Le persone raramente mettono in discussione le risposte che arrivano rapidamente e sembrano sicure. Succede ovunque. Qualcuno chiede a un modello riguardo a un evento storico, a un argomento medico, o anche a qualcosa di banale come quanti satelliti orbitano attorno alla Terra. La risposta appare istantaneamente, scritta in paragrafi puliti, spesso con riferimenti. La maggior parte dei lettori presume che sia affidabile.

E di solito… è così.

Ma non sempre.

Ricordo di aver testato un modello di intelligenza artificiale mesi fa mentre ricercavo un argomento tecnico. La spiegazione sembrava perfetta a prima vista. Linguaggio fluido. Flusso logico. Alcune citazioni sparse. Solo dopo aver approfondito mi sono reso conto che una delle affermazioni fondamentali era semplicemente sbagliata. Non in modo malevolo. Solo… incorrettamente sicuro.

Quel momento è rimasto impresso in me. Non perché il modello abbia fallito. I modelli falliscono sempre. Ciò che è rimasto in me è stato quanto facilmente l'errore avrebbe potuto diffondersi se nessuno lo avesse controllato.

Questa è la parte scomoda dei moderni sistemi di intelligenza artificiale. Generano informazioni estremamente bene. Ma la generazione non è la stessa cosa della verifica.

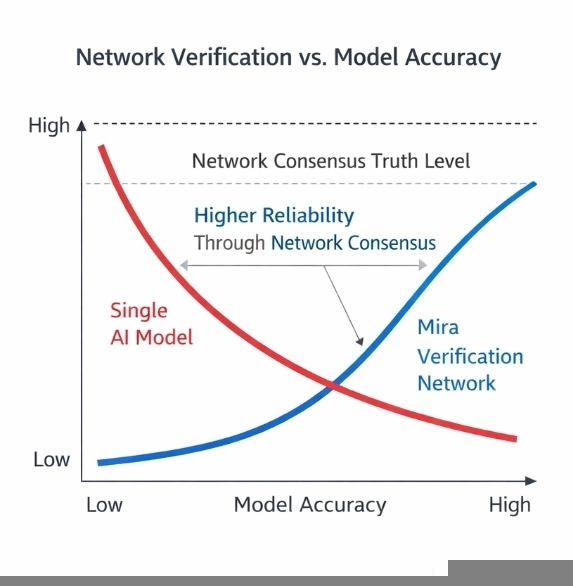

Per anni l'industria ha cercato di colmare quel divario migliorando i modelli stessi. Dataset più grandi, migliore apprendimento per rinforzo, benchmark più forti. Ogni miglioramento ha aiutato un po'. Eppure la struttura sottostante è rimasta la stessa: un sistema produce la risposta e gli utenti decidono se fidarsi di essa.

Più ci penso, più quella configurazione sembra fragile.

Perché l'affidabilità potrebbe non essere qualcosa che un singolo modello può garantire completamente.

Qui è dove la filosofia di design dietro Mira Network diventa interessante. Invece di chiedere a un modello di dimostrare la propria accuratezza, il sistema assume qualcosa di diverso fin dall'inizio: la verità potrebbe dover emergere da una rete piuttosto che da una singola macchina.

All'inizio quell'idea suona teorica. Ma la meccanica è in realtà piuttosto pratica.

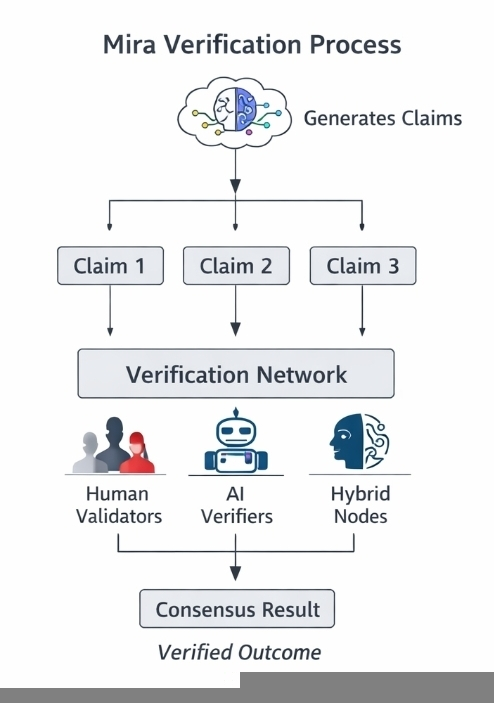

Immagina un modello di intelligenza artificiale che risponde a una domanda complessa. Invece di trattare l'output come una risposta finita, il sistema lo separa in affermazioni più piccole. Ogni affermazione diventa qualcosa che può essere valutato da solo. Una statistica. Una dichiarazione fattuale. Un'inferenza logica.

Ora immagina che quelle affermazioni si muovano attraverso uno strato di verifica.

Molteplici validatori li esaminano. Alcuni potrebbero essere sistemi automatizzati progettati per incrociare le fonti o eseguire test strutturati. Altri potrebbero essere partecipanti che mettono in gioco token e rivedono attentamente le affermazioni. Ogni validatore produce una valutazione. Inizia a formarsi un accordo. Anche il disaccordo appare.

Alla fine la rete raggiunge qualcosa di simile a un consenso.

Non una verità perfetta. Ma un giudizio collettivo su se l'affermazione regga.

Questa idea mi ricorda un po' di come le blockchain hanno risolto la verifica delle transazioni anni fa. Nessun nodo singolo decide se una transazione è valida. Invece, validatori indipendenti controllano le stesse informazioni e convergono su un risultato condiviso.

Mira Network sembra applicare un principio di coordinazione simile all'informazione stessa.

Ciò che rende questo diverso dal tradizionale fact-checking è il livello di incentivo. La verifica non è solo lavoro volontario o moderazione centralizzata. I partecipanti alla rete possono mettere in gioco token quando convalidano le affermazioni. Se le loro valutazioni divergono costantemente dai risultati accurati, rischiano di perdere parte di quella puntata.

Quel dettaglio cambia il comportamento.

Quando le persone hanno qualcosa a rischio, tendono a rallentare. Controllano le cose due volte. La validazione distratta diventa costosa.

Tuttavia, gli incentivi da soli non risolvono tutto. I problemi di coordinamento raramente scompaiono così facilmente.

Una preoccupazione a cui continuo a tornare è la scala. I sistemi di intelligenza artificiale generano enormi volumi di informazioni. Pensa ai motori di ricerca, agli assistenti virtuali, agli strumenti di ricerca automatizzati. Se ogni affermazione significativa richiedesse verifica, la rete dovrebbe elaborare un'enorme quantità di dati.

Non è banale.

Un'altra preoccupazione riguarda il comportamento sociale all'interno dei sistemi decentralizzati. I validatori potrebbero iniziare a seguire le opinioni della maggioranza piuttosto che analizzare indipendentemente le affermazioni. Abbiamo visto questa dinamica nelle votazioni di governance attraverso molte reti cripto. Gli incentivi spingono i partecipanti verso la sicurezza. A volte ciò significa allinearsi con la folla.

Quindi il sistema dipende ancora da un delicato equilibrio. Abbastanza incentivi per incoraggiare una verifica onesta. Abbastanza indipendenza per prevenire un consenso cieco.

La domanda da porsi è se una rete decentralizzata può mantenere quell'equilibrio nel tempo.

Continuo a pensare a come questo si confronta con il modo in cui si formava la fiducia su Internet nei primi tempi. Allora la credibilità proveniva dalle istituzioni. Università, riviste, organizzazioni mediatiche. Più tardi si è spostata verso le piattaforme e i sistemi di reputazione. Valutazioni, recensioni, conteggi di follower.

L'intelligenza artificiale introduce un problema diverso. Le macchine stanno ora generando enormi volumi di informazioni più velocemente di quanto gli esseri umani possano valutarle.

Se questa tendenza continua, fare affidamento esclusivamente sulla verifica istituzionale probabilmente non scalerà.

È qui che l'approccio di Mira Network inizia a avere senso concettualmente. Invece di fare affidamento su un'unica autorità o un unico modello, distribuisce la verifica attraverso una rete di partecipanti che valutano collettivamente le affermazioni.

L'accuratezza diventa qualcosa a cui la rete arriva insieme.

Ma anche mentre scrivo questo, sono consapevole che l'idea potrebbe svilupparsi in molti modi. Sistemi come questo spesso sembrano eleganti in teoria e disordinati in pratica. Gli incentivi economici possono creare comportamenti strani. I mercati di verifica potrebbero premiare la velocità invece di un'analisi attenta. Oppure gli sviluppatori potrebbero bypassare completamente lo strato di verifica se rallenta le loro applicazioni.

Tutto ciò è possibile.

Tuttavia, il cambiamento di prospettiva sottostante sembra importante.

Per molto tempo la conversazione sull'affidabilità dell'IA si è concentrata sulla costruzione di modelli migliori. Mira Network sembra suggerire un percorso diverso: costruire sistemi di verifica migliori attorno a quei modelli.

Forse questa è la vera lezione qui.

I modelli di intelligenza artificiale generano informazioni. Le reti le valutano.

E se quella relazione modello-rete diventa comune in futuro, i sistemi che decidono quali informazioni fidarci potrebbero apparire meno come macchine individuali e più come ecosistemi coordinati di partecipanti che cercano, a volte in modo imperfetto, di concordare su ciò che è realmente vero.