Mình nhìn @Mira - Trust Layer of AI và thứ khiến mình dừng lại không phải là vì họ nói về AI theo cách nghe thật lớn lao, mà vì họ đang chạm vào một điểm mà mình nghĩ sớm muộn gì thị trường cũng phải đối mặt: nếu AI agents thật sự được dùng ở quy mô lớn, thì ai sẽ là người đứng ra bảo chứng rằng những gì chúng nói và những gì chúng làm có thể được tin cậy đến mức đủ để giao việc thật, tiền thật và quyền truy cập thật cho chúng.

Trong market, rất nhiều dự án thích nói về việc agent sẽ tự giao dịch, tự phân tích, tự điều phối tài nguyên, tự vận hành doanh nghiệp nhỏ trên internet.

Nghe thì hấp dẫn, nhưng mình luôn thấy phần đáng ngại nhất không nằm ở chỗ agent có làm được hay không, mà là khi nó làm sai thì chuyện gì xảy ra.

Một chatbot trả lời nhầm đã là khó chịu rồi, nhưng một agent được cấp quyền gọi API, chuyển tài sản, ký lệnh, phân phối công việc hoặc tương tác với người dùng ở quy mô lớn mà sai thì đó không còn là lỗi nội dung nữa, mà là lỗi hành động.

Và khi lỗi đã biến thành hành động thì người dùng còn tự cứu được mình đến đâu?

Đó là lý do mình thấy luận điểm của $MIRA đáng để nhìn kỹ. Họ không nói chỉ cần model mạnh hơn là đủ. Họ đi từ giả định rằng output của AI không thể mặc định được tin, nên phải có một lớp xác minh ở phía dưới. Nghe qua thì rất hợp lý, gần như hợp lý đến mức khó phản đối.

Nếu AI agents muốn bước ra khỏi giai đoạn demo và thật sự chạm vào các hệ thống có giá trị kinh tế, thì rõ ràng sẽ cần một lớp nào đó để kiểm tra xem kết quả mà nó đưa ra có đáng tin không. Nhưng trong crypto, bất cứ thứ gì nghe quá hợp lý ở tầng narrative thì mình lại càng muốn hỏi thêm một bước: lớp xác minh đó dựa trên mô hình tin cậy nào, ai đang vận hành nó, và khi hệ thống chịu áp lực thì người dùng đang thực sự được bảo vệ bởi cái gì?

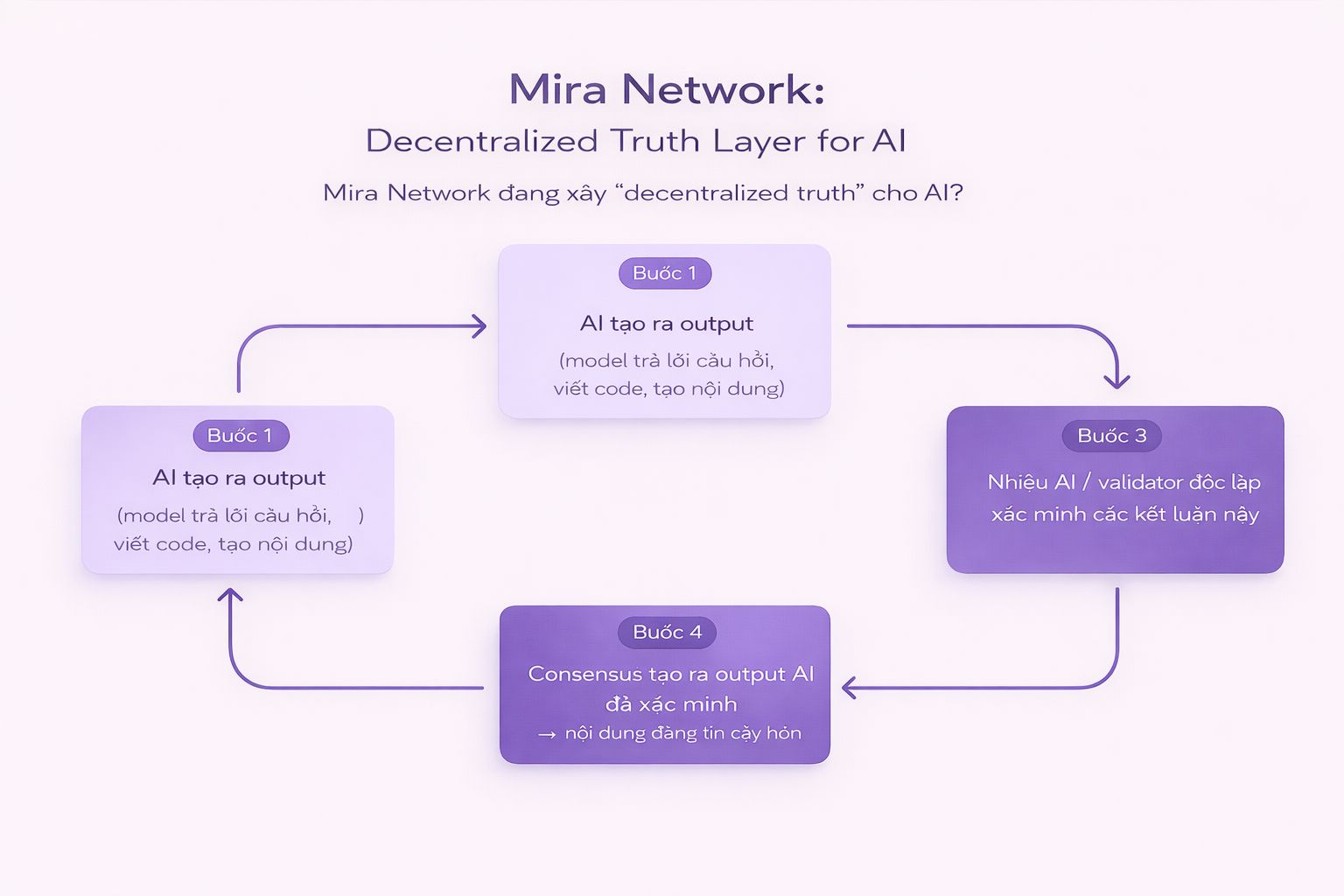

Mira thường được mô tả như một lớp verification phi tập trung cho AI, nghĩa là thay vì tin vào một model hay một nhà cung cấp duy nhất, hệ thống sẽ để nhiều tác nhân độc lập cùng tham gia kiểm tra output.

Ý tưởng này đương nhiên hấp dẫn với bất kỳ ai đã quá quen với chuyện AI nói trôi chảy nhưng sai từ gốc.

Nhưng mình nghĩ cần cẩn thận ở đây. Verification không tự nhiên sinh ra chân lý. Nó chỉ tạo ra một cơ chế để nhiều bên cùng đi đến một kết quả được xem là đủ đáng tin trong khuôn khổ mà hệ thống đặt ra.

Ai quyết định claim được tách như thế nào để kiểm tra? Ai thiết kế ngưỡng đồng thuận? Ai chọn loại mô hình nào được tham gia xác minh? Nếu những giả định nền tảng đó đã lệch thì thứ cuối cùng được dán nhãn là verified có thật sự đáng tin hơn về bản chất, hay chỉ là đáng tin hơn trong phạm vi logic mà giao thức tự xây cho chính nó?

Mình nghĩ đây mới là điểm cần soi kỹ nếu nói Mira có phải là lớp hạ tầng mà AI agents sẽ cần hay không. Bởi vì “cần” trong công nghệ không chỉ là có lý về mặt ý tưởng. Nó còn phải chấp nhận được về chi phí, độ trễ và cấu trúc quyền lực.

Một agent ở quy mô lớn thường được kỳ vọng phải phản hồi nhanh, hoạt động liên tục và xử lý được khối lượng lớn tác vụ. Nhưng càng thêm một lớp verification ở giữa thì càng có thêm chi phí và độ trễ.

Nếu một tác vụ cần ra quyết định gần như theo thời gian thực, thị trường có sẵn sàng đổi tốc độ lấy độ chắc chắn cao hơn không? Hay rồi cuối cùng người ta vẫn chọn hệ thống tập trung, nhanh hơn, rẻ hơn và chấp nhận rủi ro ngầm, giống như cách rất nhiều người vẫn làm trong crypto mỗi ngày?

Mình đã thấy quá nhiều mô hình đúng về mặt lý thuyết nhưng không thắng được vì chi phí vận hành của cái gọi là an toàn lớn hơn mức người dùng sẵn sàng trả.

Rồi còn một câu hỏi khác mà mình thấy quan trọng hơn nhiều narrative hiện tại đang thừa nhận, đó là AI agents có thực sự cần một lớp verification phi tập trung, hay chỉ cần một lớp verification đủ hiệu quả. Đây là hai thứ không giống nhau.

Một công ty hoàn toàn có thể dựng guardrails nội bộ, human review, deterministic checks, rule engine và đủ kiểu sandbox mà không cần token, validator hay cơ chế staking.

Khi Mira chọn hướng Web3, điều đó không chỉ có nghĩa là họ đang mở rộng trust ra nhiều bên hơn. Nó cũng có nghĩa là họ đang mang theo tất cả các vấn đề quen thuộc của hạ tầng crypto vào bài toán AI.

Ai có quyền nâng cấp giao thức? Ai có quyền thay đổi tham số? Nếu phát hiện lỗi nghiêm trọng, ai có quyền tạm dừng? Nếu mạng lưới xác minh bị capture bởi một nhóm lợi ích, người dùng có cách nào để tự bảo vệ không?

Trong crypto, điểm thất bại lớn nhất thường không đến từ biến động giá, mà đến từ khoảnh khắc người dùng nhận ra mình không thể tự rút lui khỏi hệ thống khi có vấn đề.

Với một lớp hạ tầng cho AI agents, rủi ro tương đương có thể không phải là mất token ngay lập tức, mà là agent tiếp tục hoạt động trên một lớp xác minh mà người dùng không còn đủ khả năng kiểm tra hoặc thoát ra đúng lúc.

Mình cũng thấy market hiện tại hơi dễ bị cuốn vào chữ “truth”. Nghe đến “decentralized truth” hay “verification layer” là nhiều người lập tức cảm thấy đây là mảnh ghép tất yếu của tương lai AI.

Nhưng trong thực tế, cái mà hệ thống như Mira cung cấp nhiều khả năng không phải truth theo nghĩa tuyệt đối, mà là một cơ chế giảm bất định trong một số loại output nhất định. Điều này có giá trị, nhưng nó không thần kỳ.

Một agent sai không phải lúc nào cũng sai vì câu trả lời cuối cùng bị lỗi. Nó có thể sai từ dữ liệu đầu vào, từ mục tiêu được đặt sai, từ phần thưởng bị thiết kế lệch, từ việc môi trường thay đổi quá nhanh, hoặc từ những ngữ cảnh mà không mạng lưới verifier nào hiểu đủ để đánh giá Nếu vậy thì lớp xác minh đang giải quyết gốc rễ của vấn đề, hay chỉ đang thêm một bộ lọc ở cuối pipeline để tạo cảm giác yên tâm hơn?

Điều làm mình thấy $MIRA đáng theo dõi là họ đang đặt đúng câu hỏi vào đúng chỗ. Nếu AI agents muốn đi xa hơn chatbot và trở thành những tác nhân kinh tế thật sự, thì thị trường rõ ràng sẽ cần một cơ chế để kiểm tra, audit và buộc chúng phải đi qua một lớp trách nhiệm nào đó trước khi được trao quá nhiều quyền.

Mình không phủ nhận sức hút của hướng đi này. Thật ra mình nghĩ nó còn hấp dẫn hơn nhiều dự án chỉ kể câu chuyện agent sẽ làm thay con người mọi thứ.

Nhưng càng hấp dẫn thì mình càng muốn kéo câu chuyện về chỗ thực tế hơn.

Khi một lớp verification trở thành hạ tầng mặc định, nó sẽ không còn được đánh giá bằng whitepaper hay triết lý thiết kế nữa.

Nó sẽ bị đánh giá bằng những lúc hệ thống căng nhất: khi throughput tăng, khi động cơ kinh tế bắt đầu méo đi, khi một số verifier có lợi ích riêng.

Khi người dùng cần câu trả lời nhanh hơn giao thức có thể xử lý, và khi một agent đã gây ra hậu quả thật ngoài đời.

Vậy Mira Network có phải là lớp hạ tầng mà AI agents sẽ cần trước khi được dùng ở quy mô lớn không?

Mình nghĩ họ đang chạm vào một nhu cầu có thật, nhưng từ nhu cầu có thật đến hạ tầng bắt buộc là cả một khoảng cách dài.

Trong thị trường này, rất nhiều thứ nghe như điều tất yếu trước khi bị chứng minh là chỉ phù hợp với một số ngách cụ thể.

Nếu AI agents thật sự bước vào những môi trường mà sai sót có chi phí lớn, verification gần như chắc chắn sẽ trở thành một lớp khó bỏ qua.

Nhưng liệu lớp đó phải là phi tập trung theo kiểu Web3, hay thị trường cuối cùng sẽ chọn một mô hình kém lý tưởng hơn nhưng dễ vận hành hơn, nhanh hơn và đủ tốt để chấp nhận?

@Mira - Trust Layer of AI #Mira $MIRA