L'intelligenza artificiale è diventata una delle tecnologie più potenti che plasmano i sistemi digitali oggi.

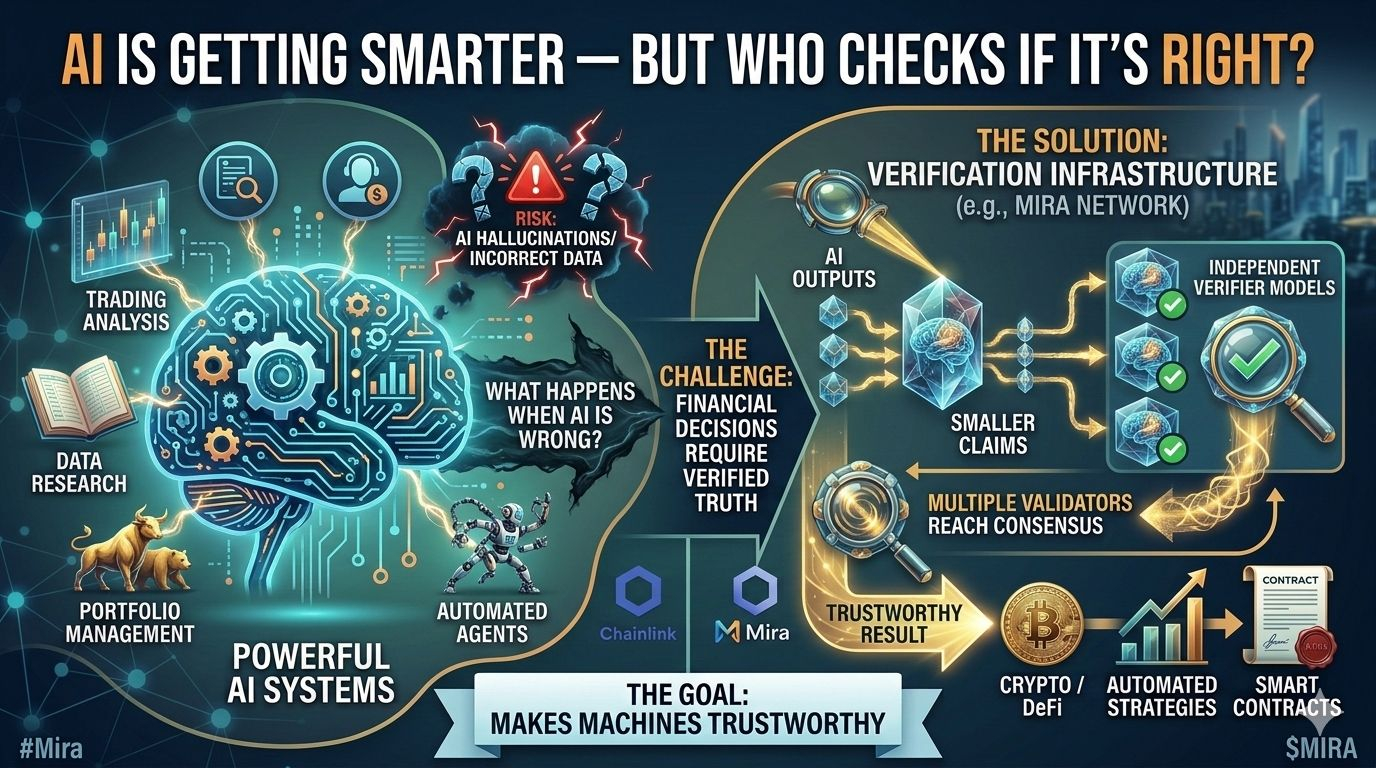

Nel crypto da solo, gli strumenti di AI vengono già utilizzati per:

• analisi di trading

• ricerca di dati on-chain

• gestione del portafoglio

• agenti finanziari automatizzati

Ma mentre esploravo l'architettura dietro $MIRA una domanda continuava a tornare in mente.

Cosa succede quando l'AI commette un errore?

Non perché il modello sia rotto — ma perché i sistemi di intelligenza artificiale generano naturalmente risposte basate sulla probabilità piuttosto che su verità verificate.

In molte situazioni questo non è un problema serio.

Tuttavia, quando l'IA inizia a influenzare le decisioni finanziarie, agenti automatizzati e infrastruttura blockchain, l'affidabilità di quelle uscite diventa improvvisamente estremamente importante.

Il problema nascosto nei sistemi di IA

I modelli di IA possono produrre risposte estremamente convincenti anche quando le informazioni sono parzialmente errate.

Questo fenomeno, comunemente definito come allucinazione dell'IA, è una delle sfide più grandi nello sviluppo moderno dell'IA.

Ad esempio:

Un assistente al trading dell'IA che analizza i mercati cripto potrebbe generare un segnale di trading sicuro basato su dati incompleti.

Se i sistemi automatizzati eseguono quella decisione, le conseguenze potrebbero rapidamente diventare costose.

Ecco perché la prossima fase dell'infrastruttura di IA potrebbe non concentrarsi solo nel rendere i modelli più potenti.

Potrebbe concentrarsi nel rendere le loro uscite verificabili.

Come Mira affronta questo problema

Piuttosto che costruire un altro modello di IA, Mira Network si concentra sull'infrastruttura di verifica.

L'idea centrale è semplice ma potente:

Le uscite dell'IA sono suddivise in affermazioni più piccole e valutate attraverso più modelli di verifica indipendenti.

Ogni verificatore controlla se l'affermazione è logicamente coerente e fattualmente affidabile.

Quando più validatori raggiungono un consenso, il risultato diventa molto più affidabile rispetto al fare affidamento sulla risposta di un singolo modello.

Questo processo di convalida decentralizzato introduce un ulteriore strato di integrità per l'intelligenza delle macchine.

Perché questo è importante per Crypto e DeFi

L'industria cripto si sta muovendo verso sistemi sempre più automatizzati.

Esempi includono:

• agenti di trading guidati dall'IA

• strategie DeFi automatizzate

• piattaforme di intelligenza dei dati blockchain

Man mano che questi sistemi diventano più autonomi, garantire che le uscite dell'IA siano affidabili diventa critico.

Un'infrastruttura di verifica come Mira potrebbe aiutare a ridurre i rischi associati alla decisione automatizzata.

Il quadro più ampio

Se guardiamo a come evolvono i sistemi digitali, gli strati infrastrutturali diventano spesso i componenti più importanti.

Ad esempio:

Chainlink è diventato essenziale per collegare i contratti intelligenti con dati del mondo reale.

Allo stesso modo, gli strati di verifica potrebbero diventare essenziali per garantire che i sistemi di IA operino in sicurezza all'interno dell'infrastruttura finanziaria.

Questa è la visione più ampia che progetti come @mira_network stanno esplorando.

Pensiero finale

La maggior parte dei progetti di IA si concentra nel rendere le macchine più intelligenti.

Ma man mano che l'IA si integra nei veri sistemi economici, appare un'altra sfida:

assicurarsi che quelle macchine siano giuste.

L'intelligenza ha reso l'IA potente.

La verifica potrebbe essere ciò che la rende affidabile.