Il modello ha risposto istantaneamente.

Output pulito. Ragionamento strutturato. JSON perfetto.

Troppo pulito.

Ho visto sistemi rompersi su risposte che sembravano esattamente così.

Quindi non mi sono fidato della prima cosa che lo schermo mi ha mostrato.

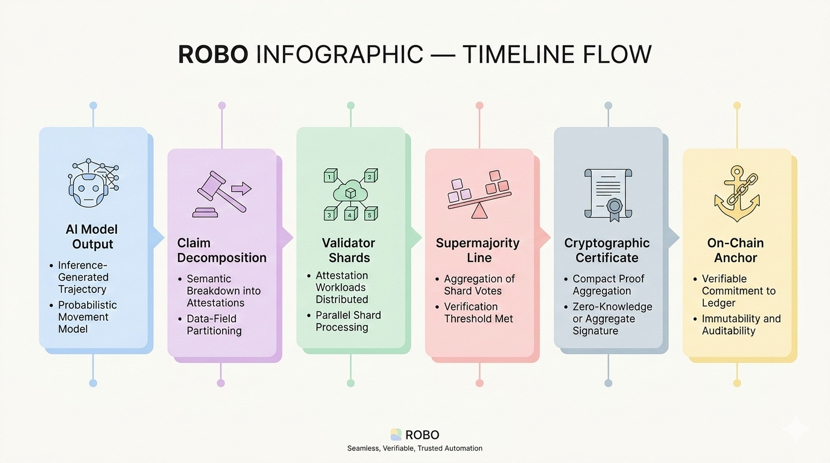

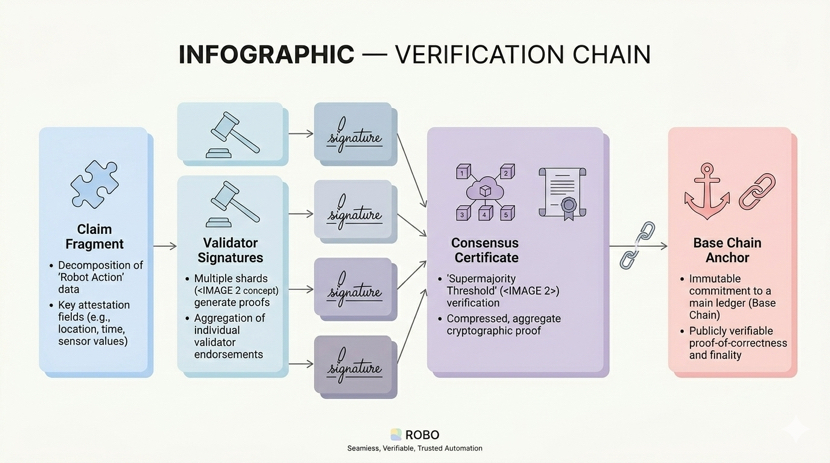

I frammenti si stavano già staccando dalla risposta.

Entità. Richiesta. Puntatore di prova.

Ogni unità divisa e instradata attraverso la rete di validatori decentralizzati di Mira prima che il paragrafo fosse anche terminato di renderizzare.

La console sembrava calma. La rete sottostante era occupata.

Il frammento uno ha raggiunto prima i validatori.

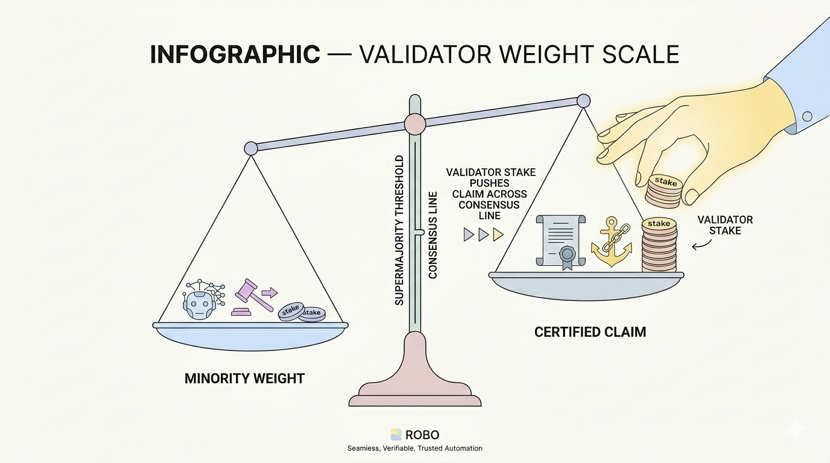

Due nodi attaccati allo stake quasi immediatamente.

Il peso verde è apparso accanto alla richiesta. Non consenso. Solo slancio.

Un validatore si è astenuto. Quel piccolo divario conta più di quanto la gente pensi.

La supermaggioranza non era ancora stata superata. Ma il cruscotto sembrava già finito.

Il frammento due è stato sigillato rapidamente.

Richiesta facile. Chiaro percorso di prova. Supermaggioranza superata. Certificato candidato in formazione.

Quello era sicuro.

Il frammento tre non lo era. Il peso si è bloccato appena sotto la soglia.

Non rifiutato. Non contestato. Solo incompleto.

E questo è lo stato pericoloso.

Il mio cliente tecnicamente permetteva di esportare frammenti sigillati in anticipo.

Due frammenti verdi. Uno ancora in attesa.

L'interfaccia utente avrebbe mostrato “verificato.” Portatile. Riutilizzabile. Sbagliato.

Perché Mira verifica le richieste, non i paragrafi.

I frammenti non aspettano l'uno per l'altro. Il significato può superare la verifica.

Ho passato più tempo del dovuto sopra l'interruttore di esportazione.

Sotto l'interfaccia, la rete di validatori continuava a muoversi.

Stake in attacco. Peso ridistribuito. Il dissenso della minoranza respira ancora silenziosamente sotto la maggioranza.

Quella pressione è intenzionale. I validatori mettono in gioco capitale per partecipare.

La verifica accurata allineata con il consenso guadagna ricompense. Divergenza o negligenza brucia stake.

Nessuna linea guida. Solo incentivi. In Mira, la pressione economica sostituisce la fiducia cieca.

L'ultimo validatore si è unito al turno pochi secondi dopo.

Il peso è aumentato. Supermaggioranza superata. Consenso chiuso.

Il certificato rielaborato istantaneamente. L'hash di output è cambiato.

Stessa frase. Verità diversa. Perché il frammento condizionale è finalmente arrivato.

La richiesta non era completa fino a quando la rete non l'ha dimostrata.

Questa è la parte che le persone fraintendono riguardo all'affidabilità dell'IA.

La sola accuratezza non scala. Le istituzioni non hanno bisogno di risposte sicure. Hanno bisogno di risposte che possano sopravvivere a un'ispezione successiva.

Mira tratta le uscite dell'IA come la produzione ad alta precisione tratta i prodotti che escono da una linea di fabbrica.

Non medie. Non benchmark. Registri di ispezione individuali. Ogni frammento verificato. Ogni validatore registrato. Ogni certificato ancorato alla catena.

Se qualcuno chiede cosa è successo dopo, il sistema non fornisce un riepilogo. Fornisce prova.

Il turno si è chiuso. Il cruscotto sembrava finalmente calmo come aveva fatto finta di essere prima.

Tutti i frammenti sono sigillati. Certificato stabile.

Ma continuavo a fissare i registri. Per alcuni secondi, i pezzi verificati erano avanzati rispetto al significato a cui appartenevano.

Non falso. Solo presto. E nei sistemi che automatizzano le decisioni, presto può essere pericoloso quanto sbagliato.

Questo è il problema che Mira Network risolve realmente.

Non rendere l'IA più intelligente. Rendere le sue risposte dimostrabili.

\u003ct-275/\u003e \u003cm-277/\u003e \u003cc-279/\u003e