L'intelligenza artificiale sta diventando parte delle nostre vite quotidiane più velocemente di quanto molte persone si aspettassero. Chiediamo all'IA di spiegare cose, riassumere informazioni, generare idee e a volte persino aiutare a prendere decisioni. I risultati spesso sembrano impressionanti. Il linguaggio è fluido, le risposte appaiono sicure e la velocità è incredibile. Ma dietro quella sicurezza, c'è ancora un problema silenzioso che molte persone stanno iniziando a notare.

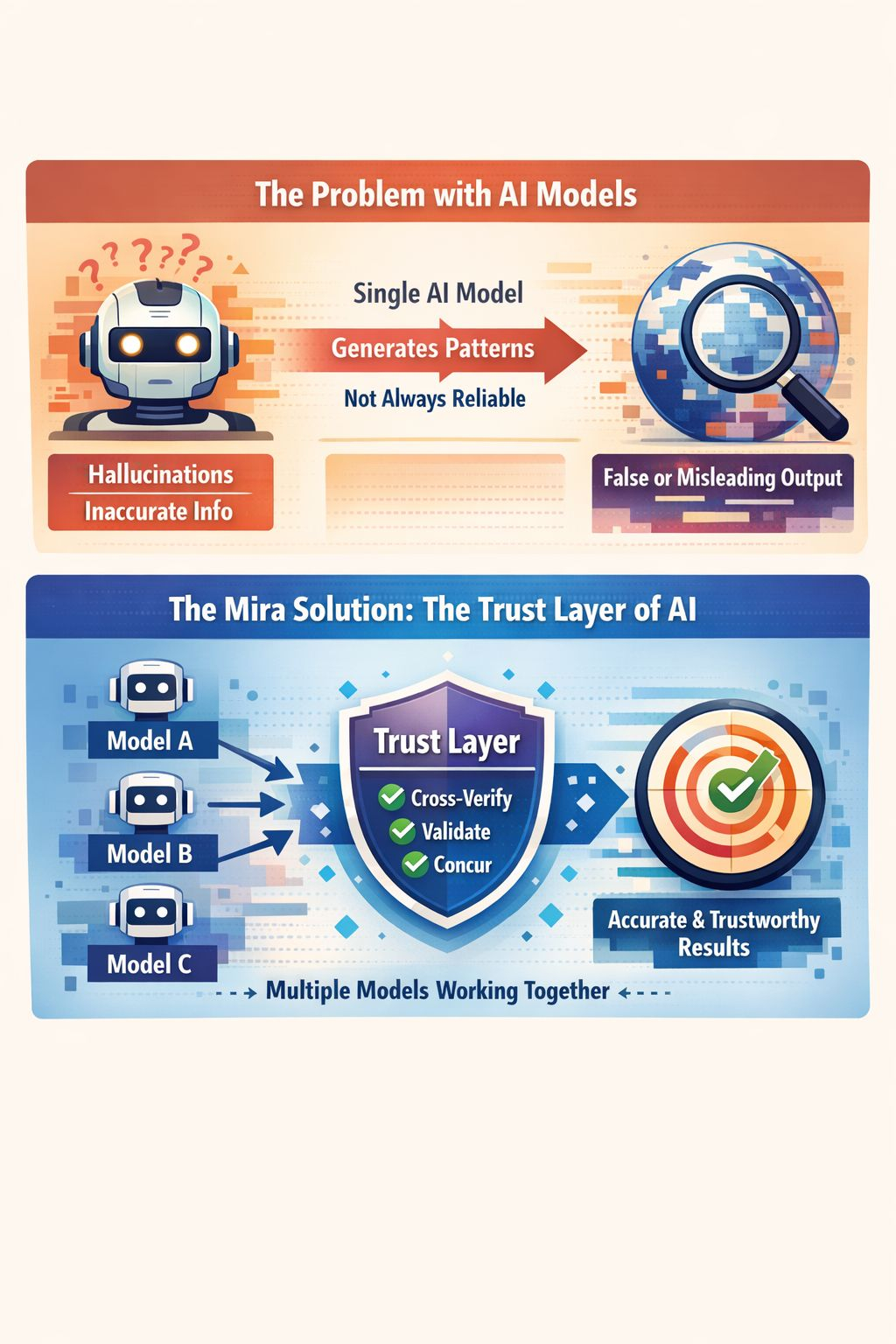

L'IA può sembrare certa anche quando è sbagliata.

Questo accade perché la maggior parte dei sistemi di intelligenza artificiale è progettata per generare risposte, non per dimostrare che quelle risposte siano corrette. Un modello può produrre una risposta convincente, ma non mostra automaticamente prove che la risposta sia affidabile. In situazioni piccole questo potrebbe non importare molto, ma quando l'IA inizia a influenzare la finanza, la ricerca, l'automazione o il governo, la fiducia diventa estremamente importante.

Questa è l'area in cui @mira_network sta cercando di introdurre qualcosa di diverso.

Invece di trattare le uscite dell'IA come risultati finali, la rete Mira le tratta come affermazioni che devono essere verificate. Quando un'IA produce informazioni, tali informazioni possono essere esaminate da più sistemi indipendenti attraverso la rete. Ogni verificatore controlla le affermazioni e contribuisce a un consenso più ampio che è registrato attraverso un'infrastruttura decentralizzata. In termini semplici, Mira sta cercando di trasformare le risposte dell'IA in qualcosa di più vicino alla conoscenza verificabile piuttosto che a congetture sicure.

L'idea può sembrare semplice, ma le implicazioni sono potenti. Se le uscite dell'IA possono essere verificate prima di essere fidate, sviluppatori e organizzazioni potrebbero costruire sistemi che si affidano all'IA con molta più fiducia. Potrebbe aiutare a ridurre l'impatto delle allucinazioni, dei pregiudizi e del ragionamento errato che attualmente limitano molte applicazioni dell'IA.

Il ruolo di $MIRA all'interno di questo ecosistema connette incentivi, partecipazione e governance. I partecipanti che aiutano a convalidare le informazioni contribuiscono all'affidabilità della rete, mentre gli sviluppatori possono costruire applicazioni che usano queste uscite verificate come base per sistemi più complessi.

Ciò che rende interessante questo approccio è che si concentra meno sul rendere l'IA più rumorosa e più sul renderla responsabile.

Man mano che l'intelligenza artificiale continua a espandersi in più settori, la domanda si sposterà lentamente da "Quanto è potente l'IA?" a qualcosa di più importante: "Possiamo fidarci di ciò che l'IA ci sta dicendo?"

Progetti come Mira_network stanno esplorando come potrebbe apparire quel livello di fiducia. E se il futuro della tecnologia dipende veramente da un'intelligenza affidabile, allora costruire sistemi che verificano le informazioni potrebbe diventare altrettanto importante quanto costruire l'intelligenza stessa.

Ecco perché molte persone stanno iniziando a guardare Mira e il più ampio ecosistema Mira con crescente interesse.

@Mira - Trust Layer of AI #Mira $MIRA