L'intelligenza artificiale sta diventando parte delle nostre vite quotidiane, ma rimane ancora una grande preoccupazione: possiamo davvero fidarci delle informazioni che produce? Molti sistemi di IA commettono ancora errori, generano risposte fuorvianti o riflettono pregiudizi nascosti. Quando l'IA viene utilizzata in ambiti importanti, questi problemi possono creare reali difficoltà.

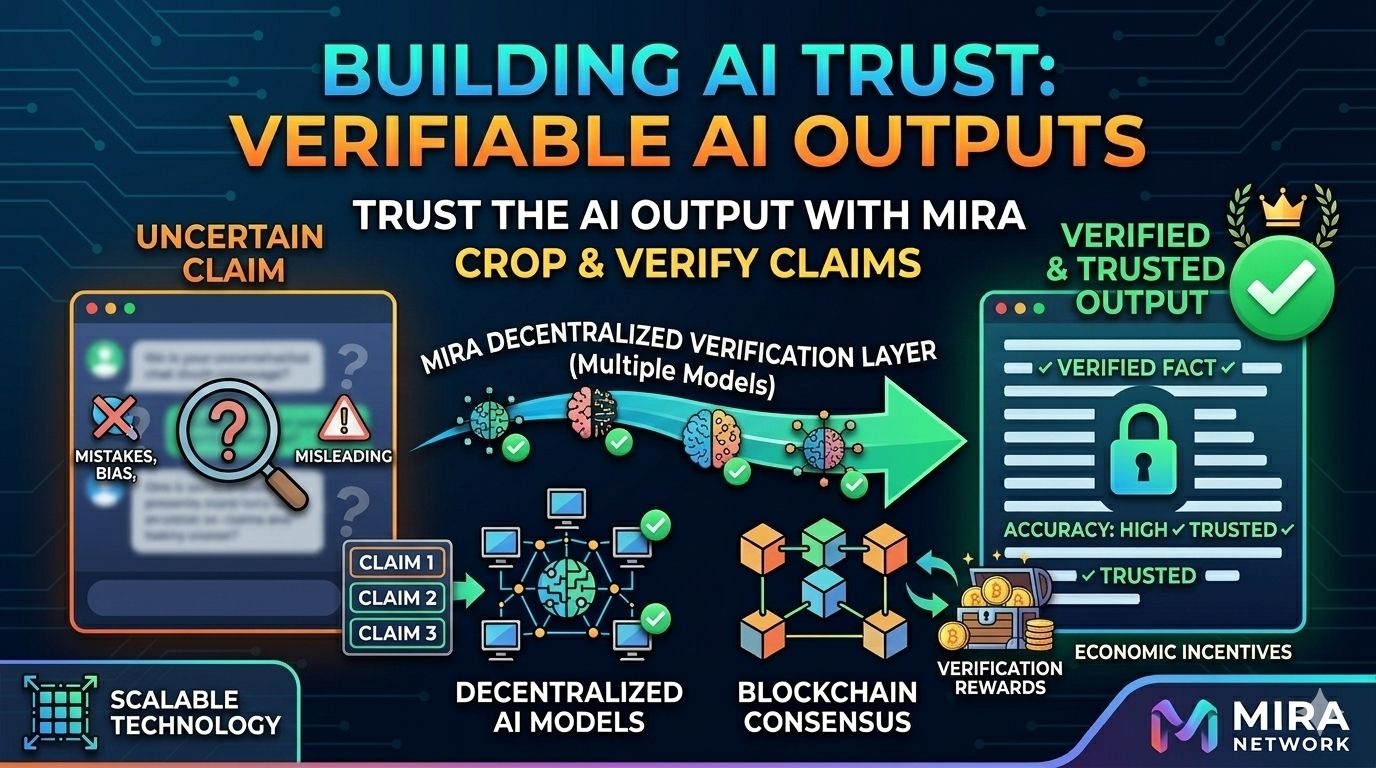

Mira Network sta cercando di affrontare questa sfida introducendo un modo decentralizzato per verificare le uscite dell'IA. Invece di fare affidamento su un singolo sistema, Mira suddivide i contenuti generati dall'IA in piccole affermazioni che possono essere controllate e validate attraverso più modelli di IA indipendenti.

Queste convalide sono quindi garantite utilizzando il consenso della blockchain, creando un sistema in cui l'accuratezza è premiata e la manipolazione diventa difficile. Piuttosto che fidarsi di un'autorità centrale, la rete si basa su verifiche trasparenti e incentivi economici.

Se questo approccio funziona su larga scala, potrebbe cambiare il modo in cui interagiamo con l'IA in futuro—trasformando risposte incerte in informazioni che possono essere verificate, fidate e utilizzate con maggiore fiducia.

@Mira - Trust Layer of AI $MIRA #Mira