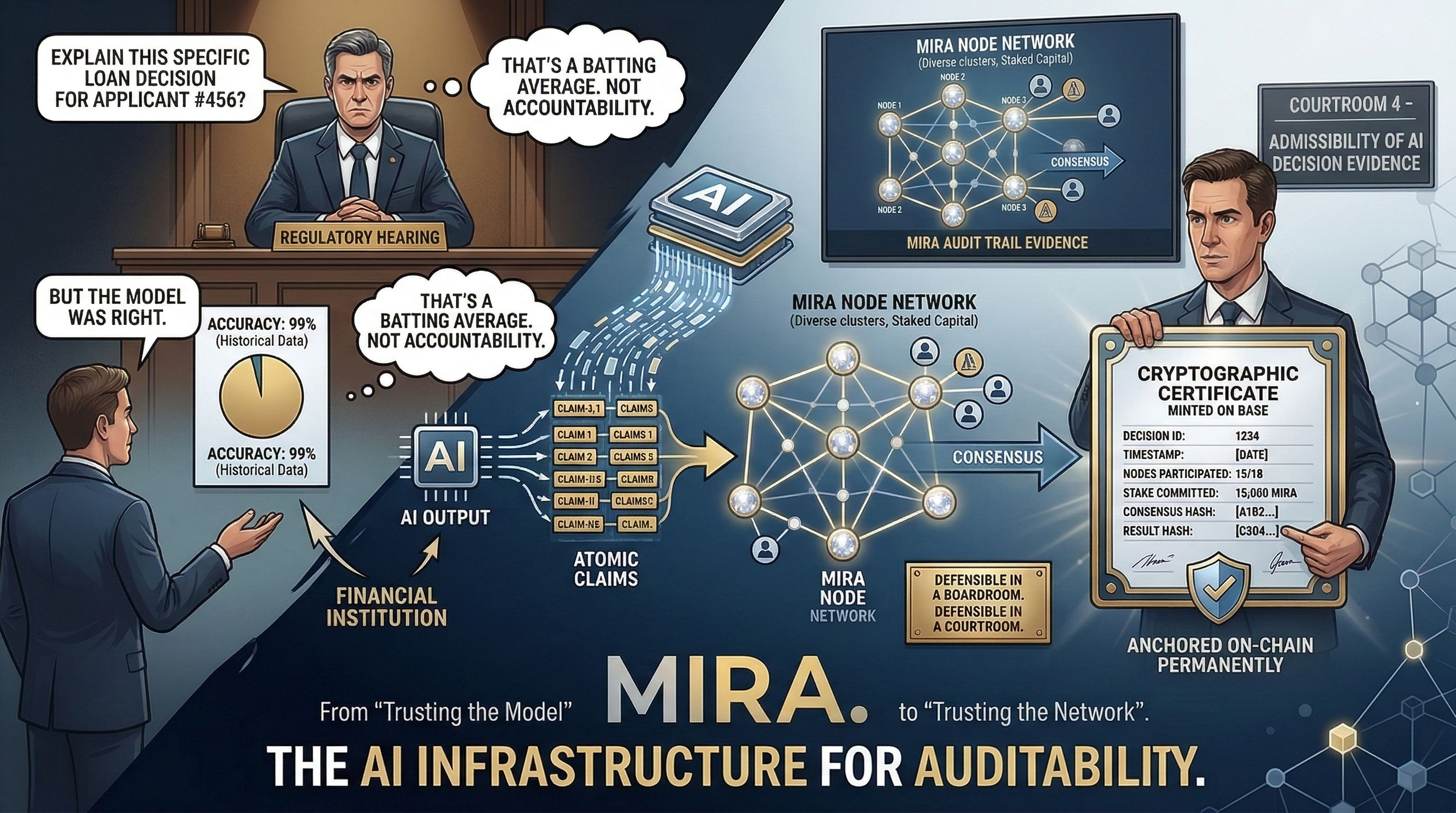

L'ho imparato a mie spese guardando un'istituzione finanziaria distruggersi in un'udienza di regolamentazione.

Il loro modello di intelligenza artificiale era corretto. Genuinamente accurato. La decisione sul rischio di credito che ha preso era corretta in base a ogni metrica che hanno monitorato. Ma quando i regolatori hanno chiesto loro di spiegare quella specifica decisione per quella specifica domanda di prestito, non avevano nulla. Solo statistiche aggregate di accuratezza. "Il nostro modello funziona al 99% sui dati storici."

La risposta del regolatore è stata brutale e giusta: questo non è responsabilità. Questo è una media di battuta.

Questo è il divario di cui nessuno parla quando presentano l'IA a istituzioni serie. L'accuratezza e l'auditabilità sono problemi completamente diversi. Puoi costruire un modello che è corretto la maggior parte delle volte e essere comunque completamente esposto legalmente e operativamente quando qualcosa va storto.

Mira affronta questo a livello di architettura.

Ogni output dell'IA elaborato tramite Mira viene scomposto in affermazioni atomiche. Ogni affermazione verificata indipendentemente attraverso diversi cluster di nodi. Consenso supermaggiore raggiunto. Poi viene coniato un certificato crittografico su Base, registrando esattamente quali nodi hanno partecipato, quale capitale economico hanno impegnato, dove si è formato il consenso e l'hash del risultato verificato ancorato permanentemente on-chain.

Tra cinque anni, puoi ritirare quel certificato e ricostruire esattamente cosa è successo e perché.

Questo cambia completamente la domanda. Invece di "ti fidi di questo modello?" diventa "ti fidi di una rete di nodi che ha messo in gioco capitali reali per verificare questo specifico output?"

Questo è difendibile in una sala consiglio. Questo è difendibile in un'aula di tribunale.

I punteggi di benchmark impressionano gli accademici. I registri di audit proteggono le organizzazioni.

Mira ha compreso quella distinzione prima che la maggior parte delle persone la riconoscesse come un problema.

È questo che rende questa infrastruttura, non solo un prodotto.

@Mira - Trust Layer of AI #Mira $MIRA