Il rapporto di automazione sembrava pulito per circa sei settimane.

Il tasso di completamento è stabile. Il throughput dei compiti aumenta. I tempi di attesa si stanno riducendo.

Poi ho notato una voce che non era nelle specifiche originali.

Ore di supervisore.

Non molto all'inizio. Quattro ore a settimana. Poi sette. Poi undici.

Niente sta fallendo. I robot stavano completando il lavoro. Ma da qualche parte tra l'assegnazione del compito e il completamento verificato, gli esseri umani continuavano a presentarsi per assicurarsi.

Nessuno ha segnalato questo come un incidente.

Il cruscotto non l'ha mai catturato.

È stato allora che ho iniziato a pensare in modo diverso a cosa significa realmente autonomo in produzione.

La promessa e il predefinito sono cose diverse.

Ogni distribuzione di cui ho letto inizia allo stesso modo.

Agenti autonomi. Flotte auto-gestite. Interventi umani minimi.

Sei mesi dopo, l'organigramma ha una nuova riga.

Non perché i robot abbiano fallito. Perché "fatto" non è mai stato definito con sufficiente precisione da fidarsi senza che qualcuno controlli.

Prima un revisore.

Poi un lead di shift per il revisore.

Poi un processo di riconciliazione che si svolge ogni mattina prima che la coda si apra.

Il sistema è ancora tecnicamente autonomo.

Ci vogliono solo tre persone per mantenerlo tale.

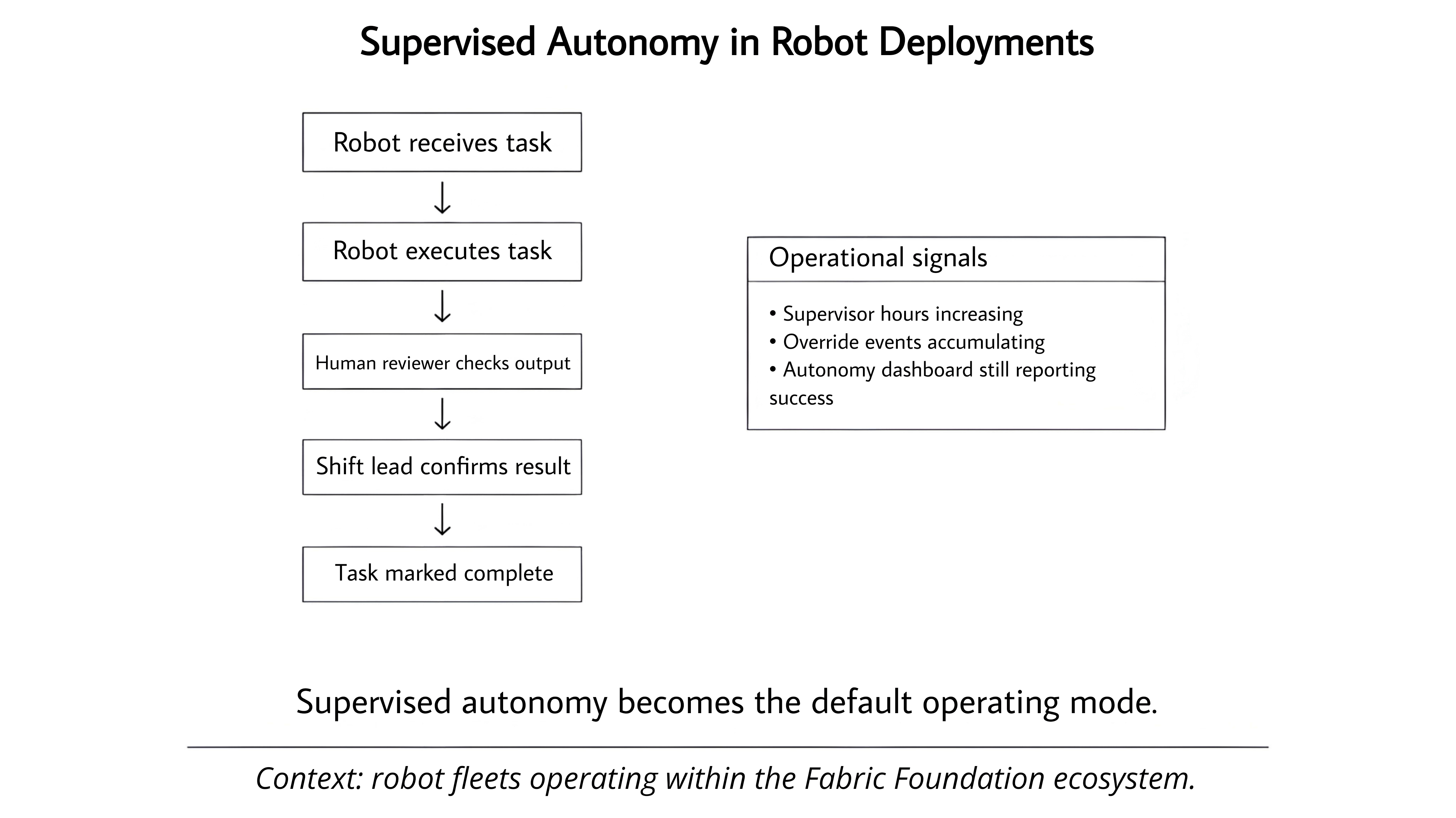

Ho iniziato a chiamare questa autonomia supervisionata.

Probabilmente non sono il primo a notarlo. Ma non ho visto nessuno nominarlo chiaramente.

Non una modalità di fallimento. Una modalità predefinita che nessuno nomina perché nominarla significherebbe ammettere che la specifica originale era incompleta.

Il costo appare in tre luoghi.

Il livello di osservazione appare per primo.

Umani assunti non per svolgere il lavoro ma per confermare che il lavoro sia stato fatto correttamente.

Questo livello cresce silenziosamente. Un FTE diventa due. Due diventano un team.

Il team sviluppa i propri strumenti, percorsi di escalation e memoria istituzionale su quali comportamenti dei robot necessitano maggiore osservazione.

Niente di tutto ciò appare nel cruscotto dell'autonomia.

Il registro di override appare secondo.

Ogni sistema supervisionato accumula interventi manuali. Piccole correzioni. Gestione di casi limite. Decisioni che il protocollo non poteva prendere chiaramente.

La maggior parte delle distribuzioni non rende questo registro pubblico.

Vive in un foglio di calcolo. O in un thread di Slack. O in una base di conoscenza tribale che solo tre persone capiscono.

Quando quelle tre persone se ne vanno, la logica di override se ne va con loro.

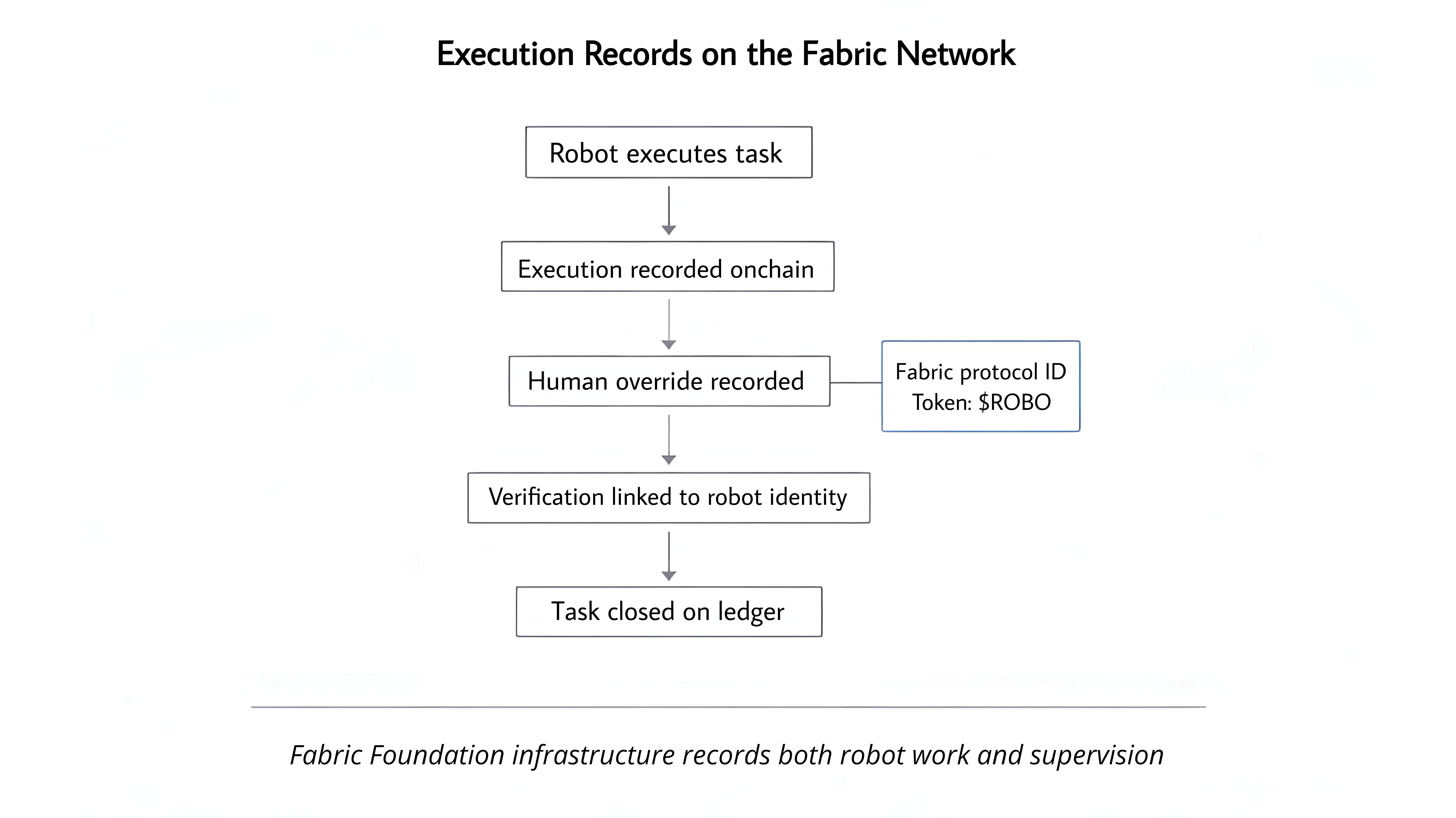

Niente di tutto ciò catturato onchain. Questo è il divario $ROBO è destinato a chiudere.

Il divario di copertura appare terzo.

Questa è la distanza tra ciò che il sistema afferma di completare autonomamente e ciò che effettivamente si chiude senza input umano.

Nei sistemi sani il divario è piccolo e in riduzione.

Nella maggior parte delle distribuzioni che ho visto è stabile al meglio.

Stabile significa che il livello di osservazione è portante.

Stabile significa che l'autonomia supervisionata è diventata il prodotto.

Questo è dove l'identità onchain cambia la superficie.

Non rimuovendo la supervisione. Rendendola visibile.

Se il registro di esecuzione del robot vive onchain e il registro di override umano non lo fa, il libro mastro sta raccontando una storia parziale.

Completamenti puliti da un lato.

Interventi invisibili dall'altro.

Questo non è un sistema trasparente. Questa è contabilità selettiva.

Il livello di identità di Fabric è interessante qui specificamente perché crea infrastrutture per entrambe le registrazioni affinché esistano nello stesso posto.

La storia lavorativa del robot.

Il percorso di contesa.

Il percorso di verifica.

Se gli eventi di override e le ore di supervisione alla fine arrivano anche onchain, il divario di copertura diventa misurabile invece che invisibile.

Questo non rende l'autonomia più facile.

Rende impossibile nascondere la distanza tra la promessa e la realtà.

$ROBO guadagna rilevanza qui solo se il libro mastro cattura ciò che è realmente accaduto.

Non solo ciò che il robot ha riportato.

Non solo ciò che è stato completato senza sfide.

Cosa è stato chiuso.

Cosa aveva bisogno di aiuto.

Cosa richiedeva un umano per essere vero.

Questo è il test che farei su qualsiasi distribuzione che afferma economia autonoma.

Estrarre il tasso di completamento.

Poi estrai le ore del supervisore per lo stesso periodo.

Osserva il rapporto per sei mesi.

In un sistema dove l'autonomia è reale, la supervisione diminuisce man mano che la rete impara.

In un sistema dove l'autonomia supervisionata è il predefinito, quel rapporto rimane piatto.

O cresce.

Ci sono due piloti in ogni cockpit commerciale.

Non perché il pilota automatico non funzioni.

Perché le conseguenze di avere torto sono abbastanza costose da non rimuovere l'umano che lo osserva.

L'economia robotica sta per fare lo stesso accordo.

La questione è se ammette ciò all'inizio e costruisce infrastrutture per esso, o chiama l'autonomia supervisionata con un altro nome e spera che nessuno controlli l'organigramma.

Fabric è uno dei pochi sistemi che ho visto costruire per la versione onesta.

Se il libro mastro alla fine cattura l'immagine completa — supervisione inclusa — è il dettaglio che separa l'infrastruttura dal marketing.