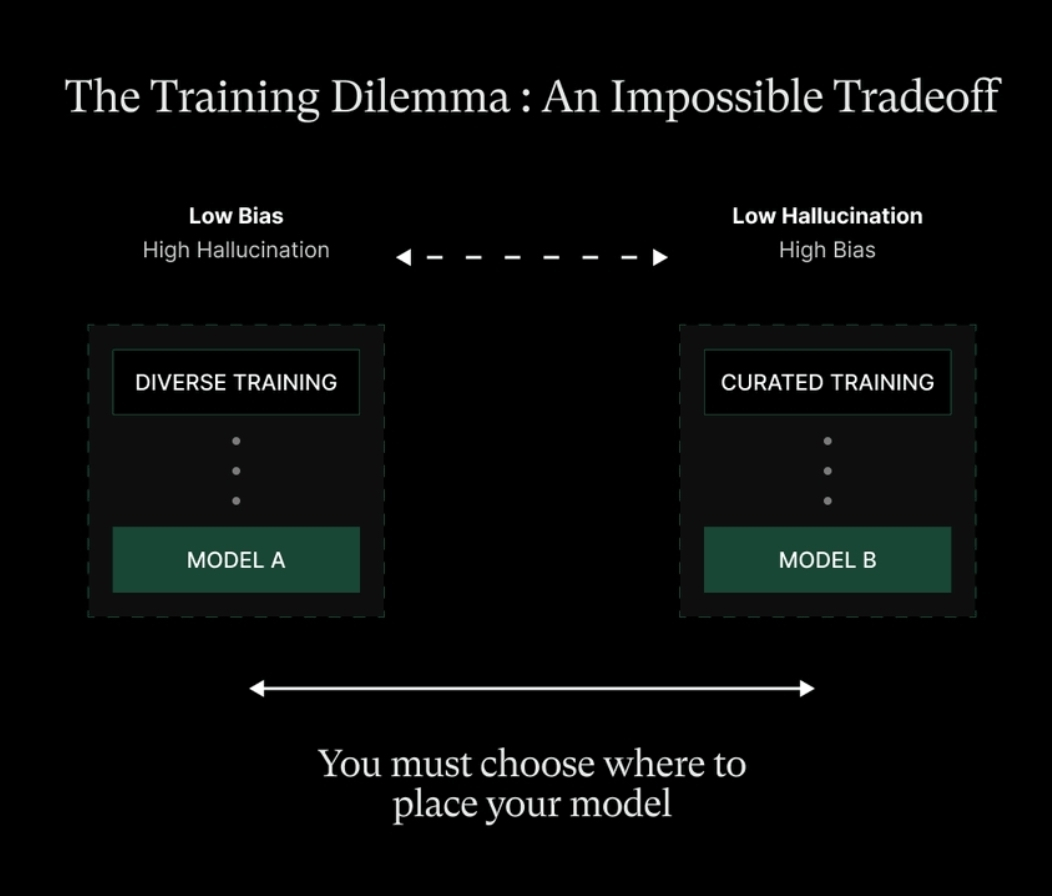

L'intelligenza artificiale sta trasformando le industrie a un ritmo incredibile, ma un grande problema continua a limitare la sua adozione: la fiducia. I sistemi AI possono produrre risposte impressionanti, ma possono anche generare con sicurezza informazioni completamente false. Queste cosiddette “allucinazioni AI” non sono bug rari — sono un risultato naturale di come funzionano i grandi modelli linguistici.

Abbiamo già visto conseguenze nel mondo reale. Gli avvocati hanno presentato documenti di tribunale citando casi che non sono mai esistiti perché un'AI li ha generati. I ricercatori hanno pubblicato riassunti basati su uscite AI errate. Quando l'AI diventa parte di ambienti ad alto rischio come legge, finanza, sanità e ricerca, la verifica diventa critica.

Questa è esattamente la sfida@Mira - Trust Layer of AI che si sta cercando di risolvere.

Invece di fare affidamento su un singolo modello AI per determinare la verità, Mira introduce uno strato di verifica decentralizzato per le uscite dell'AI. Molti modelli AI indipendenti analizzano la stessa rivendicazione e confrontano i risultati. Quando raggiungono un consenso, la probabilità di accuratezza aumenta significativamente. Le ricerche dimostrano che la validazione multi-modello può ridurre drasticamente gli errori rispetto a fare affidamento su un singolo modello.

Tuttavia, Mira va oltre aggiungendo incentivi economici attraverso $MIRA. I validatori devono mettere in gioco valore per partecipare al processo di verifica. Se si comportano onestamente e si allineano con il consenso, ricevono ricompense. Se agiscono in modo malevolo o cercano di manipolare il sistema, il loro stake può essere ridotto. Questo meccanismo garantisce che l'onestà diventi la strategia più redditizia.

Un'altra potente caratteristica dell'architettura di Mira è la trasformazione delle rivendicazioni. Le dichiarazioni complesse vengono suddivise in rivendicazioni più piccole e verificabili. Questo consente alla rete di valutare l'accuratezza passo dopo passo, rendendo la verifica su larga scala sia più veloce che più affidabile.

La visione a lungo termine di @Mira - Trust Layer of AI è molto più grande del semplice controllo dei fatti. Man mano che l'AI diventa integrata nei mercati finanziari, agenti autonomi, sistemi di ricerca e infrastrutture aziendali, la verifica affidabile diventerà essenziale. Una rete di verifica decentralizzata alimentata da $MIRA potrebbe diventare lo strato di fiducia per l'intera economia AI.

In futuro, i sistemi AI più preziosi potrebbero non essere quelli che generano il maggior numero di contenuti, ma quelli le cui uscite possono essere dimostrate affidabili.

Questo è il futuro che Mira sta costruendo.