الشيء الذي ينتشر بسرعة على الإنترنت ليس دائمًا هو الأكثر صحة، بل غالبًا هو الأكثر إثارة للمشاعر. الناس أصبحت تميل لتصديق ما يتوافق مع مشاعرها أو أفكارها، أكثر من الأشياء التي يمكن إثباتها بالأدلة.

ومع تطور الذكاء الاصطناعي أصبح الأمر أكثر تعقيدًا. اليوم يمكن للـAI أن يصنع صورًا، يقلد الأصوات، بل ويُنشئ فيديوهات كاملة خلال ثوانٍ فقط.

السؤال الحقيقي هنا:

هل نستطيع فعلًا التمييز بين الحقيقة وما تم اختلاقه؟

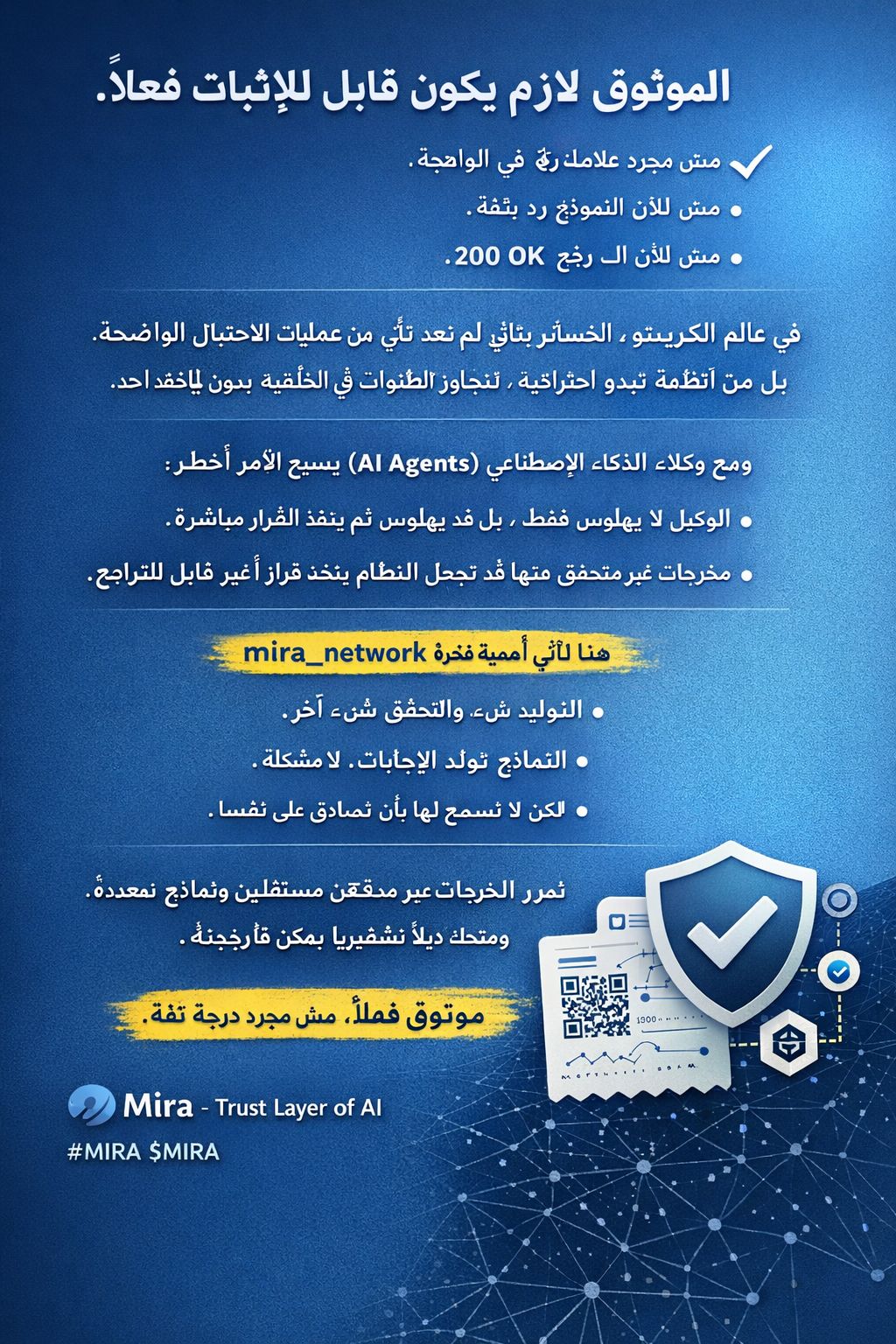

عند الحديث عن @mira_network، ما لفت انتباهي ليس فقط محاولة جعل الذكاء الاصطناعي أكثر ذكاءً، بل محاولة إصلاح نظام المعلومات على الإنترنت الذي أصبح أكثر فوضوية يومًا بعد يوم.

تخيل لو أن المعلومات لها “ملصق تغذية” مثل الطعام

تخيل أنك اشتريت طعامًا من السوبر ماركت. ستجد دائمًا ملصقًا يوضح السعرات الحرارية، السكر، البروتين وغيرها.

الآن تخيل لو كنت تقرأ مقالًا أو تشاهد فيديو، وفي زاوية الشاشة يظهر مؤشر يوضح:

كم من المعلومات تم التحقق منها،

ما هي الادعاءات التي لم يتم إثباتها بعد،

وهل هناك احتمال أن يكون المحتوى مولدًا بواسطة الذكاء الاصطناعي.

هذا تقريبًا ما تحاول Mira Network بناؤه:

نوع من “ملصق التغذية” للمعلومات الرقمية.

في الخلفية يعمل نظام Mira على تقسيم المحتوى إلى ادعاءات صغيرة، ثم يقوم الذكاء الاصطناعي بمقارنتها مع مصادر بيانات عامة يمكن التحقق منها.

إذا كان المحتوى موثوقًا يظهر ذلك بوضوح، وإذا كانت المعلومات غير مؤكدة يظهر تحذير. وكل ذلك يتم بشفافية.

الـDeepfake يزداد جنونًا… لكن يمكن فحصه

الآن يستطيع الذكاء الاصطناعي تقليد صوت أي شخص تقريبًا، وصناعة فيديوهات لشخصيات مشهورة، بل وحتى خطابات تبدو حقيقية تمامًا.

المشكلة ليست فقط من صنع الفيديو، بل ما الذي يُقال بداخله.

وهنا يصبح نهج Mira مثيرًا للاهتمام. فبدلًا من مجرد فحص الفيديو بصريًا، يقوم النظام بتحليل محتواه وتقسيمه إلى ادعاءات.

مثلًا: إذا قال الفيديو إن حدثًا معينًا وقع في عام 2015، يمكن للنظام فورًا مقارنة هذا الادعاء مع البيانات العامة المتاحة.

إذا لم يتطابق مع الحقائق فسيتم اكتشافه بسهولة.

بمعنى آخر:

ليس الهدف فقط معرفة إن كان الفيديو مزيفًا، بل معرفة إن كانت المعلومات داخله صحيحة أم لا.

البيانات النظيفة قد تصبح أغلى أصل في المستقبل

كثيرون يقولون إن “البيانات هي النفط الجديد”، لكن المشكلة أن جزءًا كبيرًا من بيانات الإنترنت غير نظيف.

هناك تحيزات وأخطاء وحتى تلاعب متعمد.

تخيل لو أن شركة ذكاء اصطناعي قامت بتدريب نموذجها على بيانات خاطئة…

النتيجة ستكون نظامًا يعطي إجابات خاطئة أيضًا.

الصحافة قد تتنفس من جديد

الذكاء الاصطناعي اليوم قادر على إنتاج آلاف المقالات خلال دقائق. المشكلة أن الكثير منها مجرد نسخ ولصق أو محتوى بلا مصادر واضحة.

لهذا أحيانًا يخسر الصحفي الحقيقي السباق أمام المحتوى السريع.

لكن مع نظام تحقق مثل الذي تحاول Mira Network بناؤه، يمكن للصحفيين تقديم شيء مختلف:

إظهار أدلة التحقق مباشرة.

وهذا قد يصبح الفرق بين الصحافة الجادة والمحتوى السريع عديم المصداقية.

أكبر مشكلة في الإنترنت كانت دائمًا “الثقة”

نحن بدأنا نشك في كل شيء تقريبًا.

الفيديو قد يكون Deepfake، المقال قد يكون مكتوبًا بواسطة AI، وحتى الصور يمكن التلاعب بها بسهولة.

إذا استمر هذا الوضع، قد يفقد الإنترنت ببطء أهم أساس قام عليه: الثقة.

لهذا فإن رؤية مشروع مثل Mira Network تعتبر طموحة جدًا، فهم يحاولون إعادة بناء شيء بدأ يختفي من العالم الرقمي.

تخيل بعد عدة سنوات أنك تقرأ مقالًا أو تشاهد فيديو، ويظهر زر صغير مكتوب عليه:

“Mira Verification”

تضغط عليه… فتظهر لك فورًا:

ما هي الادعاءات الصحيحة،

ما هي النقاط التي ما زالت محل نقاش،

وما هي المعلومات التي قد تكون خاطئة.

في الماضي عندما كنا نسأل:

"هل هذا صحيح؟"

كانت الإجابة غالبًا:

"أعتقد أنه صحيح."

لكن في المستقبل قد تصبح الإجابة:

"تحقق من دليل التحقق بنفسك."

ولو تحقق هذا التصور فعلًا، فقد يصبح الإنترنت نظامًا عالميًا أفضل للتمييز بين الحقيقة والمعلومات المضللة.

@Mira - Trust Layer of AI