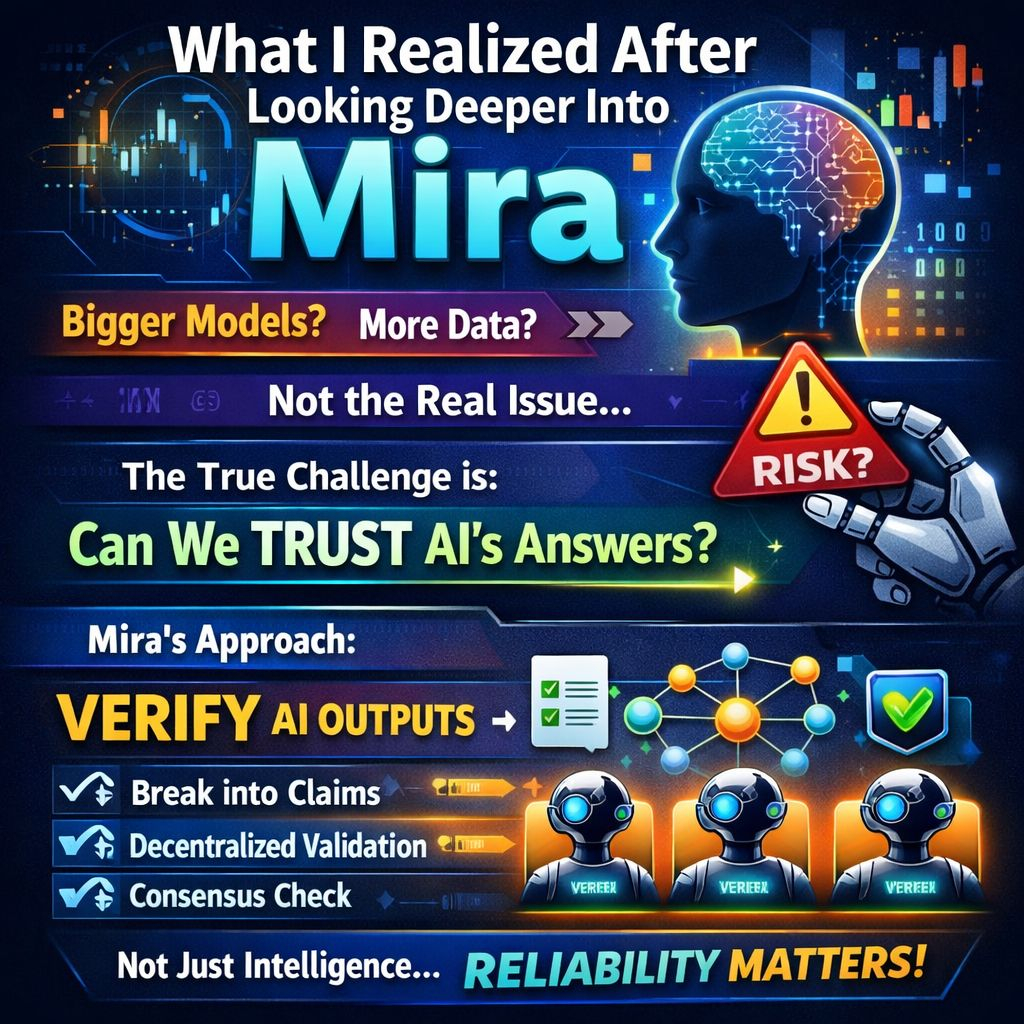

Per molto tempo, la maggior parte delle conversazioni sull'intelligenza artificiale si è concentrata su una cosa: rendere i modelli più potenti.

Modelli più grandi.

Più parametri.

Più dati di addestramento.

Ma mentre studiavo come @Mira - Trust Layer of AI funziona, mi sono reso conto di qualcosa di interessante.

La vera sfida per l'IA potrebbe non essere l'intelligenza.

Potrebbe essere fiducia.

I sistemi di intelligenza artificiale oggi generano risposte basate sulla probabilità. Nella maggior parte dei casi, le risposte sembrano convincenti, ma occasionalmente possono comunque essere errate pur suonando completamente sicure.

Questo diventa un problema serio quando l'IA inizia a influenzare sistemi reali come strumenti di trading, analisi finanziarie o agenti automatizzati.

Un singolo output errato può rapidamente diventare una decisione costosa.

Ciò che ha catturato la mia attenzione riguardo a Mira è che il progetto affronta questa sfida da una direzione diversa.

Invece di costruire un altro modello di IA, Mira si concentra sulla verifica degli output dell'IA prima che vengano considerati attendibili.

L'idea è semplice ma potente.

Le risposte dell'IA possono essere suddivise in affermazioni più piccole e verificate attraverso modelli di verifica indipendenti in una rete decentralizzata. Quando più verificatori raggiungono il consenso, il risultato diventa molto più affidabile rispetto al fare affidamento su un singolo modello di IA.

Questo introduce un interessante cambiamento nel modo in cui pensiamo all'infrastruttura dell'IA.

Invece di chiedere solo quanto sia potente un modello di IA, potremmo iniziare a porre un'altra domanda:

Può essere verificato il suo output?

Man mano che l'IA continua a integrarsi nelle piattaforme finanziarie, negli strumenti aziendali e nei sistemi automatizzati, l'affidabilità potrebbe diventare altrettanto importante quanto l'intelligenza.

E questa è la direzione in cui progetti come @mira_network stanno esplorando.