In questo momento, utilizzare l'intelligenza artificiale è un incubo per la privacy. Ogni volta che un ospedale cerca di utilizzare l'IA per esaminare la storia medica di un paziente, o un'azienda la utilizza per leggere un contratto legale privato, sta assumendo un rischio enorme. Stanno consegnando informazioni altamente sensibili e private a server tecnologici centralizzati.

Questo è esattamente il motivo per cui le industrie ad alto rischio sono state così lente nell'adottare l'IA. Semplicemente non possono permettersi il rischio per la sicurezza. Ma @Mira - Trust Layer of AI ha costruito una soluzione direttamente nella loro infrastruttura chiamata Architettura di Protezione della Privacy.

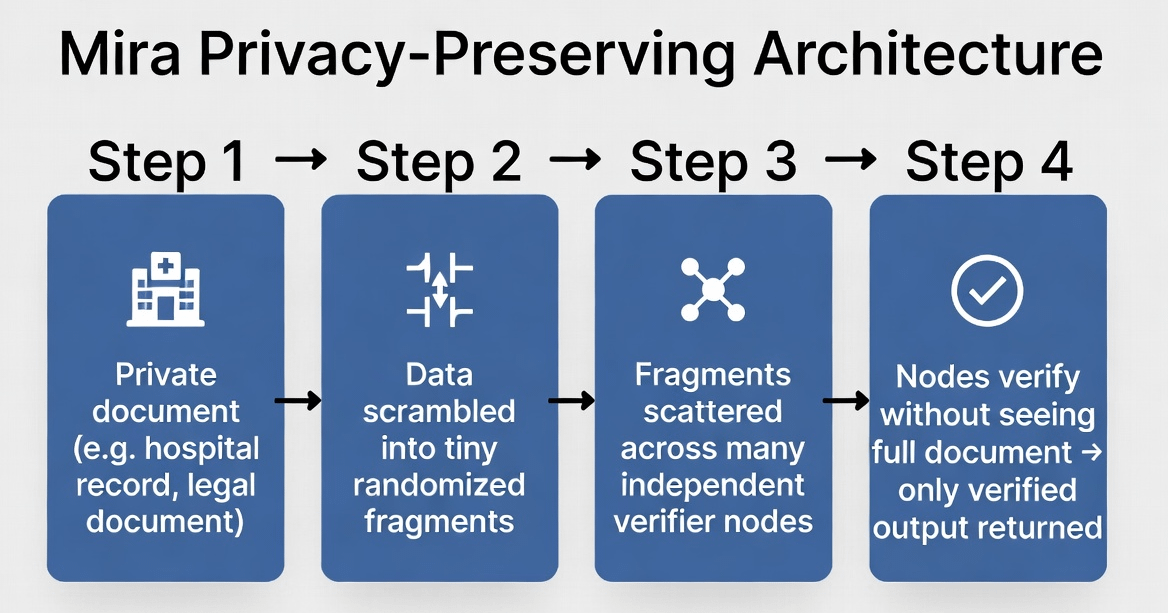

Invece di inviare l'intero documento privato a un singolo server per la verifica, la rete lo mescola. Suddivide le informazioni complesse in piccoli frammenti casualizzati.

Questi pezzi frammentati sono poi sparsi in una rete decentralizzata di nodi verificatori indipendenti. Poiché i dati sono suddivisi e distribuiti casualmente, nessun operatore di nodo singolo può mai ricostruire o leggere il tuo documento originale completo. Possono vedere solo un piccolo frammento, privo di contesto, che devono verificare.

Questo significa che un'azienda può finalmente ottenere output AI verificati al 100%, matematicamente provati, senza mai esporre i propri dati riservati o violare la privacy dei clienti. Rimuove completamente il rischio di estrazione di dati aziendali. Stiamo finalmente ottenendo l'infrastruttura necessaria per utilizzare l'IA in modo sicuro nel mondo reale. $MIRA #Mira