Ho notato qualcosa di strano dopo aver utilizzato strumenti AI regolarmente per un po'.

Le risposte sono spesso utili. A volte sorprendentemente buone. Ma di tanto in tanto controlli un dettaglio e ti rendi conto che qualcosa è leggermente sbagliato. Non drammaticamente errato. Solo... non del tutto corretto.

Ciò che rende difficile è che la risposta suona ancora sicura.

Questa è la parte scomoda dei moderni sistemi AI. Sono estremamente bravi a presentare informazioni, ma non hanno davvero un modo integrato per dimostrare se ciò che hanno prodotto è vero.

Questo è il problema che mi ha fatto esaminare più da vicino la rete Mira.

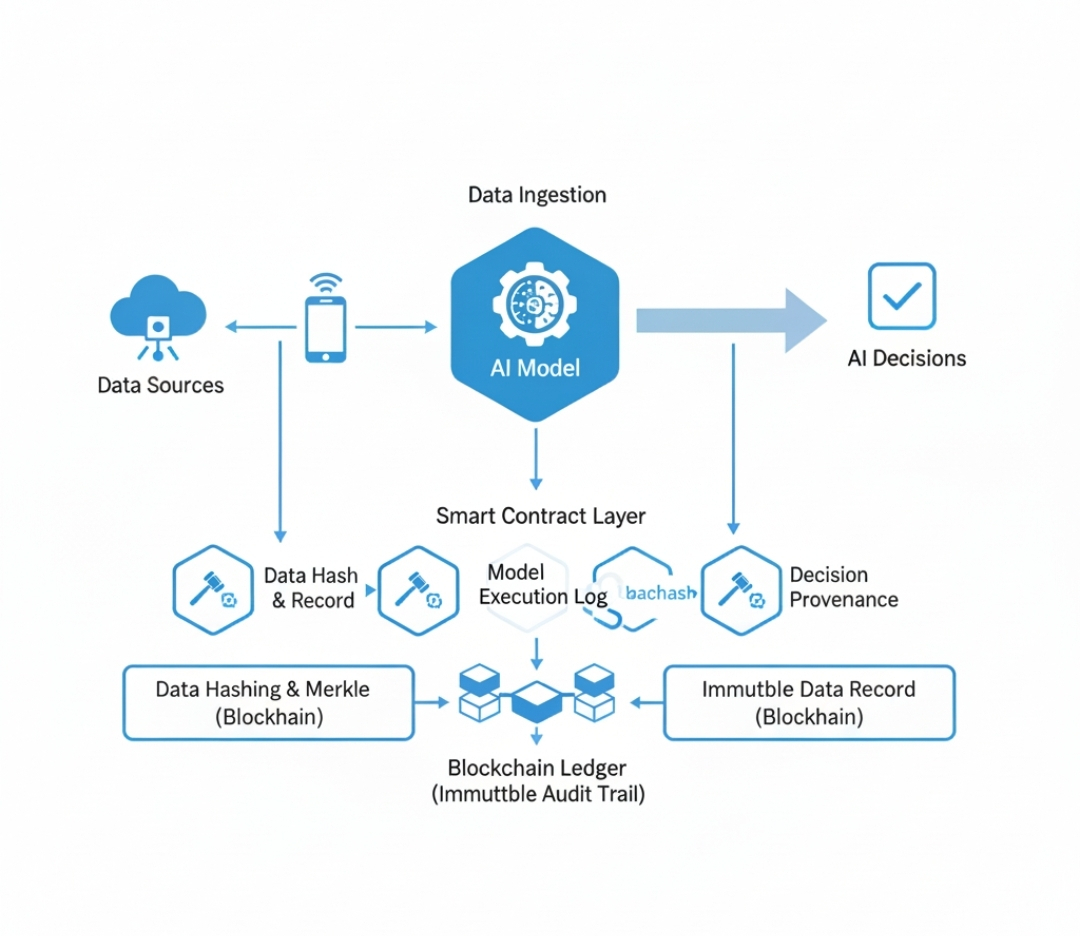

Mira non sta cercando di costruire un modello più intelligente. Invece, si concentra su qualcosa che si trova sotto l'IA stessa — la verifica. Il protocollo tratta un output IA non come una singola risposta, ma come una raccolta di affermazioni più piccole. Queste affermazioni possono poi essere valutate indipendentemente da diversi validatori attraverso una rete.

Alcuni validatori potrebbero essere altri modelli IA. Altri potrebbero essere sistemi di verifica specializzati. L'idea chiave è che nessun singolo sistema decide cosa sia corretto. La rete cerca accordo tra più validatori indipendenti e registra quel consenso onchain.

Questo approccio cambia il modello di fiducia in un modo interessante.

Proprio ora, quando un'IA produce informazioni, la responsabilità di verificarle ricade solitamente sull'utente. Mira sposta parte di quella responsabilità nella rete stessa. Le affermazioni vengono verificate collettivamente e i validatori vengono ricompensati quando verificano correttamente le informazioni.

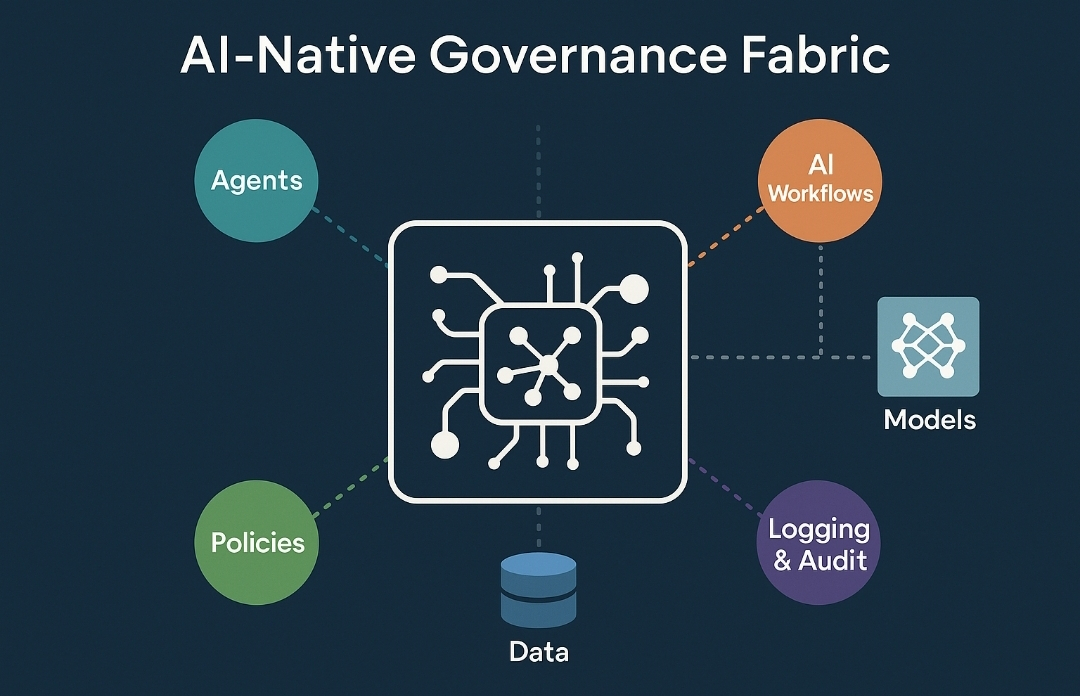

L'idea diventa più rilevante quando pensi a dove sta andando l'IA. Oggi la maggior parte dei sistemi agisce ancora come assistenti. Gli esseri umani leggono l'output e decidono cosa farne. Ma gli agenti IA stanno già iniziando a svolgere compiti automaticamente in finanza, ricerca e automazione.

Una volta che le macchine iniziano ad agire su informazioni senza una costante revisione umana, l'affidabilità diventa molto più importante.

Ecco perché Mira sembra meno un altro progetto IA e più un'infrastruttura per un futuro in cui i sistemi IA hanno bisogno di un modo per dimostrare che i loro output possono effettivamente essere considerati affidabili.