GPT-5.4 è stato rilasciato, chiarendo la direzione dell'iterazione futura dell'AI. Attualmente, il campo dell'AI è già passato dalla finestra di dialogo all'evoluzione verso agenti di sistema, con gli esseri umani responsabili dell'estetica e l'AI responsabile dell'implementazione, prendendo una direzione di flusso di lavoro collaborativo uomo-macchina.

➤ Punti chiave dell'aggiornamento centrale di GPT-5.4

1、Unire il ragionamento generale di GPT-5.2 con le capacità di programmazione di punta di GPT-5.3-Codex

2、Supportare una finestra di 1 milione di token (circa 5000 pagine di documenti) e risolvere il problema della dimenticanza nei testi lunghi

3、Operazioni native su computer, il modello può vedere direttamente lo schermo, utilizzare il mouse e digitare sulla tastiera come una persona. Nei test di OSWorld, il tasso di successo del 75,0% ha già superato la media umana.

4、Introduzione della funzione di interruzione a metà. Le conversazioni non sono più rigide e a turni, gli utenti possono inserire richieste aggiuntive in qualsiasi momento mentre il modello sta pensando o rispondendo.

5、Ottimizzazione dell'efficienza e dei costi, introduzione del meccanismo Tool Search. Il modello non ha più bisogno di caricare preventivamente tutte le definizioni degli strumenti, ma cerca in base alle necessità, risparmiando notevolmente il 47% del consumo di token.

➤ Perché succede questo?

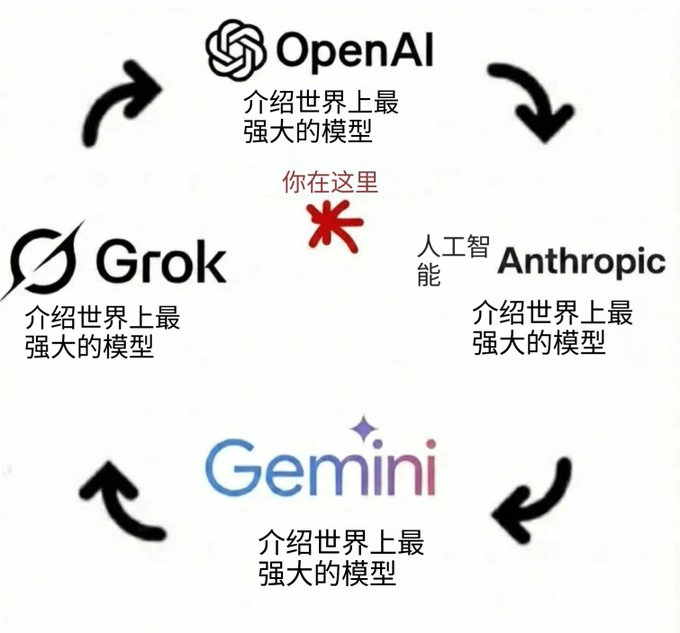

Attualmente, i principali laboratori di AI nel mondo affrontano un muro di dati. Entro il 2026, i testi di alta qualità, il codice e i libri prodotti dall'umanità potrebbero essere stati raccolti su larga scala dai grandi modelli, e l'addestramento sui testi ha raggiunto un punto di stallo; modelli come Claude code, codex e openclaw sono profondamente integrati con i sistemi operativi attuali, sostituendo in parte le operazioni umane per chiamare strumenti di sistema, e possiedono una coscienza autonoma, con l'obiettivo di completare i compiti.

C'è anche un'altra cosa che molte persone non sanno: i modelli della serie codex sono stati addestrati insieme al framework Codex, il che significa che i modelli della serie codex e il framework Codex sono nativi l'uno per l'altro, e il modello può naturalmente richiamare tutti gli strumenti di sviluppo all'interno di codex.

➤ Analisi approfondita della direzione futura dello sviluppo dell'AI

1. Passaggio da API a native di livello sistema operativo

La capacità di utilizzo del computer mostrata da GPT-5.4 è passata dalla finestra di dialogo all'intero sistema operativo.

In passato, il modello scriveva codice solo in una Sandbox (sandbox) limitata; dopo l'aggiornamento, avrà mani di significato fisico. Non solo comprende la logica del codice, ma può anche interpretare il feedback visivo degli errori di clic, trascinamento e terminale.

Il nuovo livello del framework non sarà più un insieme di funzioni di strumenti predefiniti, ma una profonda percezione dell'OS (sistema operativo). Il modello ha imparato a osservare lo schermo e fornire feedback durante l'addestramento, il che gli consente di modificare il codice e controllare le variazioni dell'interfaccia utente nella finestra di debug del browser come un ingegnere esperto, realizzando uno sviluppo end-to-end auto-ciclico, cosa già realizzata su codex.

2. Milioni di contesti + progettazione dell'architettura di compiti a lungo termine + sistema di memoria = architetto onnipotente

Nell'architettura a tre livelli di Codex, il livello del modello fornisce ragionamento strutturato. I 1 milione di token di contesto portati da GPT-5.4 offrono, in sostanza, una tela più ampia per questo tipo di ragionamento.

Il sistema di memoria di OpenAI è sempre stato di gran lunga avanti, con il rilascio della memoria senza perdita e della memoria illimitata. Soprattutto quando il modello e il framework sono nativamente collegati, il modello può recuperare istantaneamente l'intero codice sorgente (a livello di milioni di token), e il framework può applicare le modifiche con precisione su decine di file correlati.

Ora in codex è già possibile realizzare una riscrittura completa dell'architettura e comprendere con precisione il significato del codice.

3. Ricerca e espansione dinamica nell'invocazione degli strumenti

Il meccanismo Tool Search (ricerca degli strumenti) introdotto da GPT-5.4 consente al framework di comprendere i modelli di output del modello, il che permette al modello di ottenere più informazioni di contesto e quindi operare con precisione.

La direzione futura dello sviluppo non prevede il caricamento preventivo di migliaia di librerie di strumenti (per evitare sprechi di token), ma quando il modello deduce che ha bisogno di un componente di visualizzazione dei dati, può catturare e caricare in tempo reale la definizione tramite Tool Search, il che significa che le attuali Skills potrebbero essere un prodotto di transizione intermedio, con più strumenti incorporati nel contenuto del modello che il grande modello può scegliere automaticamente quale strumento utilizzare.

Il vantaggio è che il grande modello può mantenere un'alta efficienza di token. Risolve il paradosso secondo cui più strumenti ci sono, più il modello diventa stupido, consentendo all'albero delle abilità dell'Agente di estendersi all'infinito, ottimizzarsi automaticamente e trovare il percorso migliore per essere addestrato nel modello successivo.

4. Interazione in tempo reale, da un sistema a turni a modifiche interrotte in qualsiasi momento

La funzione di interruzione a metà introdotta da GPT-5.4 ha rotto lo stato di black box generato dall'AI, consentendo di apportare aggiustamenti tempestivi se il pensiero non è corretto.

A livello collaborativo, si introduce maggiormente la decisione umana, piuttosto che lasciare completamente che l'AI operi autonomamente, realizzando una collaborazione a scatola bianca, con gli esseri umani responsabili dell'estetica, della definizione delle esigenze e della selezione delle soluzioni, e l'AI responsabile dell'implementazione.

Anche grazie all'introduzione della capacità di intervento in tempo reale, l'AI passa dallo stato di consegna di compiti in scatole cinesi a quello di partner ingegneristici che possono modificare le esigenze in qualsiasi momento.

Per semplificare, il nuovo modello AI Native (Codex + GPT-5.4) costruisce direttamente una macchina F1 da zero, e il motore, il telaio e le gomme della macchina sono stati progettati per una velocità estrema fin dal primo giorno.

In futuro, potremmo non dover più cercare modelli più potenti, ma piuttosto sistemi che si integrano più profondamente con l'ambiente di sviluppo.