Il Rischio Nascosto Dietro le Intuizioni Cripto Generate dall'IA

Gli strumenti di intelligenza artificiale stanno diventando una parte regolare della ricerca sulle criptovalute.

Dai cruscotti del sentiment di mercato ai segnali di trading automatizzati, molti trader ora si affidano all'IA per interpretare rapidamente grandi quantità di dati blockchain.

Ma c'è una domanda importante che spesso passa inosservata.

Come possiamo verificare se le intuizioni generate dall'IA siano effettivamente corrette?

— — —

Recentemente, mentre scorrevo i post di analisi di mercato su Binance Square, ho sperimentato un paio di strumenti alimentati dall'IA.

Entrambi stavano analizzando dati blockchain simili.

Entrambi hanno prodotto rapporti chiari con spiegazioni sicure.

Eppure i risultati erano sorprendentemente diversi.

Uno strumento ha evidenziato una forte spinta verso l'alto.

L'altro ha suggerito cautela e possibile debolezza del mercato.

Il contrasto non era solo interessante.

Ha sollevato una domanda più profonda.

Se i sistemi AI stanno generando informazioni per trader e ricercatori, chi conferma se quegli output sono davvero affidabili?

⸻

L'AI sta diventando parte del flusso di lavoro crypto

L'intelligenza artificiale è ora integrata in molte attività crypto.

Analisi del sentiment di mercato.

Generazione di segnali di trading.

Riepiloghi di ricerca on-chain.

Analisi del portafoglio.

Questi strumenti elaborano enormi quantità di informazioni rapidamente.

Ma la maggior parte dei sistemi segue ancora una struttura semplice:

AI produce una risposta → gli utenti si fidano dell'output

Quello modello funziona in ambienti centralizzati dove le aziende controllano i dati.

Gli ecosistemi decentralizzati operano in modo diverso.

Le blockchain dipendono da informazioni verificabili, non da assunzioni.

⸻

Esplorare un approccio diverso

Mentre leggevo le discussioni dei contributori di CreatorPad, mi sono imbattuto in riferimenti a Mira Network.

All'inizio sembrava un altro progetto che combinava AI e blockchain.

Ma il concetto alla base si concentra su qualcosa di leggermente diverso.

Invece di costruire solo modelli AI più intelligenti, il protocollo esplora uno strato di verifica per le informazioni generate dalle macchine.

L'idea è semplice.

I sistemi AI possono produrre intuizioni.

Ma prima che quelle intuizioni siano trattate come affidabili, possono essere verificate dai partecipanti decentralizzati.

⸻

Trasformare la verifica in un sistema di incentivi

Qui il $MIRA token diventa importante.

I partecipanti agiscono come validatori indipendenti all'interno della rete.

Quando gli output o i dataset generati da AI vengono inviati, i validatori esaminano le informazioni e inviano la loro valutazione.

Mettono in gioco token mentre forniscono la loro valutazione.

Se la loro convalida si allinea con il consenso finale della rete, ricevono ricompense.

Se il loro giudizio è errato, parte della loro scommessa potrebbe essere ridotta.

Questa struttura crea un sistema di incentivi attorno all'accuratezza.

Invece di fare affidamento su un solo modello AI, più partecipanti valutano lo stesso output prima che diventi dati affidabili.

⸻

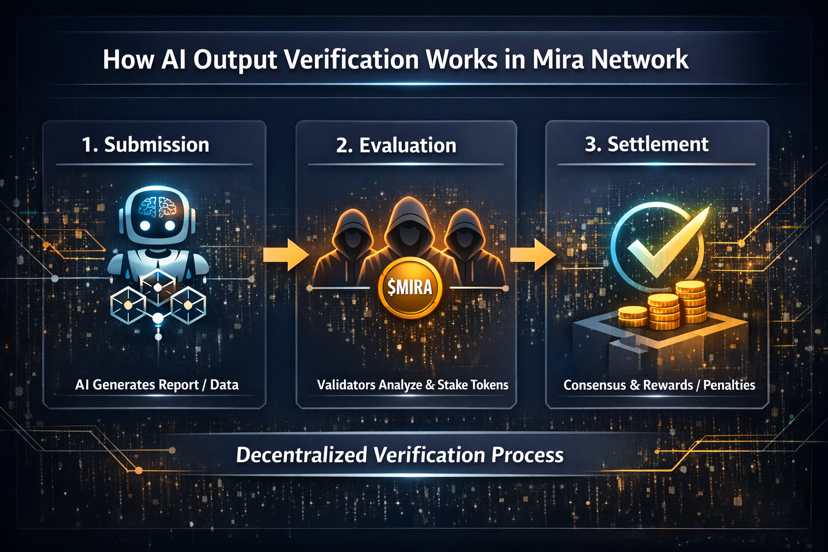

Come funziona il processo di verifica

Il flusso di verifica si muove generalmente attraverso tre fasi.

Invio

I sistemi AI o i fornitori di dati inviano output generati alla rete.

Valutazione

I partecipanti analizzano le informazioni e inviano risposte di convalida mentre mettono in gioco token.

Regolamento

La rete determina il consenso.

I validatori allineati con l'esito ricevono ricompense, mentre le sottomissioni errate possono affrontare penalità.

⸻

Perché la verifica potrebbe diventare importante

I sistemi AI stanno producendo una quantità crescente di informazioni relative alle crypto.

Riepiloghi di ricerca.

Dashboard analitiche.

Intuizioni di trading automatizzate.

Rapporti di governance.

Man mano che le applicazioni decentralizzate iniziano a interagire con gli output generati da AI, verificare che quelle informazioni diventi sempre più importante.

Un mercato di verifica decentralizzato potrebbe aggiungere uno strato di affidabilità tra la generazione AI e le decisioni reali della blockchain.

⸻

Considerazioni finali

I modelli AI possono generare intuizioni istantaneamente.

Ma la velocità non garantisce sempre l'accuratezza.

Man mano che gli ecosistemi blockchain continuano a integrare l'intelligenza artificiale, i meccanismi che verificano i risultati generati dalle macchine potrebbero diventare uno strato di infrastruttura essenziale.

Invece di fidarsi ciecamente delle intuizioni automatizzate, le reti decentralizzate potrebbero evolversi gradualmente verso sistemi informativi convalidati dalla comunità.

E quel cambiamento potrebbe influenzare come AI e Web3 interagiscono in futuro.

Cosa ne pensi?

La verifica decentralizzata diventerà necessaria mentre gli strumenti AI continuano ad espandersi sulle piattaforme crypto?

⸻

#MIRA @Mira - Trust Layer of AI #creatorpad