Ieri sera, prima di andare a letto, ho riaperto Binance. Le dita sembravano avere una memoria muscolare, quindi ho cliccato sulla pagina delle transazioni e poi scorrendo sono andato ai preferiti. Alcuni altcoin erano rossi e verdi, il mio umore ha tremato un po', poi ho iniziato a fare quel tipo di azione senza senso: avvicinarmi per vedere il grafico a 15 minuti, poi tornare a quello a 1 ora, in questo modo riesco a tenere a bada l'incertezza. Quando ho visto il settore AI, mi sono fermato un attimo, non perché stesse salendo, ma perché era "ancora in fase di scambio" — anche quando scendeva, c'era qualcuno che comprava, e quando rimbalzava, c'era qualcuno che inseguiva, la liquidità sembrava non essersi mai interrotta.

Ieri sera, prima di andare a letto, ho riaperto Binance. Le dita sembravano avere una memoria muscolare, quindi ho cliccato sulla pagina delle transazioni e poi scorrendo sono andato ai preferiti. Alcuni altcoin erano rossi e verdi, il mio umore ha tremato un po', poi ho iniziato a fare quel tipo di azione senza senso: avvicinarmi per vedere il grafico a 15 minuti, poi tornare a quello a 1 ora, in questo modo riesco a tenere a bada l'incertezza. Quando ho visto il settore AI, mi sono fermato un attimo, non perché stesse salendo, ma perché era "ancora in fase di scambio" — anche quando scendeva, c'era qualcuno che comprava, e quando rimbalzava, c'era qualcuno che inseguiva, la liquidità sembrava non essersi mai interrotta.

Ho osservato un fenomeno piuttosto coerente: il mercato ha una tolleranza molto alta per le parole "AI"; anche quando il fervore diminuisce, non torna immediatamente a zero. Se guardi altre narrazioni, quando si raffreddano è come spegnere una luce; l'AI è più come una metropolitana, si può criticare, ma c'è sempre qualcuno che si fa avanti. Ancora più sottile è che il modo in cui le persone parlano di AI sta cambiando: prima si amava confrontare i modelli per quanto somigliassero agli esseri umani, ora si ama di più confrontare chi riesce a portare le cose nella realtà, anche se è solo "capace di far completare automaticamente un certo processo."

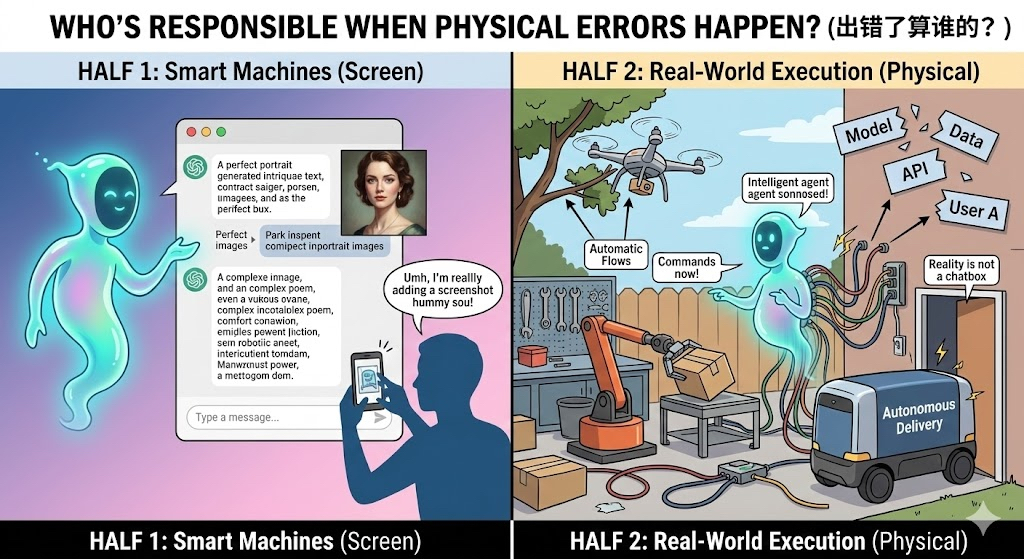

Quello che c'è dietro sembra suggerire un segnale di settore: la prima metà dell'AI è rendere le macchine capaci di parlare, scrivere e creare immagini; la seconda metà è più complicata, consiste nel far sì che le macchine "facciano affari" nella realtà, senza combinare guai. Il mondo reale non è una finestra di dialogo, ha delle soglie, dei permessi e dei confini di responsabilità. Un modello che parla a vanvera sullo schermo può essere deriso con uno screenshot; ma una volta che inizia a comandare droni, gestire bracci meccanici o effettuare ordini e pagamenti per te, il problema non è più "è intelligente o no", ma "chi è responsabile se qualcosa va storto". Ancora peggio, una volta che l'automazione è in atto, la responsabilità si frammenta: chiedi a A, A dice che è colpa del modello; chiedi al modello, il modello dice che è colpa dei dati; chiedi ai dati, i dati dicono che è colpa delle interfacce; infine ti arrabbi con l'aria.

In realtà, penso che questa "frammentazione della responsabilità" diventerà il maggior ostacolo dell'era dei robot. L'hardware diventerà sempre più economico, i modelli diventeranno sempre più potenti, ma se il sistema manca di un insieme di regole riconosciute da tutti, la collaborazione sarà come una struttura temporanea assemblata: sembra funzionare, ma al primo vento si sfascia. Maggiore è l'automazione, maggiore è la dipendenza da queste regole per chiarire i confini: chi può avviare un compito, chi può accettarlo, come verificare le consegne, come risolvere le controversie, come chiudere i conti. Sembra noioso, ma ciò che consuma di più le persone nella realtà sono spesso questi dettagli noiosi. Recentemente ho esaminato il contenuto di @Fabric Foundation , e #ROBO in questa direzione ha messo "governance e coordinamento nell'economia decentralizzata dei robot" in primo piano, facendomi improvvisamente rendere conto che il mercato potrebbe non scommettere sulla prossima macchina più cool, ma su quel sistema che consente ai robot di essere organizzati, interrogati e regolati.

Ecco un pensiero controintuitivo: forse ciò che varrà di più in futuro non sarà la macchina che cammina meglio, né il cervello che pensa meglio, ma quella serie di "regole generali per evitare che tutti si passino la responsabilità". Non è sexy, anzi, può sembrare un fastidio — perché aumenta la necessità di verifica, aumenta l'attrito, aumenta il dibattito. Ma senza di essa, quanto più si diffonde l'automazione, tanto più il contenzioso diventa comune, e alla fine ognuno imparerà solo una cosa: a spingere la responsabilità altrove. A quel punto,$ROBO queste cose discusse nell'ordine collaborativo potrebbero non essere solo "oggetti di scambio", ma più simili a diritti di partecipazione e costi di espressione: sei disposto a pagare per le regole, a prendere responsabilità per la governance, a schierarti per la collaborazione.

Quindi voglio chiederti: quando i robot inizieranno davvero a "farcela", preferisci un'automazione più fluida o un ordine più complicato ma che chiarisca le responsabilità?