Ho smesso di giudicare la fiducia nell'IA come le persone giudicano le persone. Con gli esseri umani, leggiamo il tono, il linguaggio del corpo e il curriculum. Con l'IA, il tono è la cosa più fuorviante che ha. Un modello può sembrare calmo, raffinato e certo mentre cuce silenziosamente insieme una frase che non ha mai avuto un vero ancoraggio nella verità. Quindi la domanda su cui mi sono seduto non è “Quale modello è il più intelligente?” È “Quando un output dell'IA conta, quale prova esiste che sia sicuro fare affidamento su di esso?”

L'analogia che mi ha aiutato è la spedizione, non la chat. Immagina un contenitore sigillato che attraversa i confini. Nessuno accetta la fiducia di un autista come prova che il carico sia corretto. Ciò che rende il commercio funzionante è la documentazione e l'ispezione: manifesti, sigilli, punti di controllo e una catena di custodia che puoi auditare quando qualcosa va storto. In quel mondo, la fiducia non è un'emozione, è un sistema che lascia tracce. La rete Mira è più facile da comprendere attraverso quella lente. Sta cercando di far comportare le uscite dell'IA come un carico che deve venire con documentazione, non come un narratore di cui speri solo che sia onesto.

Questo è importante perché l'AI sta attraversando una linea. Quando l'AI sta solo generando idee, un'allucinazione è per lo più un fastidio. Ma quando l'AI sta redigendo politiche, riassumendo la conformità, approvando passaggi in un flusso di lavoro, guidando le decisioni dei clienti, alimentando conclusioni di ricerca o nutrendo un agente autonomo che può effettivamente eseguire, l'affidabilità diventa un rischio operativo. La parte peggiore delle allucinazioni non è che esistano, ma che spesso arrivano con una consegna sicura, e la fiducia è la cosa più economica che un modello possa produrre.

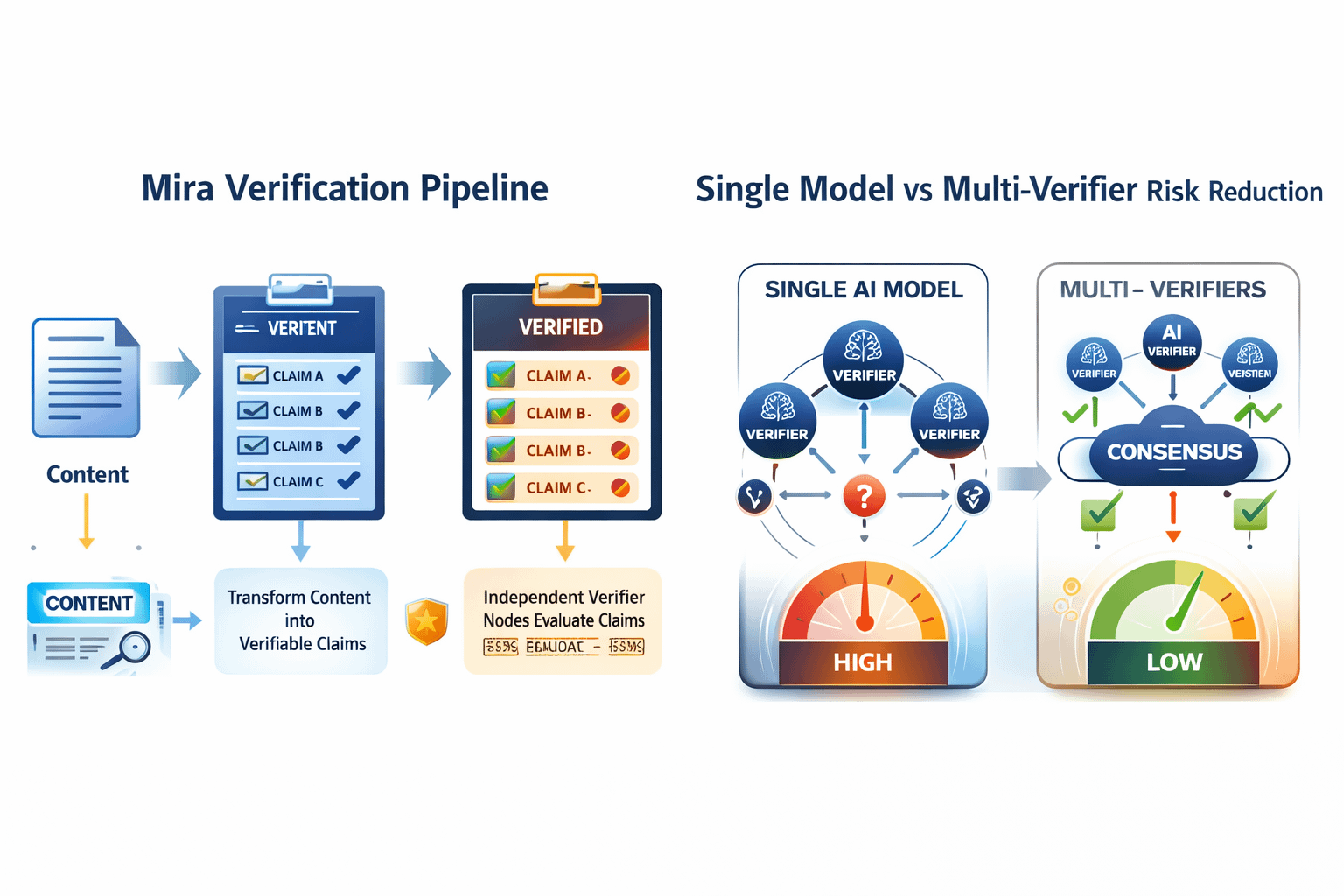

L'approccio di Mira, come descritto in spiegazioni di stile di ricerca pubbliche, è di smettere di trattare una risposta AI come un'unica grande cosa che si accetta o si rifiuta. Invece, tratta l'output come un insieme di “richieste” più piccole che possono essere verificate una alla volta. Nel momento in cui lo fai, la verifica diventa più strutturata. Un lungo paragrafo smette di essere un blob persuasivo e diventa un insieme di affermazioni che puoi testare. Il report di Messari descrive chiaramente questo flusso: suddividere gli output in affermazioni fattuali, avere più nodi verificatori che le giudicano indipendentemente e poi utilizzare una soglia di consenso per decidere cosa passa e cosa viene segnalato. Sottolinea anche che il risultato può essere accompagnato da un certificato crittografico che registra quali richieste sono state valutate, quali modelli hanno partecipato e come hanno votato, affinché tu possa auditare il percorso in seguito invece di fidarti di una scatola nera.

Ciò che sembra umano in questo è che rispecchia come le persone si comportano quando qualcosa è importante. Se ti interessa avere ragione, non chiedi a una sola persona e ti fermi. Verifichi. Confronti le prospettive. Cerchi la stessa conclusione che arriva attraverso menti diverse. Anche l'obiettivo di neutralità di Mira si adatta qui: il sistema è progettato per funzionare attraverso più modelli piuttosto che assumere che il modello di un fornitore sia il giudice della realtà. Questo non garantisce perfezione, ma riduce la dipendenza da un singolo insieme di pregiudizi, scelte di addestramento e modalità di errore.

L'idea della “ricevuta” diventa ancora più concreta quando si guarda a Mira Verify, che è presentato pubblicamente come un'API di verifica/fact-checking in beta. Il linguaggio stesso del sito dice fondamentalmente: invia una richiesta, lascia che più modelli specializzati la verifichino, e ricevi certificati verificabili affinché un team non debba supervisionare manualmente ogni output. Inquadra esplicitamente le meccaniche fondamentali come verifica multi-modello più auditabilità dall'input al consenso. Non è una storia di prezzo, è una storia di flusso di lavoro. È un tentativo di trasformare la verifica in qualcosa che uno sviluppatore può integrare in una pipeline come fa con il logging, il monitoraggio o i pagamenti.

Ora la questione del token diventa più chiara quando pensi in termini di sistemi, non di grafici. Una rete di verifica non sopravvive solo con buone intenzioni. Sopravvive grazie a incentivi e penalità che spingono i partecipanti verso un lavoro onesto e lontano dalla manipolazione. Analisi pubbliche descrivono il modello di Mira come utilizzo di incentivi economici per i verificatori che si allineano con il consenso e penalità per comportamenti che sembrano manipolati o costantemente inaccurati. In quel contesto, $MIRA è meno “un simbolo” e più “l'impianto economico” che rende il processo di verifica costoso da manipolare e vantaggioso da gestire. Può anche supportare la governance in modo noioso ma necessario: chi può partecipare, come cambiano i parametri, cosa significano le soglie e come la rete evolve man mano che appaiono nuove modalità di errore.

E le modalità di errore appariranno. La verifica non è un incantesimo magico, è un sistema di pressione, e ogni sistema di pressione rivela punti deboli nel tempo. La prima evidente pressione è la scalabilità. Se scomponi tutto in richieste, puoi esplodere la quantità di lavoro che la rete deve fare. Hai bisogno di trasformazione delle richieste intelligente, instradamento intelligente e sufficiente capacità di calcolo per mantenere la latenza e il costo ragionevoli. C'è anche la sfida della partecipazione: hai bisogno di un numero sufficiente di verificatori diversi affinché il “consenso” non diventi un pensiero di gruppo, e hai bisogno di meccanismi che rendano difficile o costosa la collusione. Blocmates, ad esempio, discute la suddivisione del lavoro di verifica in modo che nessun singolo verificatore veda il contenuto completo, mirando a ridurre la manipolazione e preservare la privacy, e inquadra il processo come scomposizione delle richieste, verifica distribuita e un layer di consenso che produce un certificato crittografico.

Poi c'è la governance. Una rete di verifica alla fine deve decidere cosa significa “verificato” nei casi limite, come gestire verità dipendenti dal contesto e come prevenire che le regole si allontanino in qualcosa che serve più i grandi stakeholder che gli utenti finali. La governance non è solo votazione, è la disciplina di mantenere la definizione di verifica sufficientemente stabile da poter essere fidata mentre è abbastanza flessibile da migliorare.

C'è anche un rischio più sottile di cui le persone non parlano abbastanza: qualcosa può essere tecnicamente “vero” e comunque fuorviare attraverso omissione, inquadramento o enfasi selettiva. La verifica aiuta di più quando non si limita a timbrare “approvato”, ma mostra anche ciò che è stato controllato, ciò che è fallito e ciò che è rimasto incerto. Ecco perché il concetto di certificato è importante. Una vera ricevuta include le parti disordinate, non solo la conclusione.

Quando guardo ai segnali recenti di Mira, ciò che spicca è la spinta a rendere la verifica tangibile. Mira Verify è esplicitamente etichettato come beta ed è posizionato come qualcosa che i costruttori possono utilizzare come un layer API oggi. C'è anche un flusso costante di attenzione della comunità e spiegazioni che appaiono molto recentemente, incluso l'articolo “Cosa è Mira $MIRA ?” della pagina CMC AI di CoinMarketCap datato 5 marzo 2026, che indica che l'argomento è attivamente portato all'attenzione dei pubblici crypto mainstream in questo momento. E indipendentemente da come ti senti riguardo alle piattaforme social, il fatto che le discussioni sulla “layer di fiducia per l'AI” stiano apparendo ripetutamente su Binance Square nell'ultima settimana mostra che la narrativa sta passando da un discorso di ricerca di nicchia a un linguaggio quotidiano degli utenti, che è di solito il passo prima che inizino i veri test di adozione.

Se Mira ha successo, non sarà perché fa sembrare l'AI più intelligente. Sarà perché rende l'AI più facile da utilizzare quando il costo di avere torto è reale, costringendo gli output a venire con una catena di custodia invece di un tono sicuro.

@Mira - Trust Layer of AI #Mira $MIRA