Tutti sappiamo che l'AI può mentire con sicurezza in faccia a noi. Quando un chatbot ti dà una risposta massiccia di cinque paragrafi, è quasi impossibile sapere se un piccolo dettaglio nascosto nel mezzo è completamente inventato.

Stavo guardando come @Mira - Trust Layer of AI risolve effettivamente questo dietro le quinte, e il loro metodo è onestamente brillante. Si chiama Decomposizione della Richiesta.

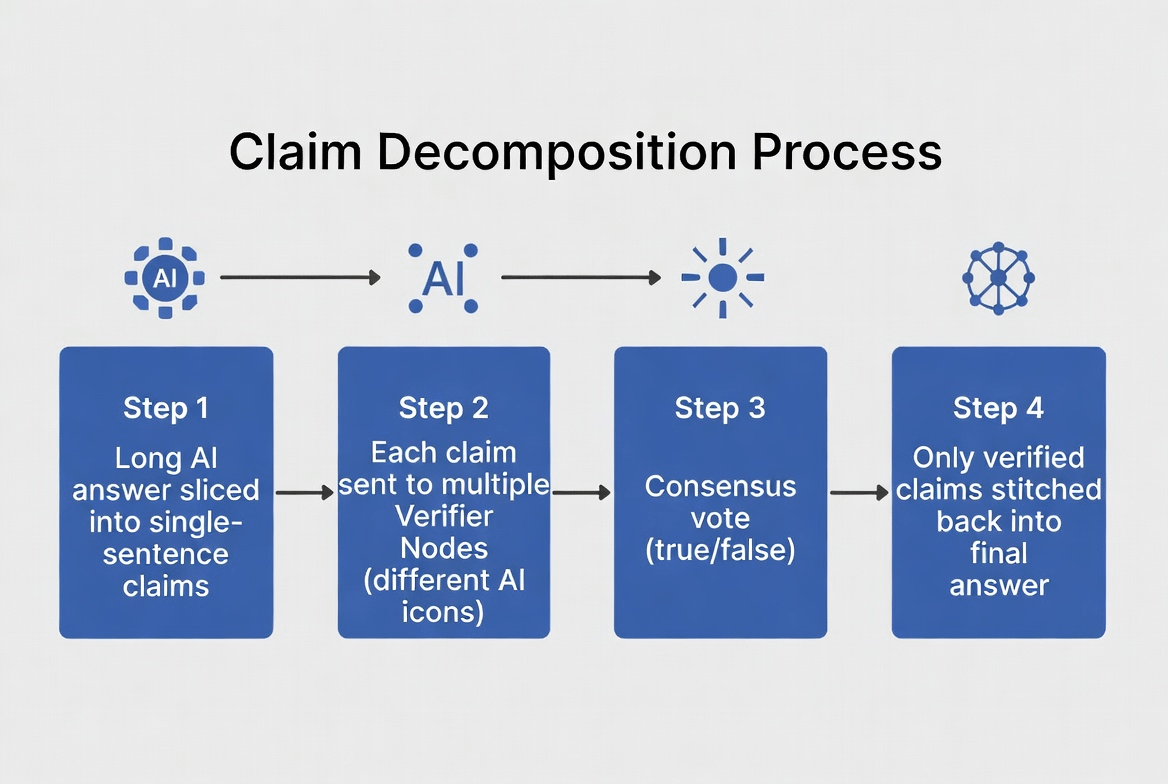

Invece di guardare a un'uscita AI massiccia e semplicemente indovinare se l'intera cosa sembra giusta, la rete letteralmente affetta il testo. Prende una grande risposta complicata e la scompone in fatti individuali e singoli.

Una volta che la risposta è suddivisa in questi piccoli pezzi, la rete invia ogni singolo fatto a un gruppo di diversi Nodi Verificatori. Questi nodi eseguono modelli di intelligenza artificiale completamente diversi. Esaminano il singolo fatto in isolamento e votano se è vero o falso.

Il sistema riunisce solo la risposta finale e la mostra all'utente quando la maggior parte di quei modelli indipendenti concorda effettivamente su ogni singolo pezzo del puzzle. Se una specifica frase è un'allucinazione, la rete la cattura, la isola e la scarta.

Questo è esattamente come arriviamo a un punto in cui possiamo effettivamente fidarci dell'IA per svolgere lavori reali nella sanità o nella finanza. Non ci si fida ciecamente della macchina; si costringe una rete decentralizzata a verificare ogni singola frase prima che arrivi allo schermo. $MIRA #Mira