$MIRA #Mira @Mira - Trust Layer of AI

Ultimamente ho trascorso più tempo a guardare come funziona realmente l'IA una volta che lascia il laboratorio e inizia a interagire con sistemi reali. Una cosa che continua a tornarmi in mente è questa semplice domanda: l'IA può generare risposte... ma qualcuno può davvero dimostrare che quelle risposte siano corrette?

La maggior parte dei modelli di IA oggi funziona sulla probabilità. Esaminano schemi in enormi quantità di dati e producono quella che pensano sia la risposta migliore. Molte volte funziona sorprendentemente bene. Ma non sempre.

Ecco dove le cose diventano interessanti.

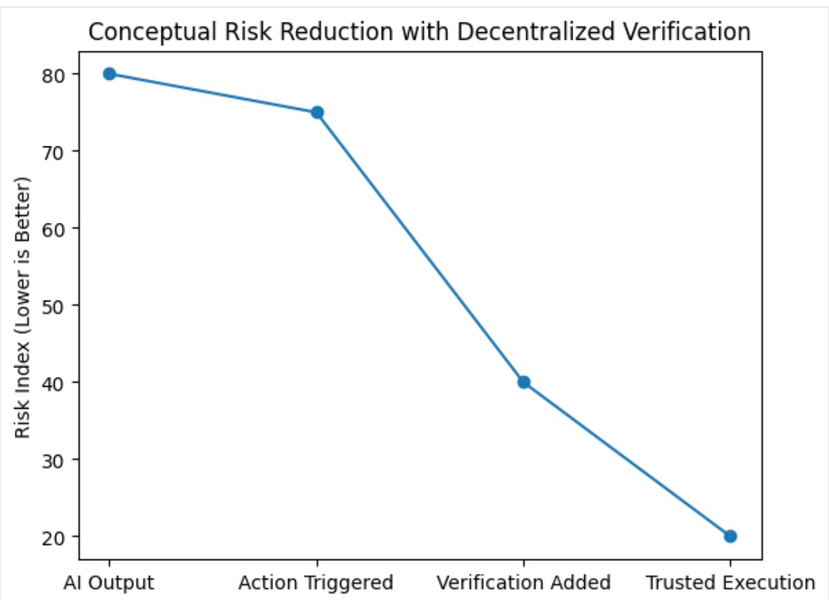

Perché quando l'IA inizia a interagire con sistemi reali — pagamenti, automazione, contratti intelligenti — una risposta sbagliata non è più solo un piccolo errore. Può attivare azioni reali, transazioni reali, a volte denaro reale che si muove.

Quando ho letto per la prima volta di MIRA, pensavo onestamente che fosse solo un'altra narrativa di token legata all'IA. La crypto ha molte di quelle ultimamente. Ma dopo aver scavato un po' più a fondo, l'idea dietro di essa ha iniziato a avere più senso.

MIRA non sta davvero cercando di competere con i modelli di IA stessi.

Invece sta esaminando un problema diverso: come puoi verificare che un output dell'IA sia effettivamente corretto prima che il sistema agisca su di esso?

La parte di cui le persone non parlano con l'IA

La maggior parte delle discussioni sull'IA si concentra sui modelli — modelli più grandi, modelli più intelligenti, modelli più veloci. Ma una volta che quei modelli iniziano a operare all'interno di applicazioni reali, c'è un altro strato che improvvisamente diventa importante.

Fiducia.

In questo momento, le aziende di solito risolvono quel problema con la supervisione umana. Qualcuno rivede l'output dell'IA, controlla se sembra ragionevole, forse esegue un secondo sistema di validazione.

Funziona, ma non è molto scalabile.

Se ogni decisione dell'IA ha ancora bisogno di un umano che la osservi, il sistema non diventa mai veramente autonomo.

Ecco perché la verifica diventa un grosso affare una volta che l'IA inizia a interagire con le reti decentralizzate.

Dove si inserisce MIRA

Ciò che mi ha colpito di MIRA è che tratta gli output dell'IA quasi come affermazioni che necessitano di prove.

Invece di assumere che la risposta sia corretta, la rete può eseguire passaggi di verifica che controllano se l'output soddisfa determinate condizioni.

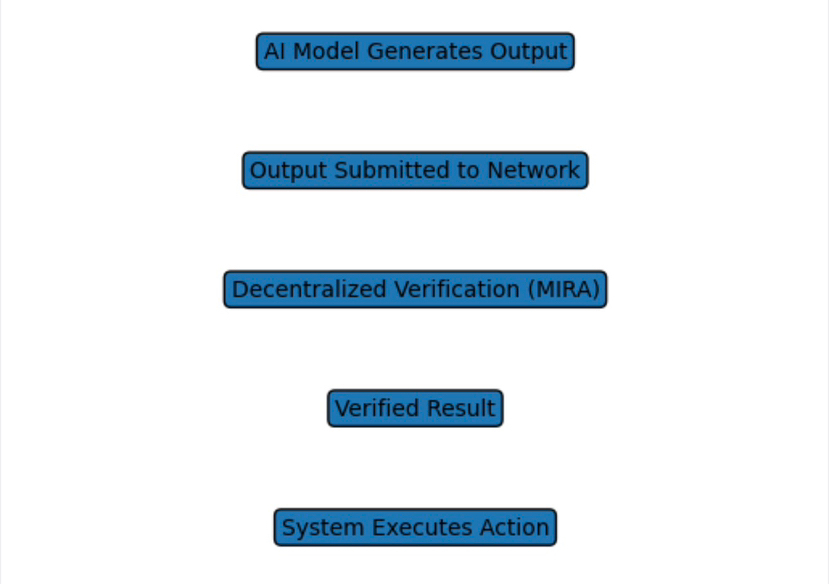

Quindi la struttura diventa qualcosa del genere:

L'IA genera la risposta. La verifica controlla la risposta. Poi il sistema decide se dovrebbe fidarsi di essa.

Sembra semplice, ma in realtà cambia da dove proviene la fiducia.

Normalmente le persone si fidano dell'azienda che gestisce il modello di IA.

Con i livelli di verifica, la fiducia proviene dal processo stesso, non dall'operatore.

Perché è importante per i sistemi decentralizzati

Una volta che l'IA inizia a interagire con l'infrastruttura blockchain, le cose diventano più complicate.

Gli agenti autonomi potrebbero attivare transazioni.

I robot potrebbero coordinare compiti.

I contratti intelligenti potrebbero reagire ai dati generati dall'IA.

Se quegli output sono sbagliati e nessuno li verifica, l'intero sistema diventa fragile.

Ecco perché trovo l'idea del livello di verifica piuttosto interessante.

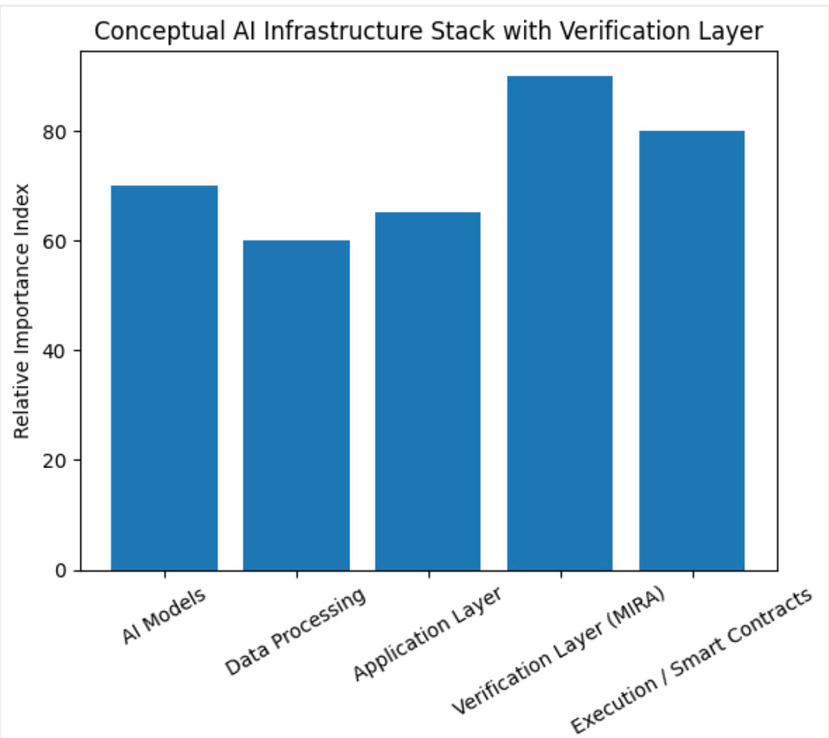

Suggerisce che il futuro stack dell'IA potrebbe apparire in questo modo:

modelli generando intelligenza livelli di verifica confermando i risultati e sistemi decentralizzati che agiscono su quegli output verificati

In quella struttura, l'IA non produce solo risposte. Produce affermazioni che la rete può testare.

Uno strato diverso della narrativa dell'IA

Una cosa che ho notato nella crypto è che ogni ciclo tende a concentrarsi su un diverso strato infrastrutturale.

DeFi aveva protocolli di liquidità. Gli NFT avevano mercati. I Layer-2 si concentravano sulla scalabilità.

L'IA potrebbe seguire uno schema simile.

Ma i progetti importanti potrebbero non essere solo quelli che costruiscono modelli. Potrebbero anche essere quelli che risolvono il problema di fiducia intorno agli output dell'IA.

Quella è la parte che MIRA sembra esplorare.

E se i sistemi di IA decentralizzati diventano più comuni, la verifica potrebbe finire per essere importante quanto i modelli stessi.

Pensiero Finale

L'IA può generare risposte. Quella parte è già impressionante.

Ma una volta che quelle risposte iniziano a influenzare sistemi reali, qualcosa di diverso diventa necessario — prova che la risposta è effettivamente corretta.

Questa è l'idea dietro MIRA.

Non sostituire i modelli di IA. Non competere con loro.

Solo per assicurarmi che quando l'IA dice qualcosa... la rete possa effettivamente verificarlo.

E onestamente, potrebbe finire per essere uno dei pezzi di infrastruttura più importanti mentre l'IA e i sistemi decentralizzati iniziano a fondersi.

Curioso di sapere cosa pensano gli altri a riguardo:

Man mano che l'IA continua a integrarsi nella crypto e nei sistemi autonomi, cosa avrà più importanza a lungo termine — modelli migliori o modi migliori per verificare gli output?