Ho passato del tempo a cercare di capire come funzioni effettivamente Mira Network, non solo cosa afferma di risolvere. Più leggo la progettazione del protocollo e le discussioni tecniche su @Mira - Trust Layer of AI , più diventa chiaro che non si tratta di costruire un altro modello di IA. Si tratta di creare uno strato di verifica per l’IA stessa.

Quella distinzione conta.

Al momento, la maggior parte dei sistemi di IA opera in un ciclo chiuso. Un modello genera una risposta, e o ci fidiamo di essa o no. Se esiste una fase di convalida, di solito si tratta di un altro modello della stessa azienda che verifica l’output, oppure di una serie di barriere di sicurezza private sovrapposte. Funziona fino a un certo punto, ma rimane comunque centralizzato. La stessa entità produce, valuta e infine decide cosa è accettabile.

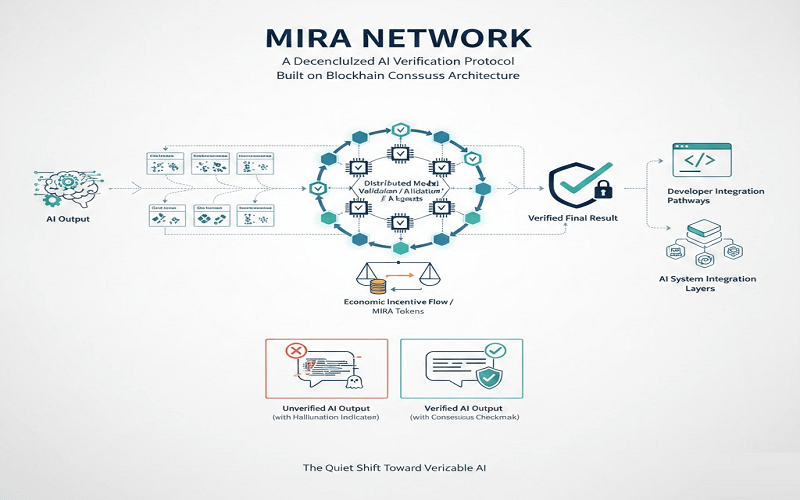

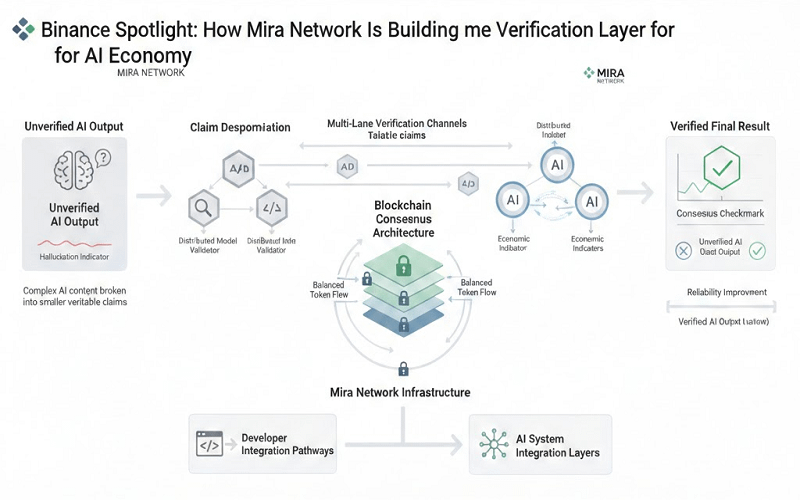

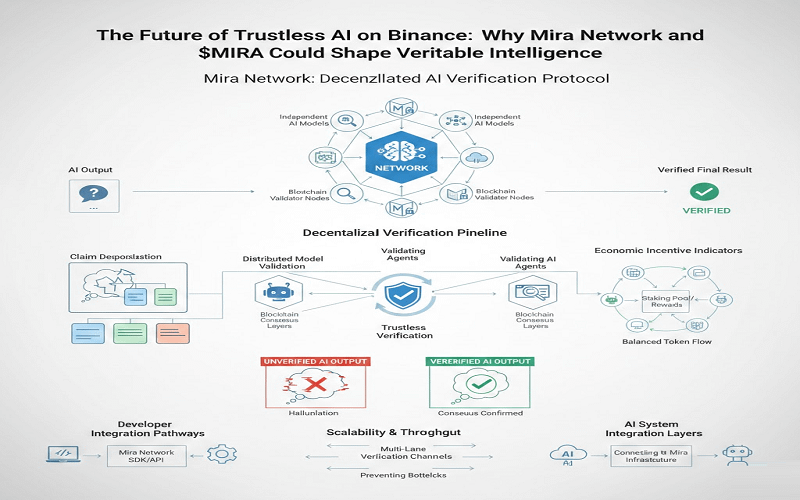

Mira affronta il problema in modo diverso. Invece di chiedere a un modello di verificarsi, suddivide le uscite AI in affermazioni più piccole e testabili. Ogni affermazione può poi essere controllata indipendentemente da più modelli attraverso una rete decentralizzata. Pensalo come trasformare un lungo saggio in un elenco di affermazioni fattuali, per poi inviare quelle affermazioni a un gruppo distribuito di revisori che non condividono gli stessi punti ciechi.

Qui entra in gioco il livello blockchain.

I risultati della verifica non sono solo memorizzati in un database privato. Sono ancorati attraverso meccanismi di consenso e prove crittografiche. Ciò significa che il processo di convalida può essere verificato e rintracciato. Nelle pipeline AI tradizionali, di solito devi fidarti della parola del fornitore che sono state applicate delle protezioni. Nella struttura di Mira, la logica di verifica e i risultati possono essere confermati indipendentemente.

Sembra simile a come funzionano le reti di verifica dei fatti nei media. Invece di fidarsi di un singolo editore, più revisori indipendenti controllano la stessa affermazione. Se la maggior parte di loro è d'accordo, la fiducia aumenta. Se non sono d'accordo, quel disaccordo è visibile. Mira sta cercando di codificare quella logica nell'infrastruttura piuttosto che nella politica.

Il token, $MIRA, svolge un ruolo funzionale qui. I validatori sono economicamente incentivati a fornire valutazioni accurate. Se un partecipante produce ripetutamente convalide inaffidabili, rischia di perdere ricompense. L'idea è semplice: allineare gli incentivi finanziari con la verifica veritiera. Se questo modello si scalda in modo pulito è ancora una domanda aperta, ma la logica è coerente.

Ciò che mi colpisce di #MiraNetwork è che non cerca di competere direttamente con i grandi laboratori AI. Presuppone che modelli potenti continueranno a esistere. Invece, si posiziona come un livello neutro tra le uscite AI e le applicazioni di uso reale, i sistemi finanziari, gli strumenti di ricerca o i motori di decisione automatizzati.

Quel livello neutro potrebbe essere importante.

Le allucinazioni AI non sono casi rari. Sono strutturali. I modelli prevedono schemi linguistici; non comprendono intrinsecamente la verità. Anche il pregiudizio si insinua attraverso i dati di addestramento. La supervisione centralizzata può mitigare parte di questo, ma dipende sempre dalle politiche e dagli incentivi di un'organizzazione.

Un protocollo di verifica decentralizzato distribuisce quella responsabilità. In teoria, riduce la possibilità che un singolo punto di guasto, pregiudizio o manipolazione definisca l'esito.

Certo, ci sono vincoli reali.

Eseguire più modelli AI per convalidare ogni affermazione aumenta il costo computazionale. Coordinare i validatori decentralizzati introduce latenza e complessità. C'è anche una crescente concorrenza nell'infrastruttura AI decentralizzata, con diversi protocolli che cercano di risolvere pezzi adiacenti del puzzle. E l'ecosistema attorno a $MIRA è ancora in fase di sviluppo. Strumenti, percorsi di integrazione e adozione da parte degli sviluppatori richiederanno tempo.

Ma come concetto, Mira sembra meno speculativa e più strutturale.

Se l'AI sta diventando parte integrante della finanza, della governance, della moderazione dei contenuti e dei flussi di lavoro automatizzati, allora la verifica non dovrebbe essere un pensiero secondario. Probabilmente ha bisogno della propria infrastruttura. #Mira inquadra quell'infrastruttura come qualcosa che dovrebbe essere aperto, verificabile e allineato agli incentivi piuttosto che controllato privatamente.

Dopo averci guardato, non lo vedo come un progetto AI appariscente. Lo vedo come un tentativo silenzioso di formalizzare il dubbio in un protocollo.

E questo potrebbe essere la direzione più durevole.