Dopo aver passato del tempo a studiare come è strutturata la Mira Network, sono arrivato a vederla meno come un progetto AI e più come un sistema di coordinamento economico costruito attorno all'affidabilità dell'AI.

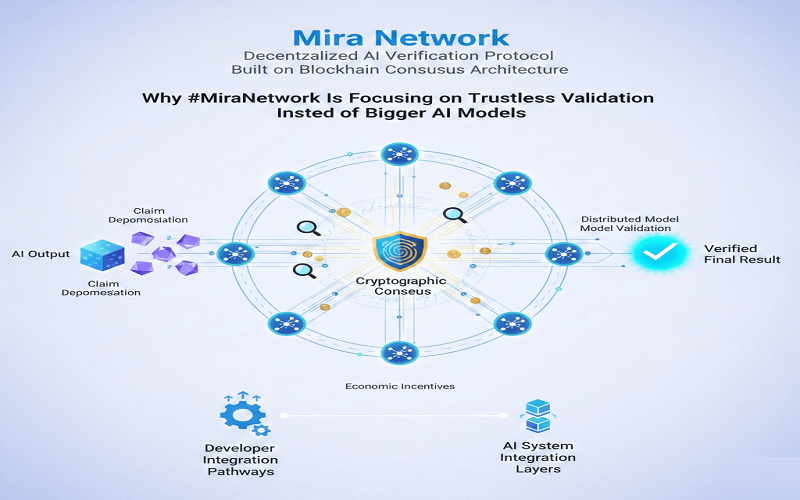

La maggior parte delle discussioni sull'AI si concentra su se i modelli siano abbastanza potenti. Mira guarda a uno strato diverso del problema. Si chiede cosa succede dopo che un modello genera una risposta. Come possiamo sapere se è corretto, imparziale o logicamente valido senza fidarci del fornitore del modello stesso?

Questo cambiamento di focus è importante.

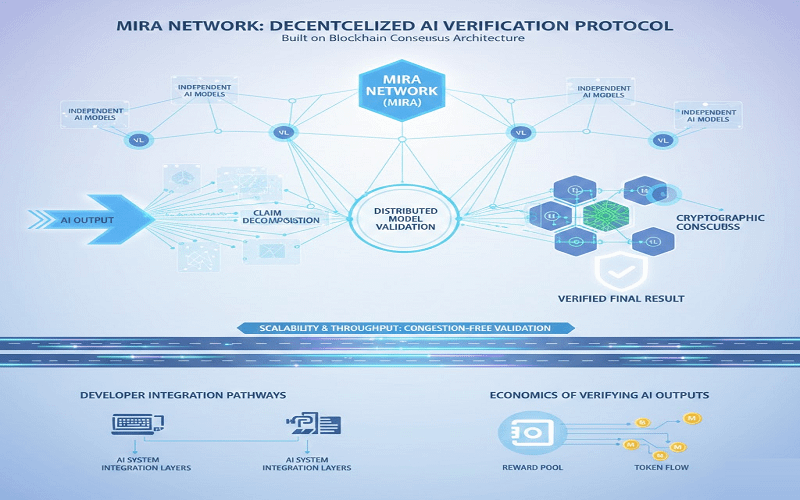

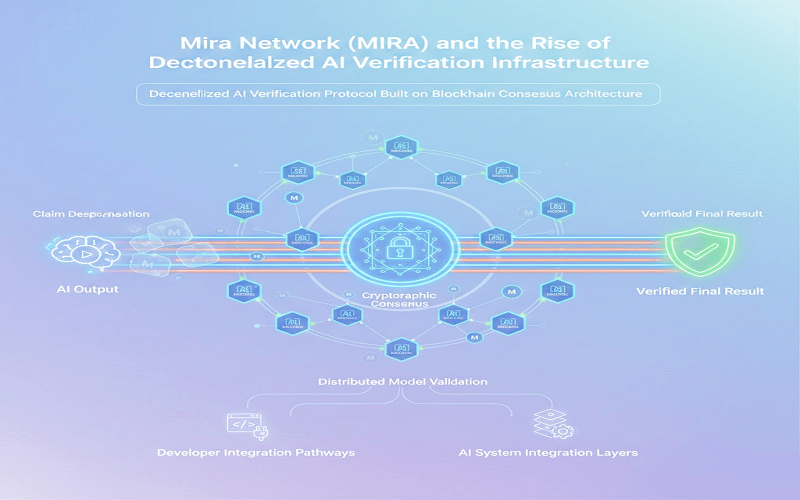

#MiraNetwork si posiziona come un protocollo di verifica decentralizzato. Invece di assumere che un grande modello possa autocorreggersi, tratta ogni output AI come qualcosa che dovrebbe essere controllato esternamente. Non da un'azienda. Non da un team di audit interno chiuso. Ma da una rete distribuita che non ha un singolo punto di controllo.

Ecco dove la struttura diventa interessante.

Quando un sistema AI produce una risposta, Mira suddivide quel risultato in affermazioni più piccole e strutturate. Pensalo come separare un lungo paragrafo in singole affermazioni che possono essere esaminate ciascuna. Un'affermazione potrebbe fare riferimento a una statistica. Un'altra potrebbe affermare una relazione causale. Un'altra potrebbe basarsi su un dettaglio fattuale.

Ognuna di quelle affermazioni può quindi essere valutata in modo indipendente.

Diversi modelli AI all'interno della rete agiscono come validatori. Valutano se un'affermazione è coerente con i dati noti, internamente coerente o potenzialmente fabbricata. Il risultato finale della validazione non dipende dall'opinione di un modello. Emergere dal consenso distribuito tra più validatori.

Questo è più vicino a un consorzio di verifica dei fatti che a un tradizionale pipeline AI.

Nei sistemi AI centralizzati, la stessa entità addestra il modello, lo distribuisce e definisce le metriche di valutazione. Anche se ci sono buone intenzioni, il controllo rimane concentrato. Mira separa generazione da verifica. Quella separazione è strutturale, non cosmetica.

Il consenso basato su blockchain ancorerà i risultati.

I registri di validazione sono scritti on-chain, supportati da verifica crittografica. Ciò significa che una volta che un'affermazione è stata validata e il consenso è stato raggiunto, il registro non può essere modificato silenziosamente. La fiducia non deriva dal credere all'operatore. Deriva dalla trasparenza verificabile.

Questo è dove $MIRA gioca un ruolo pratico.

I validatori partecipano alla rete con incentivi economici allineati attorno a un comportamento onesto. I meccanismi di staking e le strutture di ricompensa sono progettati in modo che la verifica accurata venga premiata, mentre la validazione negligente o malevola diventi costosa. Il token funge da strumento di coordinamento all'interno di questa economia di verifica.

Non si tratta di sostituire la fiducia con il branding. Si tratta di sostituire la fiducia nelle istituzioni con fiducia nel design del meccanismo.

Dalla lettura degli aggiornamenti condivisi da @Mira - Trust Layer of AI , l'accento ritorna costantemente su questa idea di validazione senza fiducia. Il protocollo presuppone che i sistemi AI a volte possano allucinare o riflettere pregiudizi. Invece di cercare di eliminare completamente quei difetti, costruisce uno strato di verifica che li tratta come rischi attesi.

Ci sono casi d'uso pratici per questo approccio.

I rapporti di ricerca finanziaria generati dall'AI potrebbero essere verificati prima della pubblicazione. I riassunti di conformità automatizzati potrebbero essere controllati incrociando prima della sottomissione. Anche le piattaforme di contenuti assistite da AI potrebbero integrare la verifica distribuita per ridurre il rischio di disinformazione.

Tuttavia, ci sono limiti.

Eseguire più modelli di validazione aumenta il sovraccarico computazionale. Coordinare validatori indipendenti introduce latenza. C'è anche una vera competizione nell'infrastruttura AI decentralizzata, e l'ecosistema più ampio è ancora nelle prime fasi in termini di strumenti e adozione.

Un'altra sfida è la diversità. Se i modelli di validazione si basano su dati di addestramento o architetture simili, il consenso potrebbe non eliminare completamente i punti ciechi condivisi. La verifica distribuita riduce il rischio, ma non garantisce una neutralità perfetta.

Detto ciò, l'idea centrale dietro #Mira sembra essere ben fondata.

Invece di promettere AI più intelligenti, si concentra su AI verificabile. Invece di chiedere agli utenti di fidarsi di un fornitore, crea un sistema in cui la verifica stessa diventa trasparente e strutturata economicamente.

In un panorama in cui i risultati dell'AI influenzano sempre di più le decisioni, costruire un secondo strato che controlli quei risultati sembra meno un aggiornamento e più una necessità.

E sebbene non si scaldi perfettamente, lo sforzo di formalizzare la verifica come infrastruttura è una direzione riflessiva da esplorare. #GrowWithSAC