Quando sento "le uscite dell'IA possono essere verificate criptograficamente" la mia prima reazione non è entusiasmo. È scetticismo. Non perché la verifica non sia importante, ma perché la maggior parte delle volte ciò che le persone chiamano "affidabilità dell'IA" è solo un post processing avvolto in un branding migliore. Se gli incentivi sottostanti non cambiano, gli errori non scompaiono, si presentano solo in modo più pulito.

Quindi la vera domanda non è se l'IA possa essere controllata. È chi fa il controllo, chi paga per esso e chi è responsabile quando qualcosa sfugge.

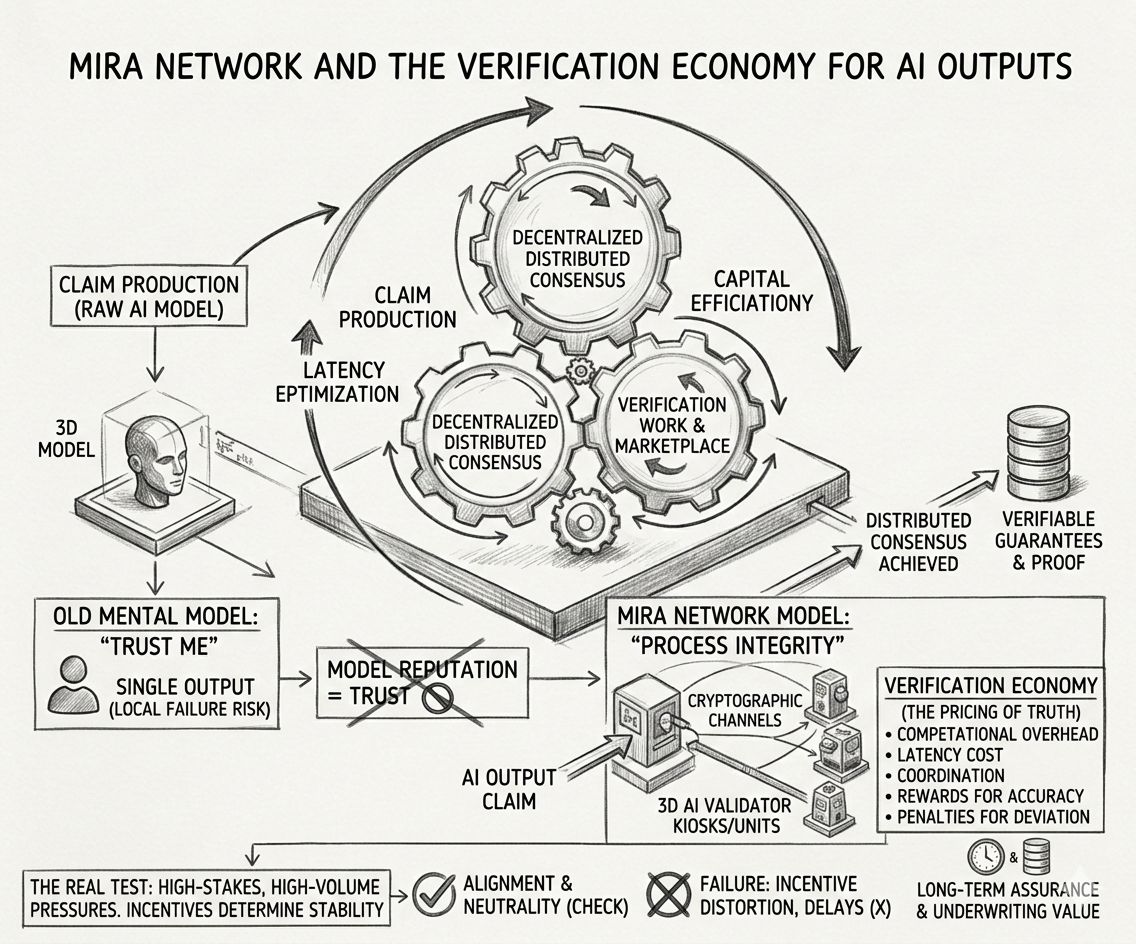

La maggior parte dei sistemi IA oggi opera su un modello 'fidati di me'. Fai una domanda, ricevi una risposta e a meno che tu non la controlli manualmente, il sistema prosegue. Quel modello funziona per casi d'uso a basso rischio. Si rompe rapidamente in ambienti dove le decisioni hanno peso finanziario, operativo o normativo. Il fallimento non è nell'intelligenza, ma nella verifica.

Mira Network affronta questo in modo diverso. Invece di trattare i risultati come prodotti finali, li tratta come affermazioni. Le affermazioni possono essere contestate, scomposte, esaminate e validate attraverso consenso distribuito. Quel cambiamento sembra sottile, ma strutturalmente cambia dove risiede la fiducia.

In un'impostazione tradizionale, il fornitore del modello possiede il risultato. Se si verifica un'illusione, la responsabilità è vaga. In un'economia di verifica, i risultati diventano oggetti che passano attraverso uno strato aggiuntivo progettato per testare la coerenza, rilevare contraddizioni e produrre prove crittografiche attorno al risultato finale. La fiducia si sposta dalla reputazione del modello all'integrità del processo.

Ma la verifica non è gratuita. C'è sempre un costo: sovraccarico computazionale, latenza e coordinamento. Una volta che introduci più modelli o validatori per controllare un'affermazione, stai effettivamente costruendo un mercato attorno alla correttezza. I partecipanti contribuiscono al lavoro di verifica. Vengono ricompensati per l'accuratezza e penalizzati per le deviazioni. Questo crea una superficie di prezzo per la verità.

Qual è il costo per verificare un'affermazione? Chi decide quanto è sufficiente la verifica? Ogni risultato richiede lo stesso livello di scrutinio?

Queste domande definiscono i contorni di un'economia di verifica.

In un sistema del genere, la domanda non si concentra solo sull'intelligenza grezza del modello. Si concentra su garanzia. Le imprese, gli agenti autonomi e i sistemi finanziari non hanno bisogno solo di risposte, hanno bisogno di risposte che possano resistere a un audit. Quando l'IA diventa parte di flussi di lavoro automatizzati, 'probabilmente corretto' smette di essere sufficiente. Hai bisogno di garanzie verificabili.

È qui che la validazione distribuita diventa più di una funzione. Diventa infrastruttura.

Se i risultati sono suddivisi in componenti verificabili più piccole, ogni componente può essere valutato indipendentemente. L'accordo tra modelli diversi aumenta la fiducia. Il disaccordo attiva una rivalutazione. Nel tempo, questo crea un feedback loop in cui la correttezza non è assunta, ma negoziata e confermata.

Ma questo introduce nuove dinamiche.

Uno strato di verifica concentra l'influenza tra coloro che gestiscono i validatori e progettano meccanismi di contenzioso. Se gli incentivi sono male allineati, i validatori potrebbero ottimizzare per la velocità anziché per la rigorosità. Se la governance è debole, alcune affermazioni potrebbero ricevere un trattamento preferenziale. L'affidabilità quindi dipende non solo dalla crittografia, ma anche dall'allineamento economico.

Le modalità di fallimento evolvono anche. In un mondo a modello singolo, il fallimento è locale: la risposta era sbagliata. In un'economia di verifica, il fallimento può essere sistemico: collusione tra validatori, distorsioni degli incentivi, conferme ritardate durante la congestione o picchi di costo durante la volatilità. Gli utenti potrebbero ancora sperimentare questo semplicemente come 'l'IA era lenta' o 'l'IA ha fallito', ma la causa risiede in uno strato di coordinamento più profondo.

Questo non rende il modello difettoso. In molti modi, è l'evoluzione necessaria. Man mano che i sistemi IA si spostano verso l'esecuzione autonoma attivando pagamenti, controllando macchine, negoziando contratti, richiedono meccanismi di verità esternalizzati. La verifica diventa il guardrail tra automazione e caos.

C'è anche un sottile spostamento nella cattura del valore. Oggi, la maggior parte del valore si accumula ai creatori di modelli. In un'economia di verifica, il valore inizia a fluire verso coloro che garantiscono l'affidabilità. I fornitori di verifica diventano strati di sottoscrizione per le decisioni guidate dall'IA. Più critica è l'applicazione, più preziosa diventa quella sottoscrizione e, una volta che l'affidabilità è valutata, la competizione cambia.

Le piattaforme IA non concorreranno solo sulla creatività o sulla velocità. Concorreranno sulla verificabilità. Quanto frequentemente i risultati superano la validazione? Quanto è trasparente il processo di contenzioso? Quanto è resiliente la rete sotto stress? Quanto sono prevedibili i costi di verifica?

In ambienti tranquilli, quasi qualsiasi strato di verifica può apparire robusto. La vera prova emerge durante momenti ad alto rischio e alto volume, quando risultati errati potrebbero cascata in perdite finanziarie o danni operativi. È allora che la progettazione degli incentivi, la diversità dei validatori e i meccanismi di governance determinano se il sistema assorbe la pressione o la amplifica.

Quindi non vedo questo semplicemente come 'IA con controlli aggiuntivi'. Lo vedo come l'inizio di uno spostamento strutturale in cui intelligenza e verifica si disaccoppiano in mercati separati ma interdipendenti. Uno produce affermazioni. L'altro prezza la fiducia.

Il valore a lungo termine di questo design non sarà misurato da quante volte i risultati sono corretti in condizioni ideali. Sarà misurato da come si comporta lo strato di verifica quando gli incentivi sono messi alla prova, quando i modelli discordano fortemente e quando la pressione esterna mette alla prova la neutralità.

La vera domanda non è se i risultati dell'IA possano essere verificati. È chi finanzia quella verifica, come sono incentivati e cosa succede quando il costo di avere torto diventa molto alto.

@Mira - Trust Layer of AI $MIRA #Mira

#BitcoinGoogleSearchesSurge #USIsraelStrikeIran