L'industria dell'IA ha a lungo evitato una questione critica: quando un sistema di IA causa danni nel mondo reale, chi è realmente responsabile? Questo non è teorico—riguarda carriere che vengono terminate, indagini avviate o risarcimenti da milioni di dollari. In questo momento, non c'è una risposta chiara, e questa incertezza è il più grande ostacolo all'adozione completa dell'IA nelle istituzioni. Il problema non è il costo, la qualità del modello o la complessità dell'integrazione—è la mancanza di responsabilità.

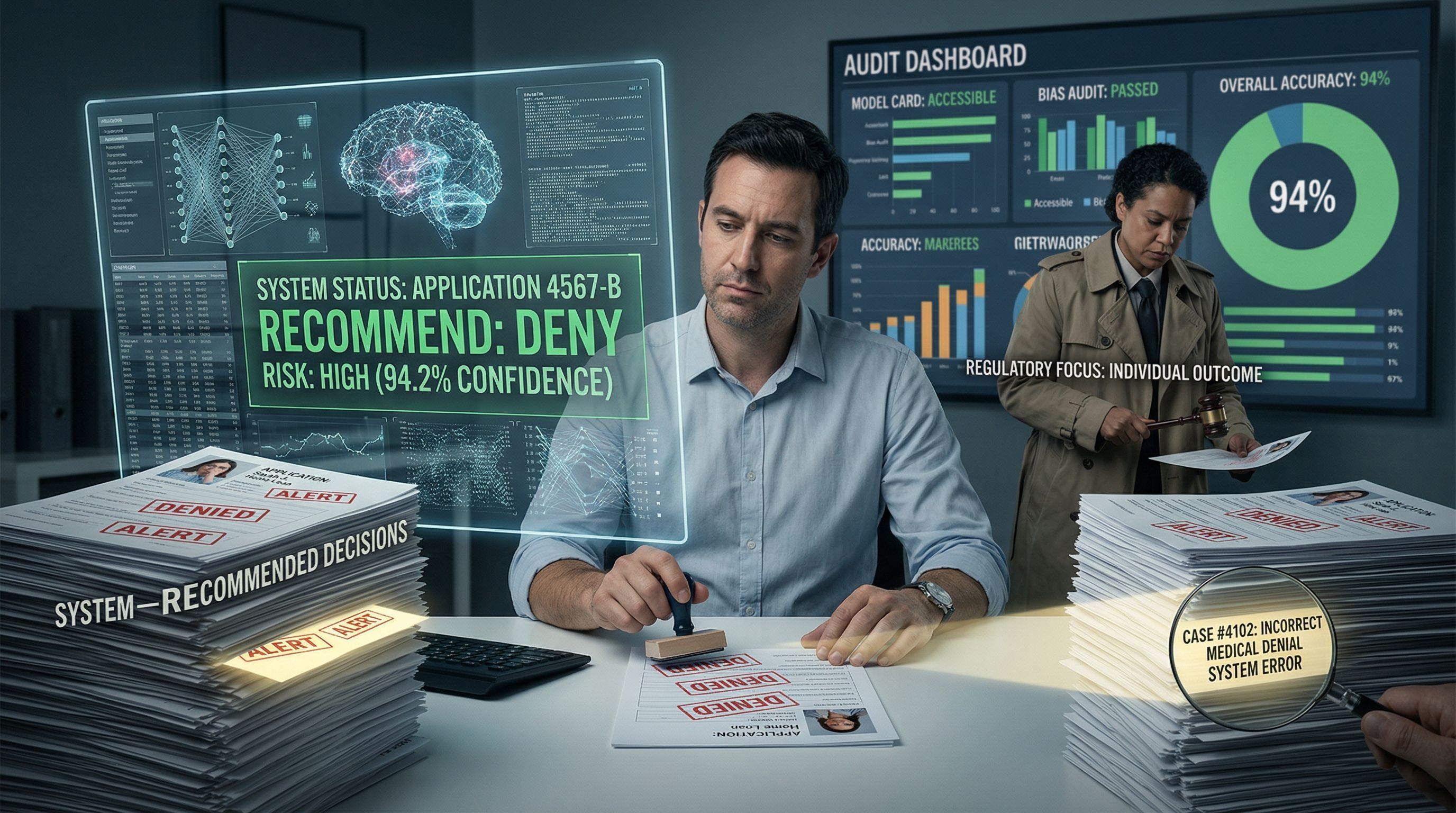

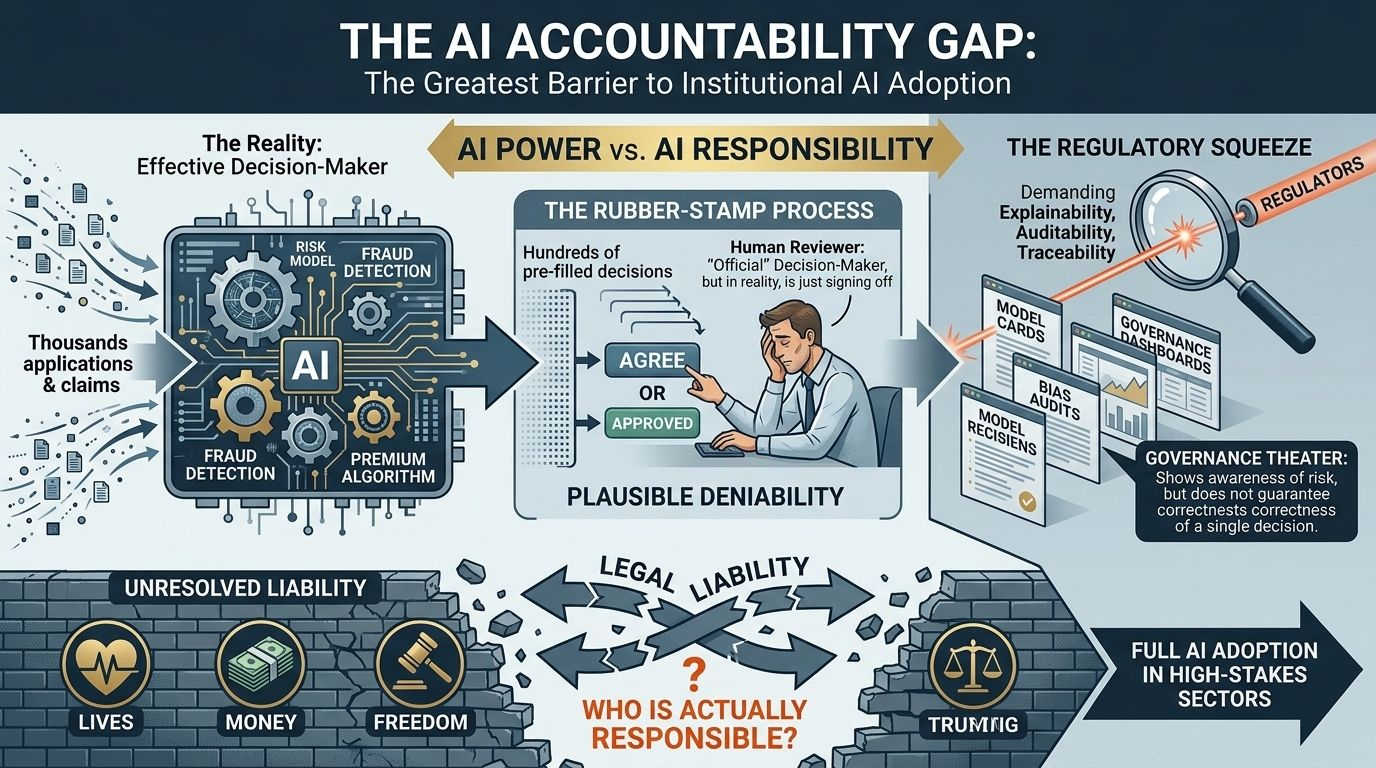

La maggior parte dei sistemi di intelligenza artificiale sono presentati come consulenti, non come decisori. Un modello di credito può segnalare qualcuno come rischioso, un algoritmo assicurativo può suggerire un premio, e un sistema di rilevamento delle frodi può sollevare un allerta. Ufficialmente, un umano approva, quindi il modello "non prende la decisione." Ma nella realtà, dopo aver elaborato migliaia di domande o richieste, gli esseri umani spesso approvano semplicemente ciò che l'IA ha già scelto. L'IA non sta più suggerendo—sta effettivamente decidendo. Le organizzazioni guadagnano i benefici di efficienza mantenendo al contempo una plausibile negabilità quando le cose vanno male.

I regolatori stanno iniziando a mettersi al passo. In tutti i settori della finanza, delle assicurazioni e di altri ambiti ad alto rischio, le nuove norme richiedono che i sistemi di AI siano spiegabili, verificabili e tracciabili. L’industria risponde con schede dei modelli, audit sul bias e dashboard che mostrano il comportamento dell’AI. Tuttavia, queste misure non risolvono il problema centrale. Esse dimostrano una consapevolezza del rischio, ma non garantiscono che una determinata decisione sia corretta. In ambiti in cui sono in gioco vite, denaro o libertà, le prestazioni generali del modello sono prive di significato.

L’accuratezza viene spesso sopravvalutata. Un modello potrebbe essere corretto in media al 94%, ma il restante 6% può rovinare una domanda di mutuo, classificare erroneamente una richiesta di indennizzo assicurativo o negare un intervento medico. Gli auditor non guardano alle medie; i regolatori non esaminano le prestazioni aggregate. I tribunali si concentrano sui singoli risultati che hanno causato danni. La responsabilità nell’AI riguarda la singola decisione, non le tendenze statistiche.

È qui che la verifica decentralizzata cambia le regole del gioco. Anziché chiedersi se un modello è generalmente affidabile, si chiede se un determinato risultato è stato verificato. Non si tratta di fidarsi dell’AI in teoria – si tratta di confermare che proprio questa decisione possa essere sostenuta. Proprio come un produttore redige registri di ispezione per ogni prodotto, le decisioni dell’AI possono avere registri verificabili.

Un simile sistema modifica anche gli incentivi. I validatori che confermano i risultati vengono premiati per l’accuratezza e puniti per la negligenza. Ogni decisione diventa verificabile e soggetta a responsabilità. Le istituzioni possono dimostrare che i singoli risultati sono stati verificati – non solo che l’AI di solito ottiene buoni risultati. Questo registro può fare la differenza tra conformità e violazione, tra fiducia e responsabilità.

La verifica comporta dei costi. Può rallentare i processi, aggiungere complessità e sollevare sfide operative. In ambienti ad alta velocità, anche piccoli ritardi possono essere inaccettabili. Restano ancora questioni legali: se una decisione verificata causa poi dei danni, chi ne risponde – il validatore, l’organizzazione o lo sviluppatore dell’AI? Finché non esisteranno norme formali per la verifica distribuita dell’AI, le istituzioni rimarranno prudenti.

La realtà è chiara: l’AI sta già prendendo decisioni che influenzano il denaro, le opportunità e le libertà delle persone. Questi ambiti operano all’interno di rigorosi quadri di accountability. Se l’AI ne fa parte, non può sfuggire agli stessi standard. La fiducia si costruisce una decisione alla volta, attraverso processi chiari che attribuiscono la responsabilità quando le cose vanno male. La responsabilità non è facoltativa – è essenziale.

Se vuoi, posso anche creare una versione breve e adatta ai social media di questo articolo, per piattaforme come Twitter o LinkedIn, che metta in evidenza i punti principali e includa un invito all’azione per $MIRA

$MIRA

$MIRA