Dopo aver trascorso del tempo a leggere come è strutturata la Mira Network, ho iniziato a vederla meno come un altro progetto blockchain e più come un tentativo di affrontare qualcosa di più profondo: il divario di affidabilità nei sistemi di intelligenza artificiale.

La maggior parte dei modelli di intelligenza artificiale oggi, indipendentemente da quanto siano avanzati, produce ancora allucinazioni. Generano risposte che sembrano corrette ma non lo sono. Nei sistemi centralizzati, la responsabilità di risolvere questo problema è dell'azienda che gestisce il modello. Audit interni, messa a punto e strati di sicurezza avvengono tutti a porte chiuse. Gli utenti devono fidarsi del fornitore.

La rete Mira prende una strada diversa.

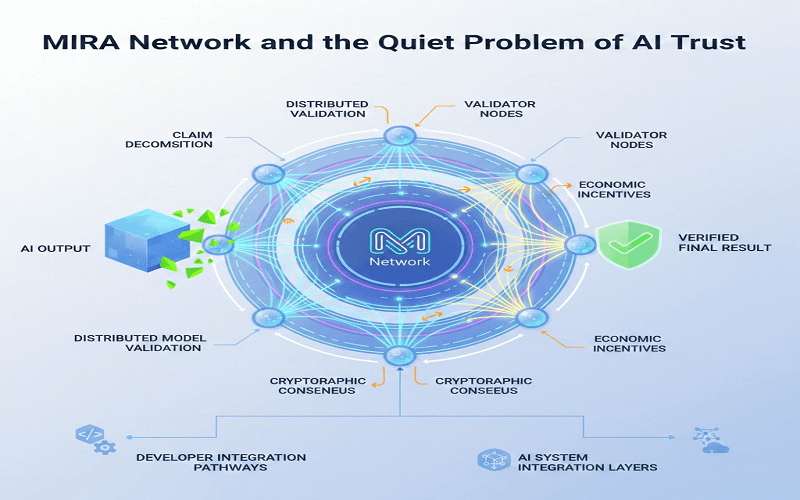

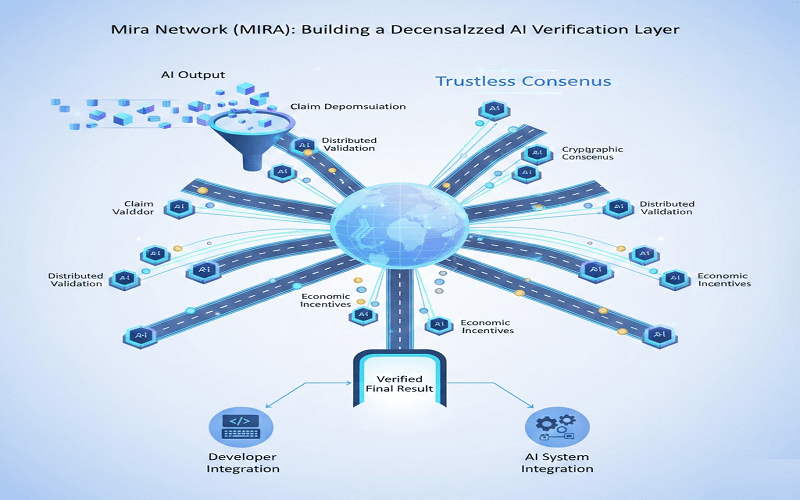

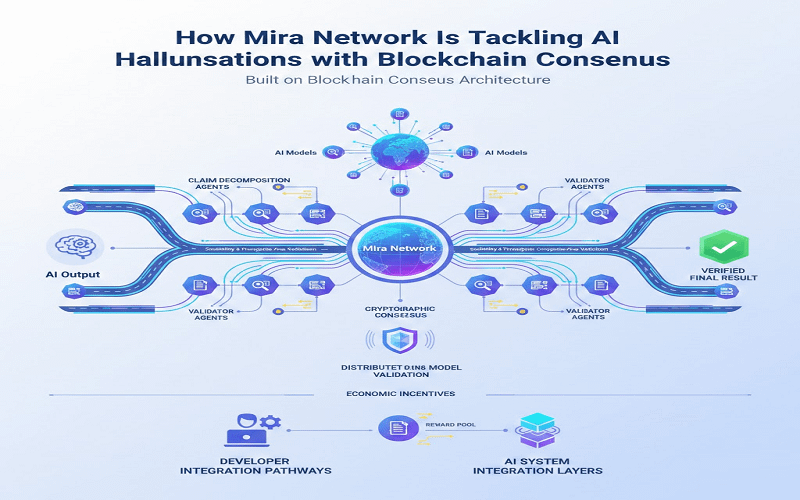

Invece di presumere che un modello possa essere reso perfettamente affidabile, tratta gli output di AI come affermazioni che necessitano di verifica. Quando un'AI genera una risposta, il protocollo di Mira suddivide quell'output in dichiarazioni fattuali più piccole. Quelle affermazioni vengono poi distribuite tra modelli indipendenti nella rete per la convalida incrociata. Se abbastanza di esse concordano, l'affermazione guadagna fiducia. Se divergono, viene segnalata.

Mi ricorda come funziona il fact-checking nel giornalismo. Un singolo reporter potrebbe scrivere una storia, ma editori e fonti indipendenti la esaminano prima della pubblicazione. Mira cerca di formalizzare quel processo in uno strato di protocollo.

La differenza importante è che questa validazione non si basa su un'autorità centrale. Utilizza il consenso basato su blockchain e prove crittografiche per registrare il processo di validazione. Il risultato non è 'fidati di noi'. È una prova verificabile che più sistemi indipendenti hanno raggiunto conclusioni simili.

È qui che l'elemento blockchain diventa pratico piuttosto che simbolico.

Invece di memorizzare grandi output di AI direttamente sulla catena, Mira registra i risultati di verifica e le prove. I validatori sono incentivati economicamente attraverso il $MIRA token. Se forniscono validazioni accurate, vengono premiati. Se si comportano in modo disonesto, il sistema può penalizzarli. L'obiettivo non è la perfezione; è l'allineamento degli incentivi verso una verifica onesta.

Quando ho esaminato gli aggiornamenti e la documentazione di @Mira - Trust Layer of AI , ciò che si è distinto non erano grandi promesse. Era l'enfasi sulla validazione strutturata. Il protocollo non cerca di sostituire grandi modelli di AI. Si trova sotto di essi, come uno strato di verifica.

Nella distribuzione tradizionale dell'AI, un'azienda rilascia un modello e forse aggiunge uno strumento di monitoraggio. In #MiraNetwork , la validazione diventa un'infrastruttura decentralizzata. Qualsiasi applicazione che si basa su AI—analisi finanziaria, strumenti di ricerca, generazione di contenuti potrebbe teoricamente collegarsi a questo livello per controllare gli output prima di agire su di essi.

Quella separazione è sottile ma importante.

Invece di chiedere, 'Questo AI è intelligente?', Mira chiede, 'Possiamo verificare ciò che ha appena detto?'

Certo, il sistema non è privo di sfide. Suddividere gli output di AI in affermazioni strutturate aggiunge un sovraccarico computazionale. Eseguire più modelli per la validazione incrociata aumenta i costi. La coordinazione tra i validatori introduce complessità. E lo spazio dell'AI decentralizzata più ampio sta diventando competitivo, con altri protocolli che esplorano modelli simili di verifica o condivisione di calcolo.

C'è anche la realtà che l'ecosistema è ancora all'inizio. Gli strumenti, l'adozione da parte degli sviluppatori e la standardizzazione richiederanno tempo. Uno strato di verifica diventa significativo solo quando le applicazioni lo integrano in modo coerente.

Tuttavia, trovo la cornice convincente.

Invece di inseguire modelli più grandi, #Mira si concentra sulla responsabilità tra i modelli. Accetta che le allucinazioni non scompariranno dall'oggi al domani. Invece, costruisce un sistema distribuito che riduce la fiducia cieca e la sostituisce con un consenso registrato.

Quel passaggio da un'assicurazione centralizzata a una validazione senza fiducia sembra essere il vero esperimento qui.

E che si scaldi o meno, riflette un crescente riconoscimento che l'intelligenza da sola non è sufficiente; la verifica conta altrettanto. #GrowWithSAC