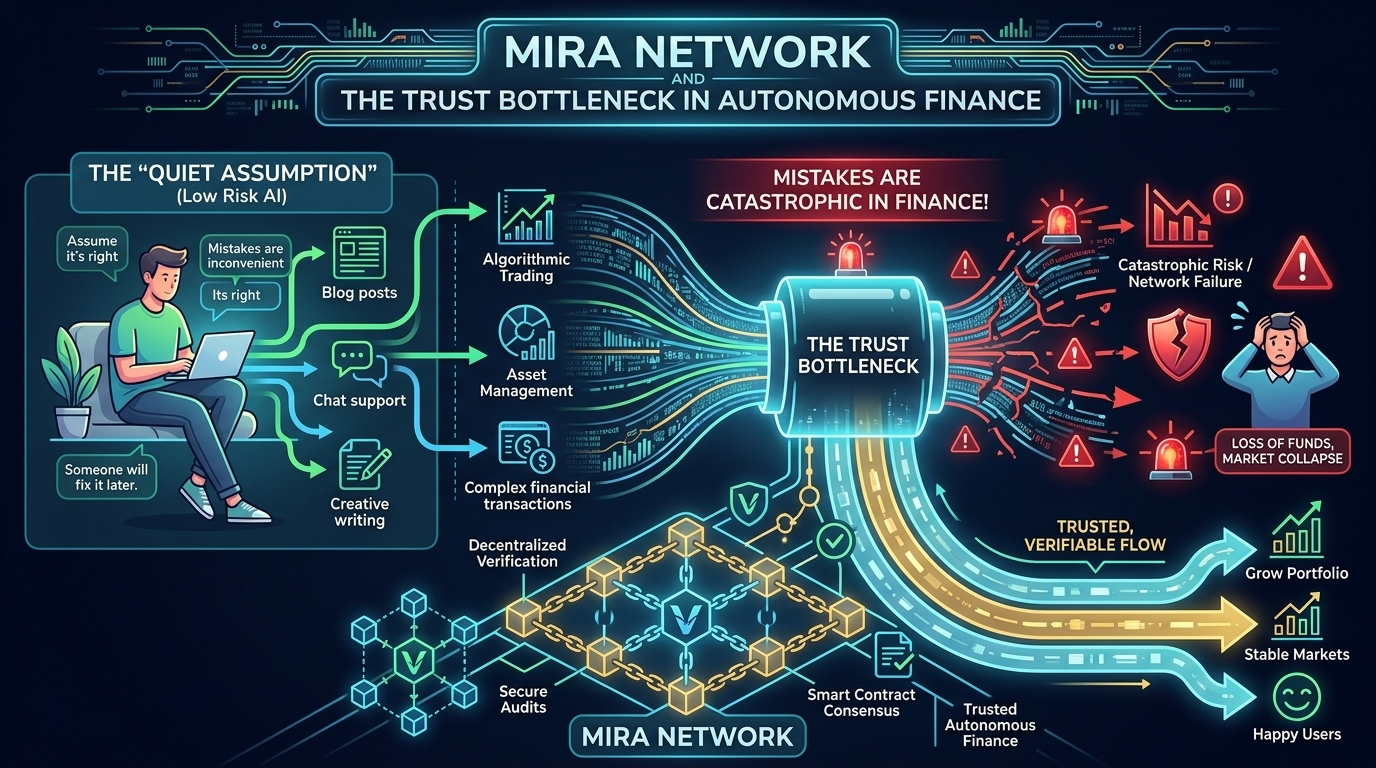

La maggior parte dei sistemi AI opera su un'assunzione silenziosa: il modello è probabilmente giusto, e se è sbagliato, qualcuno lo correggerà in seguito. In ambienti a basso rischio come la redazione di contenuti o la generazione di risposte di supporto, quella logica regge. Gli errori sono scomodi, non catastrofici.

La maggior parte dei sistemi AI opera su un'assunzione silenziosa: il modello è probabilmente giusto, e se è sbagliato, qualcuno lo correggerà in seguito. In ambienti a basso rischio come la redazione di contenuti o la generazione di risposte di supporto, quella logica regge. Gli errori sono scomodi, non catastrofici.

Ma la finanza è diversa.

Quando l'AI inizia a eseguire strategie DeFi autonome on-chain, sintetizzando ricerche complesse per tesi di investimento, o plasmando decisioni di governance DAO, “probabilmente giusto” diventa una responsabilità. Il capitale si muove. I voti passano. I mercati reagiscono. Non c'è un pulsante di pausa per la revisione una volta che le transazioni si stabilizzano su una blockchain.

Questo è il collo di bottiglia della fiducia.

La sfida non è che i modelli di IA siano intrinsecamente difettosi. È che la loro affidabilità è opaca. Un modello linguistico può produrre una risposta sicura senza fornire un segnale misurabile di accuratezza contestuale. Nei sistemi ad alto rischio, quell'ambiguità crea un rischio strutturale.

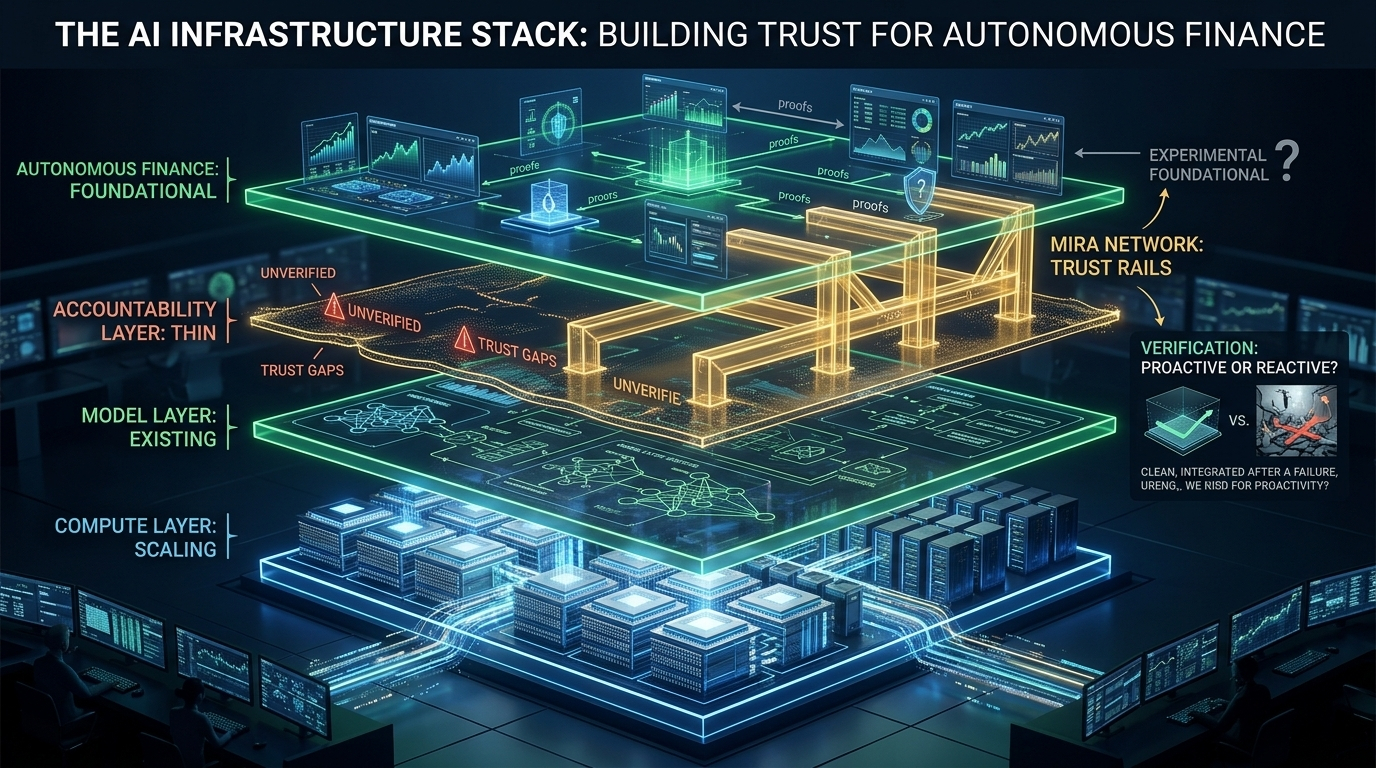

Man mano che la capacità dell'IA accelera, l'infrastruttura di responsabilità non tiene il passo. Abbiamo potenza di calcolo. Abbiamo modelli sempre più potenti. Ciò che manca è un robusto livello di verifica.

Le reti di verifica decentralizzate offrono un percorso da seguire. Invece di accettare i risultati per valore nominale, decompongono le risposte dell'IA in affermazioni discrete e rivedibili. I validatori indipendenti valutano quelle affermazioni. L'accordo con il consenso è premiato. La divergenza non supportata comporta conseguenze economiche. Gli incentivi modellano la diligenza.

Per gli ecosistemi Web3, questa architettura ha un altro vantaggio: auditabilità. Quando la verifica è ancorata ai registri blockchain, ogni revisione diventa tracciabile. Chi ha convalidato il risultato? Quando? Su quale base? La trasparenza trasforma i risultati dell'IA da previsioni opache in artefatti difendibili.

Questo cambiamento ridefinisce la curva di adozione per l'IA nella finanza. Il fattore limitante non è più l'intelligenza del modello. È la fiducia istituzionale.

I livelli di verifica non migliorano solo l'accuratezza; rendono i risultati dell'IA sostenibili sotto scrutinio. Consentono ai sistemi autonomi di operare in ambienti in cui la credibilità è non negoziabile.

Lo stack infrastrutturale dell'IA è ancora in fase di maturazione. Il livello dei modelli esiste. Il livello di calcolo si espande. Il livello di responsabilità rimane sottile.

Progetti come Mira Network si stanno posizionando per colmare quel divario—costruendo le infrastrutture di fiducia necessarie affinché la finanza autonoma passi da sperimentale a fondazionale.

Nei mercati delle infrastrutture, i sistemi che diventano flussi di lavoro predefiniti tendono a vincere. La questione aperta è se i mercati daranno priorità alla verifica in modo proattivo—o solo dopo che un fallimento rende la sua assenza innegabile.